When Environments Shift: Safe Planning with Generative Priors and Robust Conformal Prediction

作者: Kaizer Rahaman, Jyotirmoy V. Deshmukh, Ashish R. Hota, Lars Lindemann

分类: eess.SY, cs.RO

发布日期: 2026-02-13

💡 一句话要点

提出基于生成先验和鲁棒共形预测的安全规划框架,应对环境变化下的自主系统安全问题。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 自主系统 分布偏移 安全规划 共形预测 扩散模型 模型预测控制 鲁棒性 环境变化

📋 核心要点

- 自主系统在部署时面临分布偏移问题,导致基于训练数据的安全保证失效,威胁系统安全。

- 利用条件扩散模型学习环境分布随干扰参数的变化,生成合成数据,并结合鲁棒共形预测构建安全区域。

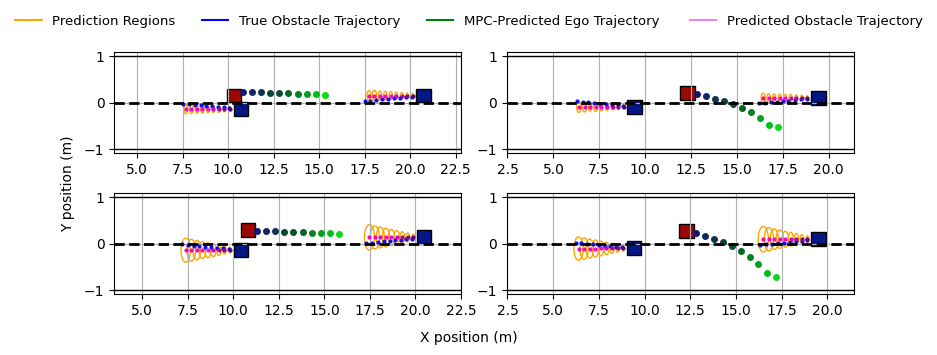

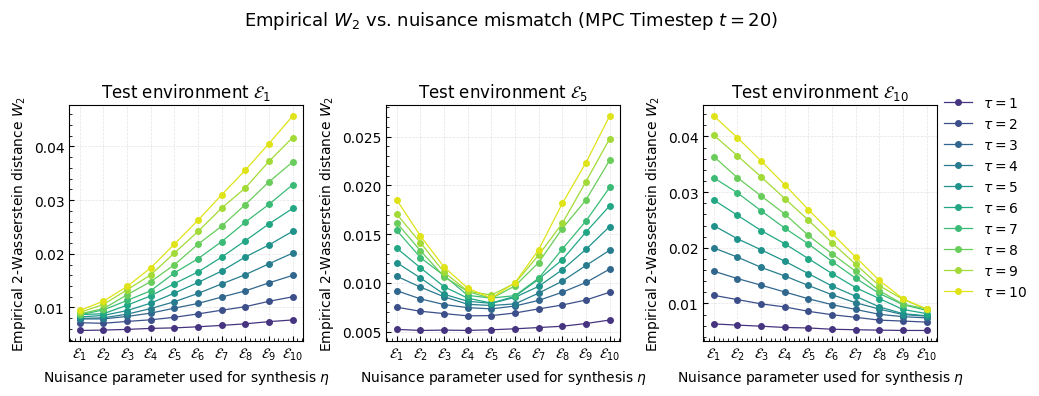

- 在ORCA模拟器中验证了该方法在多种分布偏移下的安全性,优于基于静态训练数据的规划方法。

📝 摘要(中文)

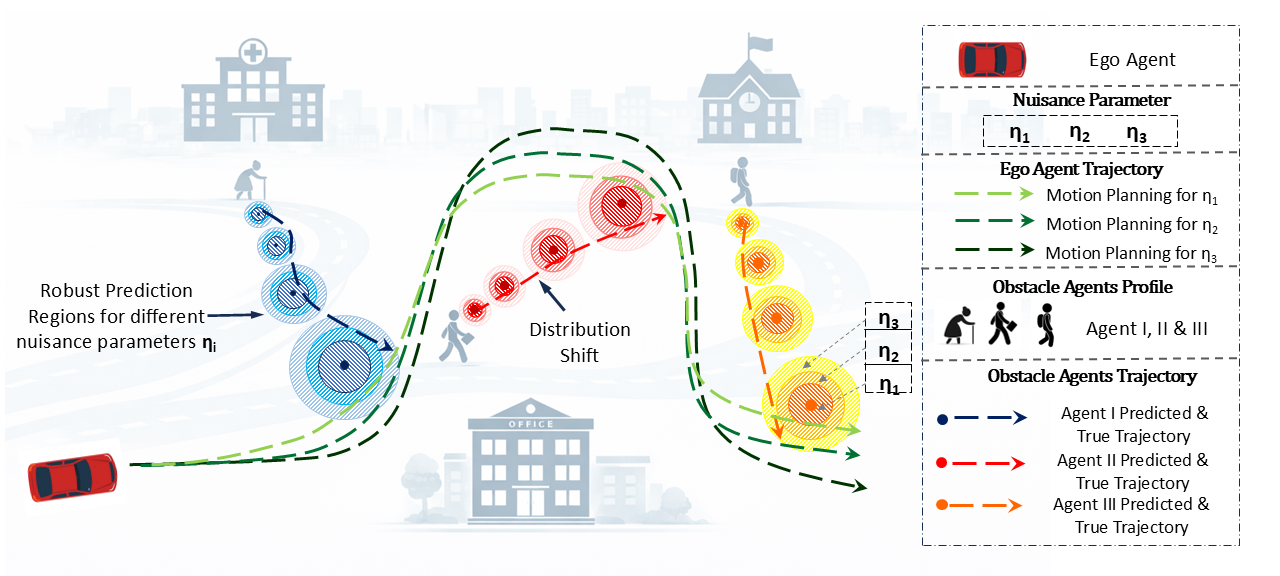

自主系统在不断变化的环境中运行,部署环境与训练环境的差异(即分布偏移)会损害其安全性。本文提出一种在分布偏移下具有鲁棒性的规划框架。该框架首先假设环境的底层数据分布由一个可观测的干扰参数(如交通密度)参数化;然后训练一个条件扩散模型,以捕捉分布偏移与干扰参数的函数关系;接着在线观测干扰参数,并从扩散模型中生成廉价的合成数据;最后设计一个模型预测控制器(MPC),该控制器嵌入了从合成数据构建的共形预测(CP)区域。重要的是,通过使用鲁棒CP来解决底层数据分布与扩散模型之间的差异。因此,与从单个静态训练数据集获得的计划相比,使用鲁棒CP计算的计划具有概率安全保证。在ORCA模拟器中的实验结果表明,该方法在各种分布偏移下均能保证安全性。

🔬 方法详解

问题定义:自主系统,如自动驾驶车辆,在实际部署中面临环境分布偏移的问题,例如交通密度、道路能见度等因素的变化。传统的基于模型预测控制(MPC)和共形预测(CP)的方法,依赖于静态的训练数据,当部署环境与训练环境存在差异时,其提供的安全保证会失效,从而导致安全风险。

核心思路:本文的核心思路是利用生成模型(条件扩散模型)来模拟环境分布随干扰参数的变化,从而生成与当前环境相符的合成数据。然后,基于这些合成数据构建共形预测区域,并将其嵌入到MPC中,以实现对环境变化的鲁棒性。此外,为了解决生成模型与真实环境之间的差异,采用了鲁棒共形预测,进一步提升了安全保证的可靠性。

技术框架:该框架包含以下几个主要模块:1) 干扰参数观测模块:在线观测环境中的干扰参数,如交通密度。2) 条件扩散模型训练模块:利用历史数据训练一个条件扩散模型,该模型能够根据干扰参数生成相应的环境数据。3) 合成数据生成模块:根据当前观测到的干扰参数,利用训练好的扩散模型生成合成数据。4) 鲁棒共形预测模块:基于合成数据构建共形预测区域,并采用鲁棒方法来应对生成模型与真实环境之间的差异。5) 模型预测控制模块:将鲁棒共形预测区域嵌入到MPC中,进行安全规划。

关键创新:该方法最重要的创新点在于将生成模型(条件扩散模型)与鲁棒共形预测相结合,从而实现了对环境分布偏移的鲁棒性。与传统的基于静态数据的CP方法相比,该方法能够根据当前环境动态调整预测区域,从而提供更可靠的安全保证。此外,使用鲁棒CP进一步考虑了生成模型的不确定性,提升了整体的安全性。

关键设计:条件扩散模型的具体结构和训练方式是关键设计之一。论文中可能采用了特定的网络结构(如U-Net)和损失函数(如变分下界)来训练扩散模型,以保证其能够准确地捕捉环境分布随干扰参数的变化。鲁棒共形预测的具体实现方式也是关键,可能涉及到对传统CP算法的修改,例如引入额外的惩罚项或调整置信水平,以应对生成模型的不确定性。MPC的设计也需要考虑共形预测区域的嵌入方式,以及如何平衡安全性和性能。

🖼️ 关键图片

📊 实验亮点

论文在ORCA模拟器中进行了实验,验证了该方法在多种分布偏移下的安全性。实验结果表明,与基于静态训练数据的传统方法相比,该方法能够显著提高自主系统在环境变化下的安全性,具体性能提升数据未知,但实验结果表明了其有效性。

🎯 应用场景

该研究成果可广泛应用于需要在动态变化环境中运行的自主系统,例如自动驾驶、机器人导航、无人机飞行等。通过提高系统在分布偏移下的安全性,可以降低事故风险,提升系统的可靠性和实用性,加速自主系统在实际场景中的部署和应用。

📄 摘要(原文)

Autonomous systems operate in environments that may change over time. An example is the control of a self-driving vehicle among pedestrians and human-controlled vehicles whose behavior may change based on factors such as traffic density, road visibility, and social norms. Therefore, the environment encountered during deployment rarely mirrors the environment and data encountered during training -- a phenomenon known as distribution shift -- which can undermine the safety of autonomous systems. Conformal prediction (CP) has recently been used along with data from the training environment to provide prediction regions that capture the behavior of the environment with a desired probability. When embedded within a model predictive controller (MPC), one can provide probabilistic safety guarantees, but only when the deployment and training environments coincide. Once a distribution shift occurs, these guarantees collapse. We propose a planning framework that is robust under distribution shifts by: (i) assuming that the underlying data distribution of the environment is parameterized by a nuisance parameter, i.e., an observable, interpretable quantity such as traffic density, (ii) training a conditional diffusion model that captures distribution shifts as a function of the nuisance parameter, (iii) observing the nuisance parameter online and generating cheap, synthetic data from the diffusion model for the observed nuisance parameter, and (iv) designing an MPC that embeds CP regions constructed from such synthetic data. Importantly, we account for discrepancies between the underlying data distribution and the diffusion model by using robust CP. Thus, the plans computed using robust CP enjoy probabilistic safety guarantees, in contrast with plans obtained from a single, static set of training data. We empirically demonstrate safety under diverse distribution shifts in the ORCA simulator.