Reinforcement Learning-based Home Energy Management with Heterogeneous Batteries and Stochastic EV Behaviour

作者: Meng Yuan, Ye Wang, Xinghuo Yu, Torsten Wik, Changfu Zou

分类: eess.SY

发布日期: 2026-02-04

💡 一句话要点

提出基于强化学习的家庭能源管理框架,优化异构电池和随机电动汽车行为下的能源调度。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 家庭能源管理 深度强化学习 异构电池 电动汽车 能源调度 约束马尔可夫决策过程 拉格朗日SAC

📋 核心要点

- 现有家庭能源管理方法难以有效协调光伏、电动汽车和储能系统,尤其是在用户行为具有随机性的情况下。

- 提出基于拉格朗日软演员-评论家算法的深度强化学习框架,显式考虑异构电池退化和用户行为随机性,优化能源调度。

- 实验结果表明,该框架在满足约束、降低成本和减少电池退化方面优于传统方法,具有显著的经济效益。

📝 摘要(中文)

本文提出了一种基于深度强化学习(DRL)的家庭能源管理框架,该框架能够联合最小化能源消耗和电池退化,同时保证居住者的舒适度和电动汽车(EV)的充电需求。与现有研究不同,本文在优化过程中显式地考虑了固定式和电动汽车电池的异构退化特性,以及用户在到达时间、离开时间和行驶距离方面的随机行为。该能源调度问题被建模为一个约束马尔可夫决策过程(CMDP),并使用拉格朗日软演员-评论家(SAC)算法求解。这种方法使智能体能够学习最优控制策略,从而在存在随机不确定性的情况下,执行包括室内温度范围和出发时目标电动汽车充电状态在内的物理约束。为期一年的数值模拟表明,所提出的框架在满足物理约束、消除热振荡和实现显著经济效益方面是有效的。具体而言,该方法与两种标准基于规则的基线方法相比,显著降低了累积运营成本,同时将电池退化成本降低了8.44%。

🔬 方法详解

问题定义:论文旨在解决家庭能源管理中,如何有效协调光伏发电、电动汽车和固定储能系统,在最小化能源支出和电池退化成本的同时,满足用户舒适度和电动汽车充电需求的问题。现有方法难以处理用户行为的随机性(如到达/离开时间、行驶距离)以及不同类型电池的异构退化特性,导致次优的能源调度策略。

核心思路:论文的核心思路是将家庭能源管理问题建模为约束马尔可夫决策过程(CMDP),并利用深度强化学习(DRL)算法学习最优的能源调度策略。通过引入拉格朗日方法,将约束条件(如室内温度范围、电动汽车充电需求)融入到奖励函数中,从而引导智能体学习满足约束的策略。同时,显式地考虑了不同类型电池的退化模型,以更准确地评估电池的使用成本。

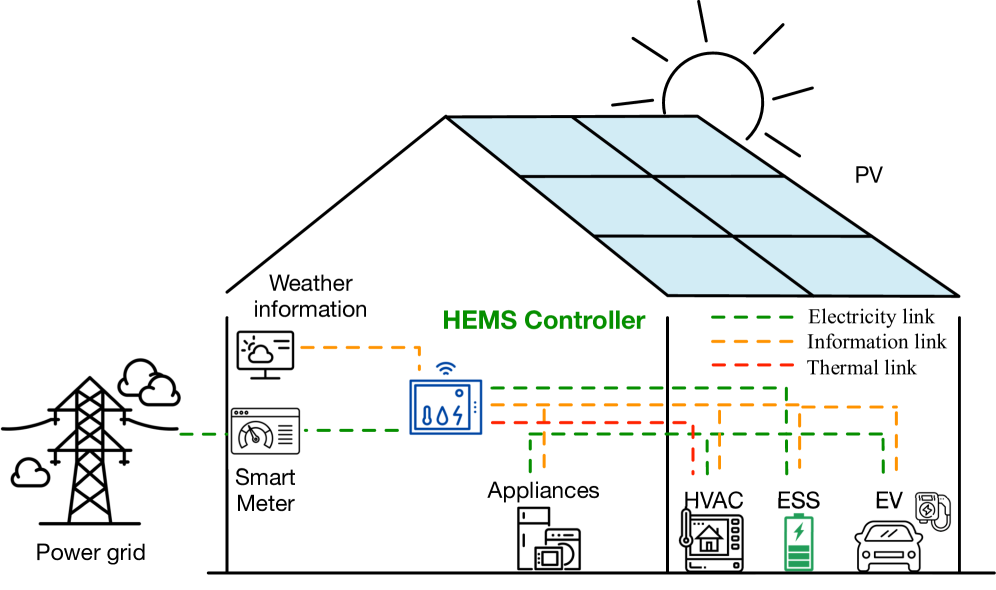

技术框架:整体框架包括以下几个主要模块:1) 环境建模:构建家庭能源系统的仿真环境,包括光伏发电模型、电动汽车模型、固定储能模型、家庭用电模型以及用户行为模型。2) 状态空间定义:定义智能体的状态空间,包括室内温度、电池电量、电动汽车状态、天气信息等。3) 动作空间定义:定义智能体的动作空间,包括储能系统的充放电功率、电动汽车的充放电功率等。4) 奖励函数设计:设计奖励函数,包括能源支出成本、电池退化成本以及违反约束的惩罚项。5) 智能体训练:使用拉格朗日软演员-评论家(SAC)算法训练智能体,使其学习最优的能源调度策略。

关键创新:论文的关键创新在于:1) 显式地考虑了异构电池的退化特性,提高了电池寿命评估的准确性。2) 将用户行为的随机性纳入模型,增强了模型的鲁棒性。3) 使用拉格朗日SAC算法求解约束马尔可夫决策过程,保证了策略的可行性。

关键设计:论文使用拉格朗日SAC算法,其中演员网络和评论家网络都采用深度神经网络结构。奖励函数的设计至关重要,需要仔细权衡能源支出成本、电池退化成本和约束违反惩罚之间的关系。拉格朗日乘子的更新策略也需要精心设计,以保证约束能够得到满足。具体参数设置未知。

🖼️ 关键图片

📊 实验亮点

数值模拟结果表明,所提出的框架与两种基于规则的基线方法相比,显著降低了累积运营成本,同时将电池退化成本降低了8.44%。此外,该方法能够有效满足物理约束,消除热振荡,保证用户舒适度。

🎯 应用场景

该研究成果可应用于智能家居、微电网等领域,实现家庭能源的智能化管理和优化调度,降低能源消耗,延长电池寿命,提高能源利用效率,促进可再生能源的消纳,具有重要的经济和社会价值。未来可扩展到更大规模的社区或城市能源管理。

📄 摘要(原文)

The widespread adoption of photovoltaic (PV), electric vehicles (EVs), and stationary energy storage systems (ESS) in households increases system complexity while simultaneously offering new opportunities for energy regulation. However, effectively coordinating these resources under uncertainties remains challenging. This paper proposes a novel home energy management framework based on deep reinforcement learning (DRL) that can jointly minimise energy expenditure and battery degradation while guaranteeing occupant comfort and EV charging requirements. Distinct from existing studies, we explicitly account for the heterogeneous degradation characteristics of stationary and EV batteries in the optimisation, alongside stochastic user behaviour regarding arrival time, departure time, and driving distance. The energy scheduling problem is formulated as a constrained Markov decision process (CMDP) and solved using a Lagrangian soft actor-critic (SAC) algorithm. This approach enables the agent to learn optimal control policies that enforce physical constraints, including indoor temperature bounds and target EV state of charge upon departure, despite stochastic uncertainties. Numerical simulations over a one-year horizon demonstrate the effectiveness of the proposed framework in satisfying physical constraints while eliminating thermal oscillations and achieving significant economic benefits. Specifically, the method reduces the cumulative operating cost substantially compared to two standard rule-based baselines while simultaneously decreasing battery degradation costs by 8.44%.