Reinforcement Learning-Based Co-Design and Operation of Chiller and Thermal Energy Storage for Cost-Optimal HVAC Systems

作者: Tanay Raghunandan Srinivasa, Vivek Deulkar, Aviruch Bhatia, Vishal Garg

分类: eess.SY, cs.AI

发布日期: 2026-01-30

备注: 11 pages, 3 figures

💡 一句话要点

基于强化学习的冷水机组与储能协同优化设计与运行,降低暖通空调系统生命周期成本

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 强化学习 暖通空调系统 冷水机组 热能存储 协同优化 马尔可夫决策过程 深度Q网络

📋 核心要点

- 现有方法难以应对冷水机组和储能系统容量成本不对称带来的协同设计挑战,容易陷入局部最优。

- 论文提出基于强化学习的协同优化方法,将冷水机组运行建模为MDP,利用DQN学习最优运行策略。

- 实验结果表明,该方法能够有效确定冷水机组和储能的最佳容量配置,降低生命周期成本。

📝 摘要(中文)

本文研究了基于强化学习的商业暖通空调系统冷却基础设施的联合运行和容量优化设计,目标是最小化30年生命周期成本。冷却系统由固定容量的电动冷水机组和热能存储(TES)单元组成,二者协同运行以满足随时间变化的电价下的随机小时冷却需求。生命周期成本包括资本支出和折现的运营成本,包括电力消耗和维护。一个关键挑战来自资本成本的强烈不对称性:增加一个单位的冷水机组容量远比等效增加TES容量昂贵。因此,在确保最佳运行下零冷却负荷损失的同时,确定冷水机组和TES容量的正确组合是一个重要的协同设计问题。为了解决这个问题,我们将固定基础设施配置下的冷水机组运行问题建模为有限时域马尔可夫决策过程(MDP),其中控制动作是冷水机组的部分负荷率(PLR)。使用具有约束动作空间的深度Q网络(DQN)求解MDP。学习到的DQN强化学习策略最小化了历史冷却需求和电价轨迹上的电力成本。对于每个候选的冷水机组-TES容量配置,评估训练后的策略。然后,我们将注意力限制在完全满足冷却需求的配置上,并在此可行集上执行生命周期成本最小化,以确定成本最优的基础设施设计。使用这种方法,我们确定最佳的冷水机组和热能存储容量分别为700和1500。

🔬 方法详解

问题定义:论文旨在解决商业暖通空调系统中冷水机组和热能存储(TES)的联合优化设计和运行问题,目标是最小化30年的生命周期成本。现有方法在处理冷水机组和TES容量成本的显著不对称性时存在困难,导致难以找到全局最优的容量配置方案,并且难以保证在各种工况下都能满足冷却需求。

核心思路:论文的核心思路是将冷水机组的运行问题建模为一个有限时域的马尔可夫决策过程(MDP),并使用深度强化学习(DQN)来学习最优的冷水机组运行策略。通过学习到的策略,可以评估不同冷水机组和TES容量配置下的运行成本,从而在满足冷却需求的前提下,找到生命周期成本最低的容量配置方案。这种方法能够有效应对容量成本不对称带来的挑战,并保证系统的可靠运行。

技术框架:整体框架包括以下几个主要步骤:1)针对给定的冷水机组和TES容量配置,将冷水机组的运行问题建模为MDP。2)使用DQN算法训练一个强化学习策略,该策略控制冷水机组的部分负荷率(PLR),以最小化电力成本。3)对于每个候选的容量配置,使用训练好的策略进行评估,计算其生命周期成本。4)筛选出能够完全满足冷却需求的容量配置,并在这些配置中选择生命周期成本最低的作为最优设计。

关键创新:论文的关键创新在于将强化学习应用于冷水机组和TES的协同优化设计和运行问题。与传统的优化方法相比,强化学习能够更好地处理随机冷却需求和时变电价带来的不确定性,并学习到适应不同工况的最优运行策略。此外,论文还考虑了容量成本的不对称性,并将其纳入到优化目标中,从而能够找到更经济的容量配置方案。

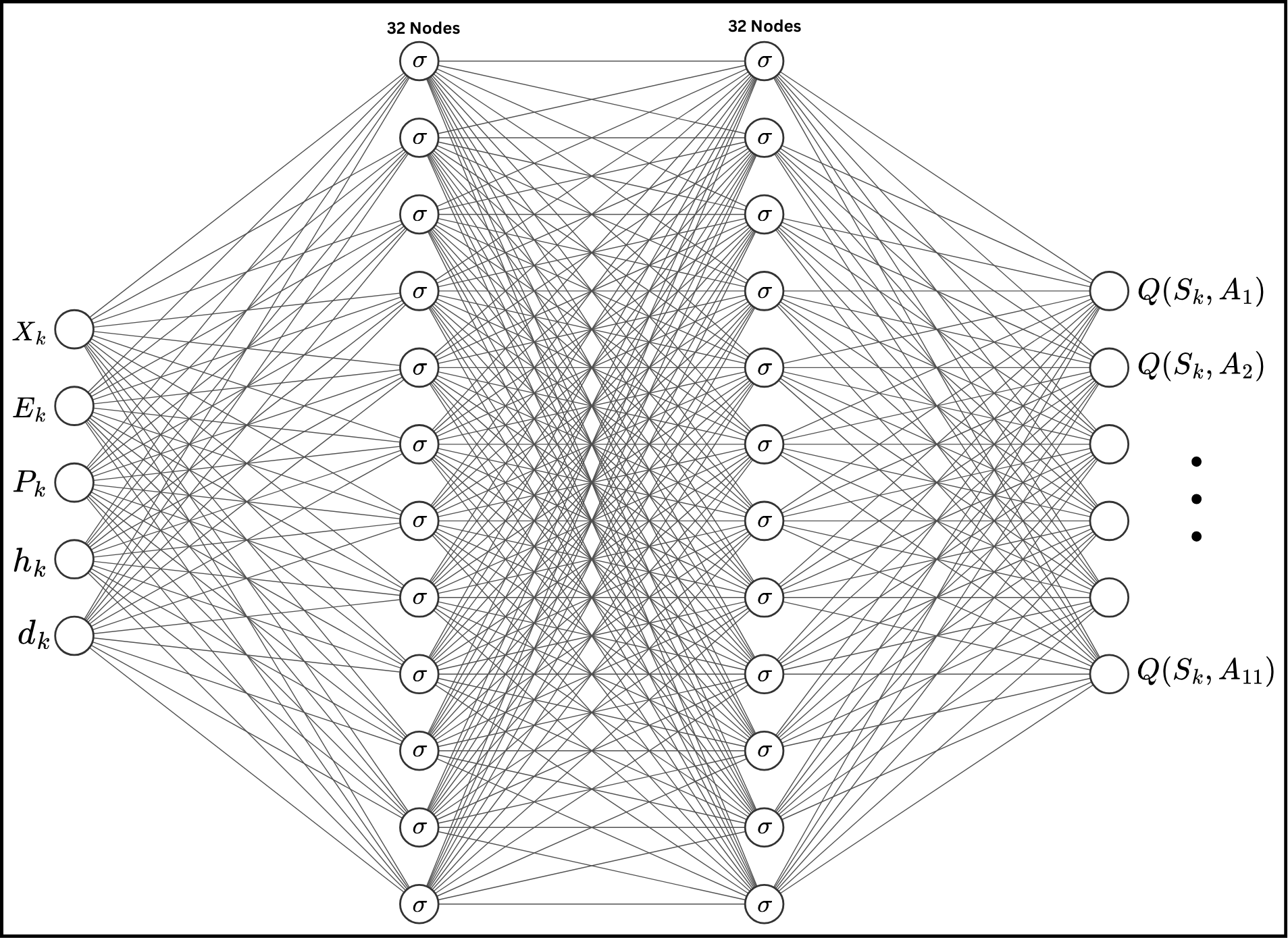

关键设计:MDP的状态空间包括当前时刻的冷却需求、TES的储能水平以及电价等信息。动作空间是冷水机组的部分负荷率(PLR),并对其进行了约束,以保证冷水机组的稳定运行。奖励函数是负的电力成本,目标是最大化累积奖励。DQN网络采用多层感知机结构,输入是MDP的状态,输出是每个动作的Q值。使用经验回放和目标网络等技术来提高DQN的训练稳定性。

🖼️ 关键图片

📊 实验亮点

论文通过实验验证了所提出方法的有效性。实验结果表明,该方法能够找到最优的冷水机组和热能存储容量,分别为700和1500。与传统方法相比,该方法能够显著降低暖通空调系统的生命周期成本,并保证在各种工况下都能满足冷却需求。

🎯 应用场景

该研究成果可应用于商业建筑、工业园区等场景的暖通空调系统设计与运行优化。通过优化冷水机组和储能系统的容量配置和运行策略,可以显著降低能源消耗和运行成本,提高能源利用效率,并减少碳排放,具有重要的经济和社会价值。

📄 摘要(原文)

We study the joint operation and sizing of cooling infrastructure for commercial HVAC systems using reinforcement learning, with the objective of minimizing life-cycle cost over a 30-year horizon. The cooling system consists of a fixed-capacity electric chiller and a thermal energy storage (TES) unit, jointly operated to meet stochastic hourly cooling demands under time-varying electricity prices. The life-cycle cost accounts for both capital expenditure and discounted operating cost, including electricity consumption and maintenance. A key challenge arises from the strong asymmetry in capital costs: increasing chiller capacity by one unit is far more expensive than an equivalent increase in TES capacity. As a result, identifying the right combination of chiller and TES sizes, while ensuring zero loss-of-cooling-load under optimal operation, is a non-trivial co-design problem. To address this, we formulate the chiller operation problem for a fixed infrastructure configuration as a finite-horizon Markov Decision Process (MDP), in which the control action is the chiller part-load ratio (PLR). The MDP is solved using a Deep Q Network (DQN) with a constrained action space. The learned DQN RL policy minimizes electricity cost over historical traces of cooling demand and electricity prices. For each candidate chiller-TES sizing configuration, the trained policy is evaluated. We then restrict attention to configurations that fully satisfy the cooling demand and perform a life-cycle cost minimization over this feasible set to identify the cost-optimal infrastructure design. Using this approach, we determine the optimal chiller and thermal energy storage capacities to be 700 and 1500, respectively.