Spatiotemporal Continual Learning for Mobile Edge UAV Networks: Mitigating Catastrophic Forgetting

作者: Chuan-Chi Lai

分类: cs.NI, cs.MA, eess.SY

发布日期: 2026-01-29

备注: 12 pages, 9 figures, manuscript submitted to IEEE Transactions on Emerging Topics in Computing

💡 一句话要点

提出时空持续学习框架,解决移动边缘无人机网络中的灾难性遗忘问题

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱八:物理动画 (Physics-based Animation)

关键词: 时空持续学习 移动边缘计算 无人机网络 深度强化学习 多智能体系统 灾难性遗忘 策略优化

📋 核心要点

- 传统DRL方法在无人机网络环境切换时易发生灾难性遗忘,需要昂贵的重训练。

- 提出时空持续学习框架STCL,利用分组解耦策略优化GDPO和3D移动性进行补偿。

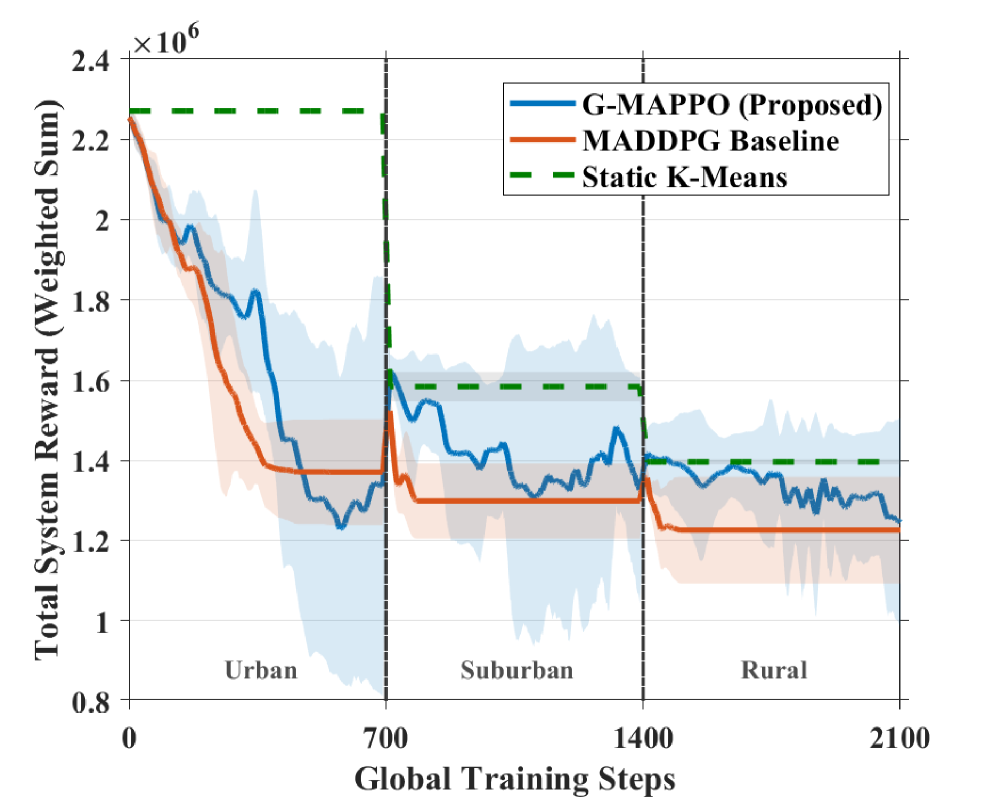

- 实验表明STCL具有卓越的弹性,服务可靠性恢复至0.95,容量增益达20%。

📝 摘要(中文)

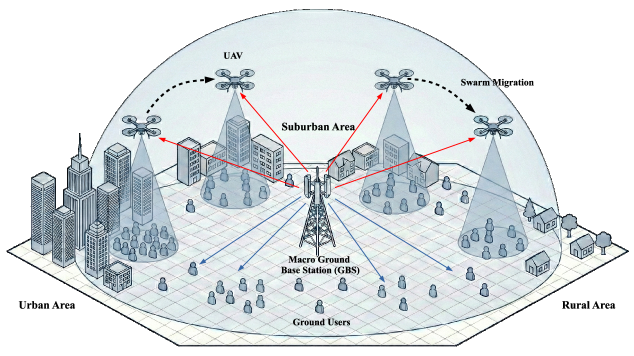

本文旨在解决移动边缘无人机网络在动态时空环境中维持鲁棒服务的关键挑战。传统的深度强化学习(DRL)方法在不同任务场景间切换时,例如从密集城市集群到稀疏农村区域,常常遭受灾难性遗忘。这些转换通常需要计算成本高昂的重训练或模型重置来适应新的用户分布,导致服务中断。为了克服这些限制,我们提出了一种计算高效的时空持续学习(STCL)框架,该框架通过分组解耦多智能体近端策略优化(G-MAPPO)算法实现。我们的方法集成了一种新颖的分组解耦策略优化(GDPO)机制,该机制利用动态z-score归一化来自动平衡异构目标,包括能源效率、用户公平性和覆盖范围。这种机制有效地缓解了由概念漂移引起的梯度冲突,而无需离线重训练。此外,该框架利用无人机的3D移动性作为空间补偿层,使无人机群能够自主调整高度以适应极端的密度波动。大量仿真表明,所提出的STCL框架实现了卓越的弹性,其特征是在阶段转换期间服务可靠性弹性恢复到大约0.95。与MADDPG基线相比,G-MAPPO不仅防止了知识遗忘,而且在极端流量负载下提供了20%的有效容量增益,验证了其作为边缘使能空中集群的可扩展解决方案的潜力。

🔬 方法详解

问题定义:论文旨在解决移动边缘无人机网络在动态时空环境中,由于用户分布变化导致的深度强化学习模型灾难性遗忘问题。现有方法通常需要对模型进行重新训练,计算成本高昂,且会导致服务中断。

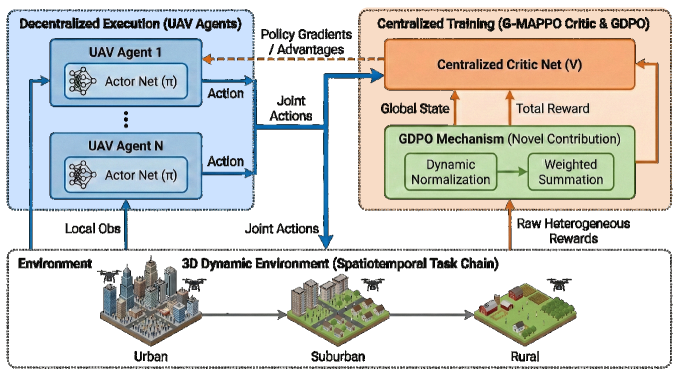

核心思路:论文的核心思路是利用时空持续学习(STCL)框架,通过分组解耦策略优化(GDPO)机制和无人机的3D移动性,使无人机网络能够适应不断变化的环境,避免灾难性遗忘。GDPO机制负责平衡不同的优化目标,而3D移动性则作为空间补偿层,应对用户密度波动。

技术框架:该框架基于多智能体近端策略优化(MAPPO)算法,并引入了分组解耦策略优化(GDPO)机制。整体流程如下:首先,无人机网络感知当前环境状态,包括用户分布、能量状态等。然后,GDPO机制根据这些状态信息,动态调整各个优化目标的权重,例如能源效率、用户公平性和覆盖范围。接着,无人机根据调整后的策略,执行动作,包括调整位置和功率等。最后,环境反馈新的状态信息,用于更新策略。

关键创新:论文的关键创新在于提出了分组解耦策略优化(GDPO)机制,该机制利用动态z-score归一化来自动平衡异构目标,从而缓解了由概念漂移引起的梯度冲突,而无需离线重训练。这与传统的DRL方法需要手动调整权重或进行离线重训练有本质区别。此外,利用无人机的3D移动性作为空间补偿层也是一个创新点。

关键设计:GDPO机制的关键设计在于动态z-score归一化,它能够将不同尺度的优化目标归一化到同一尺度,从而避免梯度冲突。具体的实现方式是,对于每个优化目标,计算其均值和标准差,然后使用z-score公式进行归一化。此外,损失函数的设计也至关重要,需要综合考虑能源效率、用户公平性和覆盖范围等多个因素。网络结构方面,采用了多智能体架构,每个无人机对应一个智能体,共享部分网络参数。

🖼️ 关键图片

📊 实验亮点

实验结果表明,所提出的STCL框架在阶段转换期间服务可靠性弹性恢复到大约0.95,显著优于传统的DRL方法。与MADDPG基线相比,G-MAPPO不仅防止了知识遗忘,而且在极端流量负载下提供了20%的有效容量增益。这些结果验证了该框架在动态环境下的鲁棒性和有效性。

🎯 应用场景

该研究成果可应用于各种需要动态资源分配的移动边缘计算场景,例如灾难救援、大型活动保障、智慧城市等。通过自适应调整无人机的位置和资源分配,可以有效提高服务质量、降低运营成本,并为用户提供更可靠的服务。未来,该技术有望推动无人机网络在更多领域的应用。

📄 摘要(原文)

This paper addresses the critical challenge of coordinating mobile edge UAV networks to maintain robust service in highly dynamic spatiotemporal environments. Conventional Deep Reinforcement Learning (DRL) approaches often suffer from catastrophic forgetting when transitioning between distinct task scenarios, such as moving from dense urban clusters to sparse rural areas. These transitions typically necessitate computationally expensive retraining or model resets to adapt to new user distributions, leading to service interruptions. To overcome these limitations, we propose a computationally efficient Spatiotemporal Continual Learning (STCL) framework realized through a Group-Decoupled Multi-Agent Proximal Policy Optimization (G-MAPPO) algorithm. Our approach integrates a novel Group-Decoupled Policy Optimization (GDPO) mechanism that utilizes dynamic $z$-score normalization to autonomously balance heterogeneous objectives, including energy efficiency, user fairness, and coverage. This mechanism effectively mitigates gradient conflicts induced by concept drifts without requiring offline retraining. Furthermore, the framework leverages the 3D mobility of UAVs as a spatial compensation layer, enabling the swarm to autonomously adjust altitudes to accommodate extreme density fluctuations. Extensive simulations demonstrate that the proposed STCL framework achieves superior resilience, characterized by an elastic recovery of service reliability to approximately 0.95 during phase transitions. Compared to the MADDPG baseline, G-MAPPO not only prevents knowledge forgetting but also delivers an effective capacity gain of 20\% under extreme traffic loads, validating its potential as a scalable solution for edge-enabled aerial swarms.