ReLU Networks for Model Predictive Control: Network Complexity and Performance Guarantees

作者: Xingchen Li, Keyou You

分类: eess.SY, cs.LG, math.OC

发布日期: 2026-01-23

💡 一句话要点

针对模型预测控制,提出保证性能的ReLU网络复杂度优化方法

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 模型预测控制 ReLU网络 神经网络控制 网络复杂度 闭环性能

📋 核心要点

- 现有基于ReLU网络的MPC方法缺乏对网络复杂度的理论指导,难以保证闭环性能。

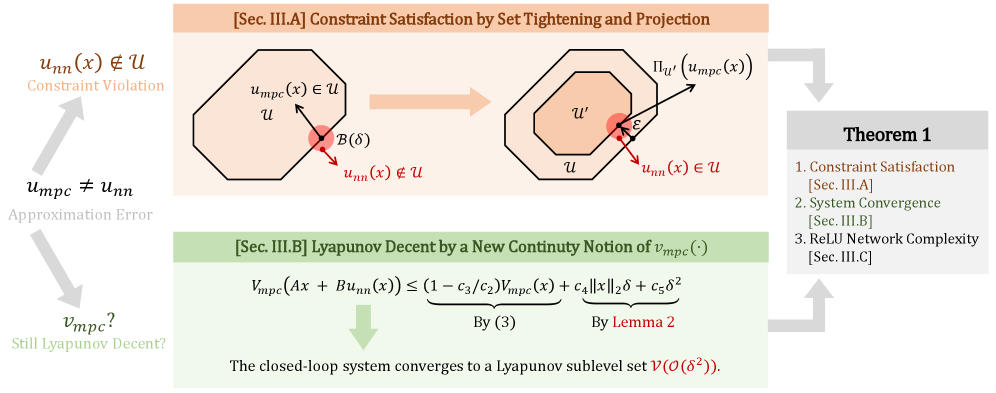

- 论文提出基于投影的方法来处理硬约束,并利用状态相关的Lipschitz连续性进行收敛分析。

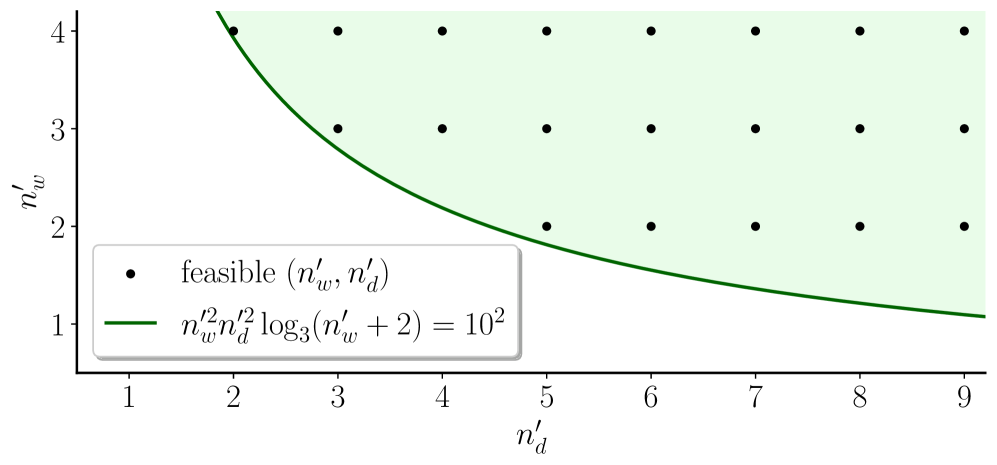

- 论文推导了ReLU网络宽度和深度的显式界限,并提出了非均匀误差框架以降低网络复杂度。

📝 摘要(中文)

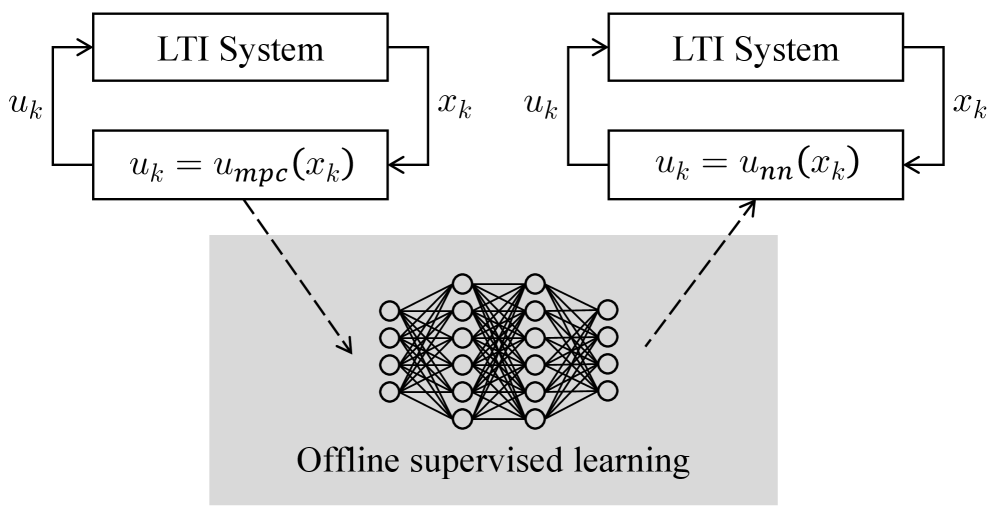

近年来,使用ReLU神经网络(NNs)来表示模型预测控制(MPC)策略的方法重新受到关注。然而,确定确保闭环性能所需的网络复杂度仍然是一个根本性的开放问题。这涉及一个关键的精度-复杂度权衡:网络过小可能无法捕获MPC策略,而网络过大可能会超过ReLU网络近似的优势。在这项工作中,我们提出了一种基于投影的方法来强制执行硬约束,并为最优MPC成本函数建立了一种状态相关的Lipschitz连续性属性,从而能够对闭环系统进行精确的收敛分析。我们首次推导了ReLU网络宽度和深度的显式界限,用于近似具有保证闭环性能的MPC策略。为了进一步降低网络复杂性并提高闭环性能,我们提出了一个非均匀误差框架,该框架具有状态感知缩放函数,可以自适应地调整ReLU网络的输入和输出。我们的贡献为可认证的基于ReLU NN的MPC提供了一个基础性的步骤。

🔬 方法详解

问题定义:论文旨在解决使用ReLU神经网络近似模型预测控制(MPC)策略时,如何确定合适的网络复杂度,以保证闭环系统的性能。现有方法缺乏理论指导,网络过小无法有效捕获MPC策略,网络过大则会降低计算效率,难以实现精度和复杂度的平衡。

核心思路:论文的核心思路是利用投影法处理硬约束,并建立最优MPC成本函数的状态相关Lipschitz连续性,从而进行精确的收敛分析。基于此,推导出ReLU网络宽度和深度的显式界限,并提出非均匀误差框架,自适应地调整ReLU网络的输入和输出,进一步降低网络复杂度。

技术框架:整体框架包含以下几个主要步骤:1) 使用投影法处理MPC中的硬约束;2) 建立最优MPC成本函数的状态相关Lipschitz连续性;3) 基于Lipschitz连续性,推导ReLU网络宽度和深度的显式界限,以保证闭环性能;4) 提出非均匀误差框架,通过状态感知缩放函数自适应地调整ReLU网络的输入和输出。

关键创新:论文的关键创新在于:1) 首次推导了ReLU网络宽度和深度的显式界限,为选择合适的网络复杂度提供了理论依据;2) 提出了非均匀误差框架,能够根据状态自适应地调整ReLU网络的输入和输出,从而降低网络复杂度并提高闭环性能。

关键设计:论文的关键设计包括:1) 投影算子的选择,需要保证投影后的状态满足约束条件;2) Lipschitz常数的估计,需要根据具体的MPC问题进行分析;3) 状态感知缩放函数的设计,需要能够有效地反映状态对近似误差的影响;4) ReLU网络结构的选择,需要根据推导出的宽度和深度界限进行设计。

🖼️ 关键图片

📊 实验亮点

论文首次推导了ReLU网络宽度和深度的显式界限,为选择合适的网络复杂度提供了理论依据。提出的非均匀误差框架能够自适应地调整ReLU网络的输入和输出,从而降低网络复杂度并提高闭环性能。具体实验结果未知,但论文强调了其贡献为可认证的基于ReLU NN的MPC提供了一个基础性的步骤。

🎯 应用场景

该研究成果可应用于各种需要模型预测控制的领域,例如机器人控制、自动驾驶、过程控制等。通过使用具有保证性能的ReLU网络来近似MPC策略,可以降低计算成本,提高控制系统的实时性,并为安全关键应用提供理论保障。未来的研究方向包括将该方法扩展到非线性系统和随机系统。

📄 摘要(原文)

Recent years have witnessed a resurgence in using ReLU neural networks (NNs) to represent model predictive control (MPC) policies. However, determining the required network complexity to ensure closed-loop performance remains a fundamental open problem. This involves a critical precision-complexity trade-off: undersized networks may fail to capture the MPC policy, while oversized ones may outweigh the benefits of ReLU network approximation. In this work, we propose a projection-based method to enforce hard constraints and establish a state-dependent Lipschitz continuity property for the optimal MPC cost function, which enables sharp convergence analysis of the closed-loop system. For the first time, we derive explicit bounds on ReLU network width and depth for approximating MPC policies with guaranteed closed-loop performance. To further reduce network complexity and enhance closed-loop performance, we propose a non-uniform error framework with a state-aware scaling function to adaptively adjust both the input and output of the ReLU network. Our contributions provide a foundational step toward certifiable ReLU NN-based MPC.