Multiagent Reinforcement Learning in Enhancing Resilience of Microgrids under Extreme Weather Events

作者: Yin Wu, Wei-Yu Chiu, Yuan-Po Tsai, Shangyuan Liu, Weiqi Hua

分类: eess.SY

发布日期: 2026-01-19

备注: 26 pages, 9 figures

期刊: Expert Systems with Applications, Volume 296, Part D, 15 January 2026, 129145

DOI: 10.1016/j.eswa.2025.129145

💡 一句话要点

提出基于MADRL的微网能量管理系统,提升极端天气下的电网韧性并降低运营成本。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 多智能体强化学习 微网 能量管理系统 电网韧性 极端天气 分布式能源 门控循环单元

📋 核心要点

- 极端天气导致负荷需求不确定性增加,现有能量管理系统在协调分布式能源方面面临挑战。

- 提出基于合作多智能体深度强化学习的能量管理系统,通过协调分布式能源来优化微网控制策略。

- 实验结果表明,该方法能有效降低运营成本,并显著提升微网在电力中断期间的韧性。

📝 摘要(中文)

本文针对日益频繁的极端天气事件导致电力中断的问题,提出了一种基于合作多智能体深度强化学习(MADRL)的能量管理系统(EMS)框架,旨在提高微网的韧性并降低停电期间的运营成本。该框架通过协调分布式能源(DER)来优化微网控制策略。引入了带有门控机制的门控循环单元(GRU)来提取时间数据中的特征,从而使EMS能够更有效地协调DER。所提出的MADRL方法结合了动作掩码技术,并在IEEE 33节点系统上使用可再生能源发电和电力负荷的真实数据进行了评估。数值结果表明,该方法在降低运营成本以及提高电力中断期间微网的韧性方面具有优越性。

🔬 方法详解

问题定义:论文旨在解决极端天气事件下,微网由于负荷需求不确定性增加而导致的电网韧性降低问题。现有能量管理系统在协调分布式能源方面存在不足,难以有效应对极端天气带来的挑战。

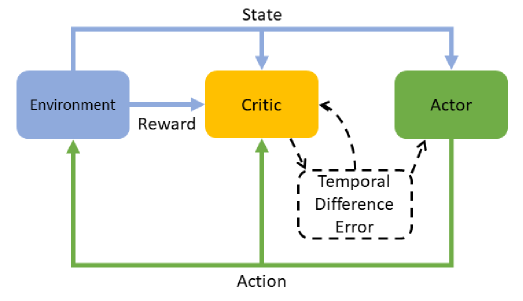

核心思路:论文的核心思路是利用合作多智能体深度强化学习(MADRL)来构建能量管理系统,通过多个智能体协同优化分布式能源的调度,从而提高微网的韧性并降低运营成本。这种方法能够更好地适应极端天气下的不确定性,实现更高效的能源管理。

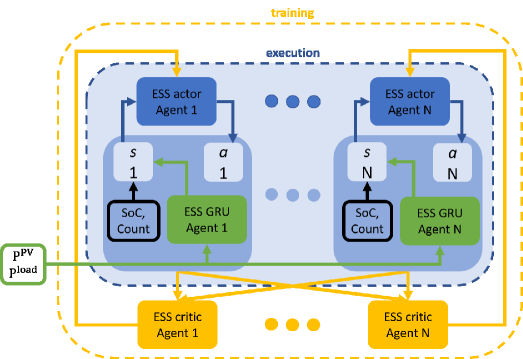

技术框架:该框架包含以下主要模块:1) 基于门控循环单元(GRU)的特征提取模块,用于从时间数据中提取特征;2) 多智能体深度强化学习模块,用于学习最优的分布式能源调度策略;3) 动作掩码模块,用于约束智能体的动作空间,提高学习效率。整体流程是:首先,GRU提取历史数据特征,然后MADRL模块根据特征学习调度策略,最后通过动作掩码保证策略的合理性。

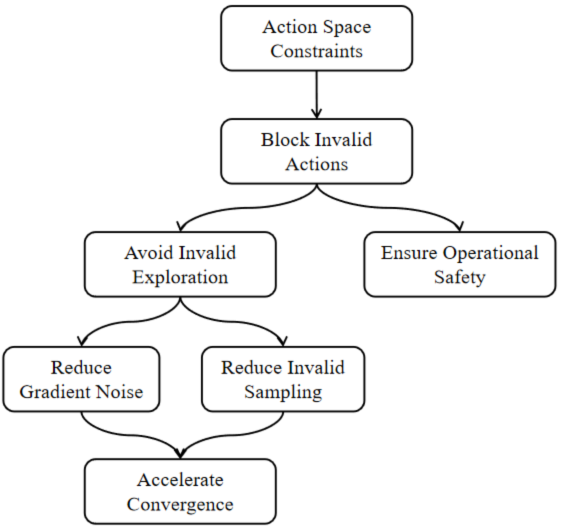

关键创新:论文的关键创新在于将合作多智能体深度强化学习应用于微网能量管理,并结合GRU和动作掩码技术。与传统的单智能体强化学习方法相比,MADRL能够更好地处理微网中多个分布式能源之间的协调问题。GRU的使用增强了对时间序列数据的处理能力,动作掩码则提高了学习效率和策略的安全性。

关键设计:GRU网络用于提取历史负荷和可再生能源发电的时间序列特征。MADRL采用集中式训练、分布式执行的框架,每个智能体控制一个或一组分布式能源。损失函数包括运营成本、电网稳定性等因素。动作掩码根据物理约束和安全约束限制智能体的动作空间。具体的参数设置和网络结构在论文中进行了详细描述(未知)。

🖼️ 关键图片

📊 实验亮点

论文在IEEE 33节点系统上进行了实验,结果表明,所提出的MADRL方法能够有效降低运营成本,并显著提高微网在电力中断期间的韧性。具体的性能提升数据和对比基线在论文中进行了详细描述(未知),但摘要强调了其优越性。

🎯 应用场景

该研究成果可应用于智能电网、微网能量管理、分布式能源调度等领域。通过提高电网在极端天气下的韧性,可以减少电力中断带来的经济损失和社会影响。未来,该方法有望推广到更大规模的电网,实现更智能、更可靠的能源管理。

📄 摘要(原文)

Grid resilience is crucial in light of power interruptions caused by increasingly frequent extreme weather events. Well-designed energy management systems (EMS) have made progress in improving microgrid resilience through the coordination of distributed energy resources (DERs), but still face significant challenges in addressing the uncertainty of load demand caused by extreme weather. The integration of deep reinforcement learning (DRL) into EMS design enables optimized microgrid control strategies for coordinating DERs. Building on this, we proposed a cooperative multi-agent deep reinforcement learning (MADRL)-based EMS framework to provide flexible scalability for microgrids, enhance resilience and reduce operational costs during power outages. Specifically, the gated recurrent unit with a gating mechanism was introduced to extract features from temporal data, which enables the EMS to coordinate DERs more efficiently. Next, the proposed MADRL method incorporating action masking techniques was evaluated in the IEEE 33-Bus system using real-world data on renewable generation and power load. Finally, the numerical results demonstrated the superiority of the proposed method in reducing operating costs as well as the effectiveness in enhancing microgrid resilience during power interruptions.