Who Moved My Distribution? Conformal Prediction for Interactive Multi-Agent Systems

作者: Allen Emmanuel Binny, Anushri Dixit

分类: eess.SY, cs.RO

发布日期: 2025-11-14

💡 一句话要点

提出迭代式共形预测框架,解决交互式多智能体系统中的分布偏移问题

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 共形预测 多智能体系统 分布偏移 不确定性预测 运动规划

📋 核心要点

- 现有共形预测方法在多智能体交互场景中,忽略了智能体间的相互影响导致的内生分布偏移问题。

- 论文提出一种迭代共形预测框架,通过迭代调整自我智能体控制器来适应这种分布偏移。

- 实验表明,该方法在保证安全性的同时,避免了过度保守的行为,并显著提高了成功率。

📝 摘要(中文)

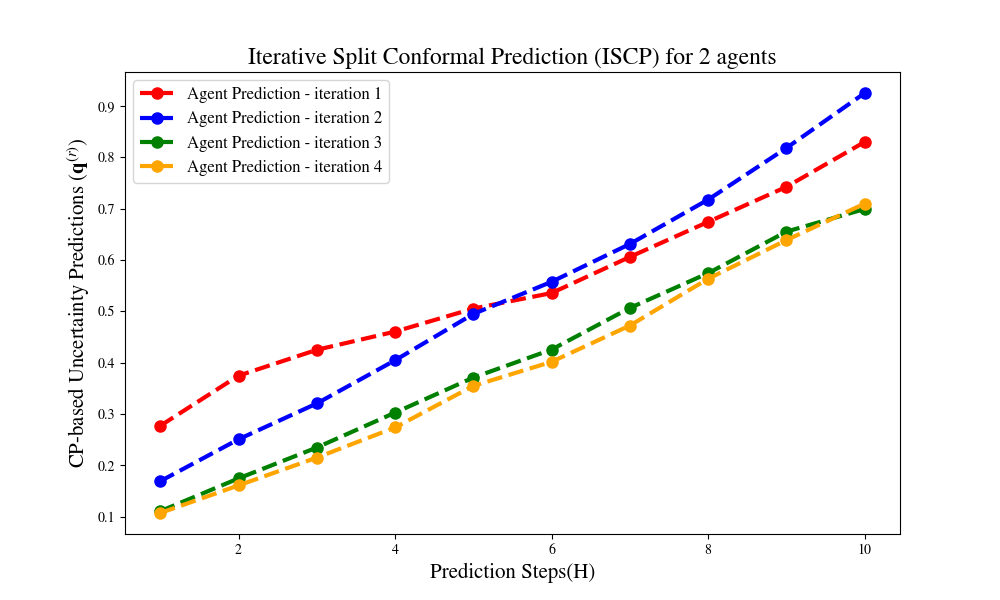

不确定性预测对于安全运动规划至关重要,尤其是在使用学习模型预测周围智能体的行为时。共形预测是一种统计工具,常用于为机器学习模型生成不确定性预测区域。现有的大多数基于共形预测的不确定性预测框架都假设周围的智能体是非交互的。这是因为在闭环中,当具有不确定性意识的智能体改变其行为以应对预测不确定性时,周围的智能体会对此变化做出反应,从而导致分布偏移,我们称之为内生分布偏移。为了解决这个挑战,我们引入了一个迭代共形预测框架,该框架系统地调整具有不确定性意识的自我智能体控制器以适应内生分布偏移。所提出的方法在适应反应性、非自我智能体的演变行为的同时,提供了概率安全保证。我们建立了内生分布偏移的模型,并提供了迭代共形预测管道在此类分布偏移下收敛的条件。我们在2智能体和3智能体交互场景的仿真中验证了我们的框架,证明了碰撞避免,而不会导致过于保守的行为,并且与其他基于共形预测的基线相比,总体成功率提高了高达9.6%。

🔬 方法详解

问题定义:论文旨在解决交互式多智能体系统中,由于智能体之间的相互影响而产生的内生分布偏移问题。现有的共形预测方法通常假设环境中的其他智能体是非交互的,因此无法适应这种分布偏移,导致预测不准确或过于保守,影响运动规划的安全性。

核心思路:论文的核心思路是通过迭代的方式,让自我智能体(ego-agent)在预测其他智能体行为的同时,考虑到自身行为对其他智能体的影响,并根据其他智能体的反应不断调整自身的预测和控制策略。这种迭代过程使得自我智能体能够逐步适应内生分布偏移,从而提高预测的准确性和安全性。

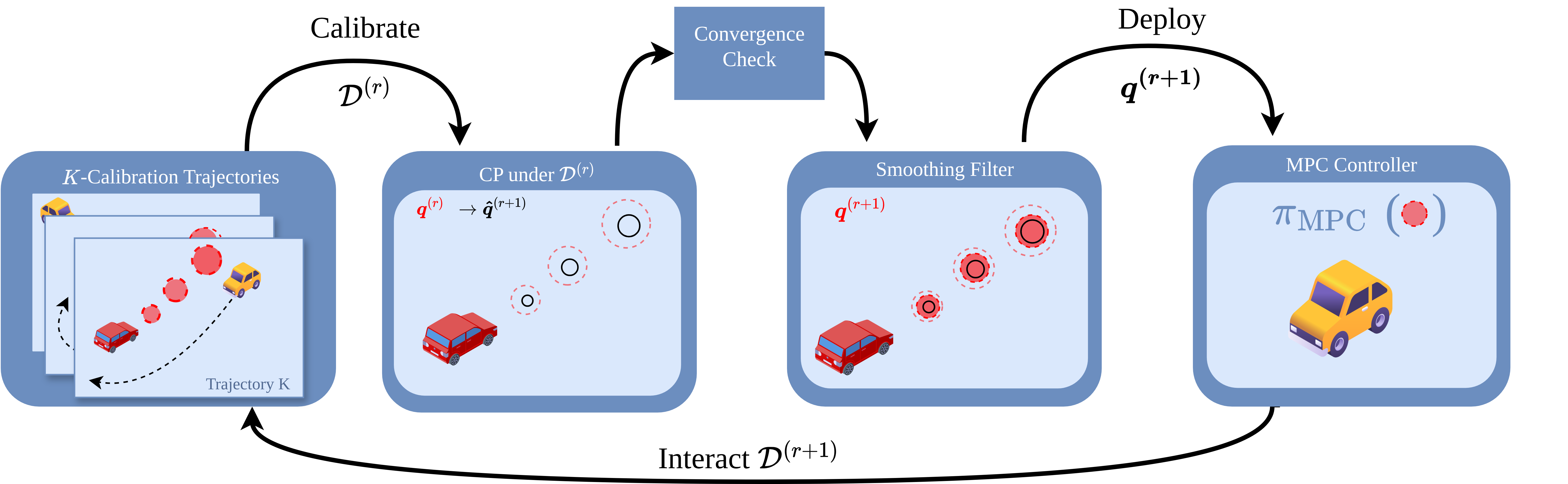

技术框架:整体框架是一个迭代的闭环控制系统。首先,自我智能体使用一个预测模型(例如,学习得到的模型)来预测其他智能体的行为。然后,利用共形预测方法,基于预测结果生成一个不确定性区域。自我智能体根据这个不确定性区域调整自身的控制策略,例如,选择一条更加安全的轨迹。由于自我智能体的行为发生了改变,其他智能体会对此做出反应,从而导致分布偏移。接下来,自我智能体再次预测其他智能体的行为,并重复上述过程。这个迭代过程一直持续到满足收敛条件为止。

关键创新:论文的关键创新在于提出了一个迭代共形预测框架,能够显式地建模和适应内生分布偏移。与传统的共形预测方法相比,该框架能够更好地处理交互式多智能体系统中的不确定性,从而提高运动规划的安全性。此外,论文还给出了迭代过程收敛的条件,保证了算法的有效性。

关键设计:论文中需要仔细设计的包括:1)预测模型的选择,需要选择能够较好地捕捉智能体之间交互关系的预测模型;2)共形预测方法,需要选择合适的共形预测方法来生成不确定性区域;3)控制策略,需要设计一种能够根据不确定性区域调整自身行为的控制策略;4)收敛条件,需要设计合适的收敛条件来保证迭代过程的有效性。具体的参数设置、损失函数、网络结构等细节取决于具体的应用场景和选择的模型。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在2智能体和3智能体交互场景中,能够有效地避免碰撞,并且不会导致过于保守的行为。与其他基于共形预测的基线方法相比,该方法的总体成功率提高了高达9.6%。这些结果验证了该方法在处理交互式多智能体系统中的内生分布偏移方面的有效性。

🎯 应用场景

该研究成果可应用于自动驾驶、机器人导航、空中交通管制等领域。在这些领域中,智能体需要与周围的其他智能体进行交互,并且需要保证自身的安全性。通过使用该论文提出的迭代共形预测框架,可以提高智能体在复杂环境中的适应性和安全性,从而实现更加可靠和高效的自主决策。

📄 摘要(原文)

Uncertainty-aware prediction is essential for safe motion planning, especially when using learned models to forecast the behavior of surrounding agents. Conformal prediction is a statistical tool often used to produce uncertainty-aware prediction regions for machine learning models. Most existing frameworks utilizing conformal prediction-based uncertainty predictions assume that the surrounding agents are non-interactive. This is because in closed-loop, as uncertainty-aware agents change their behavior to account for prediction uncertainty, the surrounding agents respond to this change, leading to a distribution shift which we call endogenous distribution shift. To address this challenge, we introduce an iterative conformal prediction framework that systematically adapts the uncertainty-aware ego-agent controller to the endogenous distribution shift. The proposed method provides probabilistic safety guarantees while adapting to the evolving behavior of reactive, non-ego agents. We establish a model for the endogenous distribution shift and provide the conditions for the iterative conformal prediction pipeline to converge under such a distribution shift. We validate our framework in simulation for 2- and 3- agent interaction scenarios, demonstrating collision avoidance without resulting in overly conservative behavior and an overall improvement in success rates of up to 9.6% compared to other conformal prediction-based baselines.