A Physics-Informed Reinforcement Learning Approach for Degradation-Aware Long-Term Charging Optimization in Batteries

作者: Shanthan Kumar Padisala, Bharatkumar Hegde, Ibrahim Haskara, Satadru Dey

分类: eess.SY

发布日期: 2025-10-13

💡 一句话要点

提出基于物理信息的强化学习方法,优化电池长期充电过程中的衰退问题。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 电池充电优化 强化学习 物理信息 电池衰退 恒流恒压充电

📋 核心要点

- 现有恒流恒压(CCCV)充电协议难以适应电池健康状态变化,导致充电效率和电池寿命受限。

- 利用物理信息强化学习,估计活性材料损失(LAM),并自适应调整CCCV充电过程中的电流大小。

- 实验结果表明,该框架能有效提升CCCV协议性能,优于非物理信息强化学习和固定CCCV策略。

📝 摘要(中文)

电池在使用和循环过程中会发生衰退,通常表现为电阻增长和容量衰减。虽然文献中提出了各种充电方法,旨在实现最佳、快速或健康导向的充电,但很少有研究尝试使通用的恒流恒压(CCCV)充电协议适应电池健康状况的变化。本文旨在解决这一差距,提出一个框架,优化CCCV协议的恒流部分,以适应电池的长期衰退。具体而言,采用了一种基于物理信息的强化学习(RL)方法,该方法不仅估计了关键的电池衰退机制,即活性材料损失(LAM),而且还根据这种衰退调整CCCV的电流大小。该框架结合了开源电池建模工具PyBamm和Stable-baselines来实现,其中RL智能体使用近端策略优化(PPO)网络进行训练。仿真结果表明,该框架具有通过在RL算法中嵌入物理信息来增强广泛使用的CCCV协议的潜力。此外,还将该智能体与由非物理信息RL智能体和恒定CCCV生成的其他两种充电协议进行了比较研究。

🔬 方法详解

问题定义:论文旨在解决电池长期循环使用过程中,由于电池衰退导致传统恒流恒压(CCCV)充电协议效率降低的问题。现有方法无法根据电池健康状态动态调整充电策略,导致充电时间过长或加速电池老化。

核心思路:论文的核心思路是将电池的物理模型(特别是活性材料损失LAM)融入到强化学习框架中,利用物理信息指导RL智能体学习最优的充电策略。通过估计电池的衰退状态,自适应地调整CCCV协议中的恒流阶段的电流大小,从而优化充电效率和电池寿命。

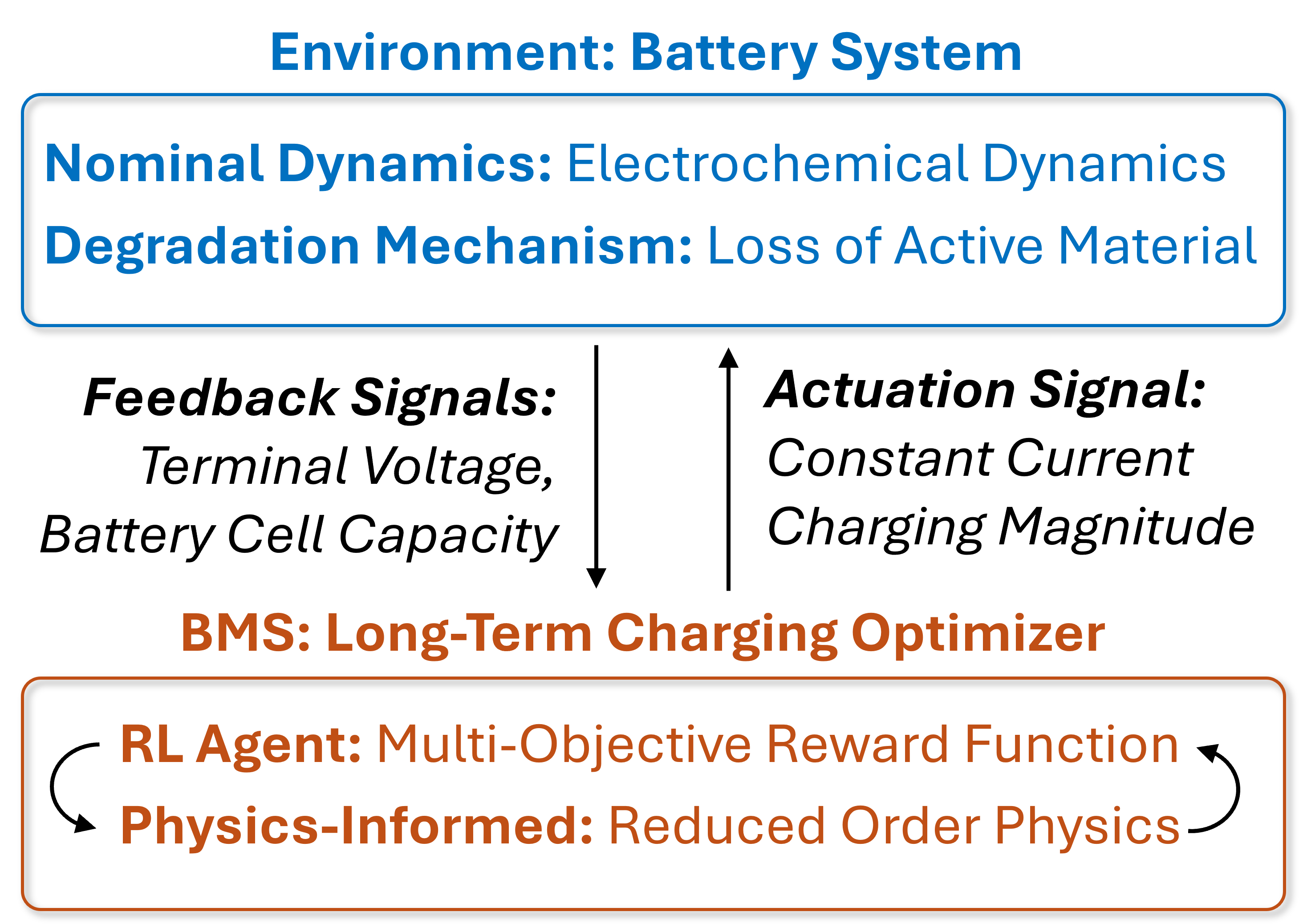

技术框架:整体框架包括以下几个主要模块:1) 基于PyBamm的电池物理模型,用于模拟电池的充放电过程和衰退行为;2) 基于Stable-baselines的强化学习智能体,使用PPO算法进行训练;3) 状态估计模块,用于估计电池的健康状态,特别是活性材料损失LAM;4) 动作选择模块,根据当前状态选择合适的恒流充电电流大小。RL智能体与电池模型交互,通过不断试错学习最优策略。

关键创新:最重要的技术创新点在于将电池的物理模型与强化学习相结合。传统的强化学习方法通常是黑盒方法,难以利用电池的先验知识。通过引入物理模型,可以更准确地估计电池的状态,并指导RL智能体学习更有效的充电策略。这种方法可以显著提高充电效率和延长电池寿命。

关键设计:关键设计包括:1) 使用PyBamm作为电池模型,提供准确的电池行为模拟;2) 使用PPO算法训练RL智能体,PPO算法具有较好的稳定性和收敛性;3) 将活性材料损失LAM作为状态变量,用于表征电池的健康状态;4) 设计合适的奖励函数,鼓励智能体在保证充电效率的同时,尽量减少电池的衰退。

🖼️ 关键图片

📊 实验亮点

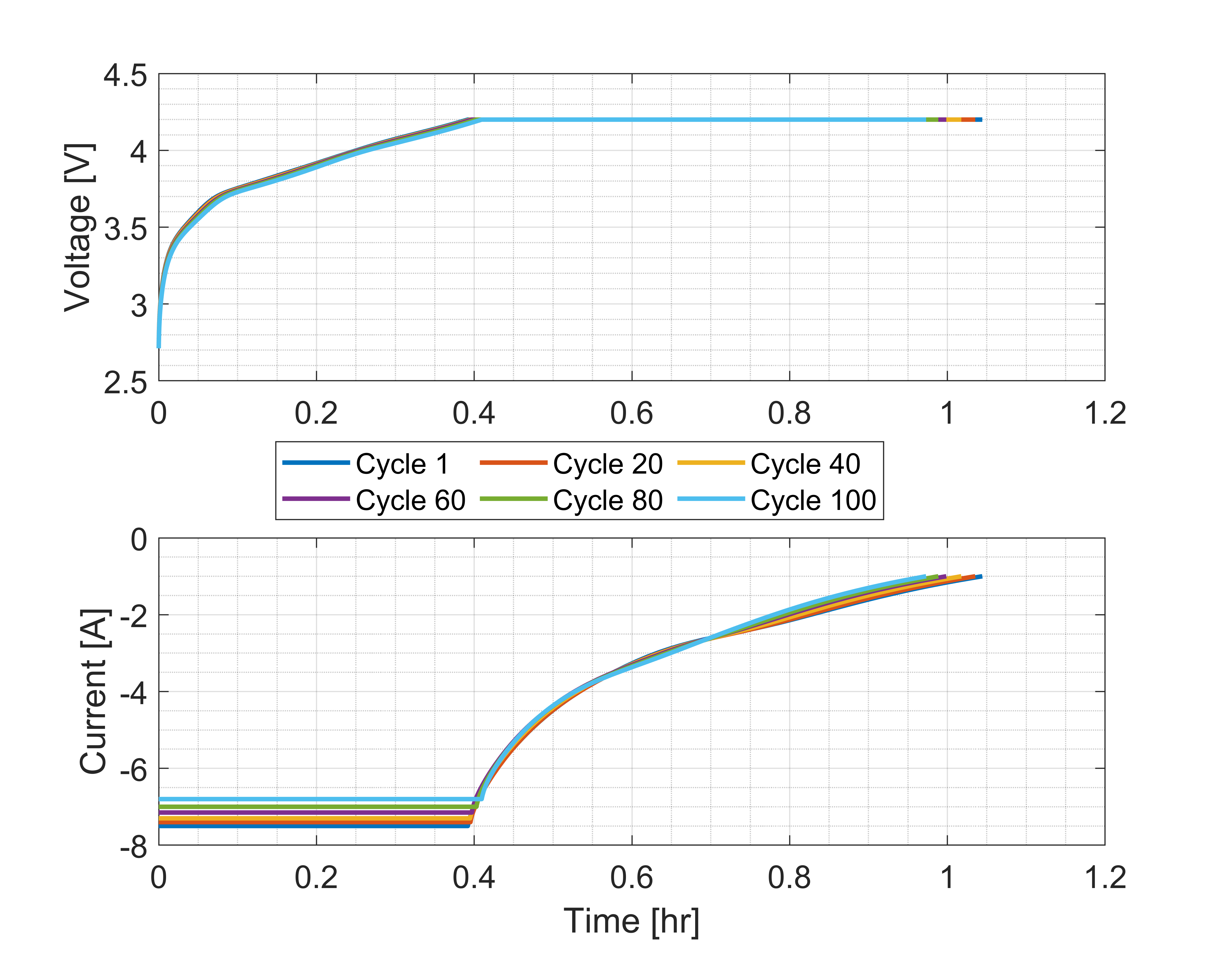

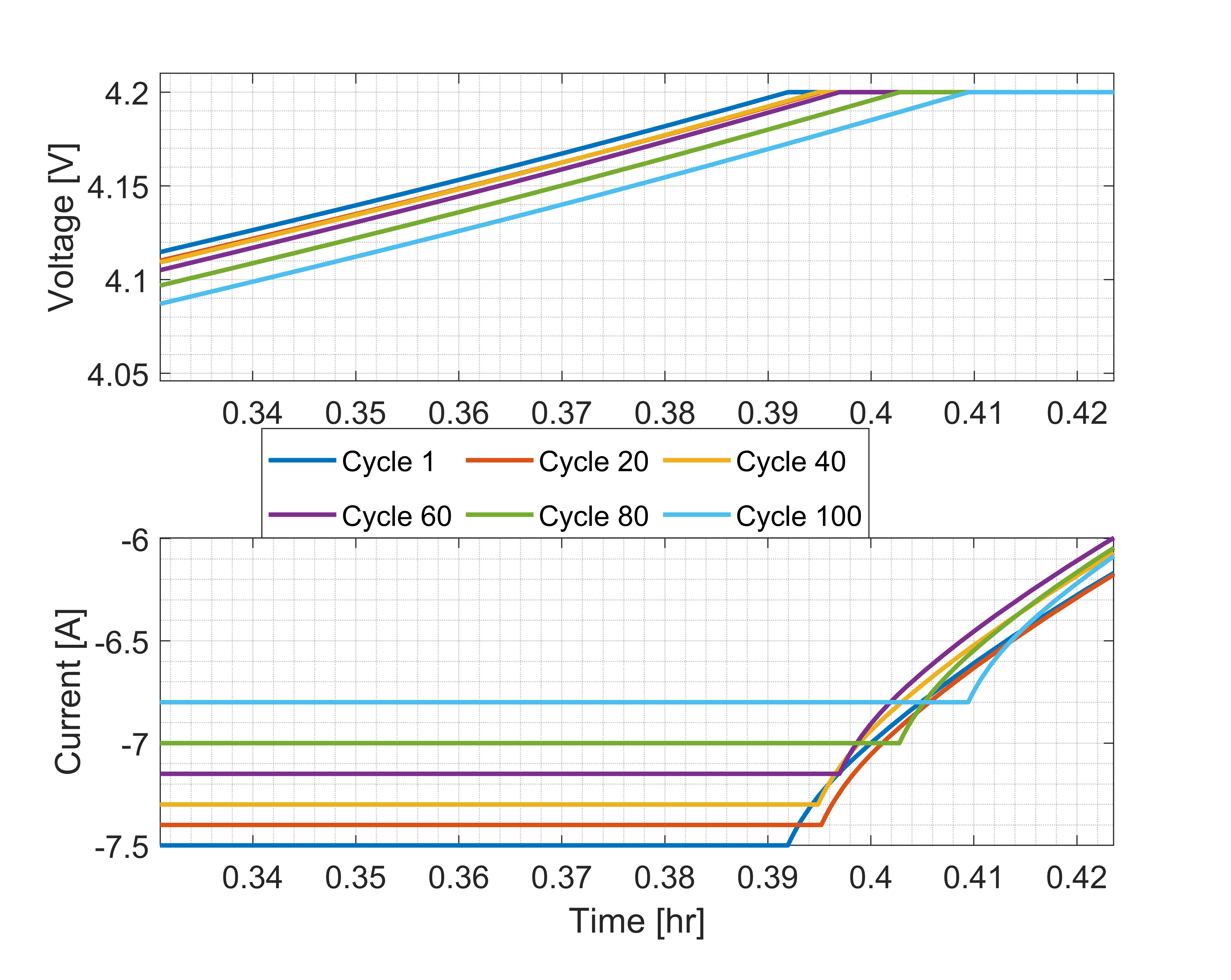

实验结果表明,所提出的基于物理信息的强化学习方法能够显著提高CCCV充电协议的性能。与传统的固定CCCV充电策略相比,该方法能够在保证充电时间的前提下,有效降低电池的衰退速度。此外,该方法还优于基于非物理信息的强化学习方法,证明了物理信息在强化学习中的重要作用。

🎯 应用场景

该研究成果可应用于电动汽车、储能系统等领域,通过优化电池充电策略,提高充电效率,延长电池寿命,降低运营成本。该方法还可扩展到其他类型的电池和充电协议,具有广泛的应用前景,并有助于推动电池技术的进步。

📄 摘要(原文)

Batteries degrade with usage and continuous cycling. This aging is typically reflected through the resistance growth and the capacity fade of battery cells. Over the years, various charging methods have been presented in the literature that proposed current profiles in order to enable optimal, fast, and/or health-conscious charging. However, very few works have attempted to make the ubiquitous Constant Current Constant Voltage (CCCV) charging protocol adaptive to the changing battery health as it cycles. This work aims to address this gap and proposes a framework that optimizes the constant current part of the CCCV protocol adapting to long-term battery degradation. Specifically, a physics-informed Reinforcement Learning (RL) approach has been used that not only estimates a key battery degradation mechanism, namely, Loss of Active Material (LAM), but also adjusts the current magnitude of CCCV as a result of this particular degradation. The proposed framework has been implemented by combining PyBamm, an open-source battery modeling tool, and Stable-baselines where the RL agent was trained using a Proximal Policy Optimization (PPO) network. Simulation results show the potential of the proposed framework for enhancing the widely used CCCV protocol by embedding physics information in RL algorithm. A comparative study of this proposed agent has also been discussed with 2 other charging protocols generated by a non-physics-based RL agent and a constant CCCV for all the cycles.