Model Predictive Control-Guided Reinforcement Learning for Implicit Balancing

作者: Seyed Soroush Karimi Madahi, Kenneth Bruninx, Bert Claessens, Chris Develder

分类: eess.SY, cs.AI

发布日期: 2025-10-06

💡 一句话要点

提出MPC引导的强化学习方法,用于欧洲平衡市场中的电池隐式平衡控制。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture)

关键词: 模型预测控制 强化学习 隐式平衡 电池储能 能源市场

📋 核心要点

- 现有MPC方法在欧洲平衡市场中存在价格预测不准确和计算成本高的问题,而传统RL方法则需要大量数据训练。

- 论文提出一种MPC引导的RL方法,结合MPC的预测能力和RL的快速决策能力,以提高套利利润。

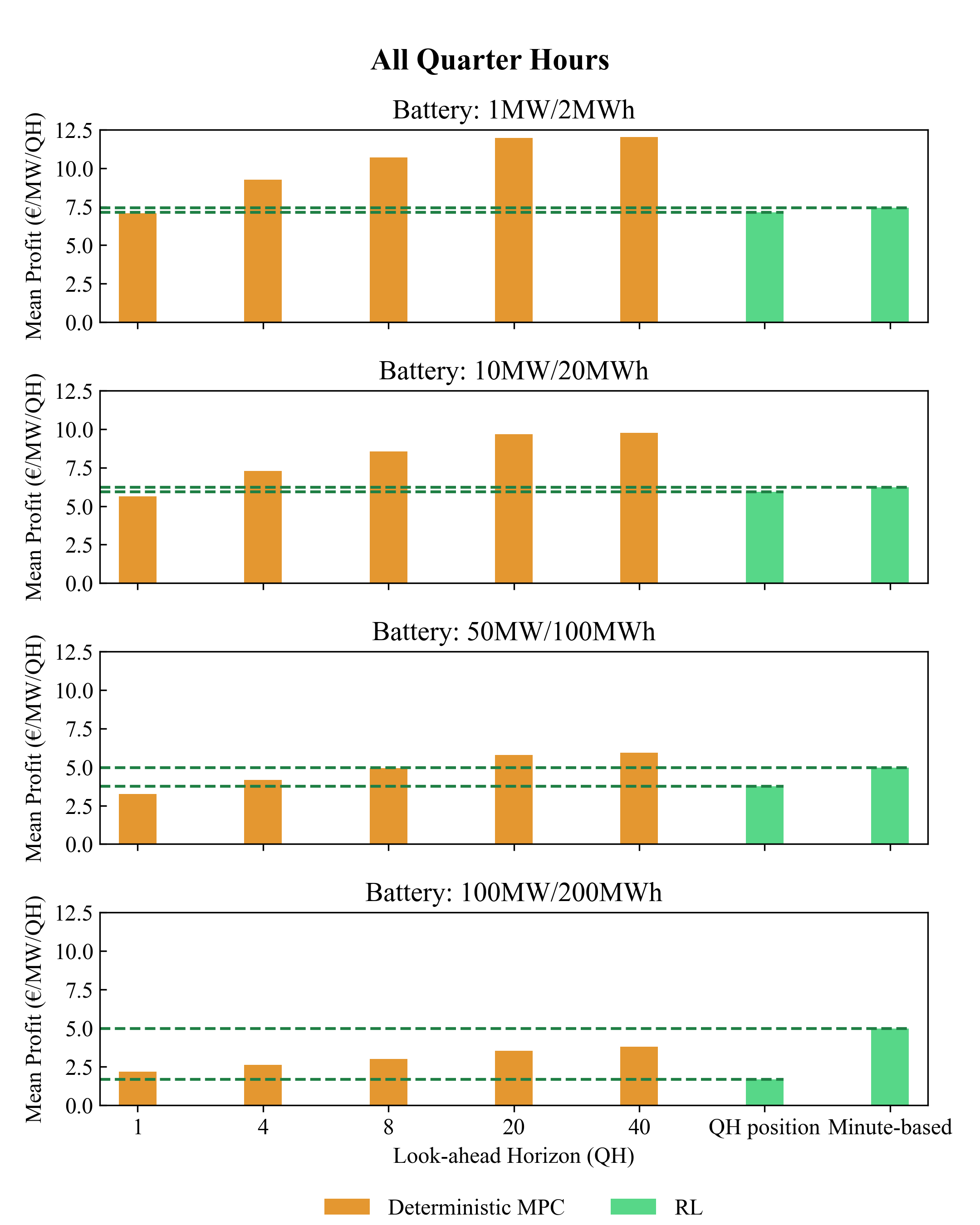

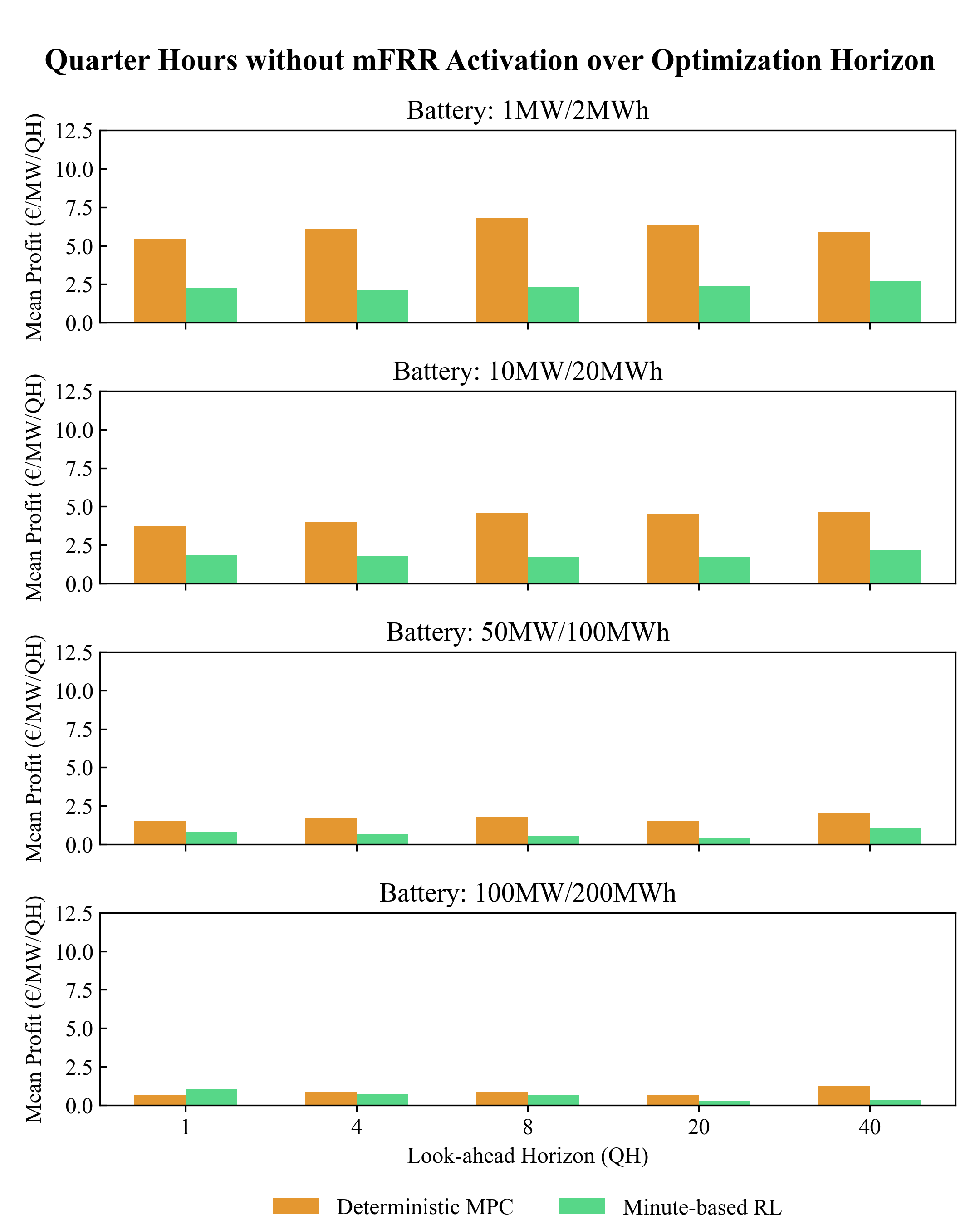

- 实验结果表明,相较于单独的RL和MPC方法,该方法在套利利润方面分别提升了16.15%和54.36%。

📝 摘要(中文)

在欧洲,追求利润的平衡责任方可以实时偏离其日前提名,以协助输电系统运营商维持供需平衡。模型预测控制(MPC)策略可以利用这些隐式平衡策略来捕捉套利机会,但无法准确捕捉欧洲不平衡市场中的价格形成过程,并且面临高计算成本。无模型强化学习(RL)方法执行速度快,但需要数据密集型训练,并且通常依赖实时和历史数据进行决策。本文提出了一种MPC引导的RL方法,该方法结合了MPC和RL的互补优势。所提出的方法可以有效地将预测纳入决策过程(如在MPC中),同时保持RL的快速推理能力。使用2023年比利时平衡数据,在隐式平衡电池控制问题上评估了所提出方法的性能。首先,我们从各个角度分析了独立的最新RL和MPC方法的性能,以突出它们的各自优势和局限性。接下来,我们表明,与独立的RL和MPC相比,所提出的MPC引导的RL方法具有16.15%和54.36%的套利利润优势。

🔬 方法详解

问题定义:论文旨在解决欧洲平衡市场中,平衡责任方如何利用电池进行隐式平衡控制以获取最大套利利润的问题。现有MPC方法难以准确预测市场价格,计算成本高昂,而传统RL方法则需要大量历史数据进行训练,且泛化能力有限。

核心思路:论文的核心思路是将MPC的预测能力与RL的快速决策能力相结合。MPC提供对未来市场价格的预测,RL则基于这些预测进行实时的决策,从而在保证决策速度的同时,提高决策的准确性。通过MPC引导,RL可以更有效地利用市场信息,减少对大量历史数据的依赖。

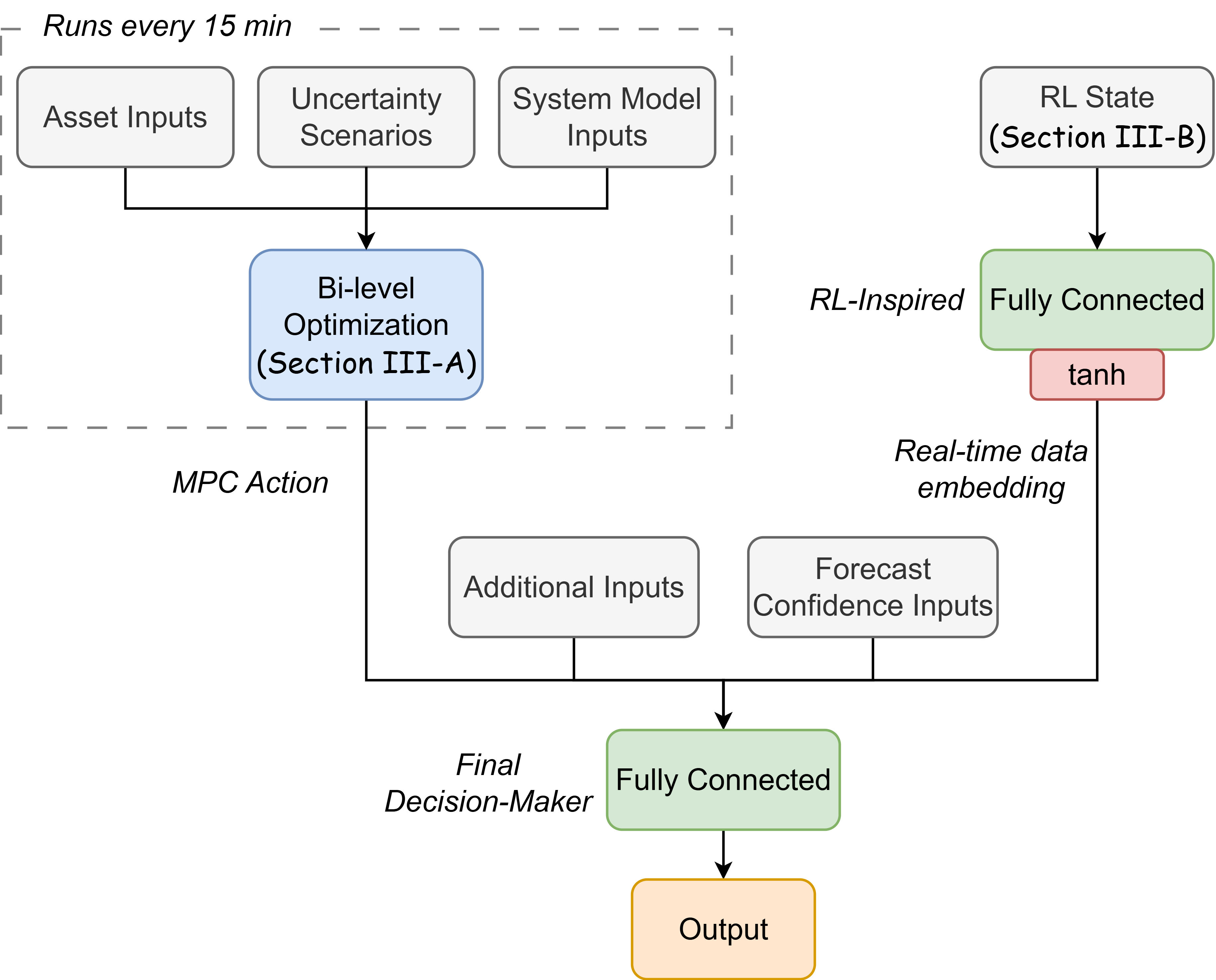

技术框架:该方法包含两个主要模块:MPC模块和RL模块。MPC模块负责基于历史数据和市场信息,预测未来一段时间内的市场价格。RL模块则基于MPC的预测结果,学习最优的电池充放电策略,以最大化套利利润。整体流程是,首先使用MPC进行价格预测,然后将预测结果作为RL的状态输入,RL根据状态选择动作(电池充放电),并获得相应的奖励。

关键创新:该方法最重要的创新点在于将MPC的预测能力融入到RL的决策过程中。传统RL方法通常直接基于历史数据进行学习,而该方法通过MPC提供对未来市场状态的预测,使得RL能够更好地应对市场的动态变化。这种MPC引导的RL方法,可以有效地提高决策的准确性和鲁棒性。

关键设计:具体的技术细节包括:MPC模块采用合适的预测模型(例如时间序列模型),并根据市场特点进行参数调整。RL模块采用合适的算法(例如DQN、PPO等),并设计合适的奖励函数,以鼓励RL学习到最优的电池充放电策略。奖励函数通常与套利利润直接相关,例如可以设置为电池充放电带来的收益减去成本。

🖼️ 关键图片

📊 实验亮点

实验结果表明,与单独使用RL和MPC方法相比,提出的MPC引导的RL方法在套利利润方面分别提升了16.15%和54.36%。这一显著的提升表明,该方法能够有效地结合MPC的预测能力和RL的决策能力,从而在复杂的市场环境中获得更高的收益。

🎯 应用场景

该研究成果可应用于电力市场的平衡责任方,帮助其利用电池储能系统参与市场调节,实现更高的经济效益。此外,该方法也可推广到其他能源管理场景,例如微电网的优化调度、电动汽车的充电策略等,具有广泛的应用前景和实际价值。

📄 摘要(原文)

In Europe, profit-seeking balance responsible parties can deviate in real time from their day-ahead nominations to assist transmission system operators in maintaining the supply-demand balance. Model predictive control (MPC) strategies to exploit these implicit balancing strategies capture arbitrage opportunities, but fail to accurately capture the price-formation process in the European imbalance markets and face high computational costs. Model-free reinforcement learning (RL) methods are fast to execute, but require data-intensive training and usually rely on real-time and historical data for decision-making. This paper proposes an MPC-guided RL method that combines the complementary strengths of both MPC and RL. The proposed method can effectively incorporate forecasts into the decision-making process (as in MPC), while maintaining the fast inference capability of RL. The performance of the proposed method is evaluated on the implicit balancing battery control problem using Belgian balancing data from 2023. First, we analyze the performance of the standalone state-of-the-art RL and MPC methods from various angles, to highlight their individual strengths and limitations. Next, we show an arbitrage profit benefit of the proposed MPC-guided RL method of 16.15% and 54.36%, compared to standalone RL and MPC.