Near-Real-Time Resource Slicing for QoS Optimization in 5G O-RAN using Deep Reinforcement Learning

作者: Peihao Yan, Jie Lu, Huacheng Zeng, Y. Thomas Hou

分类: eess.SY, cs.AI

发布日期: 2025-09-17 (更新: 2026-01-12)

备注: Published in: IEEE Transactions on Networking

期刊: in IEEE Transactions on Networking, vol. 34, pp. 1596-1611, 2026

🔗 代码/项目: GITHUB

💡 一句话要点

提出xSlice,利用DRL优化5G O-RAN中近实时资源切片,提升QoS。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: O-RAN 资源切片 深度强化学习 图卷积网络 QoS优化 近实时控制

📋 核心要点

- 现有5G O-RAN资源分配方法难以适应无线信道、用户移动等动态变化,导致QoS下降。

- xSlice利用深度强化学习,结合actor-critic模型和图卷积网络,实现动态资源切片,优化QoS。

- 实验表明,xSlice在实际O-RAN场景中,相比现有方法,性能遗憾降低了67%,显著提升QoS。

📝 摘要(中文)

本文提出了一种名为xSlice的xApp,用于5G O-RAN的近实时(Near-RT)RAN智能控制器(RIC)。xSlice是一种在线学习算法,能够自适应地调整MAC层资源分配,以应对动态网络状态,包括时变的无线信道条件、用户移动性、流量波动以及用户需求的变化。为了应对这些网络动态,我们首先将服务质量(QoS)优化问题建模为一个遗憾最小化问题,通过加权吞吐量、延迟和可靠性来量化所有流量会话的QoS需求。然后,我们开发了一个深度强化学习(DRL)框架,该框架利用actor-critic模型来结合基于价值和基于策略的更新方法的优点。将图卷积网络(GCN)作为DRL框架的组件,用于RAN数据的图嵌入,使xSlice能够处理动态数量的流量会话。我们在一个包含10部智能手机的O-RAN测试平台上实现了xSlice,并进行了广泛的实验,以评估其在实际场景中的性能。实验结果表明,与最先进的解决方案相比,xSlice可以将性能遗憾降低67%。源代码可在https://github.com/xslice-5G/code获取。

🔬 方法详解

问题定义:论文旨在解决5G O-RAN中,由于无线信道条件、用户移动性、流量波动等因素导致的动态网络状态下,如何优化MAC层资源分配以满足不同流量会话的QoS需求的问题。现有方法难以有效应对这些动态变化,导致QoS下降,例如吞吐量降低、延迟增加、可靠性降低等。

核心思路:论文的核心思路是将QoS优化问题建模为一个遗憾最小化问题,并通过深度强化学习(DRL)来解决。通过量化不同流量会话的吞吐量、延迟和可靠性需求,将QoS需求转化为可优化的目标。利用DRL的在线学习能力,自适应地调整资源分配策略,以最小化长期性能遗憾。

技术框架:xSlice的整体框架包含以下几个主要组件:首先,通过O-RAN的近实时RIC收集RAN数据,包括信道状态信息、用户位置、流量负载等。然后,利用图卷积网络(GCN)对RAN数据进行图嵌入,将动态数量的流量会话表示为统一的图结构。接下来,将图嵌入作为actor-critic模型的输入,actor网络负责生成资源分配策略,critic网络负责评估策略的价值。最后,通过DRL算法不断更新actor和critic网络,以优化资源分配策略。

关键创新:论文的关键创新在于将图卷积网络(GCN)引入到DRL框架中,用于RAN数据的图嵌入。这使得xSlice能够处理动态数量的流量会话,并有效地利用RAN数据中的拓扑信息。此外,采用actor-critic模型,结合了基于价值和基于策略的更新方法的优点,提高了学习效率和稳定性。

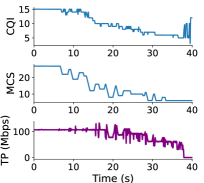

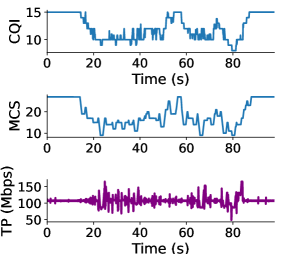

关键设计:论文中,状态空间包括信道质量指示(CQI)、用户位置、流量需求等信息。动作空间定义为每个流量会话分配的资源块数量。奖励函数设计为加权吞吐量、延迟和可靠性的组合,权重反映了不同QoS需求的重要性。Actor网络和Critic网络均采用多层感知机(MLP)结构。GCN采用两层结构,用于提取RAN数据的图特征。

🖼️ 关键图片

📊 实验亮点

实验结果表明,xSlice在实际O-RAN测试平台上,与最先进的解决方案相比,可以将性能遗憾降低67%。具体来说,xSlice能够显著提升吞吐量、降低延迟,并提高可靠性,从而更好地满足不同流量会话的QoS需求。实验结果验证了xSlice在动态网络环境下的有效性和优越性。

🎯 应用场景

该研究成果可应用于5G及未来无线通信系统的O-RAN架构中,实现智能化的资源管理和QoS保障。通过自适应地调整资源分配,可以提升用户体验,支持更多样化的业务需求,例如高清视频、在线游戏、物联网等。此外,该方法还可以应用于其他需要动态资源分配的场景,例如云计算、边缘计算等。

📄 摘要(原文)

Open-Radio Access Network (O-RAN) has become an important paradigm for 5G and beyond radio access networks. This paper presents an xApp called xSlice for the Near-Real-Time (Near-RT) RAN Intelligent Controller (RIC) of 5G O-RANs. xSlice is an online learning algorithm that adaptively adjusts MAC-layer resource allocation in response to dynamic network states, including time-varying wireless channel conditions, user mobility, traffic fluctuations, and changes in user demand. To address these network dynamics, we first formulate the Quality-of-Service (QoS) optimization problem as a regret minimization problem by quantifying the QoS demands of all traffic sessions through weighting their throughput, latency, and reliability. We then develop a deep reinforcement learning (DRL) framework that utilizes an actor-critic model to combine the advantages of both value-based and policy-based updating methods. A graph convolutional network (GCN) is incorporated as a component of the DRL framework for graph embedding of RAN data, enabling xSlice to handle a dynamic number of traffic sessions. We have implemented xSlice on an O-RAN testbed with 10 smartphones and conducted extensive experiments to evaluate its performance in realistic scenarios. Experimental results show that xSlice can reduce performance regret by 67% compared to the state-of-the-art solutions. Source code is available at https://github.com/xslice-5G/code.