Reinforcement learning meets bioprocess control through behaviour cloning: Real-world deployment in an industrial photobioreactor

作者: Juan D. Gil, Ehecatl Antonio Del Rio Chanona, José L. Guzmán, Manuel Berenguel

分类: eess.SY, cs.AI, cs.LG

发布日期: 2025-09-08

💡 一句话要点

提出基于行为克隆的强化学习方法,用于工业光生物反应器中的pH值控制。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 强化学习 行为克隆 生物过程控制 光生物反应器 pH值控制

📋 核心要点

- 开放式光生物反应器对环境变化敏感,传统控制方法难以维持稳定和最佳的生物过程条件。

- 采用行为克隆初始化强化学习策略,通过离线学习PID控制器的行为,再在线微调适应环境变化。

- 实验结果表明,该方法在降低误差、减少控制工作量和保持系统鲁棒性方面优于传统PID和标准强化学习。

📝 摘要(中文)

本文提出了一种结合强化学习(RL)和行为克隆(BC)的控制方法,用于开放式光生物反应器(PBR)中的pH值调节。这种方法是首次将基于RL的控制策略应用于这种非线性且易受干扰的生物过程中。该方法首先进行离线训练,RL智能体从标称比例-积分-微分(PID)控制器生成的轨迹中学习,无需与真实系统直接交互。然后进行每日在线微调,以适应不断变化的工艺动态并更好地抑制快速瞬态干扰。这种混合离线-在线策略能够部署自适应控制策略,以处理开放式PBR中固有的非线性和外部扰动。仿真研究表明,与PID控制相比,绝对误差积分(IAE)降低了8%,与标准离策略RL相比降低了5%。此外,控制工作量显著减少,与PID相比减少了54%,与标准RL相比减少了7%。在不同环境条件下进行的为期8天的实验验证证实了该方法的鲁棒性和可靠性。这项工作展示了基于RL的方法在生物过程控制中的潜力,并为它们更广泛地应用于其他非线性、易受干扰的系统铺平了道路。

🔬 方法详解

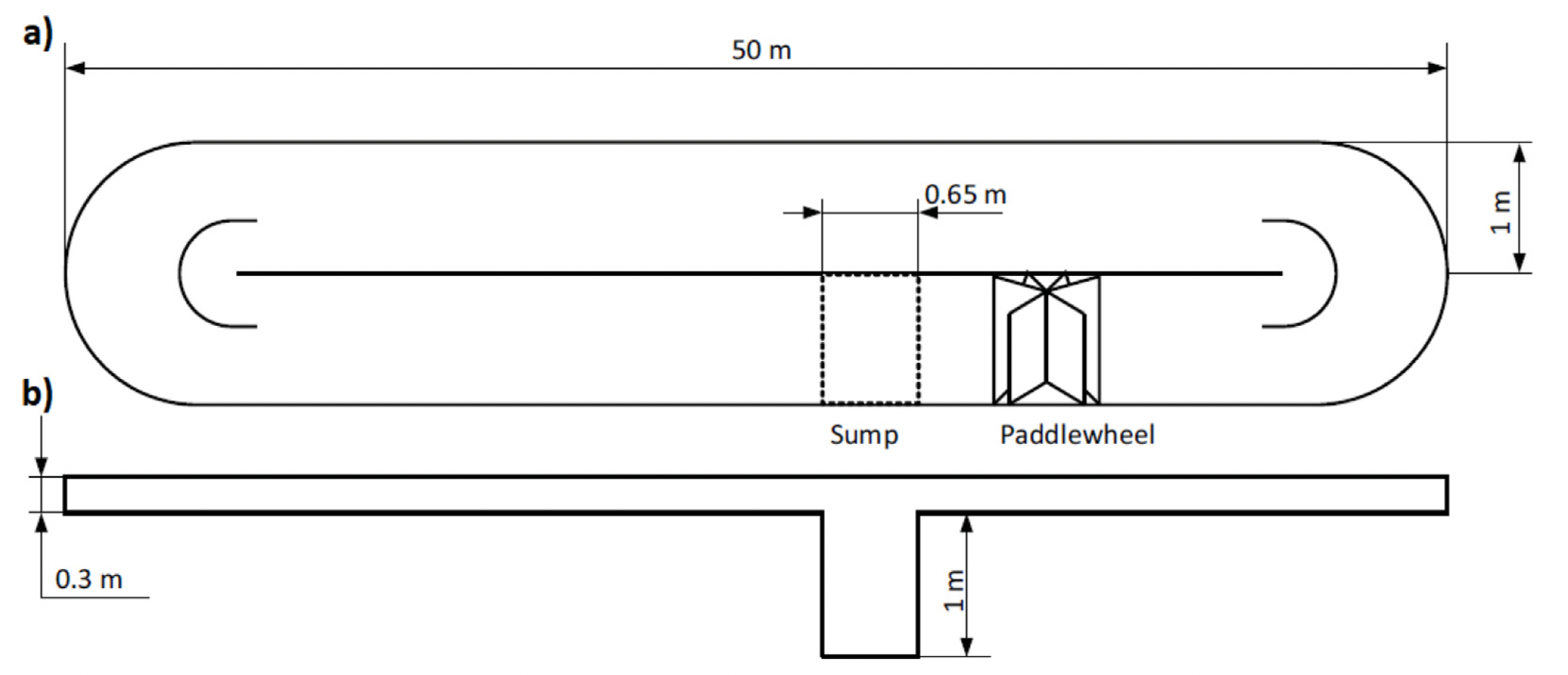

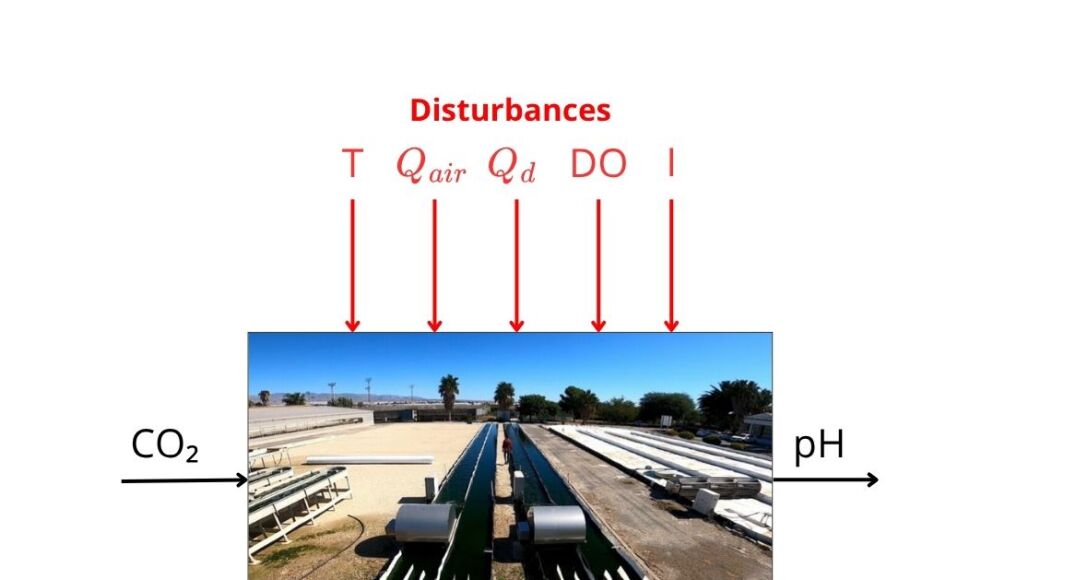

问题定义:论文旨在解决开放式光生物反应器(PBR)中pH值精确控制的问题。由于生物过程的非线性、时变性和易受外部环境干扰的特性,传统的PID控制难以达到理想的控制效果,需要频繁调整参数,且难以应对快速瞬态扰动。

核心思路:论文的核心思路是结合行为克隆(BC)和强化学习(RL),利用BC初始化RL智能体,使其快速学习到较好的控制策略,然后通过在线RL微调,使智能体能够适应环境变化,提高控制性能和鲁棒性。这种混合方法避免了RL智能体从零开始学习的困难,并能够充分利用PID控制器的经验。

技术框架:该方法包含两个主要阶段:离线训练阶段和在线微调阶段。在离线训练阶段,首先使用标称PID控制器生成控制轨迹数据。然后,使用行为克隆算法,训练RL智能体模仿PID控制器的行为。在在线微调阶段,RL智能体与实际PBR系统进行交互,通过与环境的交互,利用强化学习算法(具体算法未知)不断优化控制策略,以适应环境变化和提高控制性能。

关键创新:该方法最重要的创新点在于将行为克隆与强化学习相结合,用于解决生物过程控制问题。行为克隆提供了一个良好的初始化策略,加速了RL智能体的学习过程,并提高了控制策略的稳定性。此外,该方法采用离线训练和在线微调相结合的策略,能够在保证安全性的前提下,使智能体适应环境变化。

关键设计:论文中未明确指出具体的强化学习算法,损失函数,网络结构等技术细节。行为克隆阶段,智能体通过模仿PID控制器的动作进行学习。在线微调阶段,智能体通过与环境交互,根据奖励信号调整控制策略。奖励函数的设计对控制性能至关重要,但论文中没有详细描述。

🖼️ 关键图片

📊 实验亮点

仿真结果表明,与PID控制相比,该方法在绝对误差积分(IAE)方面降低了8%,与标准离策略RL相比降低了5%。更重要的是,控制工作量显著减少,与PID相比减少了54%,与标准RL相比减少了7%。为期8天的实验验证也证实了该方法在不同环境条件下的鲁棒性和可靠性。

🎯 应用场景

该研究成果可应用于各种生物过程控制领域,例如污水处理、生物制药和食品生产等。通过自适应控制策略,可以提高生物反应器的生产效率和产品质量,降低运营成本,并减少对环境的影响。该方法为解决其他非线性、时变和易受干扰的工业过程控制问题提供了新的思路。

📄 摘要(原文)

The inherent complexity of living cells as production units creates major challenges for maintaining stable and optimal bioprocess conditions, especially in open Photobioreactors (PBRs) exposed to fluctuating environments. To address this, we propose a Reinforcement Learning (RL) control approach, combined with Behavior Cloning (BC), for pH regulation in open PBR systems. This represents, to the best of our knowledge, the first application of an RL-based control strategy to such a nonlinear and disturbance-prone bioprocess. Our method begins with an offline training stage in which the RL agent learns from trajectories generated by a nominal Proportional-Integral-Derivative (PID) controller, without direct interaction with the real system. This is followed by a daily online fine-tuning phase, enabling adaptation to evolving process dynamics and stronger rejection of fast, transient disturbances. This hybrid offline-online strategy allows deployment of an adaptive control policy capable of handling the inherent nonlinearities and external perturbations in open PBRs. Simulation studies highlight the advantages of our method: the Integral of Absolute Error (IAE) was reduced by 8% compared to PID control and by 5% relative to standard off-policy RL. Moreover, control effort decreased substantially-by 54% compared to PID and 7% compared to standard RL-an important factor for minimizing operational costs. Finally, an 8-day experimental validation under varying environmental conditions confirmed the robustness and reliability of the proposed approach. Overall, this work demonstrates the potential of RL-based methods for bioprocess control and paves the way for their broader application to other nonlinear, disturbance-prone systems.