Learning Optimal Crew Dispatch for Grid Restoration Following an Earthquake

作者: Farshad Amani, Faezeh Ardali, Amin Kargarian

分类: eess.SY

发布日期: 2025-09-04

💡 一句话要点

提出基于Transformer和DRL的框架,加速地震后电网恢复中的最优抢修队伍调度。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 抢修队伍调度 深度强化学习 Transformer 电力网络恢复 灾后重建

📋 核心要点

- 传统混合整数线性规划方法在灾后抢修队伍调度中耗时过长,难以满足实时性要求。

- 论文提出结合Transformer和深度强化学习的框架,利用Transformer捕获系统状态,DRL进行自适应决策。

- 在2869节点欧洲天然气和电力网络上的实验表明,该方法显著加速了恢复过程,同时保持了高质量的解决方案。

📝 摘要(中文)

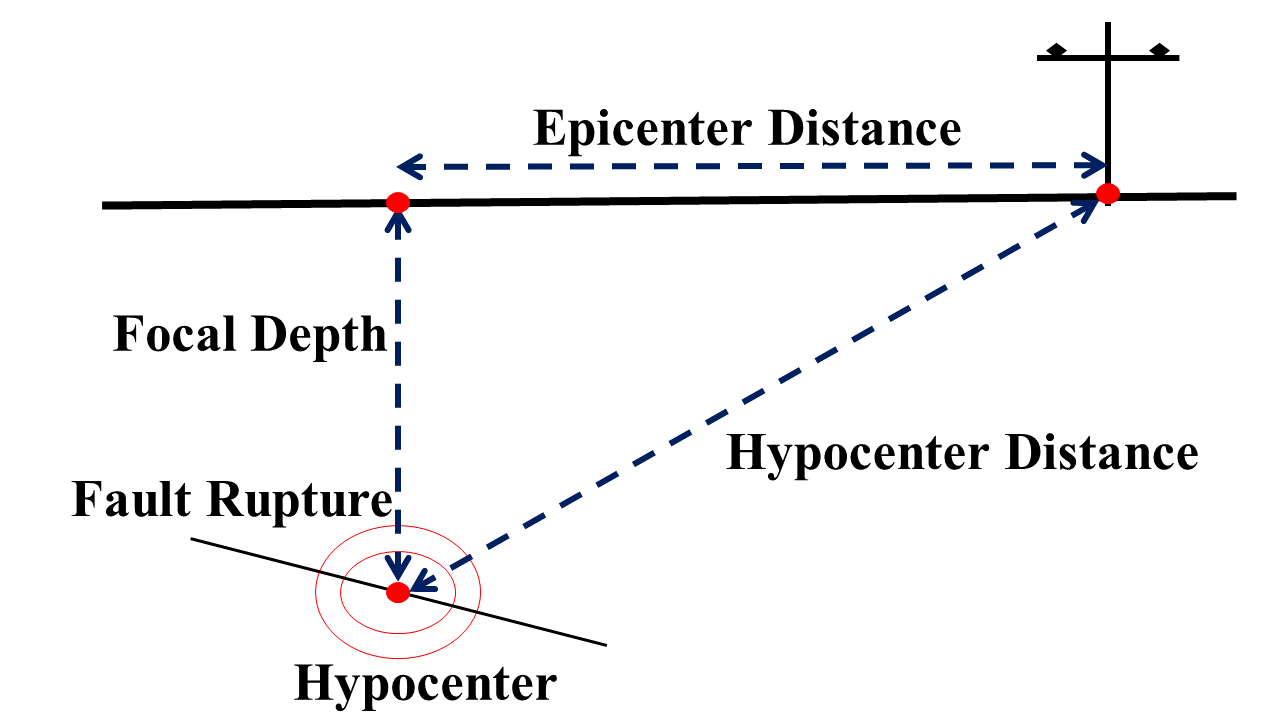

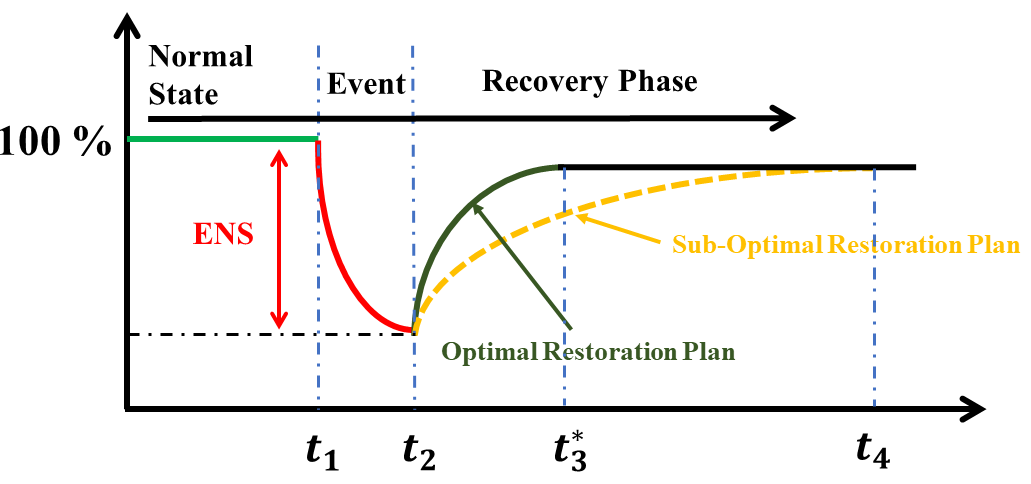

灾后抢修队伍调度是一项关键但计算密集型任务。传统的混合整数线性规划方法通常需要数分钟甚至数小时才能计算出解决方案,导致在高度动态的恢复环境中决策延误。为了解决这一挑战,我们提出了一种新的基于学习的框架,该框架集成了Transformer架构和深度强化学习(DRL),以提供近乎实时的决策支持,同时不影响解决方案的质量。抢修队伍调度被建模为不确定性下的序贯决策问题,其中Transformer捕获高维系统状态和时间依赖性,而DRL实现自适应和可扩展的决策。首先使用已建立的地震标准来表征地震引起的配电网络损坏,然后使用场景生成和缩减流程将可能的结果聚合到单个地理空间影响图中。在此图的基础上,所提出的框架生成二级调度策略,该策略在模拟和历史事件上进行离线训练,并在线部署以实现快速响应。除了显着缩短运行时间外,所提出的方法还通过实现更快,更有效的恢复来增强系统弹性。案例研究,特别是在2869节点欧洲天然气和电力网络上的案例研究表明,该方法在保持高质量解决方案的同时,显着加速了恢复,突显了其在大型灾难响应中实际部署的潜力。

🔬 方法详解

问题定义:论文旨在解决地震后电力网络恢复中的抢修队伍调度问题。现有方法,特别是基于混合整数线性规划(MILP)的方法,在计算大规模网络的优化调度方案时耗时过长,无法满足灾后快速响应的需求。这种计算瓶颈阻碍了及时决策,延缓了恢复进程。

核心思路:论文的核心思路是将抢修队伍调度问题建模为一个序贯决策问题,并利用深度强化学习(DRL)来学习最优调度策略。为了更好地表征复杂的系统状态和时间依赖性,引入了Transformer架构。通过离线训练,DRL智能体可以学习到在不同灾害场景下的最优行动策略,从而实现快速在线部署。

技术框架:整体框架包含以下几个主要阶段:1) 地震灾害评估:利用地震标准评估地震对配电网络的损害;2) 场景生成与缩减:生成多个可能的灾害场景,并通过缩减技术将其聚合为单个地理空间影响图;3) 调度策略生成:基于地理空间影响图,利用离线训练好的DRL智能体生成抢修队伍调度策略。Transformer网络作为DRL智能体的一部分,用于编码系统状态。

关键创新:论文的关键创新在于将Transformer架构与DRL相结合,用于解决灾后抢修队伍调度问题。Transformer能够有效捕获高维系统状态和时间依赖性,而DRL则能够学习到自适应和可扩展的决策策略。这种结合克服了传统MILP方法计算效率低的缺点,实现了近乎实时的决策支持。

关键设计:论文中,Transformer网络被用于编码系统状态,其输出作为DRL智能体的输入。DRL智能体使用合适的奖励函数进行训练,以最大化恢复效率和最小化恢复时间。具体的网络结构和训练参数(如学习率、批次大小等)可能在论文中有更详细的描述(未知)。损失函数的设计目标是使智能体学习到能够快速有效地恢复电力网络的调度策略(具体形式未知)。

🖼️ 关键图片

📊 实验亮点

论文在2869节点欧洲天然气和电力网络上进行了案例研究,结果表明,所提出的方法在保持高质量解决方案的同时,显著加速了恢复过程。具体的性能提升数据(例如恢复时间缩短的百分比)需要在论文中查找(未知),但总体而言,该方法展现了在大型灾难响应中实际部署的潜力。

🎯 应用场景

该研究成果可应用于各类灾害后的电力、燃气等基础设施的快速恢复。通过快速生成抢修队伍调度方案,可以显著缩短恢复时间,减少经济损失,提高社会应对灾害的能力。未来,该方法还可以扩展到其他类型的灾害和基础设施,例如洪水、飓风和通信网络。

📄 摘要(原文)

Post-disaster crew dispatch is a critical but computationally intensive task. Traditional mixed-integer linear programming methods often require minutes to several hours to compute solutions, leading to delays that hinder timely decision-making in highly dynamic restoration environments. To address this challenge, we propose a novel learning-based framework that integrates transformer architectures with deep reinforcement learning (DRL) to deliver near real-time decision support without compromising solution quality. Crew dispatch is formulated as a sequential decision-making problem under uncertainty, where transformers capture high-dimensional system states and temporal dependencies, while DRL enables adaptive and scalable decision-making. Earthquake-induced distribution network damage is first characterized using established seismic standards, followed by a scenario generation and reduction pipeline that aggregates probable outcomes into a single geospatial impact map. Conditioned on this map, the proposed framework generates second-level dispatch strategies, trained offline on simulated and historical events and deployed online for rapid response. In addition to substantial runtime improvements, the proposed method enhances system resilience by enabling faster and more effective recovery and restoration. Case studies, particularly on the 2869-bus European gas and power network, demonstrate that the method substantially accelerates restoration while maintaining high-quality solutions, underscoring its potential for practical deployment in large-scale disaster response.