A Framework for Ethical Decision-Making in Automated Vehicles through Human Reasons-based Supervision

作者: Lucas Elbert Suryana, Saeed Rahmani, Simeon Craig Calvert, Arkady Zgonnikov, Bart van Arem

分类: eess.SY

发布日期: 2025-07-31

备注: 7 pages, 4 figures

💡 一句话要点

提出基于人类理性监督的自动驾驶车辆伦理决策框架,提升复杂场景适应性。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 自动驾驶 伦理决策 人类理性 运动规划 行为决策

📋 核心要点

- 现有自动驾驶伦理决策研究过度关注极端场景,忽略了日常驾驶中常见的伦理困境,导致车辆行为僵化。

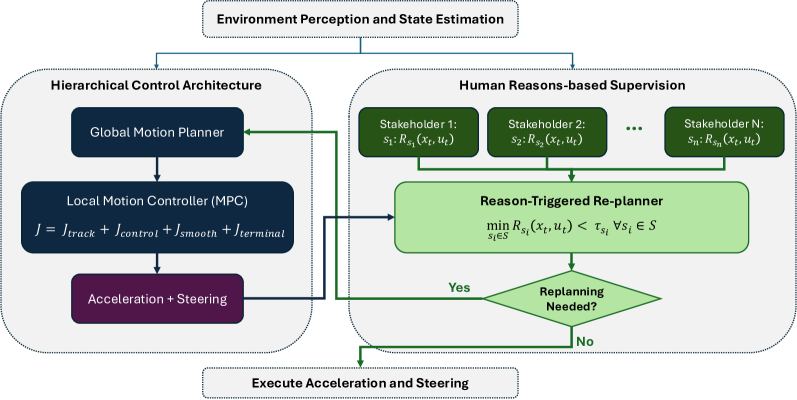

- 论文提出基于人类理性监督的框架,通过检测自动驾驶行为与人类理性的偏差,触发轨迹重新规划,实现更灵活的决策。

- 仿真结果表明,该方法能有效提升自动驾驶车辆在动态环境中的伦理决策能力,使其更好地适应复杂场景。

📝 摘要(中文)

在日常驾驶中,伦理困境普遍存在,需要驾驶员权衡安全、效率和规则遵守等相互冲突的优先级。然而,现有自动驾驶车辆(AVs)的研究主要集中在高风险的“电车难题”上,这些极端情况在现实中很少发生。实际上,当AVs面临日常伦理困境时,它们通常优先严格遵守交通规则。相比之下,人类驾驶员可能会根据具体情况灵活变通,并根据安全和效率等实际考虑做出判断。根据有意义的人工控制概念,AVs应该响应人类的理性,包括驾驶员、弱势道路使用者和政策制定者的理性。本研究提出了一种新颖的基于人类理性监督的框架,该框架检测AV行为何时与预期的人类理性不符,从而触发轨迹重新考虑。该框架与运动规划和控制系统集成,以支持实时调整,从而做出更好地反映安全、效率和监管考虑的决策。仿真结果表明,当当前轨迹未能与人类理性对齐时,该方法可以通过提示重新规划来帮助AVs更有效地应对动态驾驶环境中的伦理挑战。这些发现表明,我们的方法为AVs中更具适应性、以人为本的决策提供了一条途径。

🔬 方法详解

问题定义:自动驾驶车辆在面对日常驾驶中的伦理困境时,往往过于依赖规则,缺乏人类驾驶员的灵活性和判断力。现有方法难以有效处理这些常见但非极端的伦理问题,导致车辆行为不符合人类预期,影响用户体验和安全性。

核心思路:核心在于引入“人类理性”作为自动驾驶决策的监督信号。通过检测自动驾驶车辆的当前行为是否符合人类在类似情境下的理性判断,来触发轨迹的重新规划。这种方法旨在使自动驾驶车辆的行为更贴近人类驾驶员的决策模式,从而提高其适应性和安全性。

技术框架:该框架主要包含三个模块:1) 行为感知模块,用于感知车辆周围环境和自身行为;2) 人类理性评估模块,用于评估当前车辆行为是否符合人类理性,例如安全、效率和规则遵守;3) 轨迹重新规划模块,当评估结果表明车辆行为与人类理性存在偏差时,触发该模块进行轨迹重新规划,以生成更符合人类理性的轨迹。整个框架与现有的运动规划和控制系统集成,实现实时调整。

关键创新:关键创新在于将“人类理性”的概念引入自动驾驶决策过程,并设计了一种有效的评估方法来量化这种理性。与传统的基于规则或基于学习的方法不同,该方法能够更好地捕捉人类驾驶员在复杂情境下的决策逻辑,从而使自动驾驶车辆的行为更具适应性和可解释性。

关键设计:人类理性评估模块是关键。具体实现方式未知,但可能涉及构建一个包含大量人类驾驶行为数据的数据库,并使用机器学习算法来学习人类驾驶员的决策模式。评估模块需要考虑多种因素,例如车辆速度、周围车辆的位置、交通规则以及道路状况等。轨迹重新规划模块可能采用基于优化的方法,以生成满足安全、效率和人类理性约束的轨迹。

🖼️ 关键图片

📊 实验亮点

论文通过仿真实验验证了该框架的有效性,结果表明,当自动驾驶车辆的当前轨迹未能与人类理性对齐时,该方法可以通过提示重新规划来帮助AVs更有效地应对动态驾驶环境中的伦理挑战。具体的性能数据、对比基线和提升幅度未知,但结论表明该方法为AVs中更具适应性、以人为本的决策提供了一条途径。

🎯 应用场景

该研究成果可应用于提升自动驾驶车辆在复杂交通环境中的决策能力,使其更好地适应城市道路、拥堵路段等场景。通过模拟人类驾驶员的理性判断,自动驾驶车辆可以更安全、高效地行驶,并提高用户对自动驾驶技术的信任度。此外,该框架还可用于评估和改进自动驾驶算法的伦理性能。

📄 摘要(原文)

Ethical dilemmas are a common challenge in everyday driving, requiring human drivers to balance competing priorities such as safety, efficiency, and rule compliance. However, much of the existing research in automated vehicles (AVs) has focused on high-stakes "trolley problems," which involve extreme and rare situations. Such scenarios, though rich in ethical implications, are rarely applicable in real-world AV decision-making. In practice, when AVs confront everyday ethical dilemmas, they often appear to prioritise strict adherence to traffic rules. By contrast, human drivers may bend the rules in context-specific situations, using judgement informed by practical concerns such as safety and efficiency. According to the concept of meaningful human control, AVs should respond to human reasons, including those of drivers, vulnerable road users, and policymakers. This work introduces a novel human reasons-based supervision framework that detects when AV behaviour misaligns with expected human reasons to trigger trajectory reconsideration. The framework integrates with motion planning and control systems to support real-time adaptation, enabling decisions that better reflect safety, efficiency, and regulatory considerations. Simulation results demonstrate that this approach could help AVs respond more effectively to ethical challenges in dynamic driving environments by prompting replanning when the current trajectory fails to align with human reasons. These findings suggest that our approach offers a path toward more adaptable, human-centered decision-making in AVs.