Neural-Enhanced Rate Adaptation and Computation Distribution for Emerging mmWave Multi-User 3D Video Streaming Systems

作者: Babak Badnava, Jacob Chakareski, Morteza Hashemi

分类: cs.IT, cs.ET, cs.MM, eess.SY

发布日期: 2025-05-19

备注: Accepted to be published in IEEE Transaction on Multimedia

💡 一句话要点

提出多任务率适应与计算分配方法以优化毫米波视频流传输

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 毫米波通信 视频流传输 深度强化学习 多任务学习 用户体验优化

📋 核心要点

- 现有的毫米波视频流传输方法在多用户环境中面临通信与计算资源分配的挑战,难以实现最佳视频质量。

- 本文提出了一种深度强化学习框架(MTRC),通过实时调整视频比特率和计算分配来优化用户体验,且不依赖于环境的先验知识。

- 实验结果显示,C1R2变体在视频质量和缓冲时间方面均显著优于现有算法,PSNR提升达5.21-6.06 dB,缓冲时间减少2.18-2.70倍。

📝 摘要(中文)

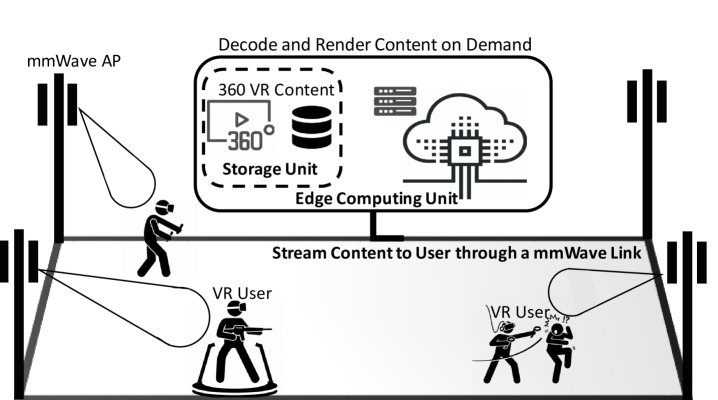

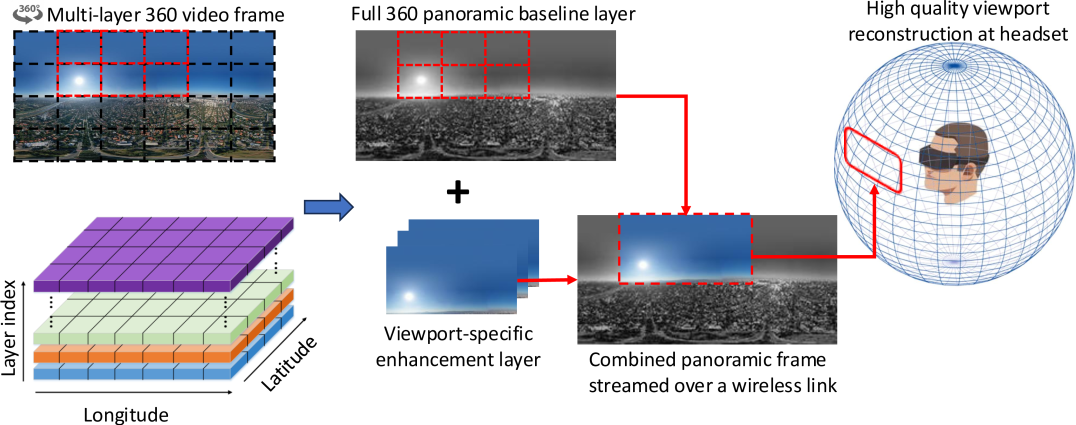

本文研究了在边缘计算支持的毫米波多用户虚拟现实系统中,针对360度视频流的多任务用户通信与计算资源分配问题。为平衡通信与计算之间的权衡,作者提出了一个视频质量最大化问题,并构建了深度强化学习框架(MTRC)来解决该问题。该方法不依赖于环境的先验知识,仅利用视频流统计数据和内容信息,动态调整视频比特率和计算分配。通过真实毫米波网络数据和360度视频数据集进行训练,结果表明,所提方法在用户体验质量、视口峰值信噪比、缓冲时间和质量变化等方面均优于现有算法,C1R2变体表现最佳,显著提升了视频质量和降低了缓冲时间。

🔬 方法详解

问题定义:本文旨在解决在边缘计算支持的毫米波多用户虚拟现实系统中,360度视频流的多任务用户通信与计算资源分配问题。现有方法在处理多用户环境时,往往无法有效平衡通信与计算之间的权衡,导致视频质量下降和用户体验不佳。

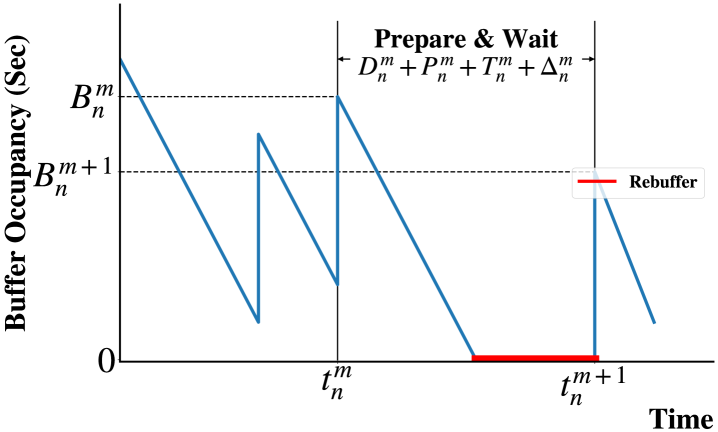

核心思路:论文提出了一种深度强化学习框架(MTRC),通过实时监测视频流的统计数据(如吞吐量、解码时间和传输延迟),动态调整视频比特率和计算资源分配,以最大化视频质量。该方法的设计理念是利用历史数据和实时反馈来优化决策,而不依赖于环境的先验知识。

技术框架:整体架构包括三个主要模块:1) 数据收集模块,负责收集视频流的统计信息;2) 深度强化学习模块,基于收集的数据进行决策;3) 反馈调整模块,根据用户的实时体验反馈调整策略。

关键创新:本文的关键创新在于引入了神经网络级联来捕捉任务间的相互依赖性,并扩展了MTRC方法至两个新变体(R1C2和C1R2),从而提升了算法的适应性和性能。与现有方法相比,这种设计能够更好地处理多任务环境中的复杂性。

关键设计:在模型训练中,采用了真实的毫米波网络数据和360度视频数据集,损失函数设计为综合考虑视频质量和用户体验的多目标函数,网络结构则采用了深度神经网络以增强学习能力。

🖼️ 关键图片

📊 实验亮点

实验结果表明,所提方法在视频质量和用户体验方面显著优于现有算法,C1R2变体实现了5.21-6.06 dB的PSNR提升,缓冲时间减少了2.18-2.70倍,质量变化减少了4.14-4.50 dB,展示了其在实际应用中的有效性。

🎯 应用场景

该研究的潜在应用场景包括虚拟现实、增强现实和360度视频流媒体等领域,能够显著提升用户在多用户环境下的观看体验。随着毫米波技术的发展,该方法的实际价值在于优化资源分配,提高视频流的质量和稳定性,具有广泛的商业应用前景。

📄 摘要(原文)

We investigate multitask edge-user communication-computation resource allocation for $360^\circ$ video streaming in an edge-computing enabled millimeter wave (mmWave) multi-user virtual reality system. To balance the communication-computation trade-offs that arise herein, we formulate a video quality maximization problem that integrates interdependent multitask/multi-user action spaces and rebuffering time/quality variation constraints. We formulate a deep reinforcement learning framework for \underline{m}ulti-\underline{t}ask \underline{r}ate adaptation and \underline{c}omputation distribution (MTRC) to solve the problem of interest. Our solution does not rely on a priori knowledge about the environment and uses only prior video streaming statistics (e.g., throughput, decoding time, and transmission delay), and content information, to adjust the assigned video bitrates and computation distribution, as it observes the induced streaming performance online. Moreover, to capture the task interdependence in the environment, we leverage neural network cascades to extend our MTRC method to two novel variants denoted as R1C2 and C1R2. We train all three methods with real-world mmWave network traces and $360^\circ$ video datasets to evaluate their performance in terms of expected quality of experience (QoE), viewport peak signal-to-noise ratio (PSNR), rebuffering time, and quality variation. We outperform state-of-the-art rate adaptation algorithms, with C1R2 showing best results and achieving $5.21-6.06$ dB PSNR gains, $2.18-2.70$x rebuffering time reduction, and $4.14-4.50$ dB quality variation reduction.