Optimizing Power Grid Topologies with Reinforcement Learning: A Survey of Methods and Challenges

作者: Erica van der Sar, Alessandro Zocca, Sandjai Bhulai

分类: eess.SY, cs.AI, cs.LG, stat.ML

发布日期: 2025-04-11 (更新: 2025-05-15)

备注: 60 pages, 26 figures, preprint

💡 一句话要点

综述:强化学习优化电网拓扑结构的方法与挑战

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 强化学习 电网拓扑优化 智能电网 可再生能源 电网控制 马尔可夫决策过程 深度Q网络

📋 核心要点

- 现有电网控制方法难以适应可再生能源带来的不确定性和复杂性,需要更智能的自适应控制策略。

- 该综述聚焦于利用强化学习优化电网拓扑结构,提升电网在动态环境下的决策能力。

- 论文通过数值实验对比评估了常见强化学习方法在电网拓扑优化中的效果,并总结了现有研究的不足。

📝 摘要(中文)

随着可再生能源日益融入电网,以及对更具适应性的控制策略的需求增长,电网运行变得越来越复杂。强化学习(RL)已成为一种有前景的电网控制(PNC)方法,它有潜力增强动态和不确定环境中的决策能力。Learning To Run a Power Network (L2RPN)竞赛通过提供标准化的基准和问题公式,在加速研究方面发挥了关键作用,从而推动了基于RL方法的发展。本综述全面而系统地概述了RL在电网拓扑优化中的应用,对现有技术进行分类,强调了关键的设计选择,并指出了当前研究中的差距。此外,我们还提供了一个比较数值研究,评估了常用RL方法的影响,从而深入了解它们的实际有效性。通过整合现有研究并概述未解决的挑战,本综述旨在为未来RL驱动的电网优化奠定基础。

🔬 方法详解

问题定义:论文旨在解决电力系统运行日益复杂的问题,特别是可再生能源的大量接入给电网的稳定性和效率带来了挑战。传统的电网控制方法难以应对这种复杂性和不确定性,需要更智能、更自适应的控制策略。现有方法的痛点在于无法在动态变化的环境中做出最优决策,导致电网运行效率低下,甚至可能引发安全问题。

核心思路:论文的核心思路是利用强化学习(RL)算法来优化电网拓扑结构,从而提高电网的运行效率和稳定性。强化学习通过智能体与环境的交互学习,能够在不确定和动态的环境中做出最优决策。通过将电网控制问题建模为马尔可夫决策过程(MDP),利用RL算法训练智能体,使其能够根据电网的实时状态调整拓扑结构,从而实现电网的优化运行。

技术框架:该综述首先对现有的基于RL的电网拓扑优化方法进行了分类和总结,然后对这些方法进行了比较数值研究。整体框架包括:1) 对电网拓扑优化问题进行建模,将其转化为马尔可夫决策过程;2) 选择合适的强化学习算法,如深度Q网络(DQN)、策略梯度算法等;3) 设计奖励函数,用于指导智能体的学习;4) 训练智能体,使其能够根据电网的实时状态做出最优决策;5) 对训练好的智能体进行评估,验证其在实际电网中的性能。

关键创新:该综述的关键创新在于对现有基于RL的电网拓扑优化方法进行了全面的总结和比较,并指出了当前研究中的差距和挑战。与现有方法相比,该综述不仅提供了对各种RL算法的详细描述,还深入分析了它们在电网拓扑优化中的应用,并对它们的性能进行了比较评估。此外,该综述还提出了未来研究的方向,为研究人员提供了有价值的参考。

关键设计:在基于RL的电网拓扑优化中,关键的设计包括:1) 状态空间的设计,需要能够全面描述电网的运行状态;2) 动作空间的设计,需要能够覆盖所有可能的拓扑结构调整;3) 奖励函数的设计,需要能够准确反映电网的运行目标,如降低损耗、提高稳定性等;4) 强化学习算法的选择,需要根据问题的特点选择合适的算法,如DQN、策略梯度算法等;5) 网络结构的设计,需要根据状态空间和动作空间的维度选择合适的网络结构。

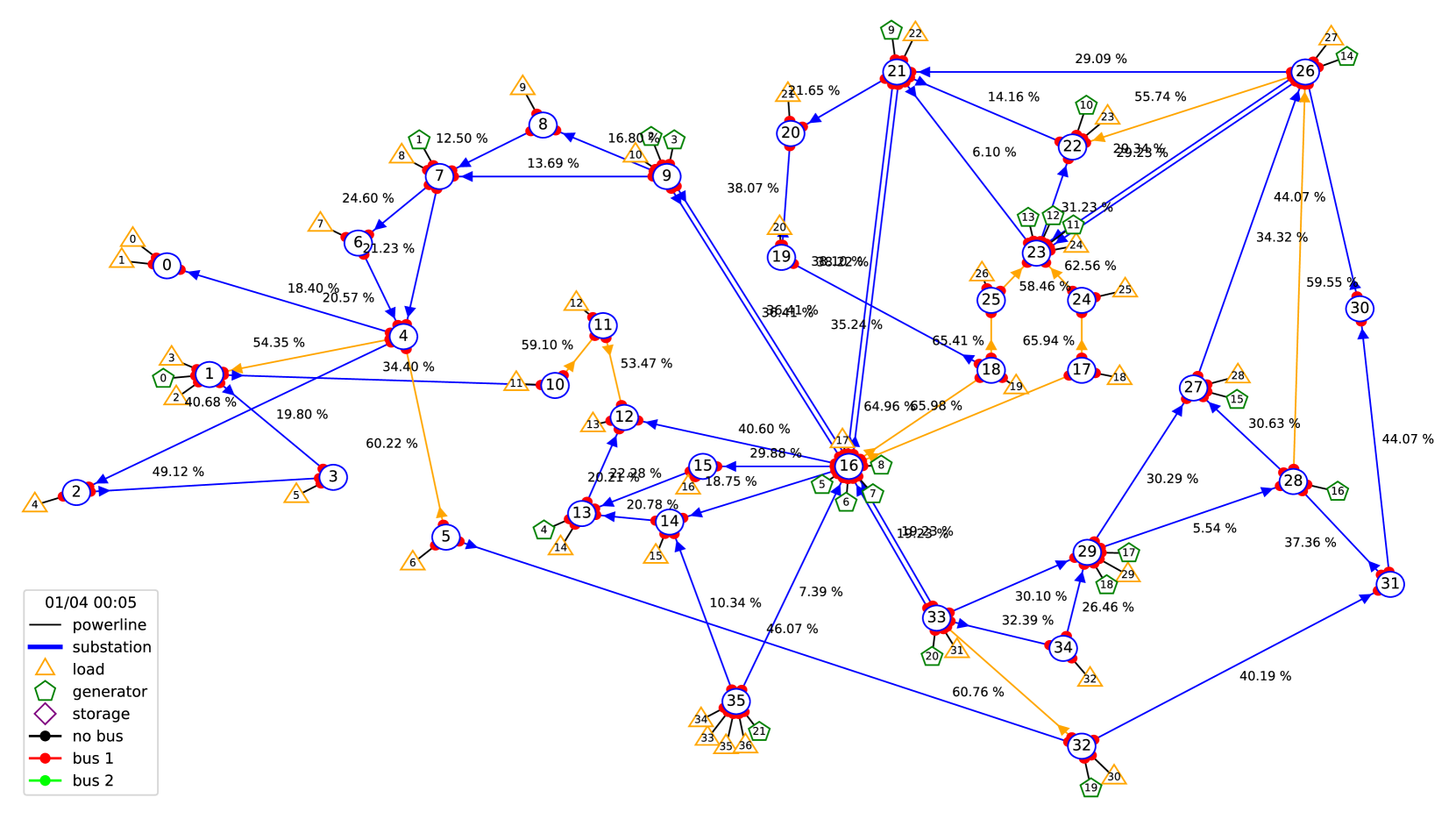

🖼️ 关键图片

📊 实验亮点

该综述通过数值实验对比评估了常见的强化学习方法在电网拓扑优化中的效果,例如DQN、策略梯度等算法。实验结果表明,不同的RL算法在不同的电网场景下表现出不同的性能,需要根据实际情况选择合适的算法。此外,实验还揭示了现有RL方法在处理大规模电网时的局限性,为未来的研究提供了方向。

🎯 应用场景

该研究成果可应用于智能电网的优化运行和控制,提高电网对可再生能源的接纳能力,降低电网损耗,提高电网的稳定性和可靠性。未来,该技术有望应用于大规模电网的实时优化控制,实现电网的智能化和自动化运行,为构建清洁、高效、安全的能源系统提供技术支撑。

📄 摘要(原文)

Power grid operation is becoming increasingly complex due to the rising integration of renewable energy sources and the need for more adaptive control strategies. Reinforcement Learning (RL) has emerged as a promising approach to power network control (PNC), offering the potential to enhance decision-making in dynamic and uncertain environments. The Learning To Run a Power Network (L2RPN) competitions have played a key role in accelerating research by providing standardized benchmarks and problem formulations, leading to rapid advancements in RL-based methods. This survey provides a comprehensive and structured overview of RL applications for power grid topology optimization, categorizing existing techniques, highlighting key design choices, and identifying gaps in current research. Additionally, we present a comparative numerical study evaluating the impact of commonly applied RL-based methods, offering insights into their practical effectiveness. By consolidating existing research and outlining open challenges, this survey aims to provide a foundation for future advancements in RL-driven power grid optimization.