Adaptive Resource Allocation Optimization Using Large Language Models in Dynamic Wireless Environments

作者: Hyeonho Noh, Byonghyo Shim, Hyun Jong Yang

分类: eess.SY, cs.LG

发布日期: 2025-02-04

💡 一句话要点

提出LLM-RAO,利用大语言模型优化动态无线环境下的资源分配,提升QoS。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大语言模型 资源分配 无线通信 动态环境 Prompt Tuning

📋 核心要点

- 现有深度学习方法在解决无线网络资源分配等约束优化问题时,缺乏通用性和适应性,难以应对动态环境。

- 论文提出LLM-RAO,利用大语言模型理解任务描述和约束,通过prompt tuning实现快速适应,无需大量重新训练。

- 实验表明,LLM-RAO在动态环境下,相比传统深度学习方法和分析方法,性能分别提升高达40%和80%,适应性显著。

📝 摘要(中文)

深度学习在解决传统分析方法难以应对的复杂无线接入网络控制挑战方面取得了显著进展。然而,深度学习在解决网络优化中常见的受约束的NP-hard问题(例如涉及服务质量QoS或用户索引等离散变量的问题)时表现出局限性。目前的解决方案依赖于特定领域的架构或启发式技术,缺乏通用的深度学习约束优化方法。此外,即使通信目标发生微小变化,也需要耗时的重新训练,这限制了它们在动态环境中的适应性,因为在动态环境中,任务目标、约束、环境因素和通信场景经常变化。为了应对这些挑战,我们提出了一种用于资源分配优化器的大语言模型(LLM-RAO),这是一种利用LLM能力来解决复杂的资源分配问题同时遵守QoS约束的新方法。通过采用基于提示的调整策略,将不断变化的任务描述和需求灵活地传递给LLM,LLM-RAO在动态环境中表现出强大的性能和无缝的适应性,而无需进行大量的重新训练。仿真结果表明,与传统的深度学习方法相比,LLM-RAO实现了高达40%的性能提升,与分析方法相比,实现了高达80%的性能提升。此外,在通信目标波动的情况下,LLM-RAO的性能是传统基于深度学习的网络的2.9倍。

🔬 方法详解

问题定义:论文旨在解决动态无线环境中资源分配的优化问题,尤其是在服务质量(QoS)约束下。现有方法,如传统分析方法和深度学习方法,在面对复杂约束和动态变化的任务目标时,存在局限性。传统分析方法难以处理复杂的非线性优化问题,而深度学习方法需要大量重新训练以适应新的环境和目标,成本高昂。

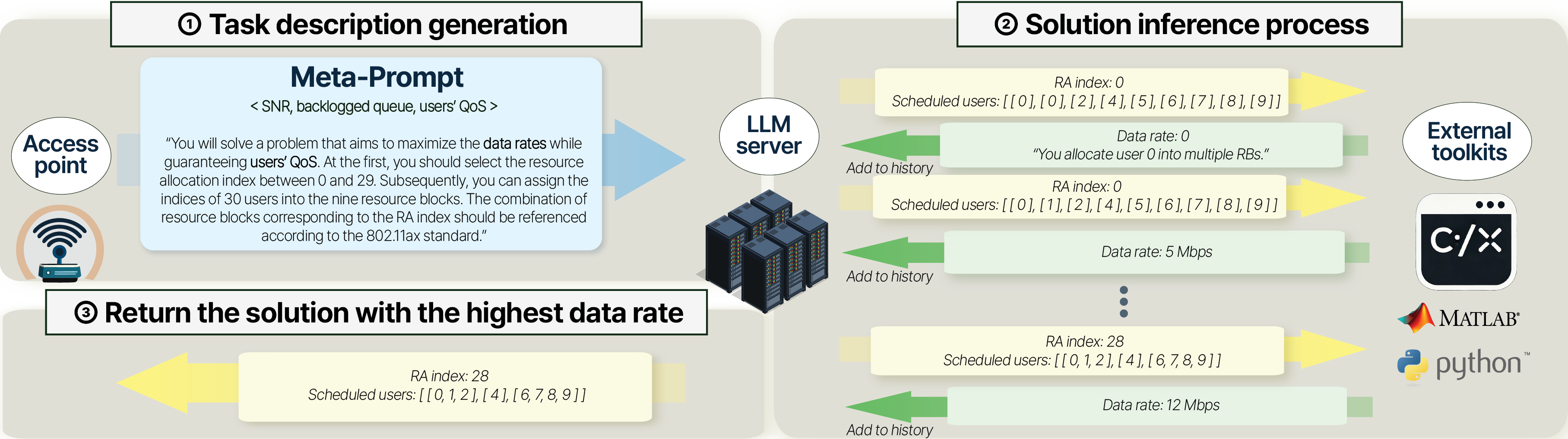

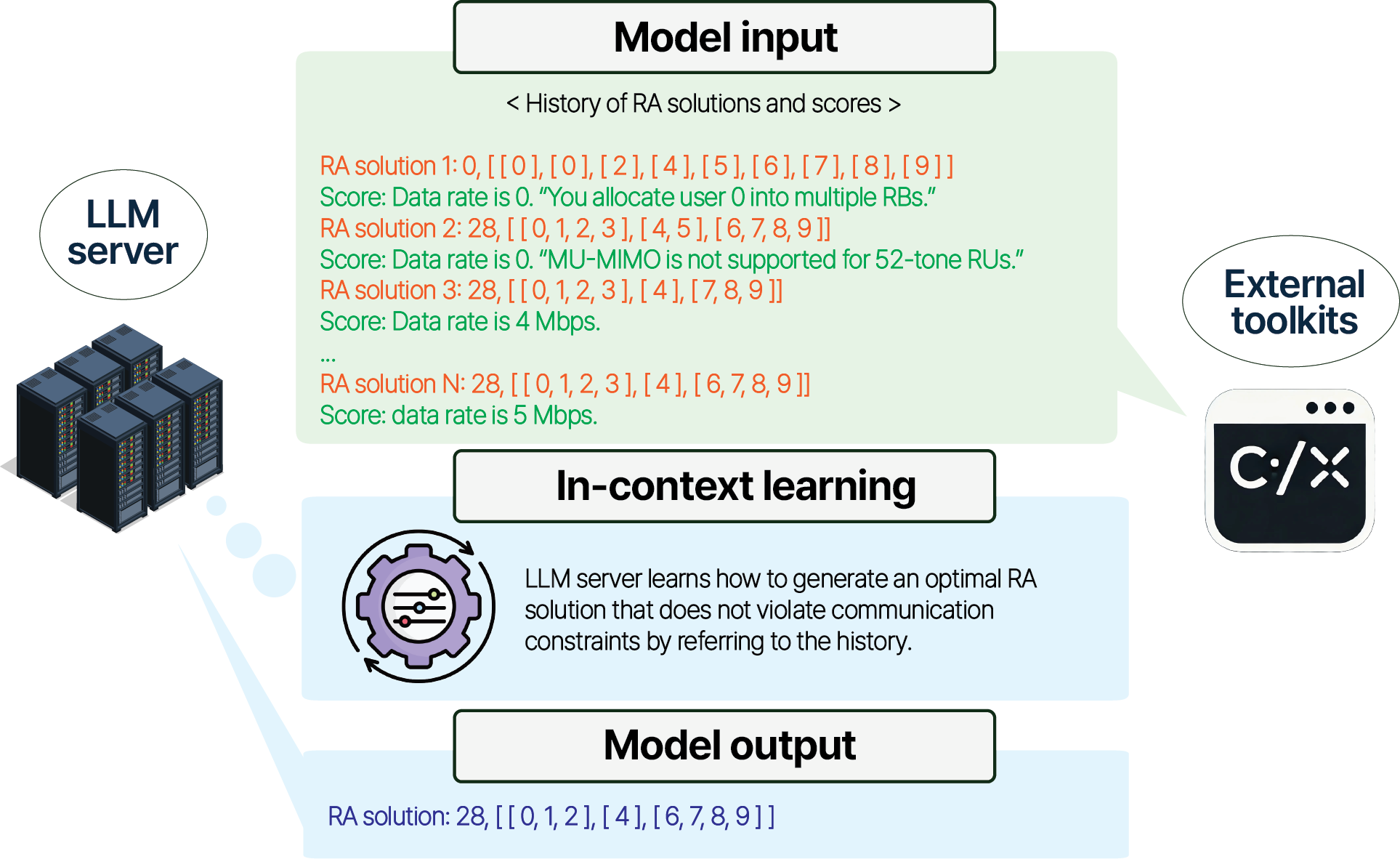

核心思路:论文的核心思路是利用大语言模型(LLM)的强大理解和泛化能力,将资源分配问题转化为LLM可以理解的文本描述,并通过prompt tuning的方式,使LLM能够根据不同的任务目标和约束条件,快速生成有效的资源分配策略。这种方法避免了针对每个新场景重新训练模型的需要,提高了适应性和效率。

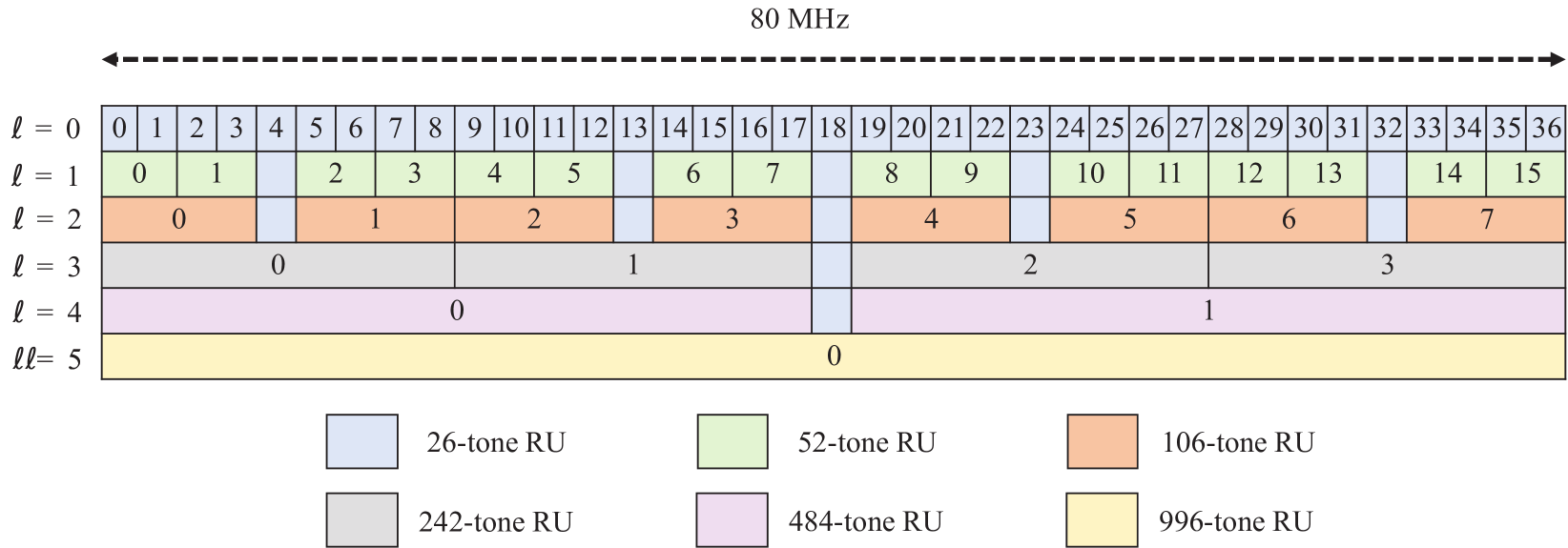

技术框架:LLM-RAO的技术框架主要包括以下几个模块:1) 任务描述模块:将资源分配问题,包括用户数量、信道状态、QoS需求等,转化为自然语言描述;2) Prompt生成模块:根据任务描述生成特定的prompt,输入到LLM中;3) LLM推理模块:利用LLM对prompt进行推理,生成资源分配方案;4) 方案评估模块:评估LLM生成的资源分配方案的性能,并根据评估结果调整prompt,优化LLM的输出。

关键创新:最重要的技术创新点在于将大语言模型应用于无线资源分配问题,并采用prompt tuning的方式实现快速适应。与传统的深度学习方法相比,LLM-RAO无需针对每个新场景重新训练模型,而是通过调整prompt来引导LLM生成合适的资源分配策略。这种方法大大提高了模型的泛化能力和适应性。

关键设计:关键设计包括:1) Prompt的设计:prompt需要包含任务描述、约束条件和期望的输出格式,以便LLM能够理解问题的目标和要求;2) 损失函数的设计:用于评估LLM生成的资源分配方案的性能,并指导prompt的优化。损失函数需要考虑QoS约束、资源利用率等因素;3) LLM的选择:选择具有强大理解和生成能力的LLM,例如GPT-3或类似的模型。

🖼️ 关键图片

📊 实验亮点

实验结果表明,LLM-RAO在动态无线环境中,相比传统深度学习方法,性能提升高达40%,与分析方法相比,性能提升高达80%。在通信目标波动的情况下,LLM-RAO的性能是传统基于深度学习的网络的2.9倍。这些结果验证了LLM-RAO在动态资源分配问题上的有效性和优越性。

🎯 应用场景

LLM-RAO可应用于各种动态无线通信场景,如蜂窝网络、无线传感器网络、物联网等。它能够根据实时变化的网络环境和用户需求,动态调整资源分配策略,提高网络性能和服务质量。该研究对于提升无线通信系统的智能化水平,降低运营成本具有重要意义,并为未来无线网络的发展提供了新的思路。

📄 摘要(原文)

Deep learning (DL) has made notable progress in addressing complex radio access network control challenges that conventional analytic methods have struggled to solve. However, DL has shown limitations in solving constrained NP-hard problems often encountered in network optimization, such as those involving quality of service (QoS) or discrete variables like user indices. Current solutions rely on domain-specific architectures or heuristic techniques, and a general DL approach for constrained optimization remains undeveloped. Moreover, even minor changes in communication objectives demand time-consuming retraining, limiting their adaptability to dynamic environments where task objectives, constraints, environmental factors, and communication scenarios frequently change. To address these challenges, we propose a large language model for resource allocation optimizer (LLM-RAO), a novel approach that harnesses the capabilities of LLMs to address the complex resource allocation problem while adhering to QoS constraints. By employing a prompt-based tuning strategy to flexibly convey ever-changing task descriptions and requirements to the LLM, LLM-RAO demonstrates robust performance and seamless adaptability in dynamic environments without requiring extensive retraining. Simulation results reveal that LLM-RAO achieves up to a 40% performance enhancement compared to conventional DL methods and up to an $80$\% improvement over analytical approaches. Moreover, in scenarios with fluctuating communication objectives, LLM-RAO attains up to 2.9 times the performance of traditional DL-based networks.