Quantum Reinforcement Learning-Based Two-Stage Unit Commitment Framework for Enhanced Power Systems Robustness

作者: Xiang Wei, Ziqing Zhu, Linghua Zhu, Ze Hu, Xian Zhang, Guibin Wang, Siqi Bu, Ka Wing Chan

分类: eess.SY

发布日期: 2024-10-28 (更新: 2025-03-22)

💡 一句话要点

提出基于量子强化学习的两阶段机组组合框架,增强电力系统鲁棒性。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 机组组合 量子强化学习 虚拟电厂 可再生能源 电力系统 智能电网

📋 核心要点

- 现有电力系统机组组合方法难以有效应对可再生能源带来的不确定性,且未能充分利用虚拟电厂的灵活性。

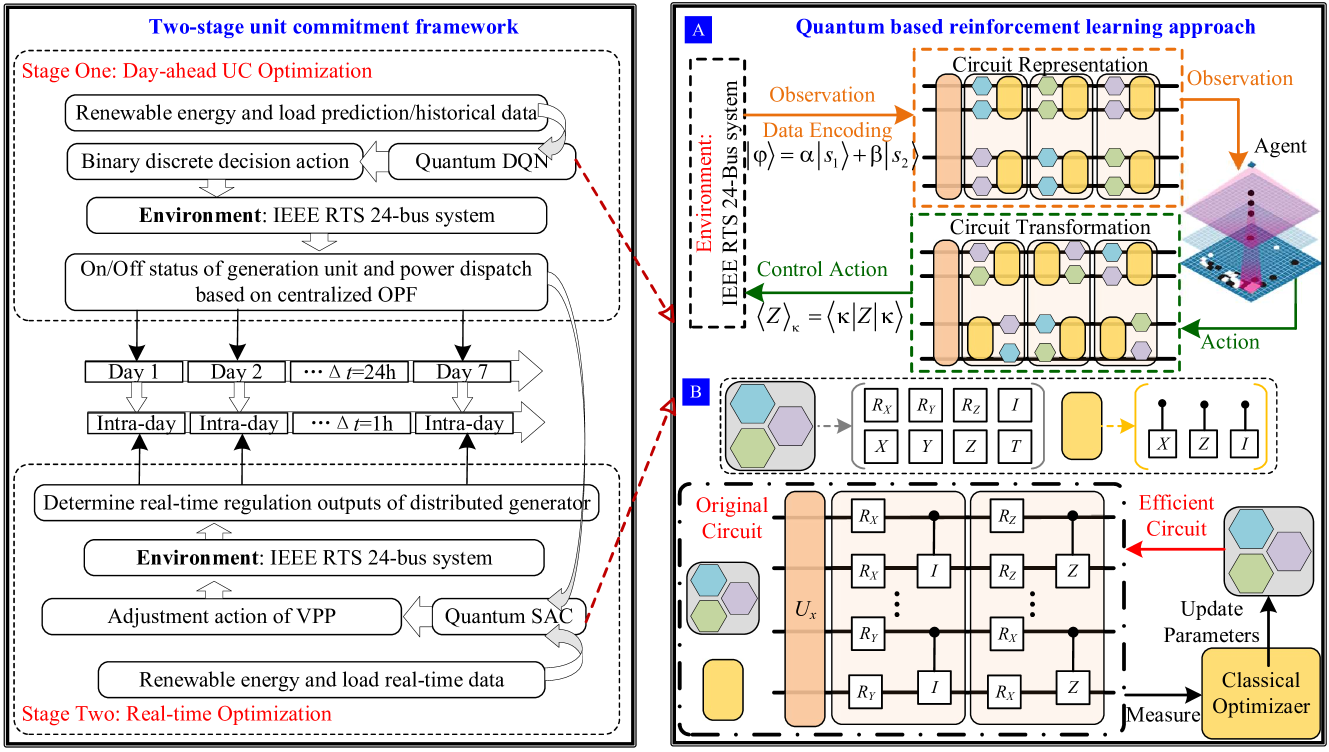

- 论文提出一种基于量子强化学习的两阶段机组组合框架,利用虚拟电厂作为灵活性资源,进行前瞻性决策。

- 实验结果表明,该方法在计算效率、实时响应性和解决方案质量方面均优于现有方法。

📝 摘要(中文)

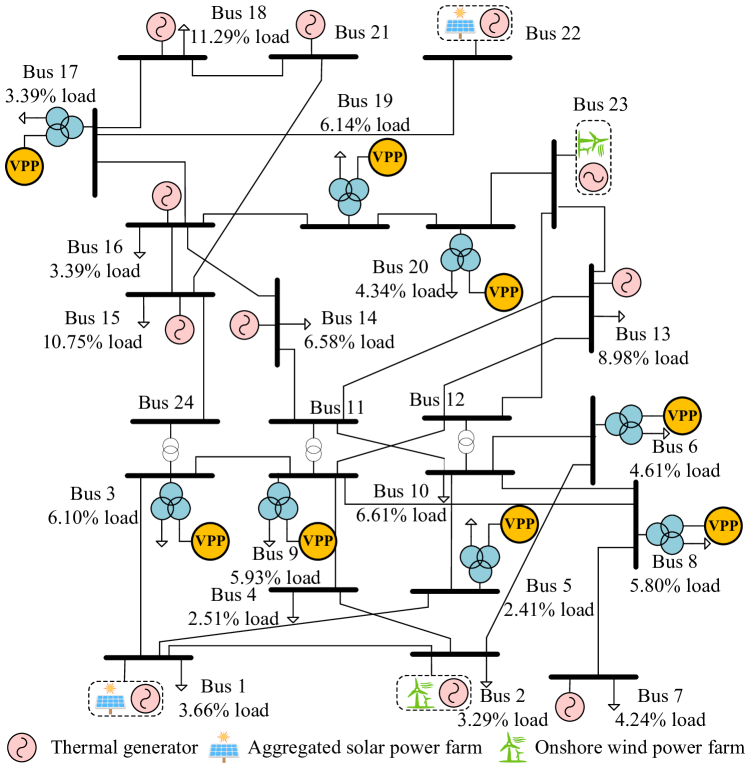

机组组合(UC)优化发电单元的启动和关闭计划,以满足负荷需求并最小化成本。然而,可再生能源日益增长的整合为实时调度带来了不确定性。现有的解决方案在建模和算法设计方面都面临局限性。在建模层面,它们未能将广泛采用的虚拟电厂(VPP)纳入作为灵活性资源,错失了通过前瞻性决策主动缓解潜在实时不平衡或斜坡约束的机会。在算法层面,现有的概率优化、多阶段方法和机器学习在计算复杂性和适应性方面面临挑战。为了应对这些挑战,本研究提出了一种新颖的两阶段UC框架,该框架在日前和实时调度中都结合了前瞻性顺序决策,利用VPP作为灵活性资源,主动为未来几个小时的可再生能源不确定性预留容量和斜坡灵活性。特别地,我们开发了量子强化学习(QRL)算法,该算法将深度强化学习(DRL)的前瞻性顺序决策和可扩展计算优势与量子计算的并行和高效搜索能力相结合。实验结果表明,所提出的基于QRL的方法在计算效率、实时响应性和解决方案质量方面表现更优。

🔬 方法详解

问题定义:论文旨在解决电力系统中日益增长的可再生能源比例带来的不确定性,以及现有方法在机组组合优化中未能充分利用虚拟电厂(VPP)的灵活性资源的问题。现有方法在建模层面缺乏对VPP的有效整合,在算法层面面临计算复杂性和适应性挑战,难以进行前瞻性决策,从而影响电力系统的鲁棒性。

核心思路:论文的核心思路是构建一个两阶段的机组组合框架,并在日前和实时调度中都引入前瞻性顺序决策。通过将VPP作为灵活性资源,主动为未来几个小时的可再生能源不确定性预留容量和斜坡灵活性。同时,利用量子强化学习(QRL)算法,结合深度强化学习(DRL)的前瞻性决策能力和量子计算的并行搜索优势,提高计算效率和解决方案质量。

技术框架:该框架包含两个主要阶段:日前调度和实时调度。在日前调度阶段,利用QRL算法预测未来一段时间内的可再生能源出力情况,并制定初步的机组组合计划。在实时调度阶段,根据实际的可再生能源出力情况,对日前计划进行调整,利用VPP的灵活性资源来平衡供需。QRL算法在两个阶段都发挥着关键作用,用于优化机组组合计划和VPP的调度策略。

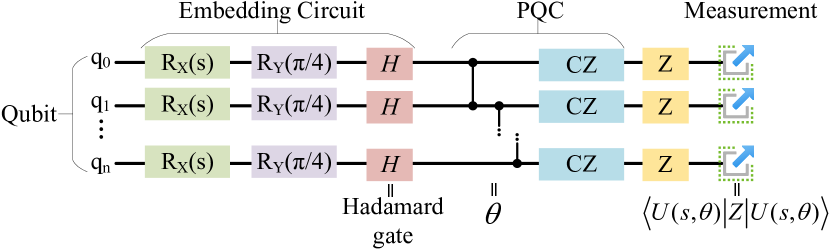

关键创新:论文最重要的技术创新点在于将量子强化学习(QRL)应用于电力系统的机组组合问题。QRL算法结合了深度强化学习(DRL)和量子计算的优势,能够在高维状态空间中进行高效的搜索和决策,从而提高计算效率和解决方案质量。与传统的基于概率优化、多阶段方法或传统机器学习的方法相比,QRL算法具有更强的适应性和鲁棒性。

关键设计:论文中QRL算法的具体设计细节未知,摘要中并未详细描述。但是可以推测,可能涉及到量子比特的编码方式、量子门的选取、奖励函数的设计以及网络结构的优化等。这些细节将直接影响QRL算法的性能和效果。

🖼️ 关键图片

📊 实验亮点

论文通过实验验证了所提出的基于QRL的两阶段机组组合框架的有效性。实验结果表明,该方法在计算效率、实时响应性和解决方案质量方面均优于现有方法。具体的性能数据和提升幅度在摘要中未给出,需要在论文正文中查找。

🎯 应用场景

该研究成果可应用于智能电网的调度和运行,提高电力系统对可再生能源的接纳能力和鲁棒性。通过优化机组组合计划和利用虚拟电厂的灵活性资源,可以降低发电成本,减少碳排放,并提高电力系统的可靠性和安全性。该方法还可推广到其他能源系统,如微电网和区域能源网络。

📄 摘要(原文)

Unit commitment (UC) optimizes the start-up and shutdown schedules of generating units to meet load demand while minimizing costs. However, the increasing integration of renewable energy introduces uncertainties for real-time scheduling. Existing solutions face limitations both in modeling and algorithmic design. At the modeling level, they fail to incorporate widely adopted virtual power plants (VPPs) as flexibility resources, missing the opportunity to proactively mitigate potential real-time imbalances or ramping constraints through foresight-seeing decision-making. At the algorithmic level, existing probabilistic optimization, multi-stage approaches, and machine learning, face challenges in computational complexity and adaptability. To address these challenges, this study proposes a novel two-stage UC framework that incorporates foresight-seeing sequential decision-making in both day-ahead and real-time scheduling, leveraging VPPs as flexibility resources to proactively reserve capacity and ramping flexibility for upcoming renewable energy uncertainties over several hours. In particular, we develop quantum reinforcement learning (QRL) algorithms that integrate the foresight-seeing sequential decision-making and scalable computation advantages of deep reinforcement learning (DRL) with the parallel and high-efficiency search capabilities of quantum computing. Experimental results demonstrate that the proposed QRL-based approach outperforms in computational efficiency, real-time responsiveness, and solution quality.