Neural Coordination and Capacity Control for Inventory Management

作者: Carson Eisenach, Udaya Ghai, Dhruv Madeka, Kari Torkkola, Dean Foster, Sham Kakade

分类: eess.SY, cs.LG, stat.ML

发布日期: 2024-09-24

💡 一句话要点

提出神经协调器,结合深度强化学习解决带容量约束的库存管理问题

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture)

关键词: 库存管理 容量约束 深度强化学习 神经协调器 需求预测

📋 核心要点

- 现有库存管理方法难以有效处理实际中存在的容量约束,导致次优决策。

- 提出神经协调器,通过预测容量价格来引导库存管理系统满足容量约束,替代传统模型预测控制。

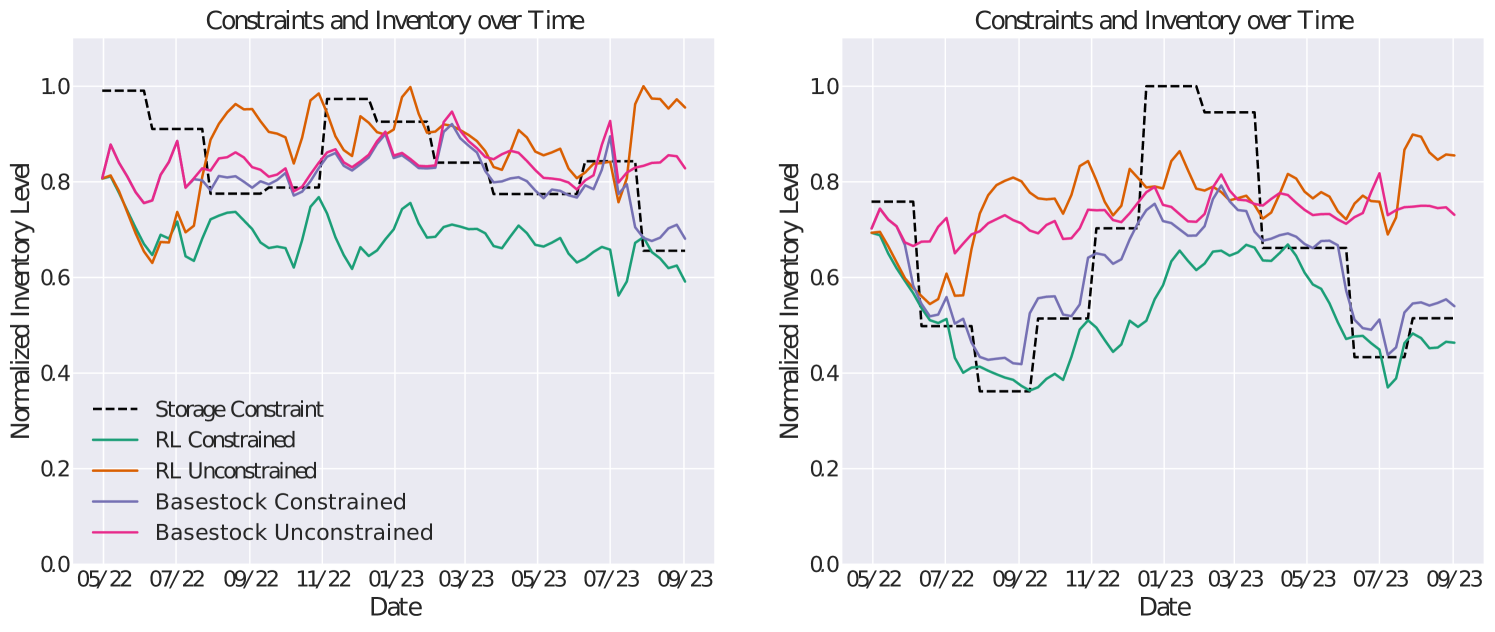

- 实验表明,结合神经协调器的强化学习购买策略在奖励和容量遵守方面显著优于传统方法,提升高达50%。

📝 摘要(中文)

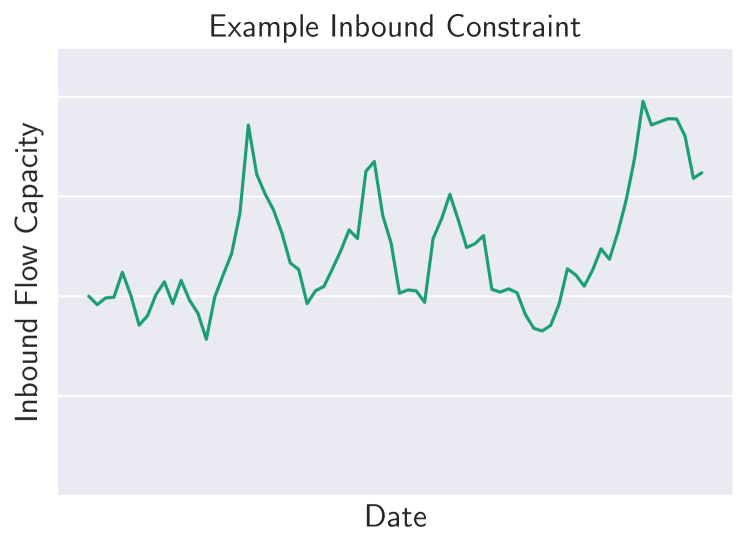

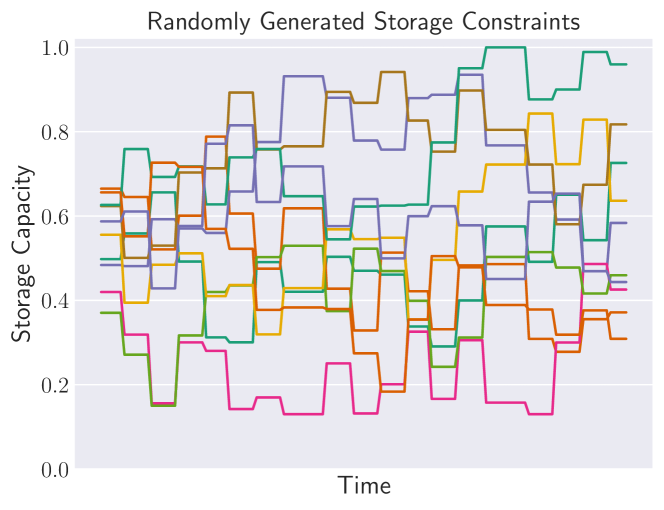

本文研究了带容量约束的周期性库存控制问题,重点关注零售商管理多种产品,同时受到共享资源(如存储空间或设施内的入库劳动力)限制的情况。本文旨在回答以下问题:(1)如何回测容量控制机制?(2)能否设计并回测与库存管理深度强化学习最新进展兼容的容量控制机制?首先,由于我们只有一个亚马逊容量限制的历史样本路径,因此提出了一种从可能的约束路径分布中采样的方法,覆盖了真实场景空间,从而对库存管理策略进行更鲁棒和真实的测试。其次,我们将Madeka等人(2022)的外部决策过程(exo-IDP)公式扩展到带容量约束的周期性库存控制问题,并表明某些容量约束控制问题并不比监督学习更难。第三,我们引入了一个“神经协调器”,旨在生成容量价格的预测,引导系统遵守目标约束,以取代传统的模型预测控制器。最后,我们应用改进的DirectBackprop算法来学习深度强化学习购买策略并训练神经协调器。通过大规模回测评估了我们的方法,结果表明,带有神经协调器的强化学习购买策略在累积折扣奖励和容量遵守方面均优于经典基线(在某些情况下,我们看到了高达50%的改进)。

🔬 方法详解

问题定义:论文旨在解决具有容量约束的周期性库存控制问题。传统的库存管理方法通常忽略了实际运营中存在的容量限制,例如存储空间、人力资源等,导致模型无法做出最优决策,甚至产生不可行的方案。现有方法难以在复杂、动态的容量约束下,有效地平衡库存成本和服务水平。

核心思路:论文的核心思路是引入一个“神经协调器”,该协调器能够预测容量的价格,并将这些价格信号传递给库存管理系统。库存管理系统根据这些价格信号调整其购买策略,从而在满足需求的同时,避免超出容量限制。这种方法将容量约束问题转化为一个价格引导的优化问题,使得系统能够自适应地调整策略以满足约束。

技术框架:整体框架包含两个主要模块:深度强化学习购买策略和神经协调器。首先,使用改进的DirectBackprop算法训练一个深度强化学习模型,该模型根据历史数据和当前库存状态生成购买决策。然后,神经协调器接收系统的容量利用率信息,预测容量的价格,并将这些价格反馈给强化学习模型。强化学习模型根据价格调整购买策略,形成一个闭环反馈系统。

关键创新:最重要的创新点在于神经协调器的引入,它取代了传统的模型预测控制器,能够更灵活、更有效地处理复杂的容量约束。与传统的基于模型的控制方法相比,神经协调器能够从数据中学习容量约束的动态特性,并生成更准确的价格预测。此外,论文还提出了一种新的回测方法,用于评估容量控制机制的性能,该方法能够生成更真实的容量约束场景。

关键设计:神经协调器通常是一个深度神经网络,输入包括历史容量利用率、库存水平等信息,输出是容量的价格预测。损失函数的设计至关重要,需要同时考虑容量约束的满足程度和库存成本。强化学习模型的网络结构和训练算法也需要进行调整,以适应价格信号的输入。DirectBackprop算法被修改以更好地训练深度RL购买策略。

🖼️ 关键图片

📊 实验亮点

实验结果表明,带有神经协调器的强化学习购买策略在累积折扣奖励和容量遵守方面均优于经典基线。在某些情况下,该方法在容量遵守方面实现了高达50%的改进。此外,论文提出的回测方法能够更真实地评估容量控制机制的性能。

🎯 应用场景

该研究成果可应用于电商、零售、制造业等多个领域的库存管理。通过引入神经协调器,企业可以更有效地利用有限的资源,降低库存成本,提高服务水平,并更好地应对需求波动和容量约束。该方法尤其适用于具有复杂供应链和多种产品的企业。

📄 摘要(原文)

This paper addresses the capacitated periodic review inventory control problem, focusing on a retailer managing multiple products with limited shared resources, such as storage or inbound labor at a facility. Specifically, this paper is motivated by the questions of (1) what does it mean to backtest a capacity control mechanism, (2) can we devise and backtest a capacity control mechanism that is compatible with recent advances in deep reinforcement learning for inventory management? First, because we only have a single historic sample path of Amazon's capacity limits, we propose a method that samples from a distribution of possible constraint paths covering a space of real-world scenarios. This novel approach allows for more robust and realistic testing of inventory management strategies. Second, we extend the exo-IDP (Exogenous Decision Process) formulation of Madeka et al. 2022 to capacitated periodic review inventory control problems and show that certain capacitated control problems are no harder than supervised learning. Third, we introduce a `neural coordinator', designed to produce forecasts of capacity prices, guiding the system to adhere to target constraints in place of a traditional model predictive controller. Finally, we apply a modified DirectBackprop algorithm for learning a deep RL buying policy and a training the neural coordinator. Our methodology is evaluated through large-scale backtests, demonstrating RL buying policies with a neural coordinator outperforms classic baselines both in terms of cumulative discounted reward and capacity adherence (we see improvements of up to 50% in some cases).