XLM for Autonomous Driving Systems: A Comprehensive Review

作者: Sonda Fourati, Wael Jaafar, Noura Baccar, Safwan Alfattani

分类: eess.SY

发布日期: 2024-09-16

备注: 30 pages, 18 figures, submitted to IEEE Open Journal of Intelligent Transportation Systems

💡 一句话要点

综述性论文:探索XLM在自动驾驶系统中的应用潜力

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 自动驾驶系统 大型语言模型 多模态学习 视觉语言模型 文献综述

📋 核心要点

- 现有自动驾驶系统在复杂环境感知和决策方面存在不足,需要更强大的模型来理解和融合多模态信息。

- 本文探讨了XLM(包括VLM和MLLM)在自动驾驶中的应用,利用其强大的语言理解能力融合多模态数据,提升驾驶决策的准确性。

- 该综述总结了XLM在自动驾驶领域的现有研究,分析了挑战和未来方向,为后续研究提供了参考。

📝 摘要(中文)

大型语言模型(LLM)在各种信息处理任务中展现了卓越的能力,包括数据提取、文献总结、内容生成、预测建模、决策制定和系统控制。视觉大型模型(VLM)和多模态LLM(MLLM),即下一代语言模型XLM,能够结合多种数据模态并利用语言理解的优势,从而推动自动驾驶系统(ADS)等信息系统的发展。通过将语言交流与全景图像、激光雷达或雷达数据等多模态传感器输入相结合,可以采取精确的驾驶行为。本文全面概述了XLM在实现自动驾驶方面的潜力,回顾了ADS和XLM的相关文献,包括架构、工具和框架。详细介绍了将XLM部署到自动驾驶解决方案的方案,并探讨了XLM在ADS部署中面临的挑战,以及旨在未来ADS框架中采用XLM的研究方向。

🔬 方法详解

问题定义:自动驾驶系统需要在复杂和动态的环境中做出准确的决策。现有的方法在处理多模态数据(如图像、激光雷达和雷达数据)的融合以及理解人类语言指令方面存在局限性,导致系统在某些情况下无法做出最佳决策。因此,如何有效地利用多模态信息并结合语言理解能力,是提升自动驾驶系统性能的关键挑战。

核心思路:本文的核心思路是探索和综述大型语言模型(LLM)及其变体(如VLM和MLLM,统称为XLM)在自动驾驶系统中的应用潜力。XLM具有强大的语言理解和生成能力,可以用于融合多模态数据,理解人类指令,并生成合理的驾驶策略。通过将XLM与传统的自动驾驶模块相结合,可以提升系统的感知、决策和控制能力。

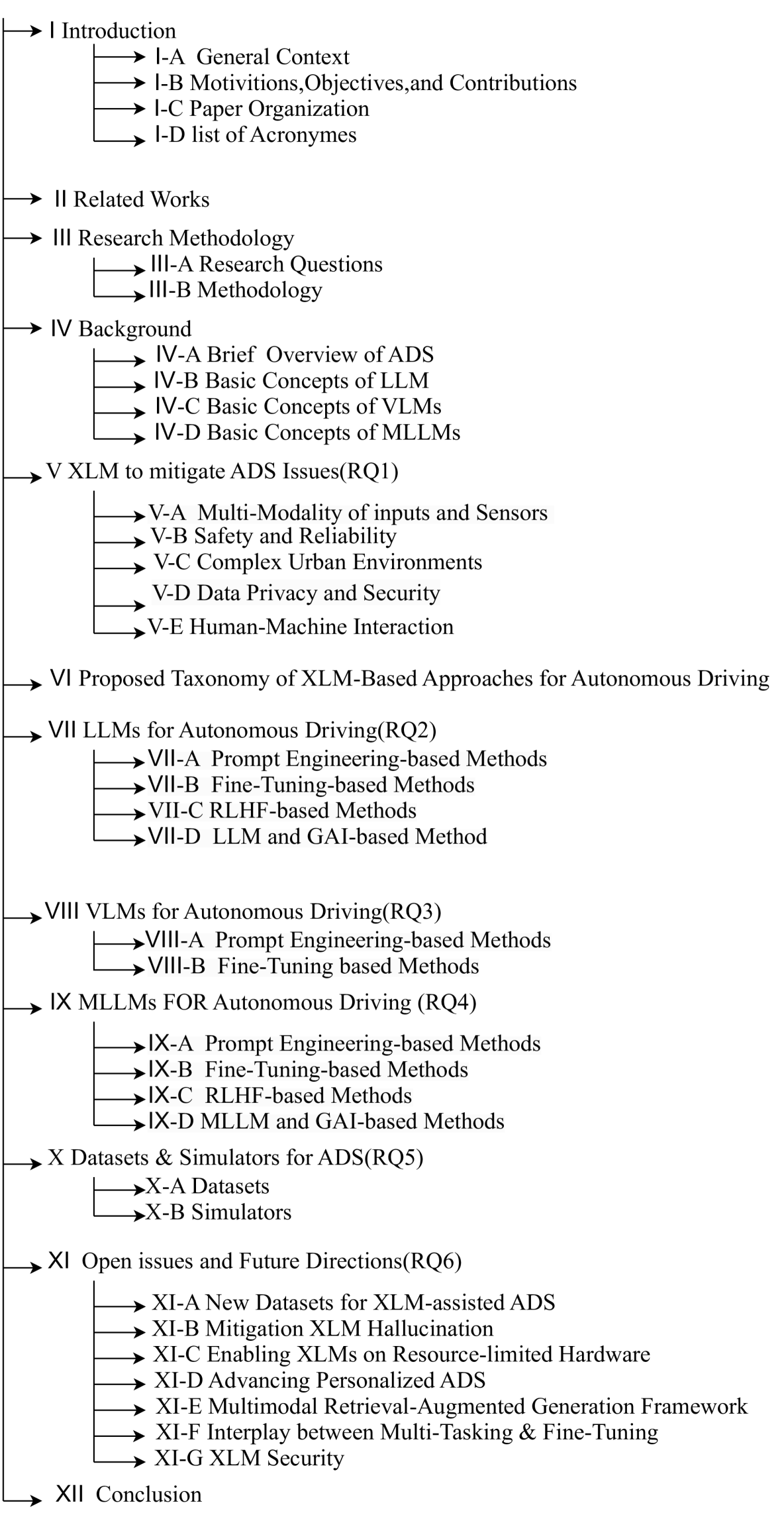

技术框架:本文主要以综述的形式,对XLM在自动驾驶领域的应用进行了梳理和总结。文章首先介绍了自动驾驶系统的基本架构和XLM的相关技术,然后详细讨论了XLM在自动驾驶中的应用,包括感知、决策和控制等方面。最后,文章分析了XLM在自动驾驶中面临的挑战,并提出了未来的研究方向。整体框架是文献综述的形式,没有具体的模型架构或流程。

关键创新:本文的创新之处在于对XLM在自动驾驶领域的应用进行了全面的综述和分析。虽然XLM在其他领域已经取得了显著的成果,但在自动驾驶领域的应用还处于探索阶段。本文通过梳理现有的研究,总结了XLM在自动驾驶中的潜力,并指出了未来的研究方向,为该领域的研究人员提供了有价值的参考。

关键设计:由于本文是综述性文章,因此没有具体的参数设置、损失函数或网络结构等技术细节。文章主要关注的是XLM在自动驾驶领域的应用,例如如何利用XLM进行多模态数据融合、如何利用XLM理解人类指令、以及如何利用XLM生成驾驶策略等。这些应用涉及到不同的模型和技术,具体的设计需要根据具体的任务和数据进行调整。

🖼️ 关键图片

📊 实验亮点

本文是一篇综述性文章,主要亮点在于对XLM在自动驾驶领域的应用进行了全面的梳理和总结。文章详细介绍了XLM在自动驾驶感知、决策和控制等方面的应用,并分析了XLM在自动驾驶中面临的挑战和未来的研究方向。虽然没有具体的实验数据,但为研究人员提供了宝贵的参考。

🎯 应用场景

该研究为自动驾驶领域提供了一种新的解决思路,即利用大型语言模型来提升系统的感知、决策和控制能力。潜在应用包括提升自动驾驶汽车在复杂环境下的安全性、优化驾驶策略以提高效率、以及实现更自然的人机交互。未来,XLM有望成为自动驾驶系统的重要组成部分,推动自动驾驶技术的进一步发展。

📄 摘要(原文)

Large Language Models (LLMs) have showcased remarkable proficiency in various information-processing tasks. These tasks span from extracting data and summarizing literature to generating content, predictive modeling, decision-making, and system controls. Moreover, Vision Large Models (VLMs) and Multimodal LLMs (MLLMs), which represent the next generation of language models, a.k.a., XLMs, can combine and integrate many data modalities with the strength of language understanding, thus advancing several information-based systems, such as Autonomous Driving Systems (ADS). Indeed, by combining language communication with multimodal sensory inputs, e.g., panoramic images and LiDAR or radar data, accurate driving actions can be taken. In this context, we provide in this survey paper a comprehensive overview of the potential of XLMs towards achieving autonomous driving. Specifically, we review the relevant literature on ADS and XLMs, including their architectures, tools, and frameworks. Then, we detail the proposed approaches to deploy XLMs for autonomous driving solutions. Finally, we provide the related challenges to XLM deployment for ADS and point to future research directions aiming to enable XLM adoption in future ADS frameworks.