Optimal Management of Grid-Interactive Efficient Buildings via Safe Reinforcement Learning

作者: Xiang Huo, Boming Liu, Jin Dong, Jianming Lian, Mingxi Liu

分类: eess.SY

发布日期: 2024-09-12

💡 一句话要点

提出一种基于物理规则的安全强化学习方法,用于优化电网互动高效建筑的能源管理。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 安全强化学习 电网互动高效建筑 能源管理 物理信息约束 智能建筑

📋 核心要点

- 传统强化学习在电网互动高效建筑管理中面临约束难以保证的问题,可能导致安全风险。

- 论文提出一种受物理启发式的安全强化学习方法,通过与环境的安全交互来增强决策能力,确保约束满足。

- 仿真结果表明,该方法能有效优化GEB的能源管理,降低成本并提升用户舒适度,同时保证安全性。

📝 摘要(中文)

本文提出了一种基于强化学习(RL)的安全方法,用于管理电网互动高效建筑(GEB)。传统的RL方法难以保证约束满足,可能导致严重的安全问题。现有的安全RL方法通常依赖于神经网络的正则化参数或奖励惩罚,面临参数调整困难和约束违反等挑战。为了在GEB控制中提供强制安全保证,本文设计了一种受物理启发式的安全RL方法,通过与环境的安全交互来增强决策能力。该方法能够优化管理GEB中的各种能源资源,以最小化能源成本并最大化客户舒适度。通过对GEB(包括供暖、通风和空调(HVAC)、太阳能光伏和储能系统)的优化管理进行仿真,验证了该方法的有效性。

🔬 方法详解

问题定义:论文旨在解决电网互动高效建筑(GEB)的能源优化管理问题。现有基于强化学习的方法虽然有效,但缺乏内在的约束满足保证,容易违反安全约束。传统的安全强化学习方法依赖于神经网络的正则化或奖励惩罚,存在参数调整困难,且无法完全避免约束违反的情况。

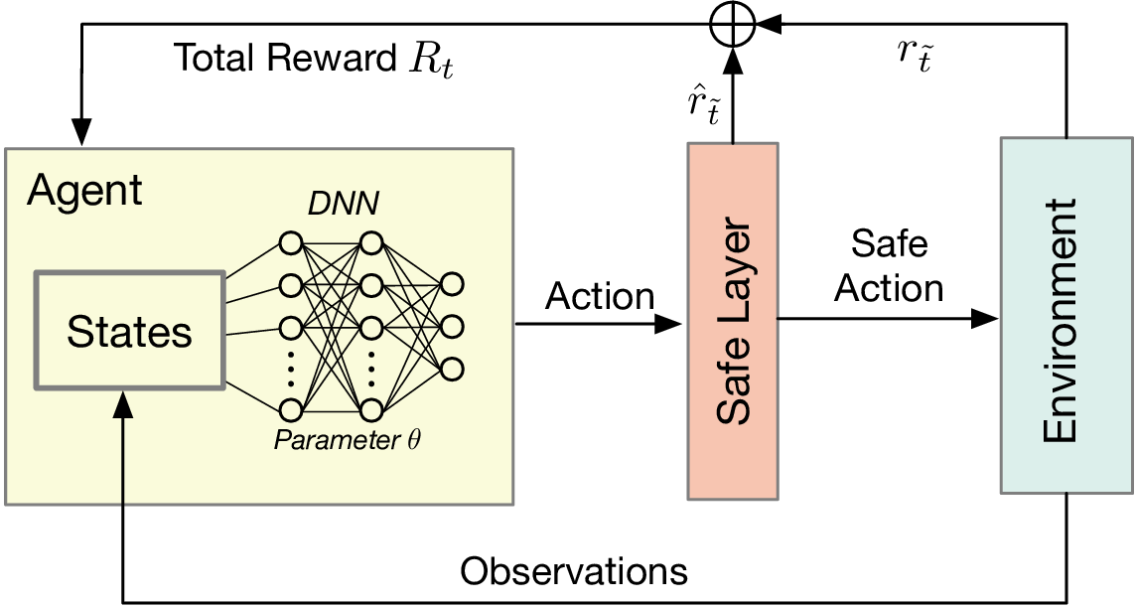

核心思路:论文的核心思路是设计一种受物理启发式的安全强化学习方法,该方法利用GEB的物理知识(如稳态规则)来指导强化学习的探索和决策过程,从而保证安全性。通过与环境的安全交互,智能体能够学习到满足约束的最优策略。

技术框架:整体框架包含以下几个主要部分:1) 环境建模:建立GEB的数学模型,包括HVAC系统、太阳能光伏系统和储能系统等。2) 安全规则制定:基于GEB的物理特性,制定一系列硬稳态规则,作为安全约束。3) 安全强化学习算法设计:将安全规则融入强化学习框架中,设计一种能够保证约束满足的策略优化算法。4) 仿真验证:在GEB仿真环境中验证所提出方法的有效性。

关键创新:该方法最重要的创新点在于将GEB的物理知识(稳态规则)直接融入到强化学习的决策过程中,从而实现强制的安全保证。与传统的安全强化学习方法相比,该方法不需要依赖于复杂的参数调整,能够更有效地避免约束违反。

关键设计:论文的关键设计包括:1) 基于GEB物理特性的硬稳态规则的制定,这些规则定义了系统的安全运行范围。2) 将这些规则作为约束条件,融入到强化学习的奖励函数或状态空间中,引导智能体学习满足约束的策略。3) 采用合适的强化学习算法(如Trust Region Policy Optimization (TRPO) 或 Proximal Policy Optimization (PPO))进行策略优化。

🖼️ 关键图片

📊 实验亮点

论文通过在包含HVAC、太阳能光伏和储能系统的GEB仿真环境中进行实验,验证了所提出方法的有效性。实验结果表明,该方法能够在保证安全约束的前提下,有效地降低能源成本,并提高用户舒适度。具体的性能数据和对比基线(如传统RL方法)的提升幅度在论文中进行了详细的展示。

🎯 应用场景

该研究成果可应用于智能建筑、智慧城市等领域,通过优化能源管理,降低能源消耗,提高能源利用效率,并保障系统的安全稳定运行。该方法有助于实现更加绿色、可持续的建筑能源系统,具有重要的经济和社会价值。

📄 摘要(原文)

Reinforcement learning (RL)-based methods have achieved significant success in managing grid-interactive efficient buildings (GEBs). However, RL does not carry intrinsic guarantees of constraint satisfaction, which may lead to severe safety consequences. Besides, in GEB control applications, most existing safe RL approaches rely only on the regularisation parameters in neural networks or penalty of rewards, which often encounter challenges with parameter tuning and lead to catastrophic constraint violations. To provide enforced safety guarantees in controlling GEBs, this paper designs a physics-inspired safe RL method whose decision-making is enhanced through safe interaction with the environment. Different energy resources in GEBs are optimally managed to minimize energy costs and maximize customer comfort. The proposed approach can achieve strict constraint guarantees based on prior knowledge of a set of developed hard steady-state rules. Simulations on the optimal management of GEBs, including heating, ventilation, and air conditioning (HVAC), solar photovoltaics, and energy storage systems, demonstrate the effectiveness of the proposed approach.