Self-Refined Generative Foundation Models for Wireless Traffic Prediction

作者: Chengming Hu, Hao Zhou, Di Wu, Xi Chen, Jun Yan, Xue Liu

分类: eess.SY

发布日期: 2024-08-19 (更新: 2025-11-24)

💡 一句话要点

提出TrafficLLM,一种自精炼生成式大模型,用于无线流量预测。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 无线流量预测 大型语言模型 上下文学习 6G网络 自精炼 少样本学习 生成式模型

📋 核心要点

- 6G网络中无线流量的动态变化给准确稳定的流量预测带来了巨大挑战。

- TrafficLLM通过上下文学习,利用LLM的少样本学习能力,迭代地精炼预测结果。

- 实验结果表明,TrafficLLM在两个真实数据集上优于其他基于LLM的上下文学习方法。

📝 摘要(中文)

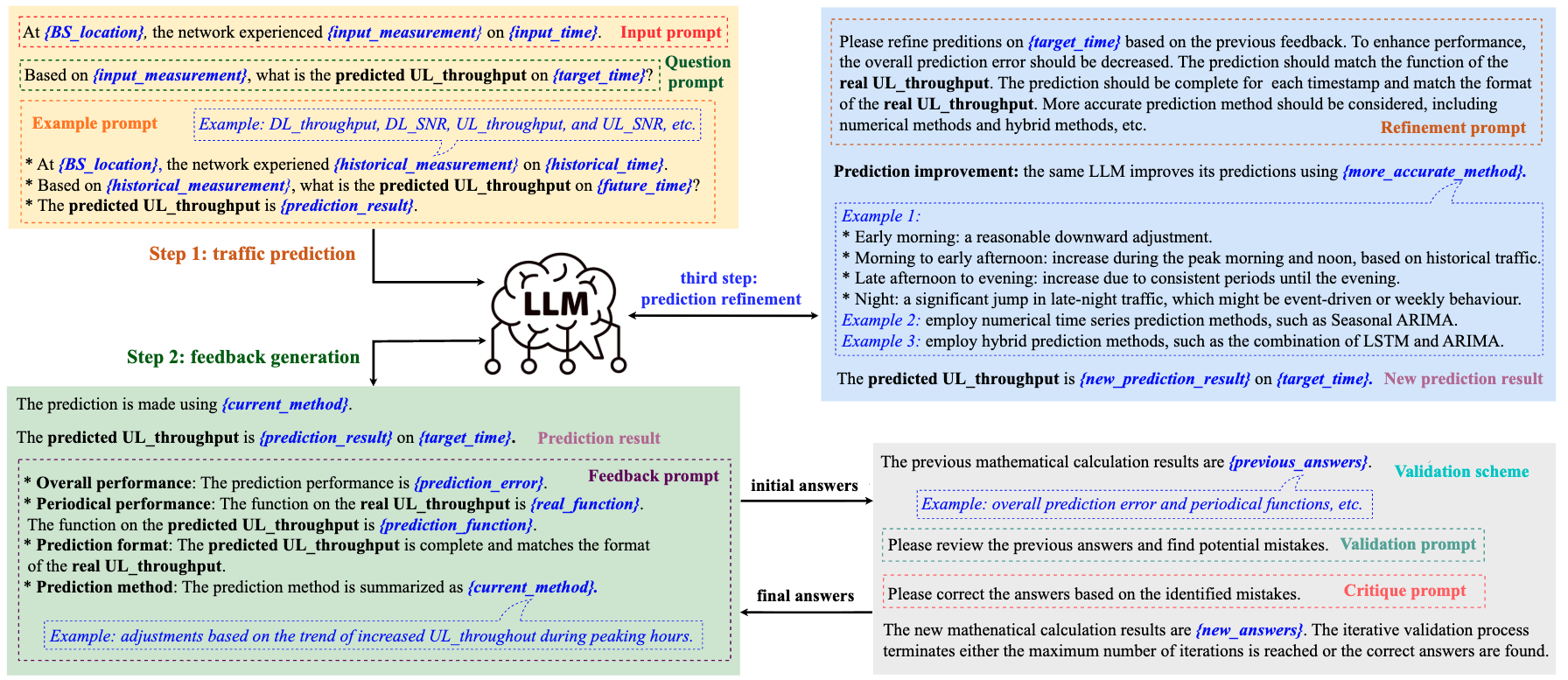

为了应对6G网络中无线流量动态变化带来的预测挑战,本文提出了一种新颖的自精炼大型语言模型(LLM)TrafficLLM,用于无线流量预测。该模型通过上下文学习实现,无需参数微调或模型训练。TrafficLLM利用LLM强大的少样本学习能力,增强了流量预测在动态无线环境中的可扩展性。TrafficLLM通过流量预测、反馈生成和预测精炼这三个步骤迭代地优化预测结果。首先,使用特定任务的演示提示进行流量预测。然后,针对LLM可能产生的错误预测,设计反馈演示提示,提供多方面的有价值的反馈,并结合验证方案来提高数学计算的准确性。最后,利用精炼演示提示,使LLM能够进一步改进其预测,从而提高预测性能。在两个真实数据集上的评估表明,TrafficLLM优于基于LLM的上下文学习方法,性能分别提高了23.17%和17.09%。

🔬 方法详解

问题定义:无线流量预测对于6G网络管理至关重要,但6G网络中无线流量的非平稳性和动态变化使得准确预测变得困难。现有方法难以适应这种动态变化,需要频繁的重新训练或微调,成本高昂。

核心思路:利用大型语言模型(LLM)的上下文学习能力,通过设计合适的提示(prompts),让LLM在无需微调的情况下,根据少量样本进行流量预测。并通过迭代的反馈和精炼过程,逐步提高预测的准确性。

技术框架:TrafficLLM包含三个主要阶段:1) 流量预测:使用任务特定的演示提示,LLM进行初始流量预测。2) 反馈生成:针对初始预测结果,设计反馈演示提示,生成多方面的反馈信息,并采用验证方案提高计算准确性。3) 预测精炼:利用精炼演示提示,LLM根据反馈信息进一步优化预测结果。这三个阶段迭代进行,直至达到预期的预测精度。

关键创新:TrafficLLM的核心创新在于其自精炼的预测框架,通过迭代的反馈和精炼过程,充分利用LLM的上下文学习能力,无需参数微调即可适应动态变化的无线环境。与传统的微调方法相比,TrafficLLM更具灵活性和可扩展性。

关键设计:关键设计包括:1) 三种类型的演示提示(流量预测、反馈生成、预测精炼),需要精心设计以引导LLM进行有效的预测和优化。2) 反馈生成过程中的验证方案,用于提高数学计算的准确性,避免LLM在计算方面出现错误。3) 迭代次数的设置,需要在预测精度和计算成本之间进行权衡。

🖼️ 关键图片

📊 实验亮点

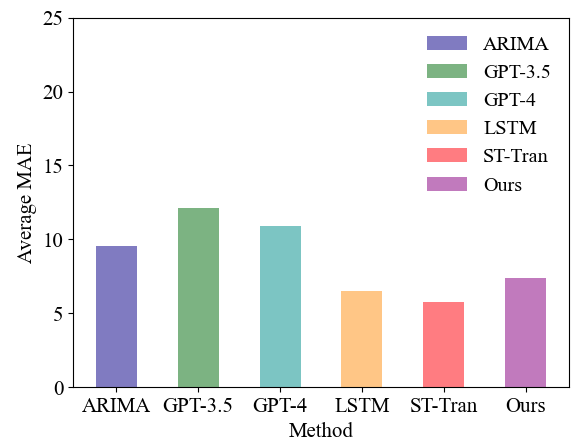

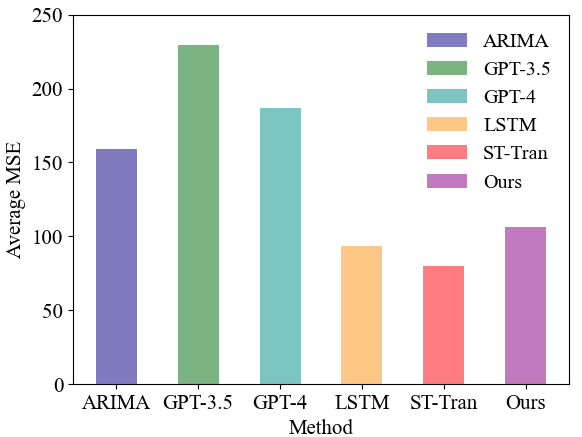

在两个真实数据集上的实验结果表明,TrafficLLM显著优于现有的基于LLM的上下文学习方法。具体来说,TrafficLLM在两个数据集上分别实现了23.17%和17.09%的性能提升。这些结果验证了TrafficLLM在无线流量预测方面的有效性和优越性。

🎯 应用场景

TrafficLLM可应用于各种6G网络场景,例如智能资源分配、网络拥塞控制、服务质量保障等。通过准确预测无线流量,网络运营商可以更有效地管理网络资源,优化网络性能,提升用户体验。该研究为未来无线网络智能化管理提供了新的思路和方法。

📄 摘要(原文)

With a broad range of emerging applications in 6G networks, wireless traffic prediction has become a critical component of network management. However, the dynamically shifting distribution of wireless traffic in non-stationary 6G networks presents significant challenges to achieving accurate and stable predictions. Motivated by recent advancements in Generative AI (GenAI)-enabled 6G networks, this paper proposes a novel self-refined Large Language Model (LLM) for wireless traffic prediction, namely TrafficLLM, through in-context learning without parameter fine-tuning or model training. The proposed TrafficLLM harnesses the powerful few-shot learning abilities of LLMs to enhance the scalability of traffic prediction in dynamically changing wireless environments. Specifically, our proposed TrafficLLM embraces an LLM to iteratively refine its predictions through a three-step process: traffic prediction, feedback generation, and prediction refinement. Initially, the proposed TrafficLLM conducts traffic predictions using task-specific demonstration prompts. Recognizing that LLMs may generate incorrect predictions on the first attempt, this paper designs feedback demonstration prompts to provide multifaceted and valuable feedback related to these initial predictions. The validation scheme is further incorporated to systematically enhance the accuracy of mathematical calculations during the feedback generation process. Following this comprehensive feedback, our proposed TrafficLLM introduces refinement demonstration prompts, enabling the same LLM to further refine its predictions and thereby enhance prediction performance. Evaluations on two realistic datasets demonstrate that the proposed TrafficLLM outperforms LLM-based in-context learning methods, achieving performance improvements of 23.17% and 17.09%, respectively.