Adaptive Safe Reinforcement Learning-Enabled Optimization of Battery Fast-Charging Protocols

作者: Myisha A. Chowdhury, Saif S. S. Al-Wahaibi, Qiugang Lu

分类: eess.SY

发布日期: 2024-06-18

💡 一句话要点

提出一种自适应安全强化学习框架,用于优化电池快速充电协议。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 强化学习 安全强化学习 电池充电 高斯过程 约束优化

📋 核心要点

- 现有强化学习充电策略优化方法难以保证电池安全约束,可能导致电池损坏和寿命缩短。

- 提出自适应安全强化学习框架,通过约束优化将不安全动作投影到安全区域,确保充电过程安全性。

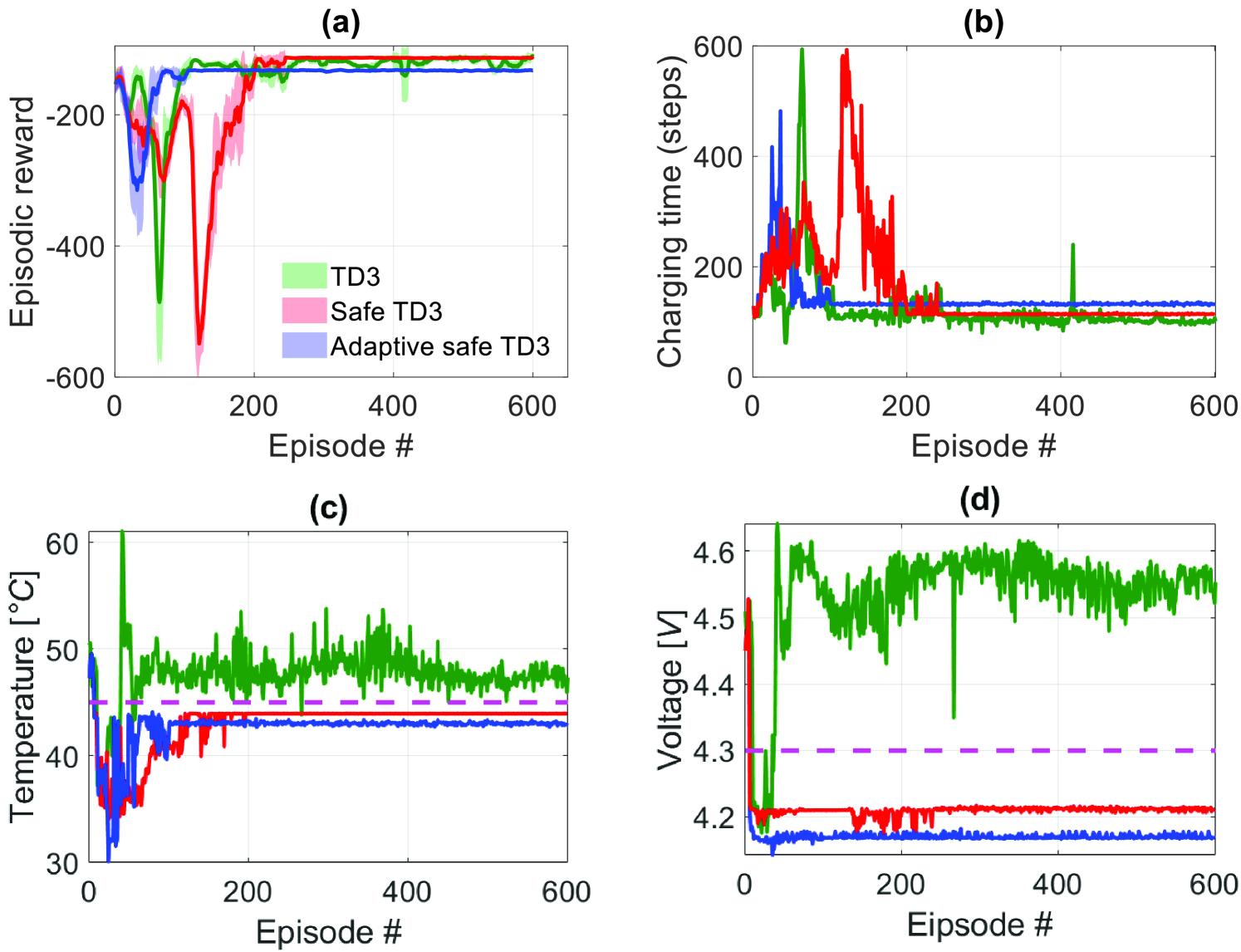

- 实验结果表明,该方法能够在满足约束条件下快速充电,适用于不同运行条件。

📝 摘要(中文)

优化充电协议对于缩短充电时间和减缓电池退化至关重要,尤其是在电动汽车等应用中。近年来,强化学习(RL)方法已被用于此目的。然而,基于RL的方法可能无法保证系统(安全)约束,这可能对电池造成不可逆转的损害并缩短其寿命。为此,本研究提出了一种自适应安全RL框架,以优化快速充电策略,同时以高概率满足安全约束。在该方法中,RL智能体做出的任何不安全动作都将通过解决约束优化问题投影到安全区域。安全区域使用自适应高斯过程(GP)模型构建,该模型由静态和动态GP组成,它们从在线经验中学习,以自适应地适应电池动力学的任何变化。仿真结果表明,该方法可以在满足约束的条件下,在不同的运行条件下快速为电池充电。

🔬 方法详解

问题定义:论文旨在解决电池快速充电过程中,传统强化学习方法难以保证电池安全约束的问题。现有方法容易产生不安全的充电策略,导致电池过热、过充等问题,从而缩短电池寿命甚至造成安全隐患。因此,如何在保证充电速度的同时,确保电池运行在安全区域内是本研究要解决的关键问题。

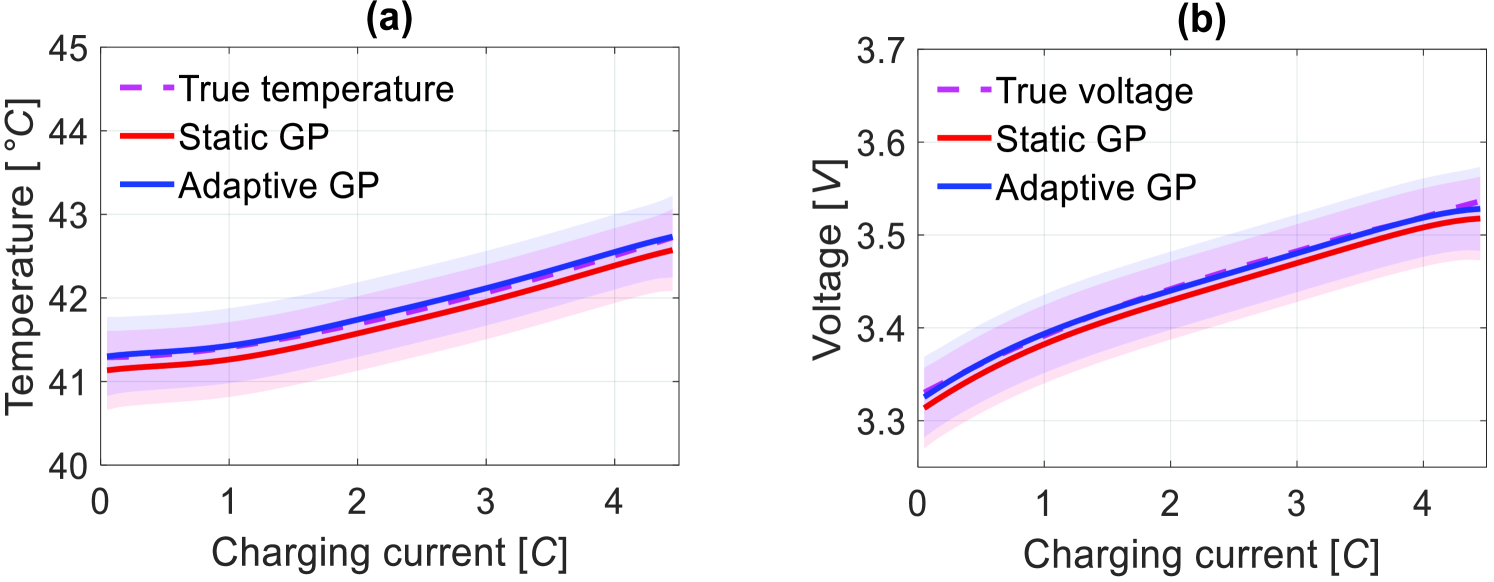

核心思路:论文的核心思路是利用自适应高斯过程(GP)构建安全区域,并将强化学习智能体的不安全动作投影到该区域内。通过在线学习电池动力学变化,自适应调整安全区域的范围,从而保证充电过程的安全性。这种方法结合了强化学习的优化能力和高斯过程的不确定性建模能力,能够在探索充电策略的同时,避免进入危险区域。

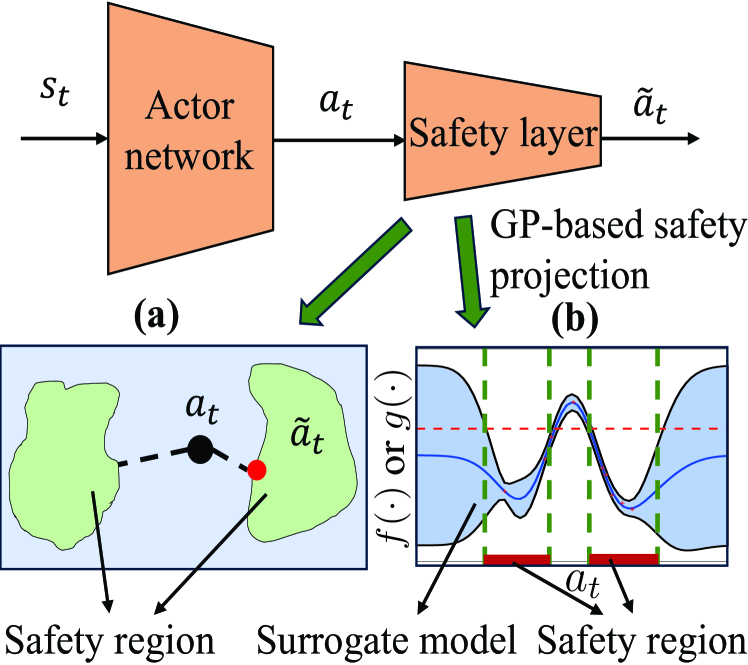

技术框架:整体框架包含以下几个主要模块:1) 强化学习智能体:负责探索和学习最优的充电策略。2) 自适应高斯过程模型:包括静态GP和动态GP,用于建模电池的安全区域。静态GP捕捉电池的长期安全约束,动态GP则适应电池的短期变化。3) 约束优化模块:当强化学习智能体选择的动作超出安全区域时,该模块通过求解约束优化问题,将动作投影到安全区域内。整个流程是,智能体根据当前状态选择动作,如果动作安全,则直接执行;否则,通过约束优化模块进行修正后再执行。

关键创新:论文的关键创新在于提出了自适应安全强化学习框架,该框架能够在线学习电池动力学变化,并自适应地调整安全区域。与传统的安全强化学习方法相比,该方法不需要预先知道电池的精确模型,而是通过在线学习不断提高模型的准确性。此外,静态GP和动态GP的结合,能够更好地捕捉电池的长期和短期变化,从而提高安全区域的可靠性。

关键设计:论文的关键设计包括:1) 使用高斯过程建模安全区域,利用高斯过程的不确定性估计能力,更准确地评估动作的安全性。2) 采用静态GP和动态GP相结合的方式,分别捕捉电池的长期和短期变化。3) 设计约束优化问题,将不安全动作投影到安全区域内,保证充电过程的安全性。具体参数设置和损失函数等细节在论文中未详细描述,属于未知信息。

🖼️ 关键图片

📊 实验亮点

仿真结果表明,该方法能够在满足安全约束的条件下快速为电池充电。具体性能数据和对比基线在摘要中未提及,属于未知信息。但论文强调,该方法在不同的运行条件下均能有效工作,表明其具有较强的鲁棒性和适应性。

🎯 应用场景

该研究成果可广泛应用于电动汽车、储能系统等领域,通过优化电池快速充电协议,缩短充电时间,提高电池寿命,并保障充电过程的安全性。这对于提升电动汽车的实用性和降低使用成本具有重要意义。未来,该方法还可以扩展到其他需要安全约束的强化学习应用中,例如机器人控制、自动驾驶等。

📄 摘要(原文)

Optimizing charging protocols is critical for reducing battery charging time and decelerating battery degradation in applications such as electric vehicles. Recently, reinforcement learning (RL) methods have been adopted for such purposes. However, RL-based methods may not ensure system (safety) constraints, which can cause irreversible damages to batteries and reduce their lifetime. To this end, this work proposes an adaptive and safe RL framework to optimize fast charging strategies while respecting safety constraints with a high probability. In our method, any unsafe action that the RL agent decides will be projected into a safety region by solving a constrained optimization problem. The safety region is constructed using adaptive Gaussian process (GP) models, consisting of static and dynamic GPs, that learn from online experience to adaptively account for any changes in battery dynamics. Simulation results show that our method can charge the batteries rapidly with constraint satisfaction under varying operating conditions.