ST-BiBench: Benchmarking Multi-Stream Multimodal Coordination in Bimanual Embodied Tasks for MLLMs

作者: Xin Wu, Zhixuan Liang, Yue Ma, Mengkang Hu, Zhiyuan Qin, Xiu Li

分类: cs.RO, cs.AI, cs.CV

发布日期: 2026-04-07

💡 一句话要点

ST-BiBench:用于评估MLLM在双臂操作任务中多模态协调能力的基准测试框架

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态融合 具身智能 大型语言模型 基准测试 双臂协调

📋 核心要点

- 现有MLLM在具身智能中面临多流多模态融合的挑战,尤其是在双臂协调任务中,存在感知与逻辑断连的问题。

- ST-BiBench通过战略协调规划、基础空间接地和精细动作控制,多层次评估MLLM的时空多模态协调能力。

- 实验结果揭示了MLLM在高层战略推理和精细物理执行之间的“协调悖论”,突出了多模态融合中的瓶颈。

📝 摘要(中文)

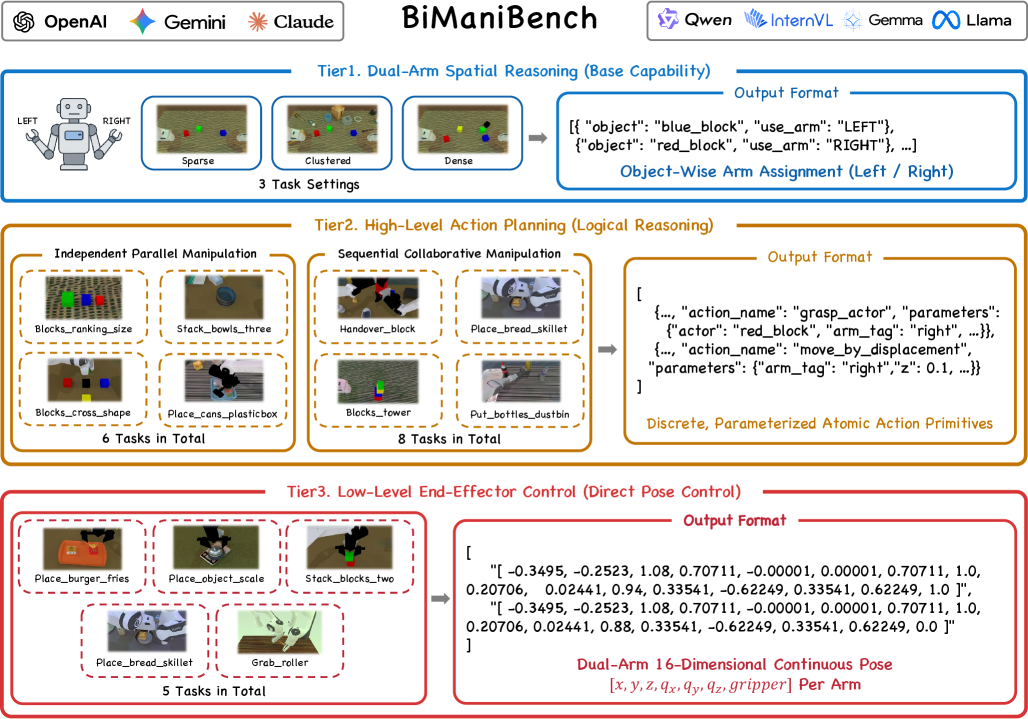

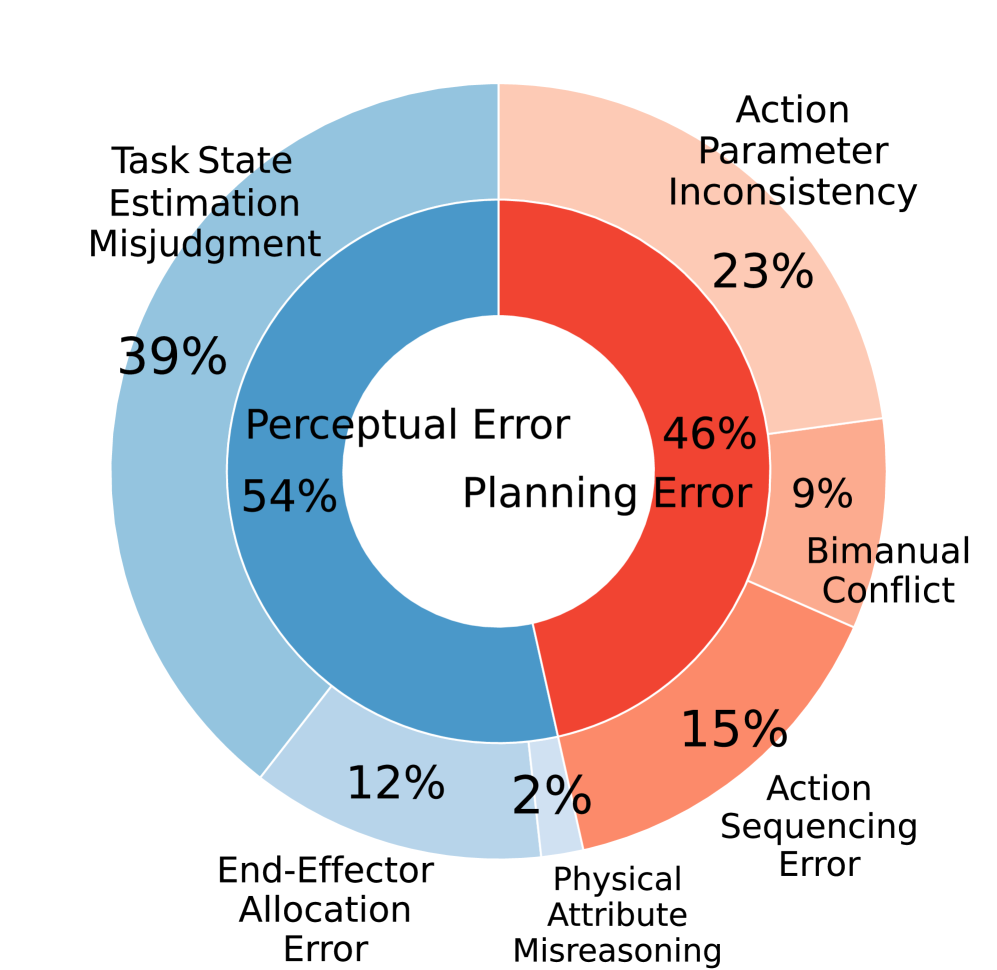

多模态大型语言模型(MLLM)显著推动了具身智能的发展,但过渡到同步双臂协调对多流多模态集成提出了严峻挑战。我们推出了ST-BiBench,这是一个全面的多层框架,用于评估时空多模态协调能力。我们的方法侧重于战略协调规划,评估跨多个动作和感知流的高级跨模态推理。为了研究“邻近悖论”——语义上连贯的计划未能与空间上接地的视觉输入对齐——我们结合了基础空间接地来验证工作空间感知和手臂选择逻辑。此外,我们通过精细动作控制来探索模型前沿,研究MLLM是否可以直接从复杂的多模态元数据中合成高维连续动作模态(16维)。通过评估30多个最先进的MLLM,我们发现了一个持续存在的“协调悖论”——高层战略推理和精细物理执行之间存在显著差距。结果表明,虽然前沿MLLM擅长逻辑驱动的策略,但它们在多模态融合过程中经常遭受感知-逻辑断连和多流干扰。ST-BiBench 为识别复杂具身任务中多流多模态融合和跨模态对齐的关键瓶颈提供了一个平台。

🔬 方法详解

问题定义:论文旨在解决多模态大型语言模型(MLLM)在具身智能任务中,特别是双臂协调任务中,多流多模态信息融合的难题。现有方法难以有效整合来自多个传感器和动作流的信息,导致高层战略规划与底层物理执行脱节,出现“协调悖论”。

核心思路:论文的核心思路是构建一个多层次的基准测试框架ST-BiBench,通过系统性的评估来揭示MLLM在多模态协调方面的不足。该框架从战略协调规划、基础空间接地和精细动作控制三个层面,考察模型在不同粒度上的表现,从而诊断问题所在。

技术框架:ST-BiBench框架包含三个主要模块:1) 战略协调规划:评估模型的高层推理能力,考察其能否根据多模态输入制定合理的行动计划。2) 基础空间接地:验证模型对工作空间的感知能力和手臂选择逻辑,确保计划与实际环境相符。3) 精细动作控制:考察模型能否直接从多模态元数据中生成高维连续动作,实现精确的动作执行。

关键创新:该论文的关键创新在于提出了一个全面的多层次评估框架,能够系统性地分析MLLM在多模态协调方面的能力。与以往的研究相比,ST-BiBench更加关注多流多模态信息的融合,以及高层推理与底层执行之间的衔接。此外,该框架还引入了“邻近悖论”和“协调悖论”等概念,为理解MLLM的局限性提供了新的视角。

关键设计:在战略协调规划层面,设计了复杂的任务场景,需要模型进行跨模态推理和决策。在基础空间接地层面,设计了专门的评估指标,用于衡量模型对工作空间的感知精度和手臂选择的合理性。在精细动作控制层面,采用了高维连续动作空间(16维),以考察模型生成复杂动作的能力。具体参数设置和损失函数等细节在论文中未详细说明,属于未知信息。

🖼️ 关键图片

📊 实验亮点

通过对30多个最先进的MLLM进行评估,ST-BiBench揭示了普遍存在的“协调悖论”,即模型在高层战略推理方面表现出色,但在精细物理执行方面存在显著差距。实验结果表明,现有MLLM在多模态融合过程中容易出现感知-逻辑断连和多流干扰,这为未来的研究指明了方向。具体的性能数据和提升幅度在摘要中未明确给出,属于未知信息。

🎯 应用场景

该研究成果可应用于机器人操作、自动化装配、医疗手术等领域。通过ST-BiBench,研究人员可以更有效地评估和改进MLLM在复杂具身任务中的表现,从而推动智能机器人在实际场景中的应用。未来,该基准测试框架可以扩展到更多类型的任务和模态,为具身智能的发展提供更全面的支持。

📄 摘要(原文)

Multimodal Large Language Models (MLLMs) have significantly advanced the landscape of embodied AI, yet transitioning to synchronized bimanual coordination introduces formidable challenges in multi-stream multimodal integration. We introduce ST-BiBench, a comprehensive multi-tier framework for evaluating spatio-temporal multimodal coordination. Our approach centers on Strategic Coordination Planning, assessing high-level cross-modal reasoning over multiple action and perception streams. To investigate the "proximity paradox"-where semantically coherent plans fail to align with spatially grounded visual inputs-we incorporate Foundational Spatial Grounding to verify workspace awareness and arm-selection logic. Furthermore, we probe model frontiers through Fine-Grained Action Control, investigating whether MLLMs can directly synthesize high-dimensional continuous action modalities (16-Dim) from complex multimodal metadata. Evaluating 30+ state-of-the-art MLLMs, we uncover a persistent and pervasive "coordination paradox"-a significant gap between high-level strategic reasoning and fine-grained physical execution. Results reveal that while frontier MLLMs excel at logic-driven strategy, they frequently suffer from perception-logic disconnection and multi-stream interference during multimodal fusion. ST-BiBench provides a platform for identifying critical bottlenecks in multi-stream multimodal fusion and cross-modal alignment for complex embodied tasks.