Lightweight Learning from Actuation-Space Demonstrations via Flow Matching for Whole-Body Soft Robotic Grasping

作者: Liudi Yang, Yang Bai, Yuhao Wang, Ibrahim Alsarraj, Gitta Kutyniok, Zhanchi Wang, Ke Wu

分类: cs.RO

发布日期: 2026-04-06

💡 一句话要点

提出基于流匹配的轻量级驱动空间学习方法,用于软体机器人全身抓取

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 软体机器人 机器人抓取 流匹配 驱动空间学习 具身智能

📋 核心要点

- 传统刚性机器人手在不确定环境中抓取时,依赖复杂模型和重反馈控制,难以适应。

- 论文提出一种轻量级驱动空间学习框架,利用软体机器人的被动柔性,直接从演示中学习控制策略。

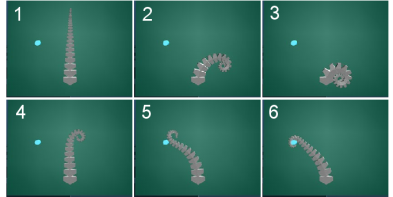

- 实验表明,该方法仅需少量演示即可实现高成功率,并能推广到不同尺寸物体和动态响应。

📝 摘要(中文)

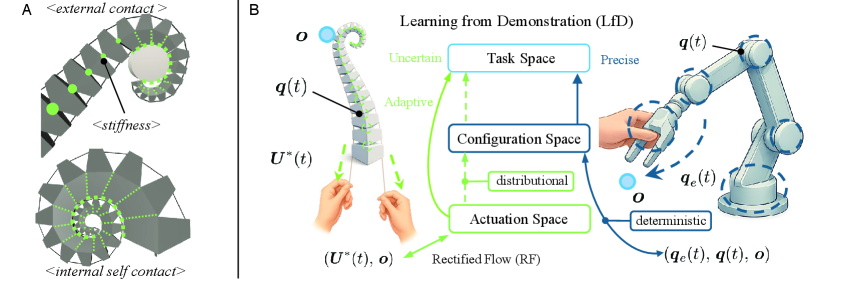

由于其不确定性和丰富的接触特性,不确定性下的机器人抓取仍然是一个根本性的挑战。传统的刚性机器人手自由度和柔顺性有限,依赖于复杂的基于模型的重型反馈控制器来管理这些交互。相比之下,软体机器人表现出具身机械智能:其欠驱动结构和全身的被动灵活性,自然地适应不确定的接触,并实现自适应行为。为了利用这种能力,我们提出了一种轻量级的驱动空间学习框架,该框架使用流匹配模型(Rectified Flow)直接从确定性演示中推断出用于全身软体机器人抓取的分布控制表示,而无需密集的传感或重型控制回路。仅使用30个演示(不到可达工作空间的8%),学习到的策略在整个工作空间中实现了97.5%的抓取成功率,推广到+-33%的被抓取物体尺寸变化,并在通过将执行时间从20%缩放到200%直接调整机器人的动态响应时保持稳定的性能。这些结果表明,驱动空间学习通过利用其被动的冗余自由度和灵活性,将身体的力学转化为功能控制智能,并大大减轻了这种不确定性丰富的任务的中央控制器的负担。

🔬 方法详解

问题定义:论文旨在解决软体机器人全身抓取中,如何在不确定环境下,利用少量演示数据学习高效控制策略的问题。现有方法通常依赖于复杂的模型或大量的传感器数据,计算成本高,泛化能力有限,难以充分利用软体机器人本身的柔性和冗余自由度。

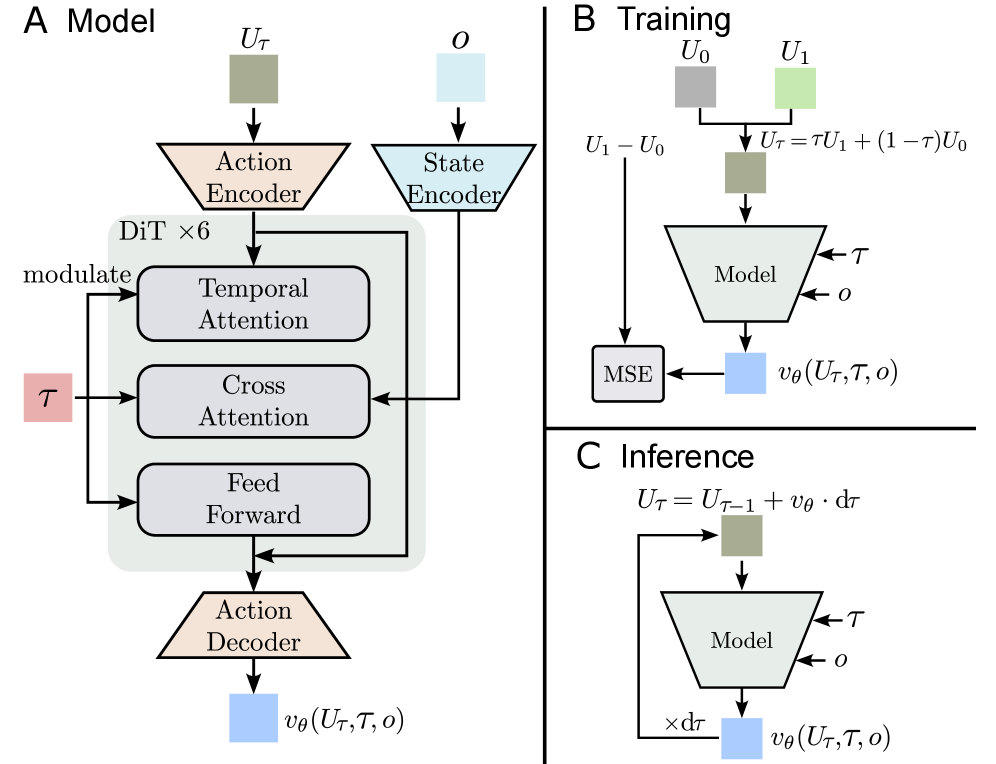

核心思路:论文的核心思路是直接在驱动空间中学习控制策略,利用流匹配模型(Rectified Flow)将确定性演示转化为分布式的控制表示。通过学习从初始状态到目标状态的连续变换,模型能够捕捉到软体机器人的内在动力学特性,从而实现鲁棒的抓取控制。这种方法避免了对复杂环境和机器人模型的精确建模,降低了学习难度。

技术框架:该框架主要包含数据收集和策略学习两个阶段。首先,通过人工或其它方式提供少量(例如30个)确定性的抓取演示数据,这些数据记录了机器人的驱动信号。然后,利用流匹配模型(Rectified Flow)学习从初始驱动状态到目标驱动状态的连续映射。在推理阶段,模型可以根据当前状态生成一系列控制信号,驱动软体机器人完成抓取任务。

关键创新:该方法最重要的创新点在于利用流匹配模型直接在驱动空间中学习控制策略,避免了对复杂环境和机器人模型的建模。通过学习连续的驱动空间变换,模型能够捕捉到软体机器人的内在动力学特性,从而实现鲁棒的抓取控制。此外,该方法仅需少量演示数据即可实现良好的性能,大大降低了学习成本。

关键设计:论文使用了Rectified Flow作为流匹配模型,该模型通过学习一个时间相关的向量场,将初始分布连续地变换到目标分布。损失函数采用标准的流匹配损失,用于优化向量场。实验中,作者使用了特定的软体机器人手爪,并调整了执行时间等参数来评估策略的鲁棒性。

🖼️ 关键图片

📊 实验亮点

实验结果表明,仅使用30个演示数据,该方法在整个工作空间中实现了97.5%的抓取成功率。此外,该方法还能够推广到±33%的被抓取物体尺寸变化,并在执行时间缩放20%-200%的情况下保持稳定的性能。这些结果表明,该方法具有良好的泛化能力和鲁棒性。

🎯 应用场景

该研究成果可应用于各种复杂环境下的软体机器人抓取任务,例如医疗康复、食品加工、以及在狭小或不规则空间内的操作。该方法降低了对环境建模和传感器数据的依赖,使得软体机器人能够更灵活、更鲁棒地完成任务,具有重要的实际应用价值和潜力。

📄 摘要(原文)

Robotic grasping under uncertainty remains a fundamental challenge due to its uncertain and contact-rich nature. Traditional rigid robotic hands, with limited degrees of freedom and compliance, rely on complex model-based and heavy feedback controllers to manage such interactions. Soft robots, by contrast, exhibit embodied mechanical intelligence: their underactuated structures and passive flexibility of their whole body, naturally accommodate uncertain contacts and enable adaptive behaviors. To harness this capability, we propose a lightweight actuation-space learning framework that infers distributional control representations for whole-body soft robotic grasping, directly from deterministic demonstrations using a flow matching model (Rectified Flow),without requiring dense sensing or heavy control loops. Using only 30 demonstrations (less than 8% of the reachable workspace), the learned policy achieves a 97.5% grasp success rate across the whole workspace, generalizes to grasped-object size variations of +-33%, and maintains stable performance when the robot's dynamic response is directly adjusted by scaling the execution time from 20% to 200%. These results demonstrate that actuation-space learning, by leveraging its passive redundant DOFs and flexibility, converts the body's mechanics into functional control intelligence and substantially reduces the burden on central controllers for this uncertain-rich task.