Posterior Optimization with Clipped Objective for Bridging Efficiency and Stability in Generative Policy Learning

作者: Yuhui Chen, Haoran Li, Zhennan Jiang, Yuxing Qin, Yuxuan Wan, Weiheng Liu, Dongbin Zhao

分类: cs.RO

发布日期: 2026-04-02

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

POCO:通过裁剪目标函数的后验优化,提升生成策略学习的效率与稳定性

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 生成策略学习 后验优化 强化学习 机器人操作 离线到在线学习

📋 核心要点

- 现有强化学习微调生成策略时,存在不稳定和样本效率低下的问题,阻碍了其在机器人操作中的应用。

- POCO通过后验推理将策略改进建模为奖励加权的隐式后验提炼,避免了直接的似然估计,提升了学习的稳定性。

- POCO采用离线到在线的范式,并具有模型无关的设计,在模拟和真实机器人任务中均表现出优越的性能。

📝 摘要(中文)

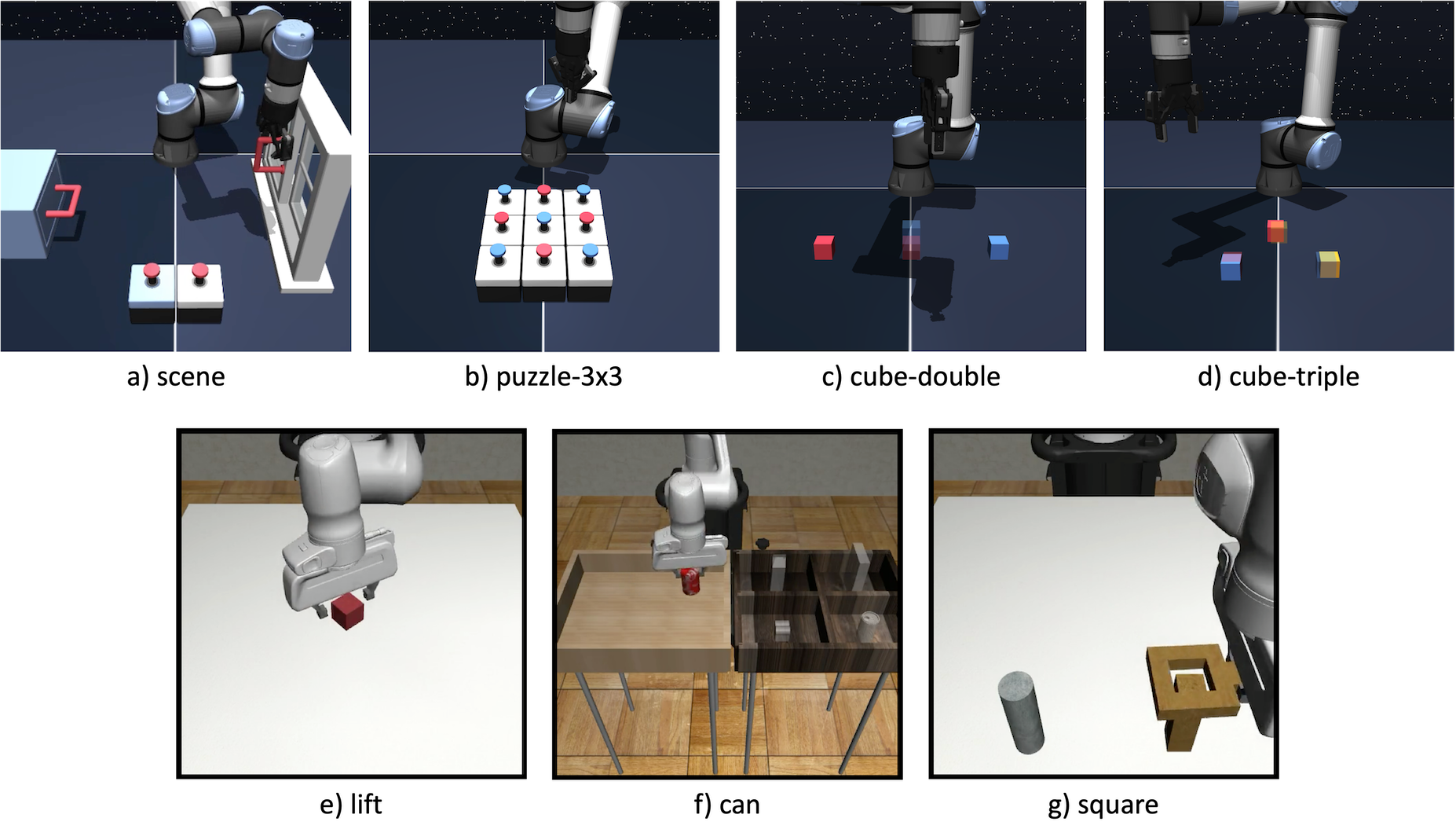

富有表现力的生成模型通过捕获时间扩展轨迹上复杂的多模态动作分布,推动了机器人操作的发展。然而,由于不稳定性和样本效率低下,通过强化学习对这些策略进行微调仍然具有挑战性。我们引入了具有裁剪目标函数的后验优化(POCO),这是一个原则性的强化学习框架,它将策略改进形式化为针对时间动作块量身定制的后验推理问题。通过期望最大化过程,POCO将奖励加权的隐式后验提炼到策略中,而无需似然估计。此外,POCO采用离线到在线的范式,将在线探索锚定到预训练的先验,其模型无关的设计可以扩展到微调大型VLA模型,而无需架构修改。在7个模拟基准测试和4个富接触的真实世界任务中的评估表明,POCO可以防止灾难性的策略崩溃,优于SOTA基线,并在真实世界任务中实现了96.7%的成功率。

🔬 方法详解

问题定义:现有方法在利用强化学习微调生成策略时,面临着策略崩溃和样本效率低下的问题。这是因为直接优化策略的似然函数容易受到奖励噪声的影响,导致策略快速退化,尤其是在探索空间较大的复杂任务中。

核心思路:POCO的核心思想是将策略改进视为一个后验推理问题,目标是找到一个能够最大化期望奖励的策略分布。与直接优化策略的似然函数不同,POCO通过期望最大化(EM)算法,迭代地将一个隐式的奖励加权后验分布提炼到策略中。这种方法避免了直接的似然估计,从而提高了学习的稳定性和样本效率。

技术框架:POCO的整体框架包含两个主要阶段:离线预训练和在线微调。在离线预训练阶段,使用行为克隆等方法训练一个初始策略,作为在线微调的先验。在在线微调阶段,POCO使用EM算法迭代地更新策略。E步骤计算奖励加权的后验分布,M步骤将后验分布提炼到策略中。为了进一步提高稳定性,POCO还引入了裁剪目标函数,限制了策略更新的幅度。

关键创新:POCO的关键创新在于将策略改进建模为后验推理问题,并使用EM算法进行优化。这种方法避免了直接的似然估计,从而提高了学习的稳定性和样本效率。此外,POCO的离线到在线范式和模型无关的设计使其能够有效地微调大型VLA模型,而无需架构修改。

关键设计:POCO的关键设计包括:1) 使用时间动作块作为基本单元,进行后验推理;2) 采用裁剪目标函数,限制策略更新的幅度,防止策略崩溃;3) 使用KL散度作为正则化项,鼓励策略接近预训练的先验;4) 使用Adam优化器更新策略参数。

🖼️ 关键图片

📊 实验亮点

POCO在7个模拟基准测试和4个真实世界任务中均取得了显著的性能提升。在真实世界任务中,POCO实现了96.7%的成功率,显著优于SOTA基线方法。实验结果表明,POCO能够有效地防止灾难性的策略崩溃,并提高样本效率。

🎯 应用场景

POCO具有广泛的应用前景,可以应用于各种机器人操作任务,例如抓取、装配、导航等。尤其适用于需要复杂动作序列和多模态动作分布的任务。该方法能够提升机器人策略学习的稳定性和效率,降低对样本数据的需求,加速机器人在实际场景中的部署。

📄 摘要(原文)

Expressive generative models have advanced robotic manipulation by capturing complex, multi-modal action distributions over temporally extended trajectories. However, fine-tuning these policies via RL remains challenging due to instability and sample inefficiency. We introduce Posterior Optimization with Clipped Objective (POCO), a principled RL framework that formulates policy improvement as a posterior inference problem tailored for temporal action chunks. Through an Expectation-Maximization procedure, POCO distills a reward-weighted implicit posterior into the policy without likelihood estimation. Furthermore, POCO adopts an offline-to-online paradigm that anchors online exploration to pre-trained priors, and its model-agnostic design scales to fine-tune large VLA models without architectural modifications. Evaluations across 7 simulation benchmarks and 4 contact-rich real-world tasks demonstrate that POCO prevents catastrophic policy collapse, outperforms SOTA baselines, and achieves a 96.7% success rate on real-world tasks. Videos are available at our project website https://cccedric.github.io/poco/.