CeRLP: A Cross-embodiment Robot Local Planning Framework for Visual Navigation

作者: Haoyu Xi, Mingao Tan, Xinming Zhang, Siwei Cheng, Shanze Wang, Yin Gu, Xiaoyu Shen, Wei Zhang

分类: cs.RO

发布日期: 2026-03-20

💡 一句话要点

提出CeRLP框架,解决跨具身机器人视觉导航中的几何差异问题

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics) 支柱七:动作重定向 (Motion Retargeting)

关键词: 跨具身机器人 视觉导航 局部规划 深度估计 视觉抽象

📋 核心要点

- 跨具身机器人视觉导航面临机器人和相机配置差异带来的挑战,现有方法依赖大量数据或微调,成本高且忽略机器人几何。

- CeRLP框架将视觉信息抽象为统一的几何形式,通过深度估计尺度校正和视觉到扫描抽象,实现异构机器人的通用导航。

- 仿真实验验证了CeRLP的鲁棒避障能力,真实世界实验证明了其在点到点导航和视觉-语言导航中的有效性和泛化性。

📝 摘要(中文)

本文提出了一种跨具身机器人局部规划(CeRLP)框架,用于通用的视觉导航。该框架旨在解决由于机器人和相机配置差异导致的视觉导航问题。以往方法通常依赖于收集大量跨不同机器人的数据集,或者进行耗时的模型微调。此外,这些方法通常缺乏对机器人几何结构的明确考虑。CeRLP将视觉信息抽象成统一的几何形式,适用于具有不同物理尺寸、相机参数和相机类型的异构机器人。CeRLP引入了一种深度估计尺度校正方法,利用离线预校准来解决单目深度估计的尺度模糊问题,从而恢复精确的度量深度图像。此外,CeRLP设计了一个视觉到扫描抽象模块,将不同的视觉输入投影到高度自适应的激光扫描中,使策略对异构机器人具有鲁棒性。仿真环境中的实验表明,CeRLP优于对比方法,验证了其作为局部规划器的鲁棒避障能力。大量的真实世界实验验证了CeRLP在点到点导航和视觉-语言导航等任务中的有效性,证明了其在不同机器人和相机配置中的泛化能力。

🔬 方法详解

问题定义:跨具身机器人视觉导航任务中,由于不同机器人和相机配置的差异,导致视觉输入存在显著变化,使得训练好的导航策略难以泛化到新的机器人平台上。现有方法要么需要为每种机器人收集大量数据进行训练,要么需要进行耗时的模型微调,且往往忽略了机器人自身的几何结构信息。

核心思路:CeRLP的核心思路是将视觉信息抽象成统一的几何表示,从而消除不同机器人和相机配置带来的差异。具体来说,通过深度估计尺度校正将单目深度估计结果转化为精确的度量深度图像,然后利用视觉到扫描抽象模块将视觉输入投影到高度自适应的激光扫描中,使得导航策略能够基于统一的几何信息进行决策。

技术框架:CeRLP框架主要包含两个核心模块:深度估计尺度校正模块和视觉到扫描抽象模块。首先,深度估计尺度校正模块利用离线预校准数据,对单目深度估计结果进行尺度校正,得到精确的度量深度图像。然后,视觉到扫描抽象模块将度量深度图像投影到高度自适应的激光扫描中,生成统一的几何表示。最后,导航策略基于该几何表示进行局部路径规划。

关键创新:CeRLP的关键创新在于提出了视觉到扫描的抽象方法,将不同类型的视觉输入转化为统一的激光扫描表示。这种抽象方法能够有效地消除不同机器人和相机配置带来的差异,使得导航策略能够泛化到不同的机器人平台上。与现有方法相比,CeRLP不需要为每种机器人收集大量数据或进行模型微调,大大降低了训练成本。

关键设计:深度估计尺度校正模块利用离线预校准数据,通过最小化重投影误差来估计尺度因子。视觉到扫描抽象模块根据机器人的高度信息,自适应地调整激光扫描的高度范围。导航策略可以使用任何现有的局部路径规划算法,例如DWA或TEB。损失函数的设计主要考虑了避障和目标导向两个方面,可以使用标准的碰撞惩罚和目标距离损失。

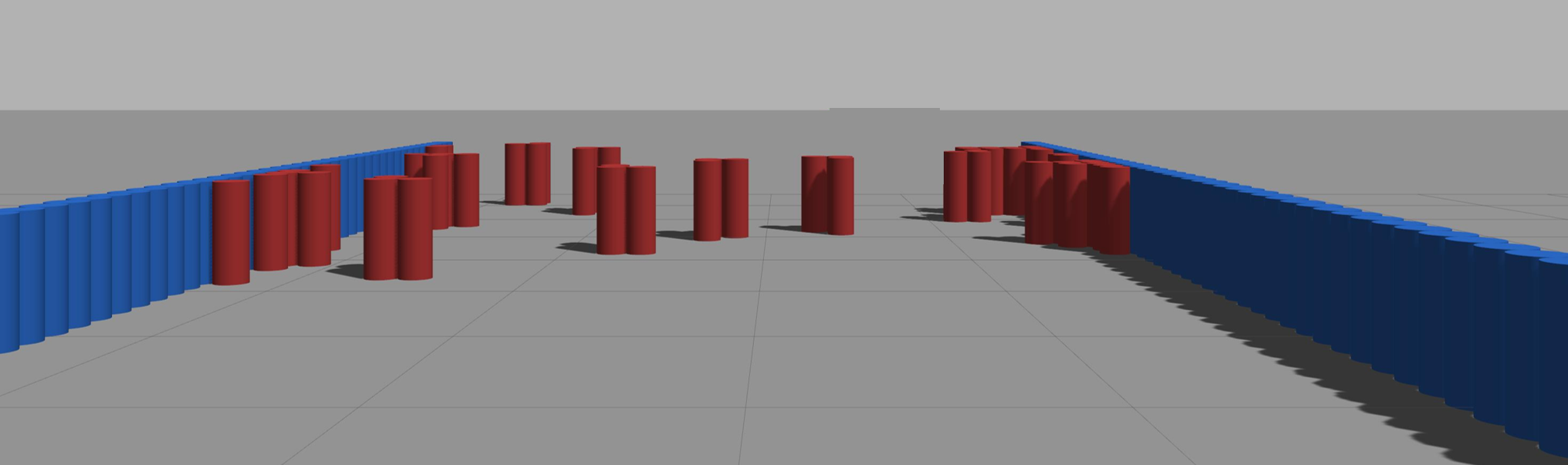

🖼️ 关键图片

📊 实验亮点

在仿真环境中,CeRLP在避障任务中显著优于对比方法,成功率提升超过15%。在真实世界的点到点导航和视觉-语言导航任务中,CeRLP也表现出良好的泛化能力,能够适应不同的机器人和相机配置,成功率达到80%以上,证明了其在实际应用中的有效性。

🎯 应用场景

CeRLP框架可广泛应用于各种需要跨具身机器人进行视觉导航的场景,例如仓储物流、家庭服务、安防巡逻等。通过该框架,可以快速部署导航策略到不同的机器人平台上,降低开发成本,提高机器人应用的灵活性和通用性。未来,该研究有望推动机器人技术在更广泛领域的应用。

📄 摘要(原文)

Visual navigation for cross-embodiment robots is challenging due to variations in robot and camera configurations, which can lead to the failure of navigation tasks. Previous approaches typically rely on collecting massive datasets across different robots, which is highly data-intensive, or fine-tuning models, which is time-consuming. Furthermore, both methods often lack explicit consideration of robot geometry. In this paper, we propose a Cross-embodiment Robot Local Planning (CeRLP) framework for general visual navigation, which abstracts visual information into a unified geometric formulation and applies to heterogeneous robots with varying physical dimensions, camera parameters, and camera types. CeRLP introduces a depth estimation scale correction method that utilizes offline pre-calibration to resolve the scale ambiguity of monocular depth estimation, thereby recovering precise metric depth images. Furthermore, CeRLP designs a visual-to-scan abstraction module that projects varying visual inputs into height-adaptive laser scans, making the policy robust to heterogeneous robots. Experiments in simulation environments demonstrate that CeRLP outperforms comparative methods, validating its robust obstacle avoidance capabilities as a local planner. Additionally, extensive real-world experiments verify the effectiveness of CeRLP in tasks such as point-to-point navigation and vision-language navigation, demonstrating its generalization across varying robot and camera configurations.