CoViLLM: An Adaptive Human-Robot Collaborative Assembly Framework Using Large Language Models for Manufacturing

作者: Jiabao Zhao, Jonghan Lim, Hongliang Li, Ilya Kovalenko

分类: cs.RO

发布日期: 2026-03-12

备注: 7 pages, 7 figures. Accepted to ASME MSEC 2026

💡 一句话要点

提出CoViLLM框架以解决定制化产品组装的灵活性问题

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 人机协作 自适应框架 大型语言模型 定制化生产 智能制造

📋 核心要点

- 现有的人机协作框架依赖于预定义的感知-操作流程,缺乏处理新产品组装的灵活性。

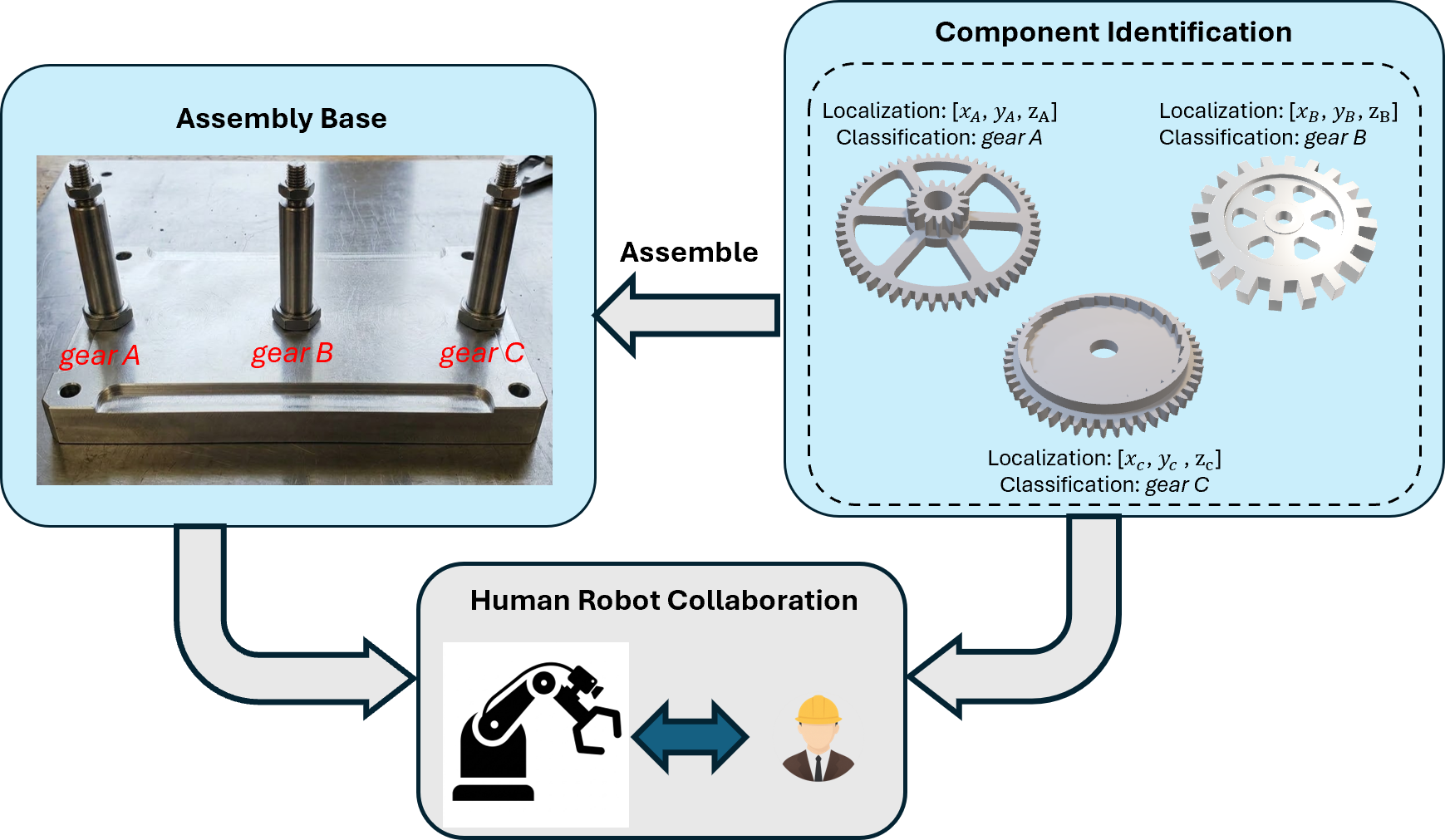

- CoViLLM框架结合深度摄像头定位、人类操作员分类和大型语言模型,实现自适应组装任务规划。

- 实验结果表明,CoViLLM在已知、定制和新产品案例中均表现出显著的灵活性和适应性提升。

📝 摘要(中文)

随着对大规模定制的需求增加,传统的基于规则的制造机器人缺乏适应性,无法处理定制或新产品变体。人机协作(HRC)通过利用人类的灵活性和决策能力,展示了提高系统适应性的潜力。然而,现有的HRC框架通常依赖于预定义的感知-操作流程,限制了其自主生成新产品组装任务计划的能力。本文提出了CoViLLM,一个自适应的人机协作组装框架,支持定制和之前未见过的产品组装。CoViLLM结合了基于深度摄像头的定位、用于识别新组件的人类操作员分类,以及基于自然语言指令的组装任务规划的大型语言模型(LLM)。该框架在NIST组装任务板上进行了验证,实验结果表明,该框架通过扩展HRC超越预定义的产品和任务设置,实现了灵活的协作组装。

🔬 方法详解

问题定义:本文旨在解决传统制造机器人在面对定制化和新产品变体时的灵活性不足问题。现有方法通常依赖于固定的规则和流程,无法适应快速变化的生产需求。

核心思路:CoViLLM框架通过结合深度摄像头进行物体定位、人类操作员分类和大型语言模型进行任务规划,提供了一种自适应的解决方案。这种设计能够有效利用人类的灵活性和机器人的执行能力。

技术框架:该框架的整体架构包括三个主要模块:1) 基于深度摄像头的物体定位模块,用于估计组件位置;2) 人类操作员分类模块,用于识别新组件;3) 大型语言模型模块,用于根据自然语言指令生成组装任务计划。

关键创新:CoViLLM的主要创新在于其能够自主生成针对新产品的组装任务计划,突破了传统HRC框架的限制。这使得系统能够灵活应对多样化的生产需求。

关键设计:在技术细节方面,框架使用深度摄像头进行高精度定位,采用特定的分类算法进行操作员识别,并利用大型语言模型进行自然语言处理和任务规划,确保了系统的高效性和准确性。

🖼️ 关键图片

📊 实验亮点

实验结果显示,CoViLLM框架在已知、定制和新产品案例中均表现出优异的性能,成功实现了灵活的协作组装。与传统方法相比,系统在任务规划的准确性和适应性上有显著提升,具体性能数据尚未披露。

🎯 应用场景

该研究的潜在应用领域包括智能制造、定制化生产线和人机协作工作环境。通过提高机器人在复杂任务中的适应能力,CoViLLM能够显著提升生产效率和灵活性,满足不断变化的市场需求。未来,该框架可能在更广泛的工业应用中发挥重要作用。

📄 摘要(原文)

With increasing demand for mass customization, traditional manufacturing robots that rely on rule-based operations lack the flexibility to accommodate customized or new product variants. Human-Robot Collaboration (HRC) has demonstrated potential to improve system adaptability by leveraging human versatility and decision-making capabilities. However, existing HRC frame- works typically depend on predefined perception-manipulation pipelines, limiting their ability to autonomously generate task plans for new product assembly. In this work, we propose CoViLLM, an adaptive human-robot collaborative assembly frame- work that supports the assembly of customized and previously unseen products. CoViLLM combines depth-camera-based localization for object position estimation, human operator classification for identifying new components, and an Large Language Model (LLM) for assembly task planning based on natural language instructions. The framework is validated on the NIST Assembly Task Board for known, customized, and new product cases. Experimental results show that the proposed framework enables flexible collaborative assembly by extending HRC beyond predefined product and task settings.