A Pragmatic VLA Foundation Model

作者: Wei Wu, Fan Lu, Yunnan Wang, Shuai Yang, Shi Liu, Fangjing Wang, Qian Zhu, He Sun, Yong Wang, Shuailei Ma, Yiyu Ren, Kejia Zhang, Hui Yu, Jingmei Zhao, Shuai Zhou, Zhenqi Qiu, Houlong Xiong, Ziyu Wang, Zechen Wang, Ran Cheng, Yong-Lu Li, Yongtao Huang, Xing Zhu, Yujun Shen, Kecheng Zheng

分类: cs.RO, cs.CV

发布日期: 2026-02-28

💡 一句话要点

LingBot-VLA:基于2万小时真实机器人数据的实用视觉-语言-动作基础模型

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 视觉-语言-动作模型 机器人学习 基础模型 泛化能力 真实世界数据 双臂机器人 高效训练

📋 核心要点

- 现有VLA模型在任务和平台泛化性方面存在不足,且数据和计算成本高昂,限制了实际应用。

- LingBot-VLA利用大规模真实世界机器人数据进行训练,旨在提升模型在不同任务和平台上的泛化能力。

- 实验结果表明,LingBot-VLA在多个机器人平台上表现出卓越的性能和泛化能力,并具有更高的训练效率。

📝 摘要(中文)

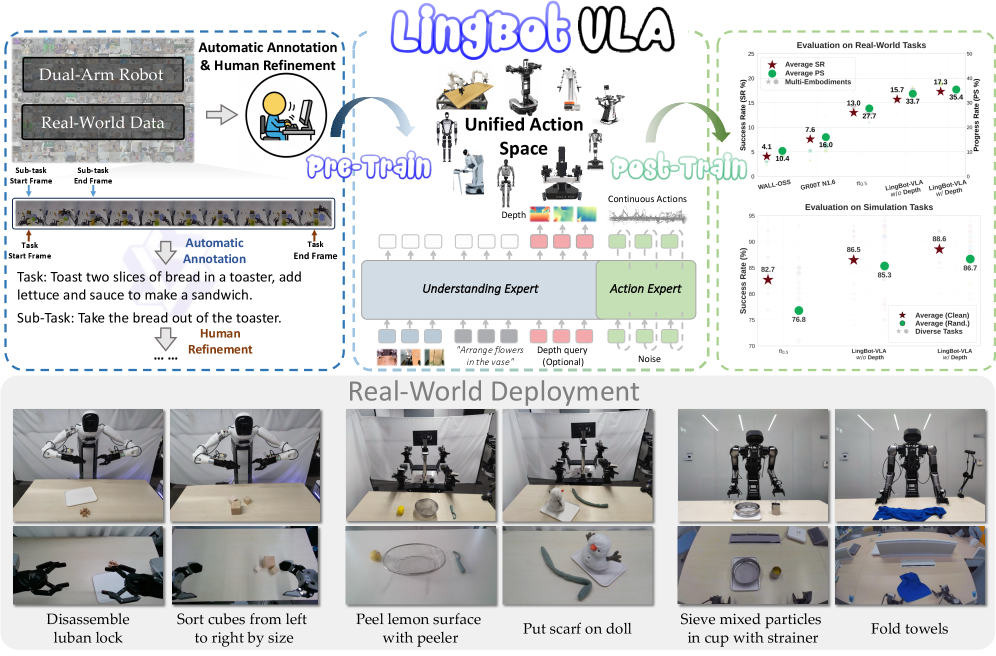

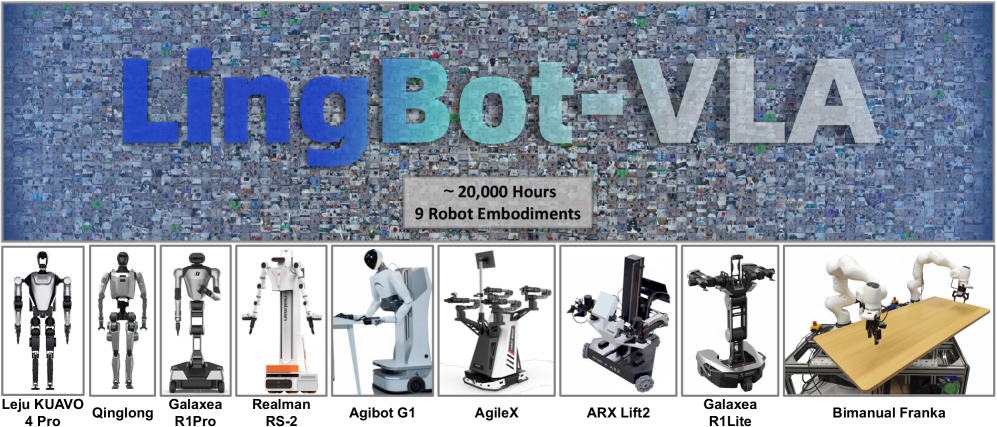

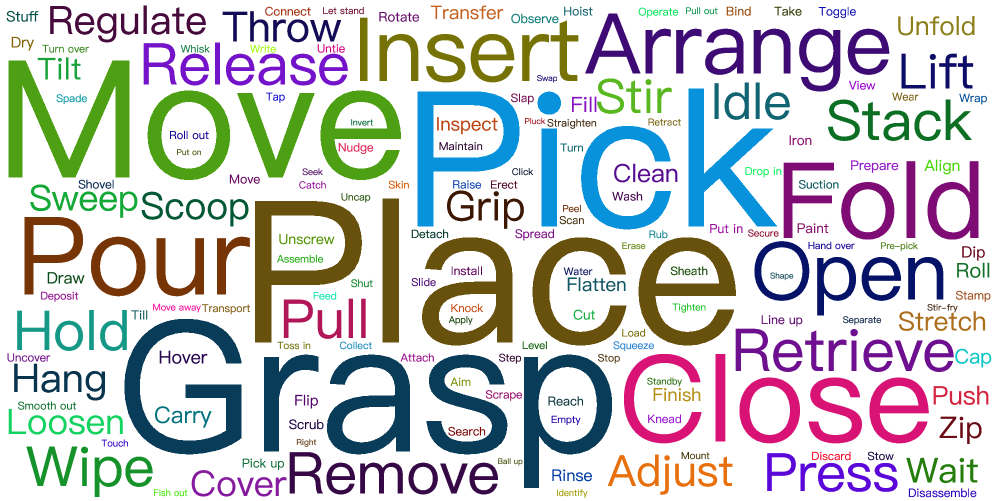

本文提出了一种实用的视觉-语言-动作(VLA)基础模型LingBot-VLA,旨在提升机器人操作的泛化能力和成本效益。该模型利用来自9种常见双臂机器人配置的约20,000小时真实世界数据进行训练。在三个机器人平台上进行的系统评估表明,LingBot-VLA在100个任务中,每个任务经过130次后训练episode后,明显优于竞争对手,展示了其强大的性能和广泛的泛化能力。此外,该论文还构建了一个高效的代码库,在8-GPU训练设置下,吞吐量达到每秒261个样本,比现有的VLA代码库快1.5~2.8倍(取决于所依赖的VLM基础模型)。该模型及其代码、基础模型和基准数据均已开源,以促进机器人学习领域的发展,并鼓励更具挑战性的任务和健全的评估标准。

🔬 方法详解

问题定义:现有视觉-语言-动作(VLA)模型在机器人操作领域面临泛化性差和成本高的问题。具体来说,这些模型难以在不同的机器人平台和任务之间进行有效迁移,并且需要大量的训练数据和计算资源才能达到可接受的性能。这限制了它们在实际机器人应用中的部署。

核心思路:本文的核心思路是利用大规模的真实世界机器人数据来训练一个通用的VLA基础模型。通过让模型接触到各种不同的机器人配置和操作场景,可以提高其泛化能力,使其能够更好地适应新的任务和平台。此外,通过优化训练流程和代码库,可以降低训练成本,提高模型的实用性。

技术框架:LingBot-VLA的整体框架包括数据收集、模型训练和评估三个主要阶段。首先,从9种不同的双臂机器人配置中收集了约20,000小时的真实世界数据。然后,利用这些数据训练VLA模型。最后,在三个不同的机器人平台上对模型进行评估,每个平台完成100个任务,每个任务进行130次后训练episode。

关键创新:该论文的关键创新在于构建了一个大规模的真实世界机器人数据集,并利用该数据集训练了一个具有强大泛化能力的VLA基础模型。此外,该论文还开发了一个高效的代码库,可以显著提高VLA模型的训练速度。

关键设计:LingBot-VLA的具体网络结构和损失函数细节未在摘要中明确说明,属于未知信息。但摘要强调了数据规模(20,000小时)和训练效率(8-GPU,261 samples/second)的重要性。代码库的优化是提高训练效率的关键设计。

🖼️ 关键图片

📊 实验亮点

LingBot-VLA在三个机器人平台上进行了系统评估,每个平台完成100个任务,每个任务进行130次后训练episode。实验结果表明,LingBot-VLA明显优于竞争对手,展示了其强大的性能和广泛的泛化能力。此外,该论文还构建了一个高效的代码库,在8-GPU训练设置下,吞吐量达到每秒261个样本,比现有的VLA代码库快1.5~2.8倍。

🎯 应用场景

该研究成果可广泛应用于各种机器人操作任务,例如工业自动化、家庭服务、医疗辅助等。通过利用LingBot-VLA,可以降低机器人部署和维护的成本,提高机器人的智能化水平,使其能够更好地适应复杂和动态的环境。未来,该模型有望成为机器人领域的基础设施,促进机器人技术的进一步发展。

📄 摘要(原文)

Offering great potential in robotic manipulation, a capable Vision-Language-Action (VLA) foundation model is expected to faithfully generalize across tasks and platforms while ensuring cost efficiency (e.g., data and GPU hours required for adaptation). To this end, we develop LingBot-VLA with around 20,000 hours of real-world data from 9 popular dual-arm robot configurations. Through a systematic assessment on 3 robotic platforms, each completing 100 tasks with 130 post-training episodes per task, our model achieves clear superiority over competitors, showcasing its strong performance and broad generalizability. We have also built an efficient codebase, which delivers a throughput of 261 samples per second with an 8-GPU training setup, representing a 1.5~2.8$\times$ (depending on the relied VLM base model) speedup over existing VLA-oriented codebases. The above features ensure that our model is well-suited for real-world deployment. To advance the field of robot learning, we provide open access to the code, base model, and benchmark data, with a focus on enabling more challenging tasks and promoting sound evaluation standards.