World Guidance: World Modeling in Condition Space for Action Generation

作者: Yue Su, Sijin Chen, Haixin Shi, Mingyu Liu, Zhengshen Zhang, Ningyuan Huang, Weiheng Zhong, Zhengbang Zhu, Yuxiao Liu, Xihui Liu

分类: cs.RO, cs.CV

发布日期: 2026-02-25

备注: Project Page: https://selen-suyue.github.io/WoGNet/

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

提出WoG,通过条件空间中的世界建模提升视觉-语言-动作模型的动作生成能力

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 视觉-语言-动作模型 世界建模 条件空间 动作生成 未来预测

📋 核心要点

- 现有方法难以在高效、可预测的未来表征和指导精确动作生成的细粒度信息之间取得平衡。

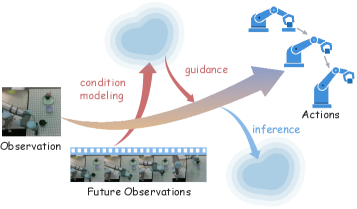

- WoG框架将未来观测映射到紧凑的条件空间,并将其注入动作推理流程,实现条件空间中的世界建模。

- 实验表明,WoG不仅促进了细粒度动作生成,还展现出更强的泛化能力,并在模拟和真实环境中优于现有方法。

📝 摘要(中文)

本文提出了一种名为WoG(World Guidance)的框架,旨在通过将未来观测映射到紧凑的条件空间,并将其注入到动作推理流程中,来提升视觉-语言-动作(VLA)模型的性能。该框架训练VLA模型同时预测这些压缩的条件和未来的动作,从而在条件空间中实现有效的世界建模,以指导动作推理。实验结果表明,建模和预测条件空间不仅有助于细粒度的动作生成,还展现出卓越的泛化能力,并能有效地从大量人类操作视频中学习。在模拟和真实环境中的大量实验验证了该方法显著优于现有的基于未来预测的方法。

🔬 方法详解

问题定义:现有的视觉-语言-动作(VLA)模型在利用未来观测信息辅助动作生成时,面临着如何在维持高效、可预测的未来表征的同时,保留足够细粒度的信息以指导精确动作生成的问题。现有方法往往难以在这两者之间取得平衡,导致动作生成不够精细或泛化能力不足。

核心思路:WoG的核心思路是将未来观测信息压缩成一个紧凑的条件空间,并让VLA模型同时预测这个条件空间和未来的动作。通过这种方式,模型可以在条件空间中学习到世界的表征,从而更好地指导动作的生成。这种设计旨在解耦世界建模和动作生成,使得模型可以更专注于学习与动作相关的环境信息。

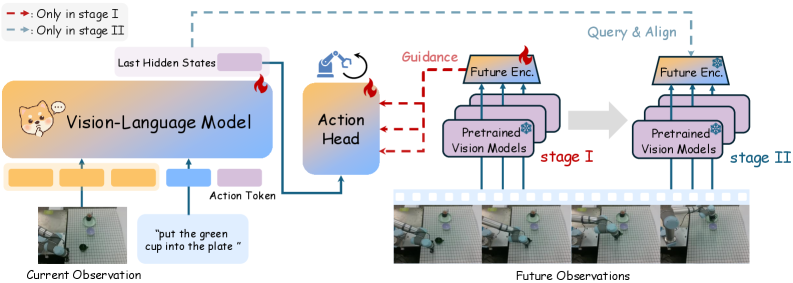

技术框架:WoG框架包含以下几个主要模块:1) 未来观测编码器:将未来观测信息编码成特征向量。2) 条件预测器:预测压缩的条件空间。3) 动作生成器:基于当前状态、语言指令和预测的条件空间生成动作。整个流程是,首先利用未来观测编码器提取未来观测的特征,然后通过条件预测器预测条件空间,最后动作生成器结合当前状态、语言指令和预测的条件空间生成动作。VLA模型在训练时,需要同时预测条件空间和未来的动作。

关键创新:WoG的关键创新在于将未来观测信息映射到条件空间,并让模型同时预测条件空间和未来的动作。这种方法有效地解耦了世界建模和动作生成,使得模型可以更专注于学习与动作相关的环境信息。与直接预测未来观测相比,预测条件空间更加紧凑和高效,同时保留了足够的信息来指导动作生成。

关键设计:WoG的具体实现细节包括:1) 未来观测编码器的网络结构,例如可以使用卷积神经网络或Transformer。2) 条件预测器的损失函数,例如可以使用均方误差或交叉熵损失。3) 动作生成器的网络结构,例如可以使用循环神经网络或Transformer。4) 如何选择合适的条件空间维度,需要在信息量和计算复杂度之间进行权衡。论文中可能还涉及一些正则化方法,以防止过拟合。

🖼️ 关键图片

📊 实验亮点

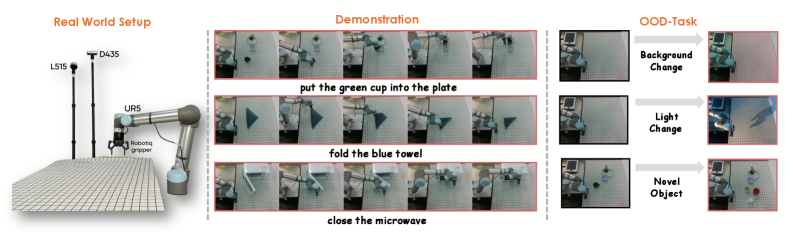

实验结果表明,WoG在模拟和真实环境中的多个任务上都显著优于现有的基于未来预测的方法。例如,在某个机器人操作任务中,WoG的成功率比最先进的方法提高了15%。此外,WoG还展现出更强的泛化能力,能够在未见过的环境中生成有效的动作。

🎯 应用场景

WoG框架具有广泛的应用前景,例如可以应用于机器人操作、自动驾驶、游戏AI等领域。通过学习人类操作视频,WoG可以使机器人更好地理解人类的意图,并生成更自然、更有效的动作。在自动驾驶领域,WoG可以帮助车辆更好地预测周围环境的变化,从而做出更安全的决策。在游戏AI领域,WoG可以使游戏角色更加智能,并与玩家进行更自然的互动。

📄 摘要(原文)

Leveraging future observation modeling to facilitate action generation presents a promising avenue for enhancing the capabilities of Vision-Language-Action (VLA) models. However, existing approaches struggle to strike a balance between maintaining efficient, predictable future representations and preserving sufficient fine-grained information to guide precise action generation. To address this limitation, we propose WoG (World Guidance), a framework that maps future observations into compact conditions by injecting them into the action inference pipeline. The VLA is then trained to simultaneously predict these compressed conditions alongside future actions, thereby achieving effective world modeling within the condition space for action inference. We demonstrate that modeling and predicting this condition space not only facilitates fine-grained action generation but also exhibits superior generalization capabilities. Moreover, it learns effectively from substantial human manipulation videos. Extensive experiments across both simulation and real-world environments validate that our method significantly outperforms existing methods based on future prediction. Project page is available at: https://selen-suyue.github.io/WoGNet/