Hierarchical LLM-Based Multi-Agent Framework with Prompt Optimization for Multi-Robot Task Planning

作者: Tomoya Kawabe, Rin Takano

分类: cs.RO, cs.AI, cs.MA

发布日期: 2026-02-25

备注: Accepted to ICRA 2026. 8 pages, 2 figures

💡 一句话要点

提出基于层级LLM的多智能体框架,通过提示优化解决多机器人任务规划问题

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多机器人任务规划 大型语言模型 层级规划 提示优化 多智能体系统

📋 核心要点

- 现有方法难以处理多机器人任务规划中自然语言指令的模糊性和长期性,且LLM易产生幻觉和不可行动作。

- 提出一种层级多智能体LLM规划器,上层分解任务并分配给下层智能体,下层生成PDDL问题供经典规划器求解。

- 通过文本梯度更新优化智能体提示,并学习共享元提示,在MAT-THOR基准测试中显著提升了任务成功率。

📝 摘要(中文)

多机器人任务规划需要将自然语言指令分解为异构机器人团队可执行的动作。传统的规划领域定义语言(PDDL)规划器提供严格的保证,但难以处理模糊或长期的任务,而大型语言模型(LLM)可以解释指令并提出计划,但可能产生幻觉或不可行的动作。我们提出了一种基于层级多智能体LLM的规划器,具有提示优化功能:上层分解任务并将其分配给下层智能体,下层智能体生成由经典规划器解决的PDDL问题。当计划失败时,系统应用受TextGrad启发的文本梯度更新来优化每个智能体的提示,从而提高规划准确性。此外,元提示在同一层内的智能体之间学习和共享,从而实现多智能体设置中的高效提示优化。在MAT-THOR基准测试中,我们的规划器在复合任务、复杂任务和模糊任务上的成功率分别达到0.95、0.84和0.60,分别比之前的最先进水平LaMMA-P提高了2、7和15个百分点。一项消融研究表明,层级结构、提示优化和元提示共享对整体成功率的贡献分别约为+59、+37和+4个百分点。

🔬 方法详解

问题定义:论文旨在解决多机器人任务规划中,如何利用自然语言指令高效、可靠地控制异构机器人团队完成复杂任务的问题。现有方法,如PDDL规划器,虽然保证了规划的严谨性,但难以处理自然语言的模糊性和长时序任务。而直接使用LLM进行规划,则容易产生幻觉和不可行的动作,缺乏可靠性。

核心思路:论文的核心思路是将LLM的理解能力和经典规划器的严谨性相结合。通过层级结构,将复杂任务分解为子任务,并分配给不同的智能体。每个智能体利用LLM生成PDDL问题,然后由经典规划器求解,从而保证了规划的可行性。同时,通过提示优化,提高LLM生成PDDL问题的准确性。

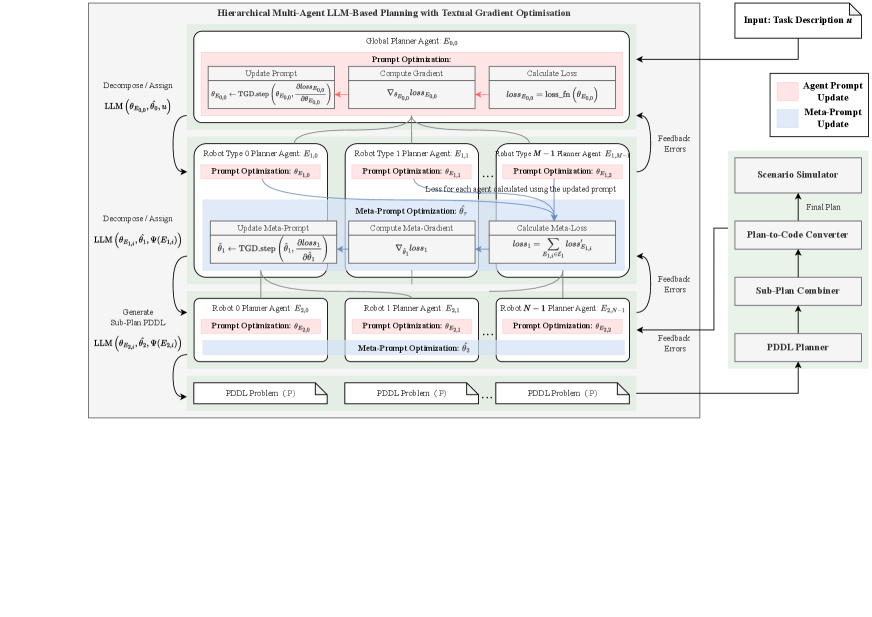

技术框架:该框架包含两个主要层级:上层任务分解层和下层任务执行层。上层由一个LLM智能体负责,接收自然语言指令,将其分解为多个子任务,并将这些子任务分配给下层的各个机器人智能体。下层每个机器人智能体也由一个LLM驱动,负责将分配给它的子任务转化为PDDL问题描述,然后使用经典的PDDL求解器生成具体的执行计划。如果计划失败,则进行提示优化。

关键创新:该论文的关键创新在于以下几点:1) 提出了层级多智能体架构,有效分解复杂任务;2) 引入了基于文本梯度的提示优化方法,提高了LLM生成PDDL问题的准确性;3) 提出了元提示共享机制,加速了多智能体环境下的提示优化过程。与现有方法相比,该方法结合了LLM的理解能力和经典规划器的严谨性,提高了规划的可靠性和效率。

关键设计:提示优化采用了受TextGrad启发的文本梯度更新方法,通过计算计划失败时目标状态与实际状态之间的差异,反向传播到LLM的提示中,从而优化提示。元提示共享机制允许同一层级的智能体共享学习到的提示信息,加速了提示优化过程。具体参数设置和损失函数细节未知。

🖼️ 关键图片

📊 实验亮点

该规划器在MAT-THOR基准测试中取得了显著的性能提升。在复合任务、复杂任务和模糊任务上的成功率分别达到0.95、0.84和0.60,分别比之前的最先进水平LaMMA-P提高了2、7和15个百分点。消融实验表明,层级结构、提示优化和元提示共享对整体成功率的贡献分别约为+59、+37和+4个百分点。

🎯 应用场景

该研究成果可应用于各种多机器人协作场景,例如智能家居、仓储物流、灾难救援等。通过自然语言指令,用户可以方便地指挥多个机器人协同完成复杂任务,提高工作效率和安全性。未来,该技术有望进一步扩展到更复杂的机器人系统和应用领域。

📄 摘要(原文)

Multi-robot task planning requires decomposing natural-language instructions into executable actions for heterogeneous robot teams. Conventional Planning Domain Definition Language (PDDL) planners provide rigorous guarantees but struggle to handle ambiguous or long-horizon missions, while large language models (LLMs) can interpret instructions and propose plans but may hallucinate or produce infeasible actions. We present a hierarchical multi-agent LLM-based planner with prompt optimization: an upper layer decomposes tasks and assigns them to lower-layer agents, which generate PDDL problems solved by a classical planner. When plans fail, the system applies TextGrad-inspired textual-gradient updates to optimize each agent's prompt and thereby improve planning accuracy. In addition, meta-prompts are learned and shared across agents within the same layer, enabling efficient prompt optimization in multi-agent settings. On the MAT-THOR benchmark, our planner achieves success rates of 0.95 on compound tasks, 0.84 on complex tasks, and 0.60 on vague tasks, improving over the previous state-of-the-art LaMMA-P by 2, 7, and 15 percentage points respectively. An ablation study shows that the hierarchical structure, prompt optimization, and meta-prompt sharing contribute roughly +59, +37, and +4 percentage points to the overall success rate.