What Matters for Simulation to Online Reinforcement Learning on Real Robots

作者: Yarden As, Dhruva Tirumala, René Zurbrügg, Chenhao Li, Stelian Coros, Andreas Krause, Markus Wulfmeier

分类: cs.RO, cs.AI

发布日期: 2026-02-23

💡 一句话要点

针对真实机器人在线强化学习,系统性研究了仿真到真实迁移的关键设计选择。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 在线强化学习 机器人学习 仿真到真实 设计选择 消融实验

📋 核心要点

- 现有在线强化学习方法在机器人上的应用缺乏系统性的设计选择分析,导致工程实践难度大。

- 通过系统性地消融算法、系统和实验设计选择,寻找对在线强化学习至关重要的因素。

- 实验表明,某些常用默认设置可能有害,而稳健的设计选择能提升任务和硬件上的学习稳定性。

📝 摘要(中文)

本文研究了哪些具体的设计选择能够成功地在物理机器人上进行在线强化学习(RL)。通过在三个不同的机器人平台上进行的100次真实世界训练,我们系统地消融了算法、系统和实验决策,这些决策在先前的工作中通常是隐式的。我们发现,一些广泛使用的默认设置可能是有害的,而标准RL实践中的一组稳健、易于采用的设计选择可以在任务和硬件上产生稳定的学习。这些结果提供了对这些设计选择的首次大样本经验研究,使从业者能够以更少的工程工作量部署在线RL。

🔬 方法详解

问题定义:论文旨在解决真实机器人上在线强化学习的工程实践问题。现有方法通常依赖于隐式的设计选择,缺乏系统性的分析,导致在不同机器人平台和任务上的泛化能力差,需要大量的工程调试工作。现有方法难以确定哪些设计选择是关键的,哪些是冗余的,从而阻碍了在线强化学习在机器人领域的广泛应用。

核心思路:论文的核心思路是通过大规模的消融实验,系统性地评估不同的算法、系统和实验设计选择对在线强化学习性能的影响。通过控制变量,分析每个设计选择对学习稳定性和最终性能的贡献,从而确定哪些设计选择是至关重要的,哪些是可以忽略的。这种方法旨在为从业者提供一套稳健的设计指南,降低在线强化学习的工程难度。

技术框架:论文的技术框架主要包括以下几个部分:首先,选择三个不同的机器人平台和多个不同的任务,以保证实验结果的泛化性。其次,定义一系列的设计选择,包括算法参数、系统配置和实验设置。然后,进行大规模的在线强化学习实验,每次实验只改变一个设计选择,并记录学习曲线和最终性能。最后,对实验结果进行统计分析,确定每个设计选择对学习稳定性和最终性能的影响。

关键创新:论文的关键创新在于其系统性的消融实验方法,通过大规模的实验数据,揭示了在线强化学习中不同设计选择的重要性。与以往的研究不同,论文不仅关注算法的改进,还关注系统和实验设置对性能的影响。这种全面的分析方法为从业者提供了更实用的指导,降低了在线强化学习的工程难度。

关键设计:论文的关键设计包括:1) 选择具有代表性的机器人平台和任务,以保证实验结果的泛化性;2) 定义清晰的设计选择,包括算法参数(如学习率、折扣因子)、系统配置(如传感器噪声、执行器延迟)和实验设置(如奖励函数、探索策略);3) 使用统一的评估指标,如学习曲线的稳定性和最终性能,以便比较不同设计选择的影响;4) 进行大规模的实验,以保证统计结果的可靠性。

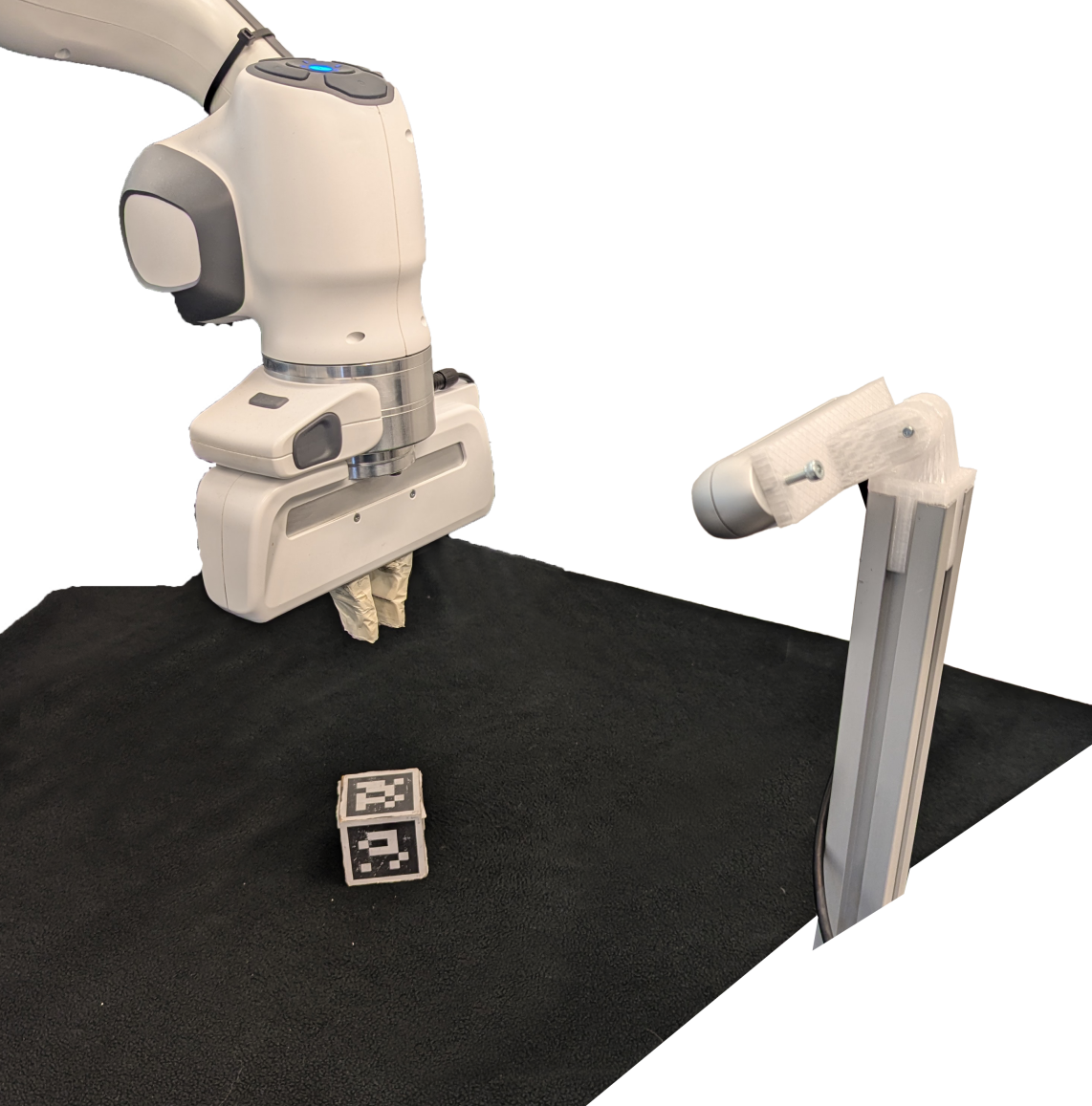

🖼️ 关键图片

📊 实验亮点

论文通过100次真实机器人训练,系统评估了多种设计选择。实验结果表明,某些常用默认设置(具体设置未知)可能对性能产生负面影响。研究确定了一组稳健的设计选择,能够在不同任务和硬件上实现稳定的学习。具体性能提升数据未知,但研究强调了这些设计选择的通用性和易用性。

🎯 应用场景

该研究成果可广泛应用于机器人自主导航、操作、控制等领域。通过指导设计选择,降低在线强化学习在机器人上的部署难度,加速机器人智能化进程。未来可应用于工业自动化、服务机器人、无人驾驶等场景,提升机器人的适应性和鲁棒性。

📄 摘要(原文)

We investigate what specific design choices enable successful online reinforcement learning (RL) on physical robots. Across 100 real-world training runs on three distinct robotic platforms, we systematically ablate algorithmic, systems, and experimental decisions that are typically left implicit in prior work. We find that some widely used defaults can be harmful, while a set of robust, readily adopted design choices within standard RL practice yield stable learning across tasks and hardware. These results provide the first large-sample empirical study of such design choices, enabling practitioners to deploy online RL with lower engineering effort.