Vid2Sid: Videos Can Help Close the Sim2Real Gap

作者: Kevin Qiu, Yu Zhang, Marek Cygan, Josie Hughes

分类: cs.RO, cs.LG

发布日期: 2026-02-22

💡 一句话要点

Vid2Sid:利用视频弥合Sim2Real差距,实现物理参数自动标定与可解释性推理。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: Sim2Real 系统辨识 视频分析 VLM 物理参数校准

📋 核心要点

- 现有Sim2Real方法依赖手动或黑盒优化,缺乏对物理参数差异的解释,且易受感知噪声影响。

- Vid2Sid利用视频信息,结合基础模型感知和VLM在环优化,诊断物理参数不匹配并提供自然语言解释。

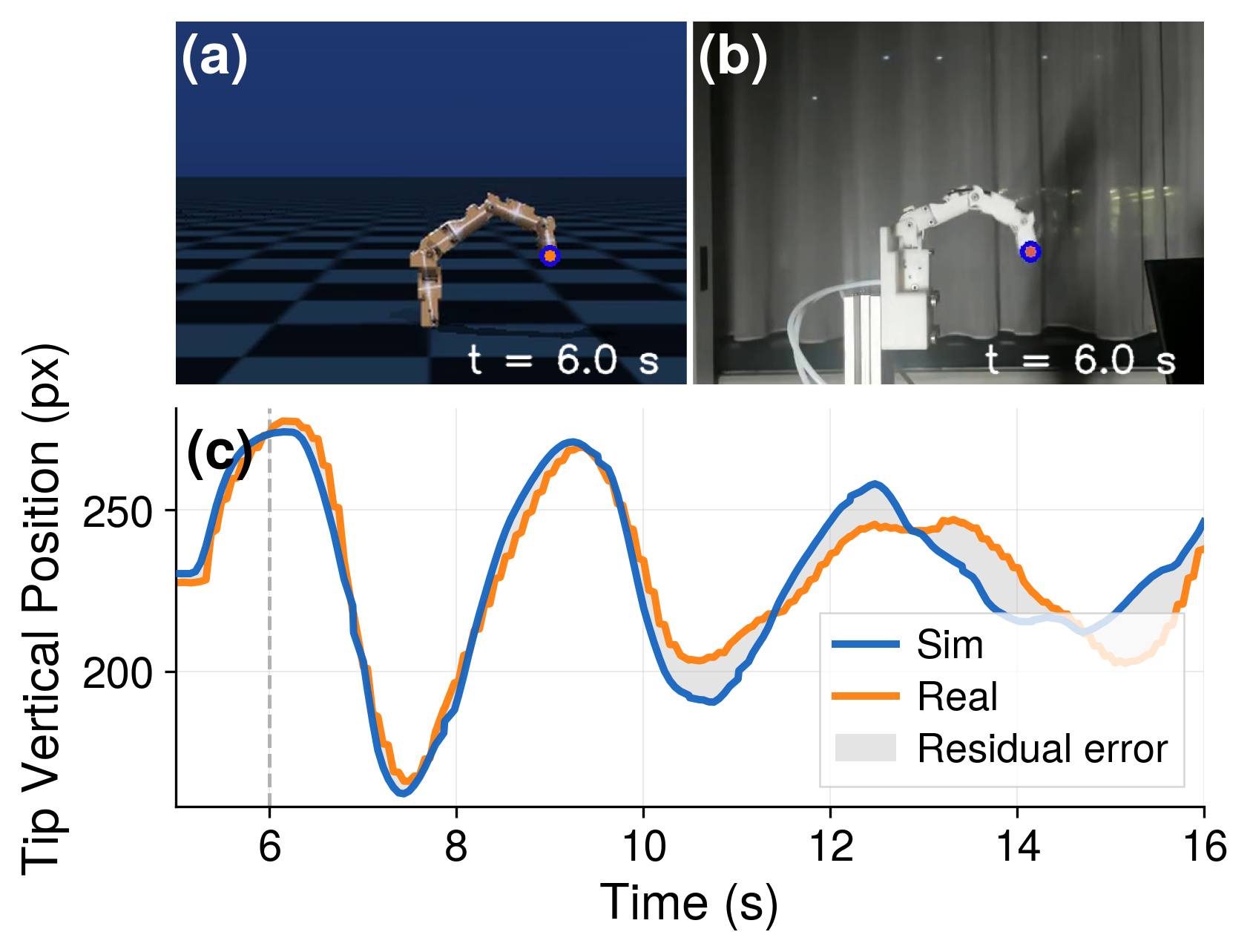

- 实验表明,Vid2Sid在Sim2Real控制任务中表现最佳,Sim2Sim验证能更准确恢复真实参数,平均相对误差低于13%。

📝 摘要(中文)

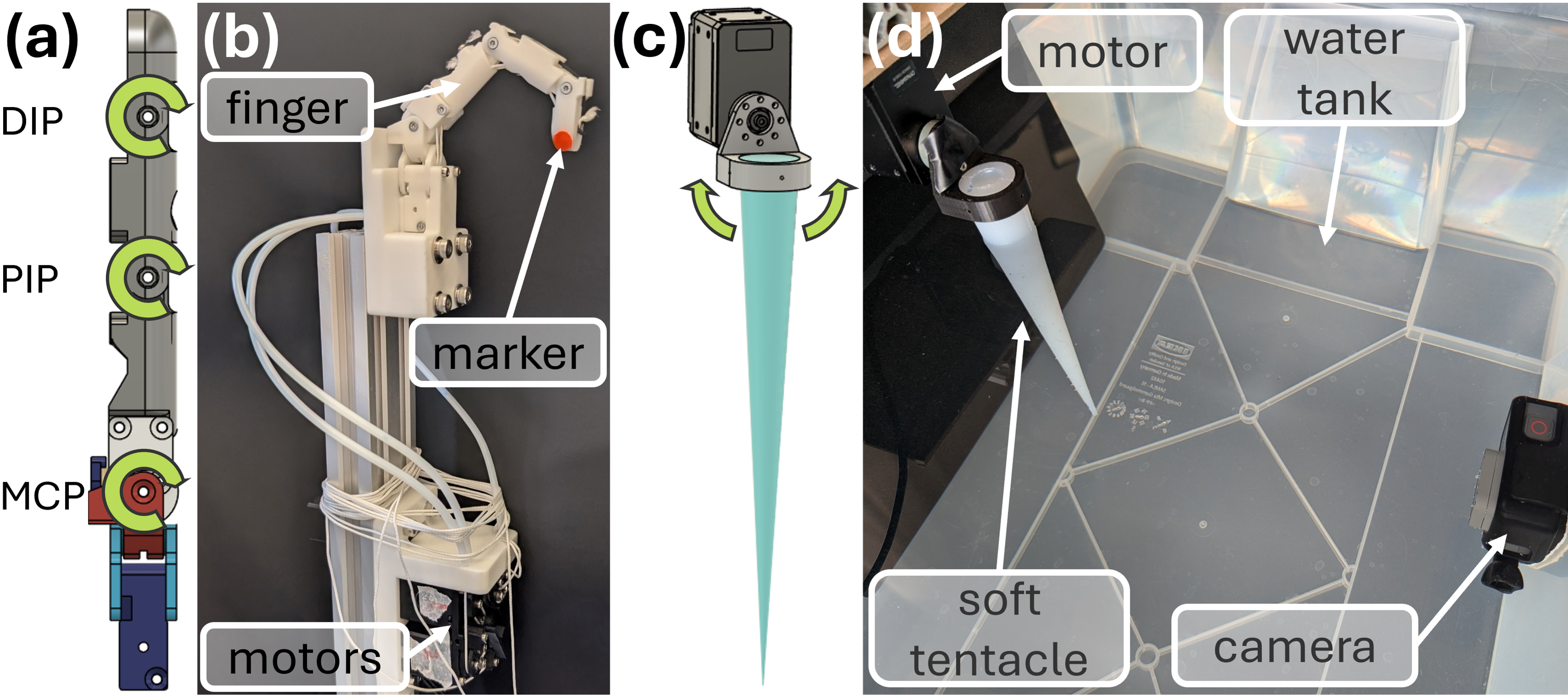

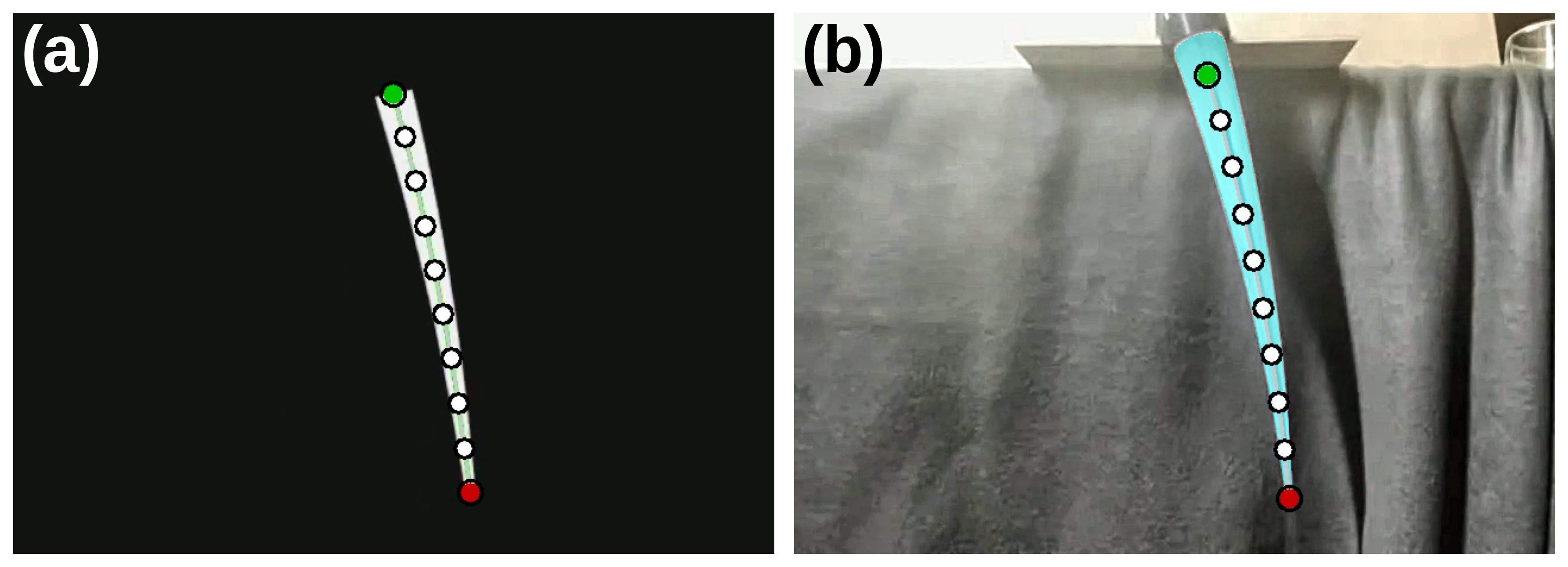

校准机器人仿真器的物理参数(摩擦力、阻尼、材料刚度)以匹配真实硬件通常手动完成,或使用黑盒优化器来减少误差,但无法解释哪些物理差异导致误差。当感知仅限于外部摄像头时,感知噪声和缺乏直接的力或状态测量会使问题更加复杂。我们提出了Vid2Sid,一个视频驱动的系统辨识流程,它将基础模型感知与VLM在环优化器相结合,分析配对的sim-real视频,诊断具体的不匹配,并提出带有自然语言解释的物理参数更新。我们在肌腱驱动的手指(MuJoCo中的刚体动力学)和可变形连续触手(Elastica中的软体动力学)上评估了我们的方法。在训练期间未见过的sim2real保持控制上,Vid2Sid在所有设置中实现了最佳平均排名,匹配或超过了黑盒优化器,同时独特地在每次迭代中提供可解释的推理。Sim2sim验证证实Vid2Sid最准确地恢复了ground-truth参数(平均相对误差低于13%,而其他方法为28-98%),消融分析揭示了三种校准机制。当感知清晰且模拟器具有表现力时,VLM引导的优化表现出色,而模型类限制限制了更具挑战性的设置中的性能。

🔬 方法详解

问题定义:Sim2Real差距是机器人领域的核心挑战之一。现有的参数校准方法,如手动调整或黑盒优化,存在两个主要痛点:一是缺乏可解释性,难以理解哪些物理参数的差异导致了仿真与现实之间的不一致;二是依赖于直接的状态测量或力反馈,当感知仅限于外部摄像头时,感知噪声会显著影响校准效果。

核心思路:Vid2Sid的核心思路是利用视频作为桥梁,连接仿真环境和真实环境。通过分析配对的仿真视频和真实视频,诊断两者之间的差异,并利用VLM(Vision Language Model)提供可解释的物理参数更新建议。这种方法避免了对直接状态测量的依赖,并能够利用VLM的推理能力来指导参数校准。

技术框架:Vid2Sid的整体框架包含以下几个主要模块:1) 视频采集模块:同步采集仿真环境和真实环境的视频数据。2) 基础模型感知模块:利用预训练的视觉模型(如CLIP)提取视频帧的视觉特征。3) VLM在环优化模块:该模块是核心,它将视觉特征输入到VLM中,VLM分析仿真视频和真实视频之间的差异,并提出物理参数更新的建议,同时给出自然语言解释。4) 参数更新模块:根据VLM的建议,更新仿真器的物理参数。5) 仿真执行模块:使用更新后的参数执行仿真,并生成新的仿真视频。整个流程是一个迭代过程,直到仿真视频和真实视频之间的差异足够小。

关键创新:Vid2Sid的关键创新在于将VLM引入到Sim2Real的参数校准过程中。与传统的黑盒优化方法不同,Vid2Sid能够提供可解释的推理过程,帮助用户理解哪些物理参数的差异导致了仿真与现实之间的不一致。此外,Vid2Sid利用视频作为输入,避免了对直接状态测量的依赖,使其更适用于感知受限的场景。

关键设计:VLM在环优化模块是Vid2Sid的关键。该模块的设计需要考虑以下几个方面:1) VLM的选择:选择具有较强视觉推理能力的VLM,例如GPT-4V。2) Prompt设计:设计合适的Prompt,引导VLM分析仿真视频和真实视频之间的差异,并提出物理参数更新的建议。Prompt需要包含足够的信息,例如物体形状、运动轨迹、物理属性等。3) 损失函数设计:设计合适的损失函数,衡量仿真视频和真实视频之间的差异。可以使用视觉特征的距离作为损失函数,也可以使用更复杂的度量指标,例如运动轨迹的相似度。

🖼️ 关键图片

📊 实验亮点

Vid2Sid在肌腱驱动手指和可变形触手的Sim2Real控制任务中取得了最佳平均排名,与黑盒优化器性能相当甚至超越,同时提供了可解释的推理。Sim2Sim验证表明,Vid2Sid能以低于13%的平均相对误差恢复真实参数,显著优于其他方法(28-98%)。

🎯 应用场景

Vid2Sid可应用于机器人仿真、游戏开发、自动驾驶等领域。它能够自动校准仿真器的物理参数,提高仿真结果的真实性,从而加速算法的开发和部署。此外,Vid2Sid的可解释性推理能力有助于用户理解仿真与现实之间的差异,为改进仿真模型提供指导。

📄 摘要(原文)

Calibrating a robot simulator's physics parameters (friction, damping, material stiffness) to match real hardware is often done by hand or with black-box optimizers that reduce error but cannot explain which physical discrepancies drive the error. When sensing is limited to external cameras, the problem is further compounded by perception noise and the absence of direct force or state measurements. We present Vid2Sid, a video-driven system identification pipeline that couples foundation-model perception with a VLM-in-the-loop optimizer that analyzes paired sim-real videos, diagnoses concrete mismatches, and proposes physics parameter updates with natural language rationales. We evaluate our approach on a tendon-actuated finger (rigid-body dynamics in MuJoCo) and a deformable continuum tentacle (soft-body dynamics in PyElastica). On sim2real holdout controls unseen during training, Vid2Sid achieves the best average rank across all settings, matching or exceeding black-box optimizers while uniquely providing interpretable reasoning at each iteration. Sim2sim validation confirms that Vid2Sid recovers ground-truth parameters most accurately (mean relative error under 13\% vs. 28--98\%), and ablation analysis reveals three calibration regimes. VLM-guided optimization excels when perception is clean and the simulator is expressive, while model-class limitations bound performance in more challenging settings.