WildOS: Open-Vocabulary Object Search in the Wild

作者: Hardik Shah, Erica Tevere, Deegan Atha, Marcel Kaufmann, Shehryar Khattak, Manthan Patel, Marco Hutter, Jonas Frey, Patrick Spieler

分类: cs.RO, cs.CV

发布日期: 2026-02-22

备注: 28 pages, 16 figures, 2 tables

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

提出WildOS以解决复杂户外环境中的开放词汇物体搜索问题

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱三:空间感知与语义 (Perception & Semantics) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 开放词汇 物体搜索 自主导航 几何探索 语义推理 深度学习 机器人技术

📋 核心要点

- 现有方法在复杂户外环境中导航时,往往无法有效结合几何信息与语义理解,导致探索效率低下。

- WildOS通过构建稀疏导航图和利用ExploRFM模块,实现了几何安全与语义推理的结合,提升了导航能力。

- 实验结果显示,WildOS在效率和自主性上显著优于传统的几何和视觉方法,展示了其在实际应用中的潜力。

📝 摘要(中文)

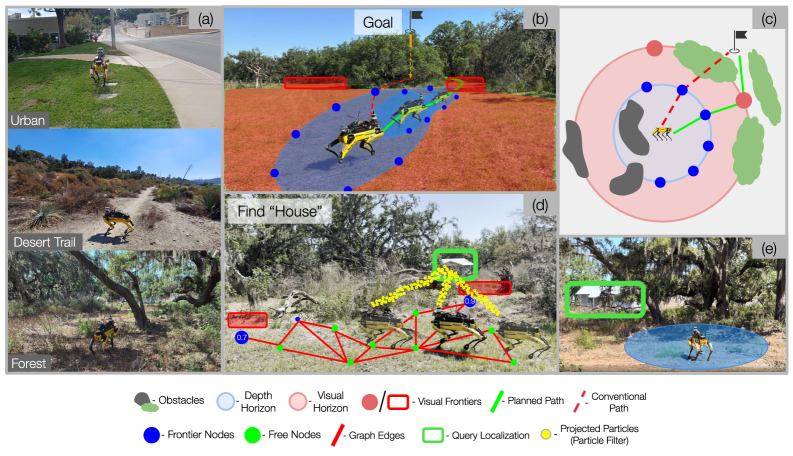

在复杂的非结构化户外环境中,自主导航要求机器人在没有先前地图和有限深度感知的情况下进行长距离操作。仅依赖几何前沿进行探索往往不足以满足需求。因此,能够在语义上推理出安全的行进方向至关重要。本文提出了WildOS,一个统一的长距离开放词汇物体搜索系统,结合了安全的几何探索与语义视觉推理。WildOS构建了稀疏导航图以维护空间记忆,并利用基于基础模型的视觉模块ExploRFM对图的前沿节点进行评分。ExploRFM同时预测可通行性、视觉前沿和图像空间中的物体相似性,实现实时的语义导航任务。实验结果表明,WildOS在多种越野和城市地形中表现出色,显著优于纯几何和纯视觉基线方法。

🔬 方法详解

问题定义:本文旨在解决在复杂的户外环境中,机器人如何在没有先前地图和有限深度感知的情况下进行有效的开放词汇物体搜索。现有方法往往仅依赖几何信息,缺乏语义推理能力,导致导航效率低下。

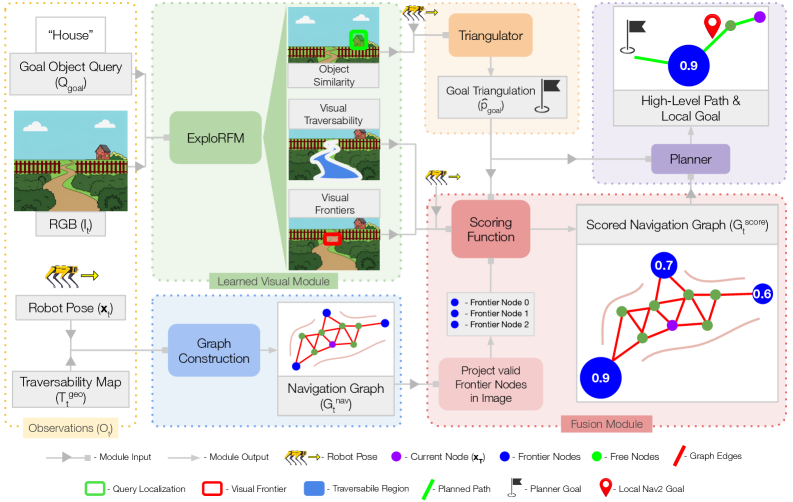

核心思路:WildOS的核心思路是结合几何探索与语义视觉推理,通过构建稀疏导航图和使用ExploRFM模块,实时评估探索方向的安全性和语义相关性,从而实现更智能的导航。

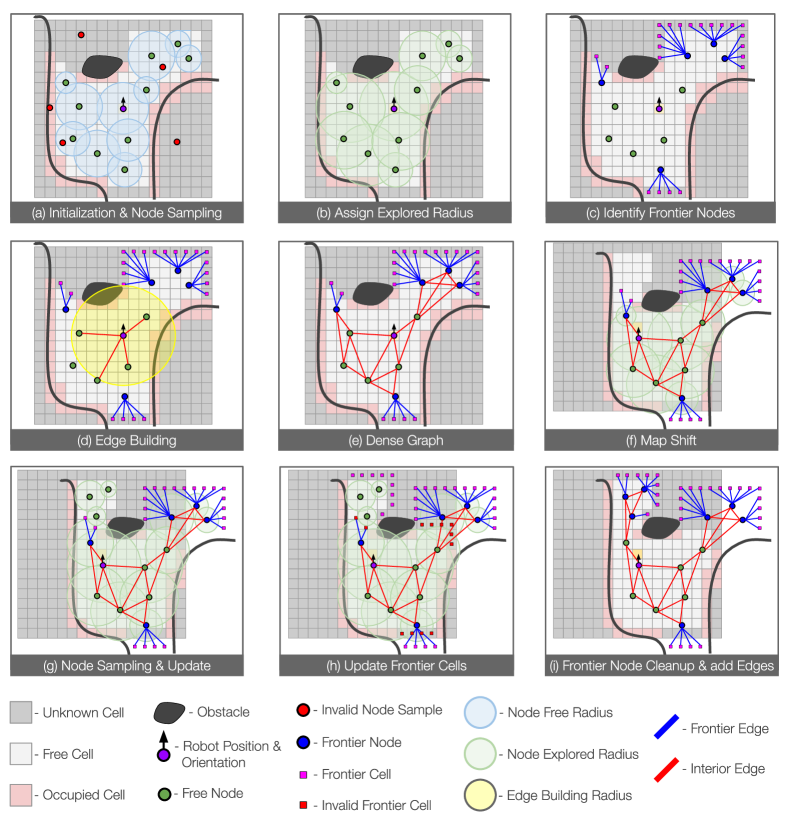

技术框架:WildOS的整体架构包括稀疏导航图的构建、ExploRFM模块的集成以及基于粒子滤波的粗定位方法。稀疏导航图用于维护空间记忆,ExploRFM模块则负责评分前沿节点,确保探索的语义意义和几何安全。

关键创新:WildOS的关键创新在于将基础模型的视觉推理与几何探索相结合,ExploRFM模块能够同时预测可通行性、视觉前沿和物体相似性,这在现有方法中尚属首次。

关键设计:在设计上,ExploRFM模块采用了深度学习网络结构,结合了多种损失函数以优化预测效果,确保在实时任务中能够快速响应并提供准确的评分。

🖼️ 关键图片

📊 实验亮点

实验结果表明,WildOS在多种越野和城市地形中表现出色,导航效率提升了显著的百分比,且在自主性方面超过了传统的几何和视觉基线方法。这一成果展示了视觉基础模型在推动开放世界机器人行为中的巨大潜力。

🎯 应用场景

WildOS的研究成果在无人驾驶、搜索与救援、以及环境监测等领域具有广泛的应用潜力。通过实现更智能的导航,机器人能够在复杂环境中自主探索,提升任务执行的效率和安全性。未来,该技术有望推动开放世界机器人行为的发展,使其在多样化的场景中表现出更高的自主性和适应性。

📄 摘要(原文)

Autonomous navigation in complex, unstructured outdoor environments requires robots to operate over long ranges without prior maps and limited depth sensing. In such settings, relying solely on geometric frontiers for exploration is often insufficient. In such settings, the ability to reason semantically about where to go and what is safe to traverse is crucial for robust, efficient exploration. This work presents WildOS, a unified system for long-range, open-vocabulary object search that combines safe geometric exploration with semantic visual reasoning. WildOS builds a sparse navigation graph to maintain spatial memory, while utilizing a foundation-model-based vision module, ExploRFM, to score frontier nodes of the graph. ExploRFM simultaneously predicts traversability, visual frontiers, and object similarity in image space, enabling real-time, onboard semantic navigation tasks. The resulting vision-scored graph enables the robot to explore semantically meaningful directions while ensuring geometric safety. Furthermore, we introduce a particle-filter-based method for coarse localization of the open-vocabulary target query, that estimates candidate goal positions beyond the robot's immediate depth horizon, enabling effective planning toward distant goals. Extensive closed-loop field experiments across diverse off-road and urban terrains demonstrate that WildOS enables robust navigation, significantly outperforming purely geometric and purely vision-based baselines in both efficiency and autonomy. Our results highlight the potential of vision foundation models to drive open-world robotic behaviors that are both semantically informed and geometrically grounded. Project Page: https://leggedrobotics.github.io/wildos/