Safe and Interpretable Multimodal Path Planning for Multi-Agent Cooperation

作者: Haojun Shi, Suyu Ye, Katherine M. Guerrerio, Jianzhi Shen, Yifan Yin, Daniel Khashabi, Chien-Ming Huang, Tianmin Shu

分类: cs.RO, cs.AI, cs.HC, cs.MA

发布日期: 2026-02-22

💡 一句话要点

提出CaPE:一种安全可解释的多模态路径规划方法,用于多智能体协作

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多智能体协作 路径规划 视觉-语言模型 模型预测控制 安全规划 可解释性 机器人控制

📋 核心要点

- 现有去中心化智能体协作方法难以快速适应其他智能体的行为,尤其是在智能体无法准确预测彼此意图时,语言沟通至关重要。

- CaPE方法利用视觉-语言模型将语言指令转化为路径编辑程序,并结合模型预测控制确保路径的安全性和可解释性。

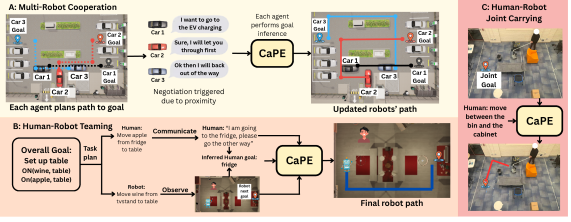

- 实验表明,CaPE能有效提升机器人在多智能体协作任务中的性能,并在自动驾驶、家务和联合搬运等场景中展现出良好的适应性。

📝 摘要(中文)

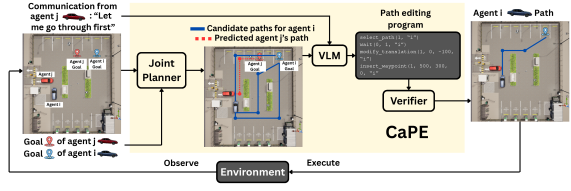

本文提出了一种安全且可解释的多模态路径规划方法CaPE(Code as Path Editor),用于解决去中心化智能体间的协作问题。该方法基于环境信息和来自其他智能体的语言通信,生成并更新智能体的路径规划。CaPE利用视觉-语言模型(VLM)合成路径编辑程序,并通过基于模型的规划器进行验证,从而以安全且可解释的方式将通信内容与路径规划更新相关联。在自动驾驶、家务和联合搬运等模拟和真实场景中,对该方法进行了评估。实验结果表明,CaPE可以作为一个即插即用的模块集成到不同的机器人系统中,极大地增强了机器人根据其他机器人或人类的语言通信调整其计划的能力。此外,基于VLM的路径编辑程序合成和基于模型的规划安全性的结合,使机器人能够在保持安全性和可解释性的同时实现开放式的协作。

🔬 方法详解

问题定义:论文旨在解决多智能体协作场景下,智能体如何根据其他智能体的语言指令安全有效地调整自身路径规划的问题。现有方法通常难以将语言信息直接融入路径规划,或者缺乏对安全性和可解释性的保证。尤其是在复杂环境中,智能体需要理解语言指令并将其转化为具体的行动,同时避免碰撞等安全问题。

核心思路:论文的核心思路是将语言指令转化为可执行的路径编辑程序,并利用模型预测控制(MPC)等方法对生成的路径进行安全验证。通过视觉-语言模型(VLM)理解语言指令,并将其映射到一系列路径编辑操作。然后,使用基于模型的规划器验证这些操作是否安全,并生成最终的路径规划。这种方法将语言理解、路径规划和安全验证相结合,实现了安全且可解释的多智能体协作。

技术框架:CaPE的整体框架包含以下几个主要模块:1) 视觉-语言模型(VLM):用于理解环境信息和来自其他智能体的语言指令,并生成初步的路径编辑程序。2) 路径编辑程序合成器:将VLM的输出转化为一系列具体的路径编辑操作,例如调整速度、改变方向等。3) 基于模型的规划器:利用环境模型和智能体的动力学模型,对生成的路径进行安全验证,并进行必要的调整。4) 路径执行器:将最终的路径规划转化为智能体的控制指令,使其能够安全地执行任务。

关键创新:CaPE的关键创新在于将视觉-语言模型与模型预测控制相结合,实现了一种安全且可解释的多模态路径规划方法。与传统的基于规则或学习的方法相比,CaPE能够更好地理解语言指令,并将其转化为具体的行动。同时,基于模型的规划器能够保证路径的安全性,避免碰撞等问题。此外,CaPE的路径编辑程序具有可解释性,可以清晰地了解智能体的决策过程。

关键设计:VLM的选择和训练是CaPE的关键设计之一。论文可能采用了预训练的VLM模型,并在特定任务上进行微调,以提高其对语言指令的理解能力。路径编辑程序合成器的设计需要考虑不同类型的语言指令,并将其转化为相应的路径编辑操作。基于模型的规划器需要选择合适的模型和优化算法,以保证路径的安全性和效率。此外,损失函数的设计也至关重要,需要平衡路径的安全性、效率和与语言指令的一致性。

🖼️ 关键图片

📊 实验亮点

实验结果表明,CaPE在多智能体协作任务中取得了显著的性能提升。在模拟和真实世界的实验中,CaPE能够有效地将语言指令融入路径规划,并保证路径的安全性。与传统的路径规划方法相比,CaPE能够更好地适应动态环境和复杂的语言指令,提高了智能体的协作效率和安全性。具体性能数据未知,但论文强调了CaPE在不同机器人系统中的即插即用性。

🎯 应用场景

CaPE具有广泛的应用前景,可应用于自动驾驶、机器人协作、智能家居等领域。在自动驾驶中,车辆可以通过语言与其他车辆或行人进行沟通,从而提高交通效率和安全性。在机器人协作中,多个机器人可以通过语言进行协调,共同完成复杂的任务。在智能家居中,用户可以通过语音指令控制机器人完成各种家务。

📄 摘要(原文)

Successful cooperation among decentralized agents requires each agent to quickly adapt its plan to the behavior of other agents. In scenarios where agents cannot confidently predict one another's intentions and plans, language communication can be crucial for ensuring safety. In this work, we focus on path-level cooperation in which agents must adapt their paths to one another in order to avoid collisions or perform physical collaboration such as joint carrying. In particular, we propose a safe and interpretable multimodal path planning method, CaPE (Code as Path Editor), which generates and updates path plans for an agent based on the environment and language communication from other agents. CaPE leverages a vision-language model (VLM) to synthesize a path editing program verified by a model-based planner, grounding communication to path plan updates in a safe and interpretable way. We evaluate our approach in diverse simulated and real-world scenarios, including multi-robot and human-robot cooperation in autonomous driving, household, and joint carrying tasks. Experimental results demonstrate that CaPE can be integrated into different robotic systems as a plug-and-play module, greatly enhancing a robot's ability to align its plan to language communication from other robots or humans. We also show that the combination of the VLM-based path editing program synthesis and model-based planning safety enables robots to achieve open-ended cooperation while maintaining safety and interpretability.