3D Shape Control of Extensible Multi-Section Soft Continuum Robots via Visual Servoing

作者: Abhinav Gandhi, Shou-Shan Chiang, Cagdas D. Onal, Berk Calli

分类: cs.RO

发布日期: 2026-02-22

💡 一句话要点

提出基于视觉伺服的可伸缩多节软体连续机器人的3D形状控制方法。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 软体机器人 视觉伺服 形状控制 逆运动学 机器人控制

📋 核心要点

- 现有基于视觉的软体机器人控制算法主要关注末端执行器的姿态控制,忽略了机器人整体形状的调节和运动学冗余的利用。

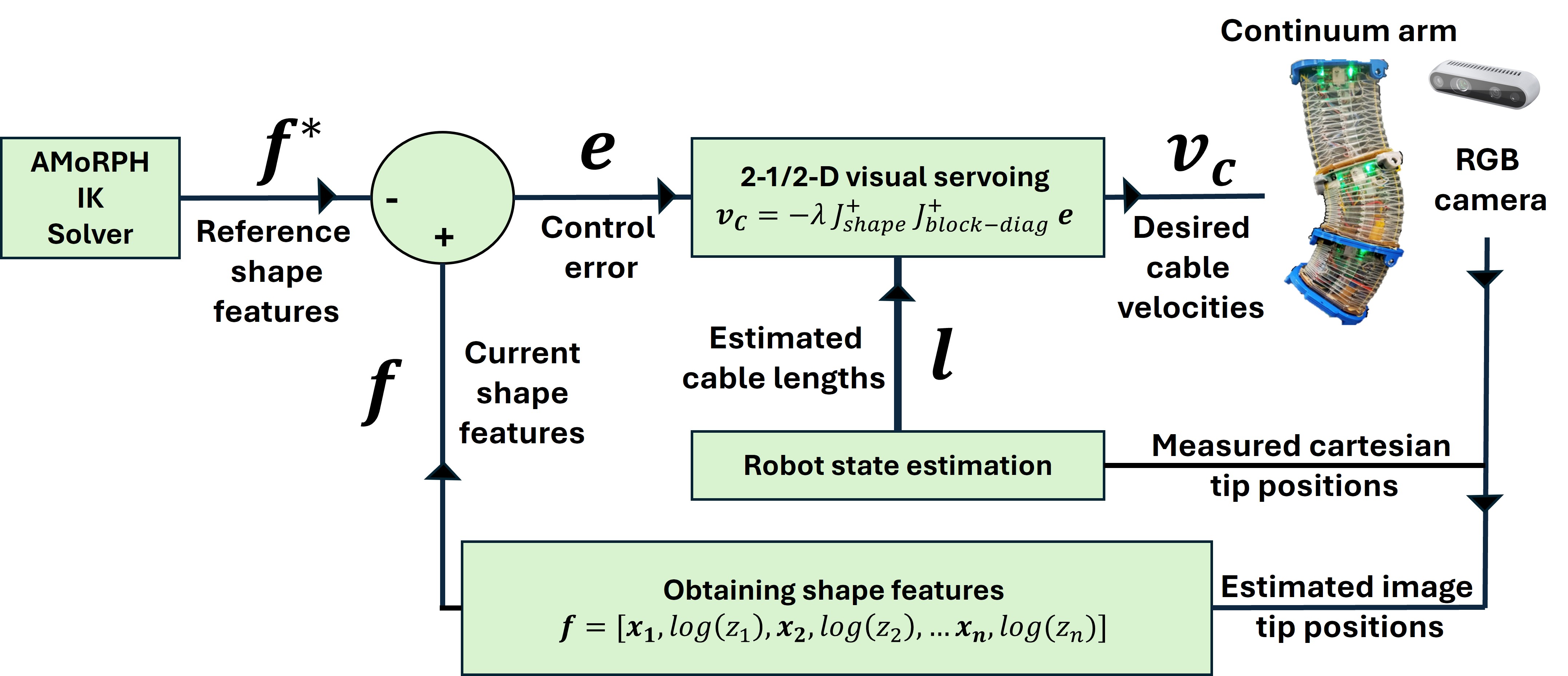

- 提出一种基于视觉伺服的控制算法,直接调节软体机器人的整体形状,无需本体感受传感器,并利用逆运动学求解器生成参考特征。

- 实验结果表明,该控制器能够有效调节软体机器人的形状,实现精确的末端执行器定位,并在对象操作任务中表现出良好的适用性。

📝 摘要(中文)

本文提出了一种新颖的基于视觉的控制算法,用于调节可伸缩多节软体连续机器人的整体形状。与现有文献中调节机器人末端执行器姿态的基于视觉的控制算法不同,我们提出的控制算法调节机器人的整体构型,从而能够利用其运动学冗余性。此外,与报告局部最小值的文献中最接近的工作相比,我们基于模型的2.5D形状视觉伺服在机器人的3D工作空间中提供了全局稳定的渐近收敛。与现有视觉伺服算法不同,我们的方法不需要来自本体感受传感器的信息,使其适用于不具备此类能力的连续机器人。相反,机器人状态是从外部相机获取的图像中估计的,该相机观察机器人的整体形状,并用于闭合形状控制回路。传统上,视觉伺服方案需要机器人在其参考姿势下的图像来生成参考特征。在这项工作中,我们利用逆运动学求解器为所需的机器人配置生成参考特征,而不需要机器人在参考位置的图像。在多节连续机器人上进行了实验,证明了控制器调节机器人整体形状同时精确定位机器人末端执行器的能力。结果验证了我们的控制器调节连续机器人形状的能力,同时展示了平滑的瞬态响应和1毫米以内的稳态误差。进行了包括堆叠、倾倒和拉动任务的概念验证对象操作实验,以证明我们控制器的适用性。

🔬 方法详解

问题定义:现有基于视觉的软体机器人控制方法通常只关注末端执行器的位姿控制,而忽略了对机器人整体形状的精确控制。此外,许多方法依赖于本体感受传感器,这限制了它们在缺乏此类传感器的软体机器人上的应用。因此,需要一种能够仅通过视觉信息精确控制软体机器人整体形状的方法。

核心思路:本文的核心思路是利用视觉伺服技术,直接将机器人整体形状的视觉特征作为控制目标。通过外部相机获取机器人的图像,提取形状特征,并与期望的形状特征进行比较,从而生成控制信号。此外,利用逆运动学求解器生成参考特征,避免了对参考图像的依赖。

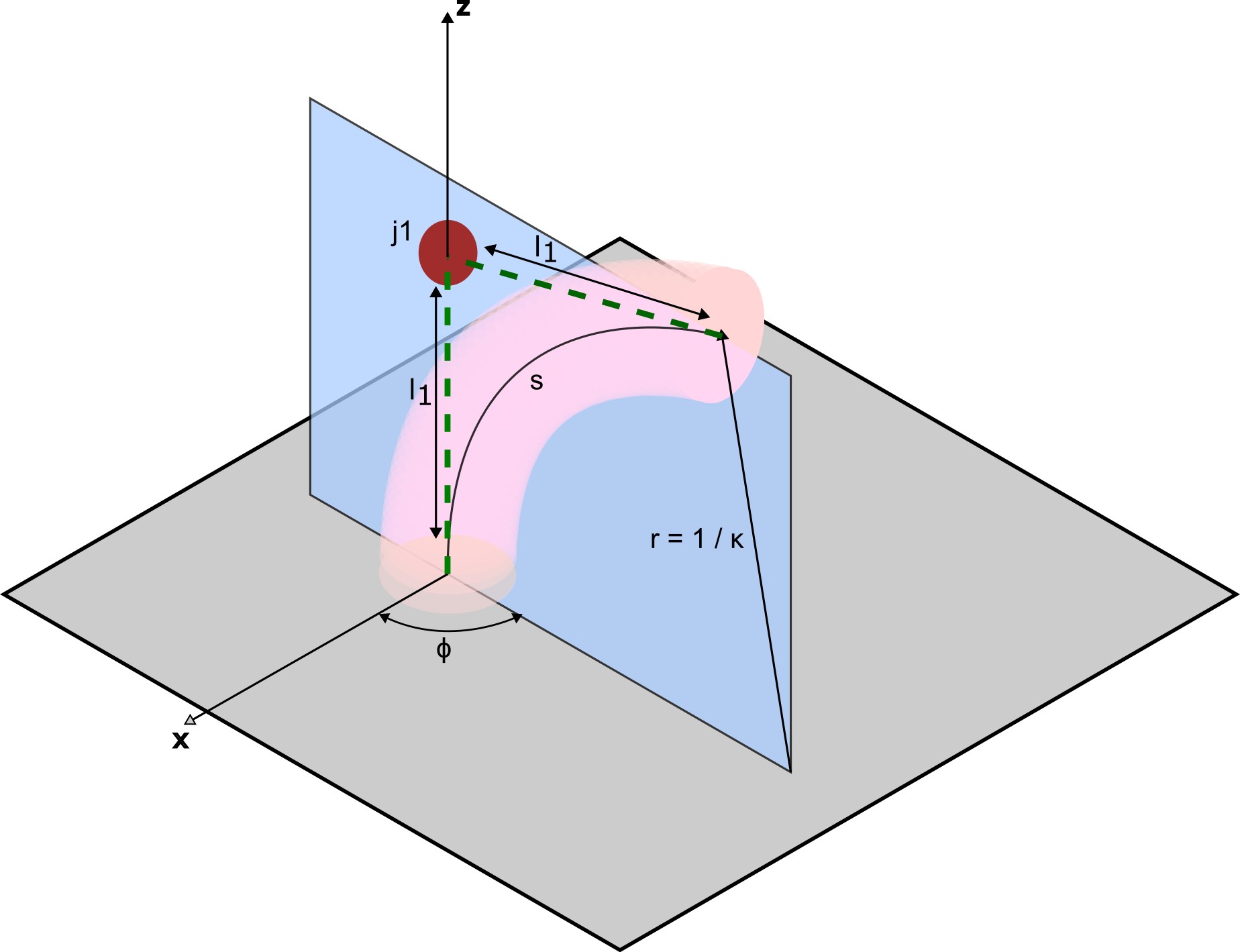

技术框架:该方法主要包含以下几个模块:1) 图像采集模块:使用外部相机获取机器人的图像。2) 形状特征提取模块:从图像中提取机器人的形状特征,例如关键点的坐标。3) 逆运动学求解器:根据期望的机器人构型,计算出对应的参考形状特征。4) 视觉伺服控制器:根据实际形状特征和参考形状特征的差异,生成控制信号,驱动机器人运动。5) 机器人控制模块:将控制信号转化为机器人的关节控制指令。

关键创新:该方法的关键创新在于:1) 直接对机器人整体形状进行控制,而非仅关注末端执行器。2) 不需要本体感受传感器,仅依赖视觉信息。3) 利用逆运动学求解器生成参考特征,避免了对参考图像的依赖。4) 实现了全局稳定的渐近收敛,优于现有方法的局部最小化问题。

关键设计:该方法使用2.5D视觉伺服,即同时考虑图像空间和3D空间的信息。形状特征的选择至关重要,需要能够准确描述机器人的整体形状。视觉伺服控制器的设计需要保证系统的稳定性,并具有良好的鲁棒性。逆运动学求解器的精度直接影响参考特征的准确性,需要进行仔细的校准。

🖼️ 关键图片

📊 实验亮点

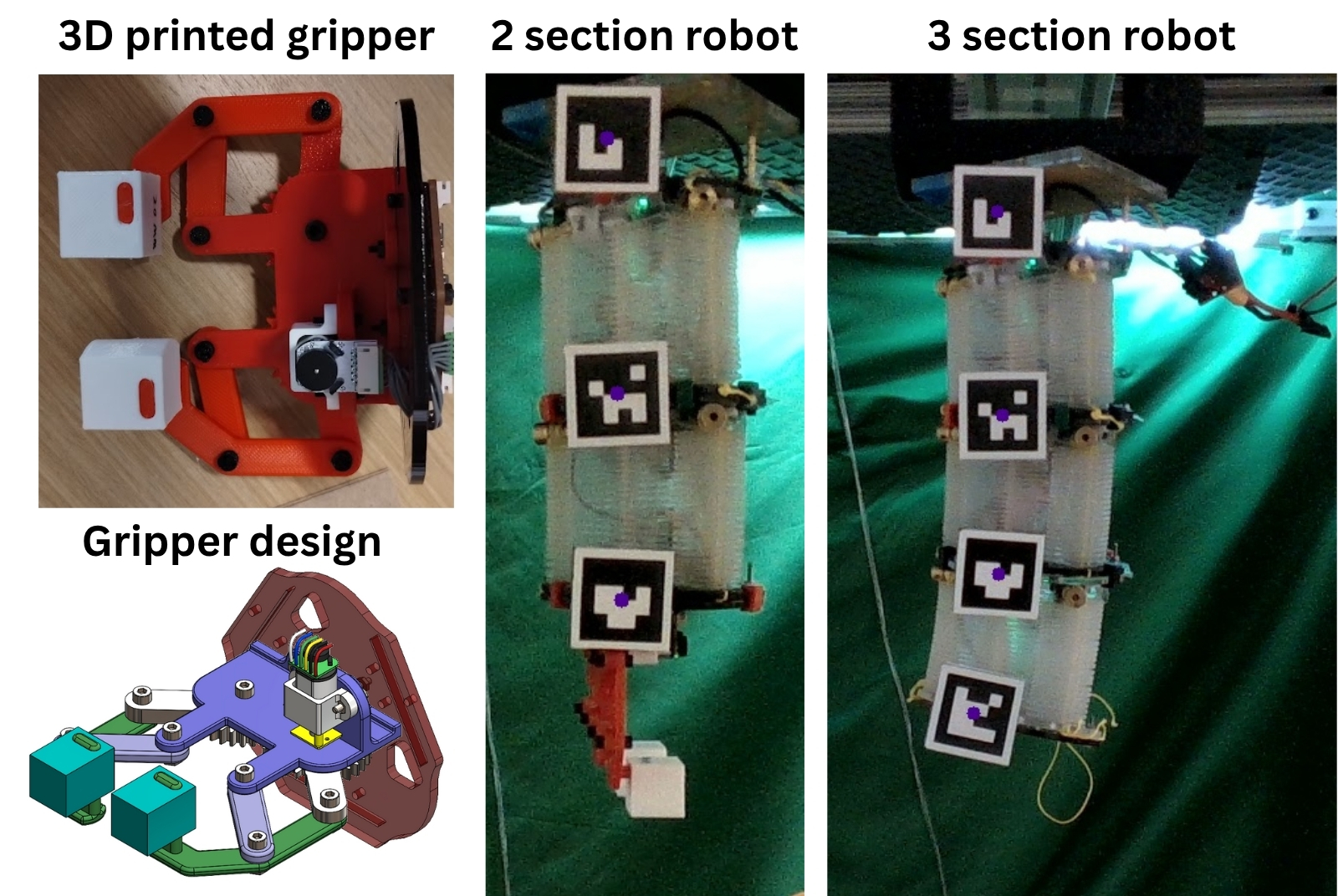

实验结果表明,该控制器能够有效调节软体机器人的形状,实现精确的末端执行器定位,稳态误差在1mm以内。通过堆叠、倾倒和拉动等概念验证实验,验证了该控制器在对象操作任务中的适用性。该方法无需本体感受传感器,降低了对硬件的要求,更易于实际应用。

🎯 应用场景

该研究成果可应用于医疗机器人、工业自动化、搜索救援等领域。例如,在微创手术中,可以利用该方法精确控制软体机器人的形状,使其能够安全地到达目标位置。在工业自动化中,可以利用该方法实现对柔性物体的抓取和操作。在搜索救援中,可以利用软体机器人的灵活性和适应性,在复杂环境中进行探测和救援。

📄 摘要(原文)

In this paper, we propose a novel vision-based control algorithm for regulating the whole body shape of extensible multisection soft continuum manipulators. Contrary to existing vision-based control algorithms in the literature that regulate the robot's end effector pose, our proposed control algorithm regulates the robot's whole body configuration, enabling us to leverage its kinematic redundancy. Additionally, our model-based 2.5D shape visual servoing provides globally stable asymptotic convergence in the robot's 3D workspace compared to the closest works in the literature that report local minima. Unlike existing visual servoing algorithms in the literature, our approach does not require information from proprioceptive sensors, making it suitable for continuum manipulators without such capabilities. Instead, robot state is estimated from images acquired by an external camera that observes the robot's whole body shape and is also utilized to close the shape control loop. Traditionally, visual servoing schemes require an image of the robot at its reference pose to generate the reference features. In this work, we utilize an inverse kinematics solver to generate reference features for the desired robot configuration and do not require images of the robot at the reference. Experiments are performed on a multisection continuum manipulator demonstrating the controller's capability to regulate the robot's whole body shape while precisely positioning the robot's end effector. Results validate our controller's ability to regulate the shape of continuum robots while demonstrating a smooth transient response and a steady-state error within 1 mm. Proof-of-concept object manipulation experiments including stacking, pouring, and pulling tasks are performed to demonstrate our controller's applicability.