RoboCurate: Harnessing Diversity with Action-Verified Neural Trajectory for Robot Learning

作者: Seungku Kim, Suhyeok Jang, Byungjun Yoon, Dongyoung Kim, John Won, Jinwoo Shin

分类: cs.RO, cs.AI, cs.CV

发布日期: 2026-02-21

备注: 20 pages; 6 figures; Project page is available at https://seungkukim.github.io/robocurate/

💡 一句话要点

RoboCurate:利用动作验证神经轨迹提升机器人学习多样性

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 机器人学习 合成数据 动作验证 神经轨迹 模拟重放

📋 核心要点

- 现有方法依赖视频生成模型合成数据,但动作质量受限于生成视频的保真度,且视觉-语言模型难以准确评估动作的物理合理性。

- RoboCurate通过模拟器重放预测动作,并比较模拟结果与生成视频的一致性,从而验证动作质量,筛选高质量合成数据。

- RoboCurate结合图像编辑和视频迁移技术,扩展了数据的观察多样性,实验表明,该方法显著提升了机器人学习的成功率。

📝 摘要(中文)

视频生成模型生成的合成数据在机器人学习中展现出潜力,但由于视频生成质量的不足,动作质量常常不稳定。最近,视觉-语言模型(VLMs)被用于验证视频质量,但它们在区分物理上精确的视频方面存在局限性,并且无法直接评估生成的动作本身。为了解决这个问题,我们引入了RoboCurate,一种新颖的合成机器人数据生成框架,通过将预测的动作与模拟重放进行比较来评估和过滤带注释的动作质量。具体来说,RoboCurate在模拟器中重放预测的动作,并通过测量模拟器展开和生成的视频之间的运动一致性来评估动作质量。此外,我们通过图像到图像的编辑解锁了超出可用数据集的观察多样性,并应用动作保持的视频到视频的迁移来进一步增强外观。我们观察到,与仅使用真实数据相比,RoboCurate生成的数据在成功率方面产生了显著的相对改进,在GR-1 Tabletop(300个演示)上实现了+70.1%,在预训练设置中的DexMimicGen上实现了+16.1%,在具有挑战性的真实世界ALLEX人形灵巧操作设置中实现了+179.9%。

🔬 方法详解

问题定义:论文旨在解决机器人学习中,利用合成数据进行训练时,由于合成数据质量不高(特别是动作质量),导致训练效果不佳的问题。现有方法依赖视觉-语言模型进行视频质量评估,但无法准确判断动作的物理合理性,且难以直接评估动作本身。

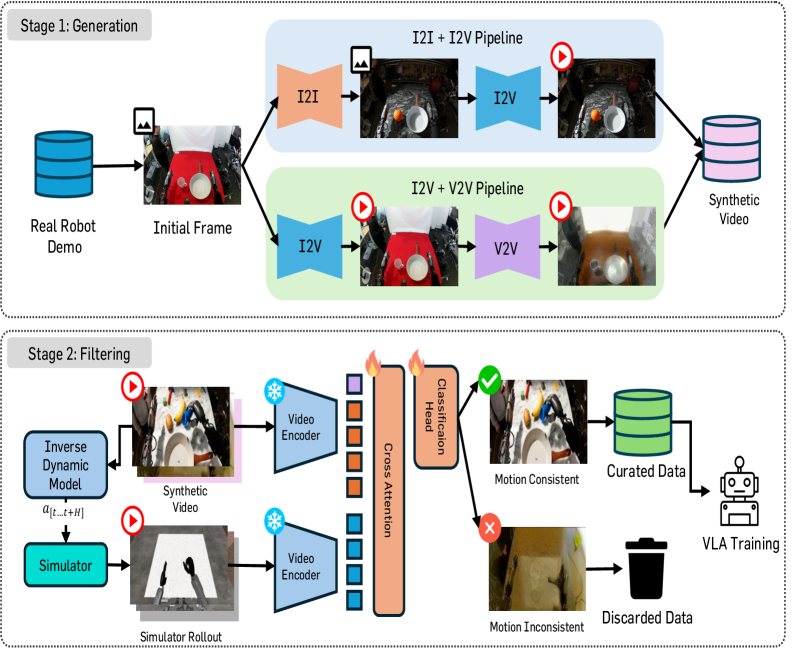

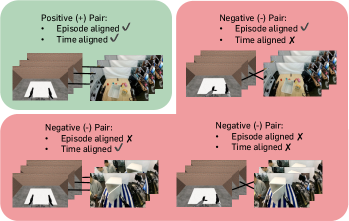

核心思路:RoboCurate的核心思路是通过模拟器重放合成数据中的动作,并将模拟结果与原始合成视频进行比较,从而验证动作的物理合理性。如果模拟结果与视频高度一致,则认为该动作是高质量的,可以用于训练。这种方法直接评估了动作的物理可行性,避免了依赖视觉-语言模型的间接评估。

技术框架:RoboCurate框架主要包含以下几个阶段:1) 使用视频生成模型生成合成数据,包括视频和对应的动作序列;2) 使用动作预测模型从视频中提取动作序列;3) 在物理模拟器中重放提取的动作序列,得到模拟轨迹;4) 将模拟轨迹与原始视频进行比较,计算一致性得分;5) 根据一致性得分筛选高质量的合成数据;6) 使用图像到图像的编辑和视频到视频的迁移技术,进一步增强数据的多样性。

关键创新:RoboCurate的关键创新在于提出了基于模拟重放的动作验证方法。与传统的基于视觉-语言模型的视频质量评估方法相比,RoboCurate直接评估了动作的物理可行性,从而更准确地筛选高质量的合成数据。此外,RoboCurate还结合了图像编辑和视频迁移技术,进一步增强了数据的多样性。

关键设计:RoboCurate使用物理引擎(例如MuJoCo)作为模拟器。一致性得分的计算方式可以是多种多样的,例如,可以计算模拟轨迹和视频中物体轨迹之间的距离,或者计算模拟轨迹和视频中机器人末端执行器轨迹之间的距离。具体的一致性度量方式需要根据具体的任务进行选择。图像到图像的编辑和视频到视频的迁移技术可以使用现有的方法,例如CycleGAN或Vid2Vid。

🖼️ 关键图片

📊 实验亮点

实验结果表明,RoboCurate在多个机器人学习任务上取得了显著的性能提升。在GR-1 Tabletop任务上,RoboCurate的成功率比仅使用真实数据提高了70.1%。在DexMimicGen预训练任务上,成功率提高了16.1%。在具有挑战性的ALLEX人形灵巧操作任务上,成功率提高了179.9%。这些结果表明,RoboCurate能够有效地生成高质量的合成数据,并显著提升机器人学习的性能。

🎯 应用场景

RoboCurate可应用于各种机器人学习任务,尤其是在数据收集成本高昂或难以获取真实数据的场景下。例如,它可以用于训练机器人进行复杂的装配任务、灵巧操作任务或导航任务。通过生成大量高质量的合成数据,RoboCurate可以显著降低机器人学习的成本,并加速机器人的部署。

📄 摘要(原文)

Synthetic data generated by video generative models has shown promise for robot learning as a scalable pipeline, but it often suffers from inconsistent action quality due to imperfectly generated videos. Recently, vision-language models (VLMs) have been leveraged to validate video quality, but they have limitations in distinguishing physically accurate videos and, even then, cannot directly evaluate the generated actions themselves. To tackle this issue, we introduce RoboCurate, a novel synthetic robot data generation framework that evaluates and filters the quality of annotated actions by comparing them with simulation replay. Specifically, RoboCurate replays the predicted actions in a simulator and assesses action quality by measuring the consistency of motion between the simulator rollout and the generated video. In addition, we unlock observation diversity beyond the available dataset via image-to-image editing and apply action-preserving video-to-video transfer to further augment appearance. We observe RoboCurate's generated data yield substantial relative improvements in success rates compared to using real data only, achieving +70.1% on GR-1 Tabletop (300 demos), +16.1% on DexMimicGen in the pre-training setup, and +179.9% in the challenging real-world ALLEX humanoid dexterous manipulation setting.