Zero-shot Interactive Perception

作者: Venkatesh Sripada, Frank Guerin, Amir Ghalamzan

分类: cs.RO, cs.AI

发布日期: 2026-02-20

备注: Original manuscript submitted on April 24, 2025. Timestamped and publicly available on OpenReview: https://openreview.net/forum?id=7MhpFcr5Nx

💡 一句话要点

提出零样本交互感知框架,结合多策略操作与记忆驱动的视觉语言模型,解决复杂场景中的语义查询问题。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 交互感知 视觉语言模型 机器人操作 零样本学习 多策略操作 语义理解 增强观察

📋 核心要点

- 现有方法难以有效解决复杂场景中由于遮挡和歧义导致的机器人感知问题,限制了交互式操作的性能。

- 该论文提出了一种零样本交互感知框架,通过结合多策略操作和记忆驱动的视觉语言模型来引导机器人交互。

- 实验结果表明,该框架在推操作任务中优于现有方法,并且能够保持非目标元素的完整性。

📝 摘要(中文)

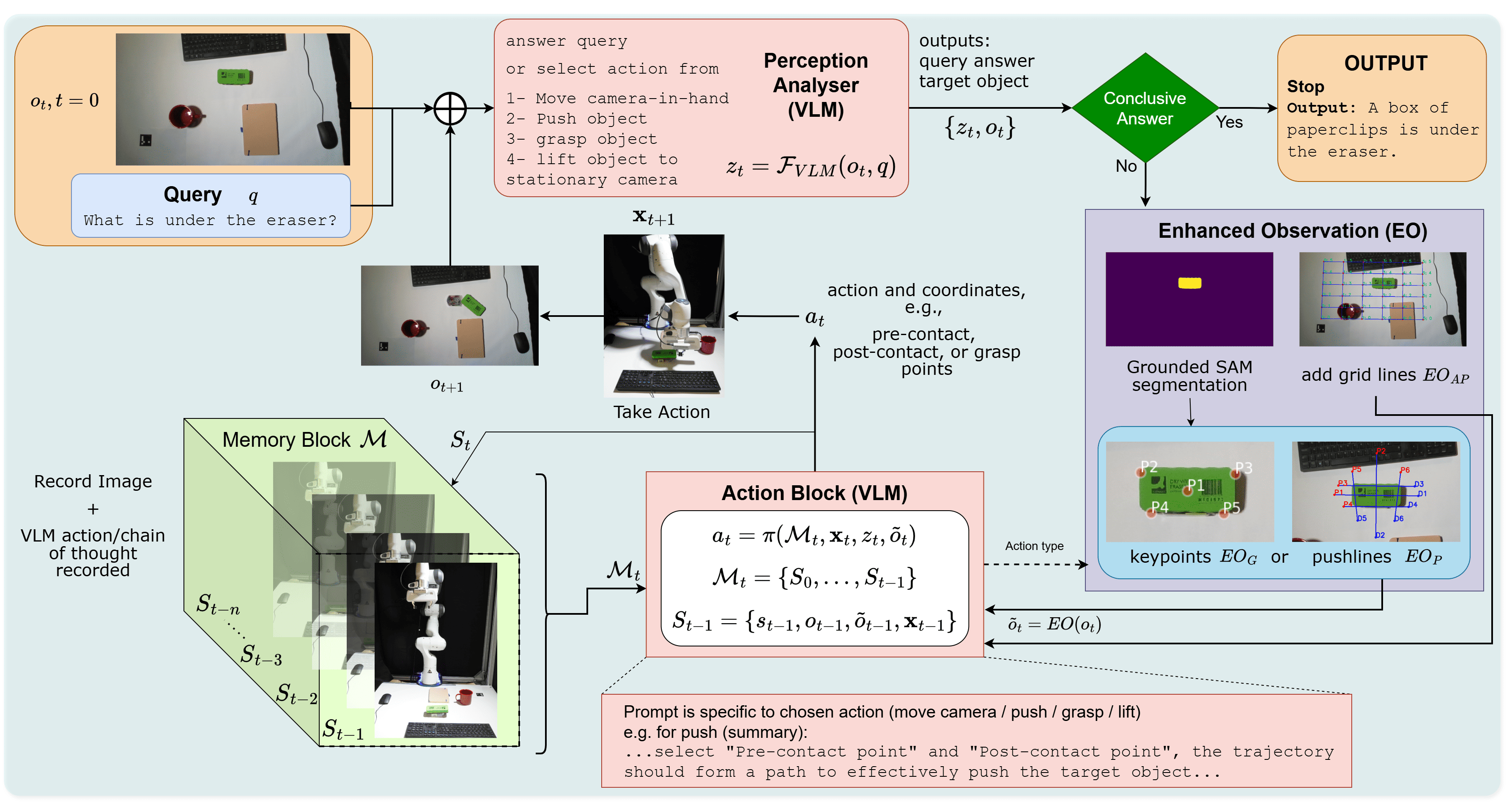

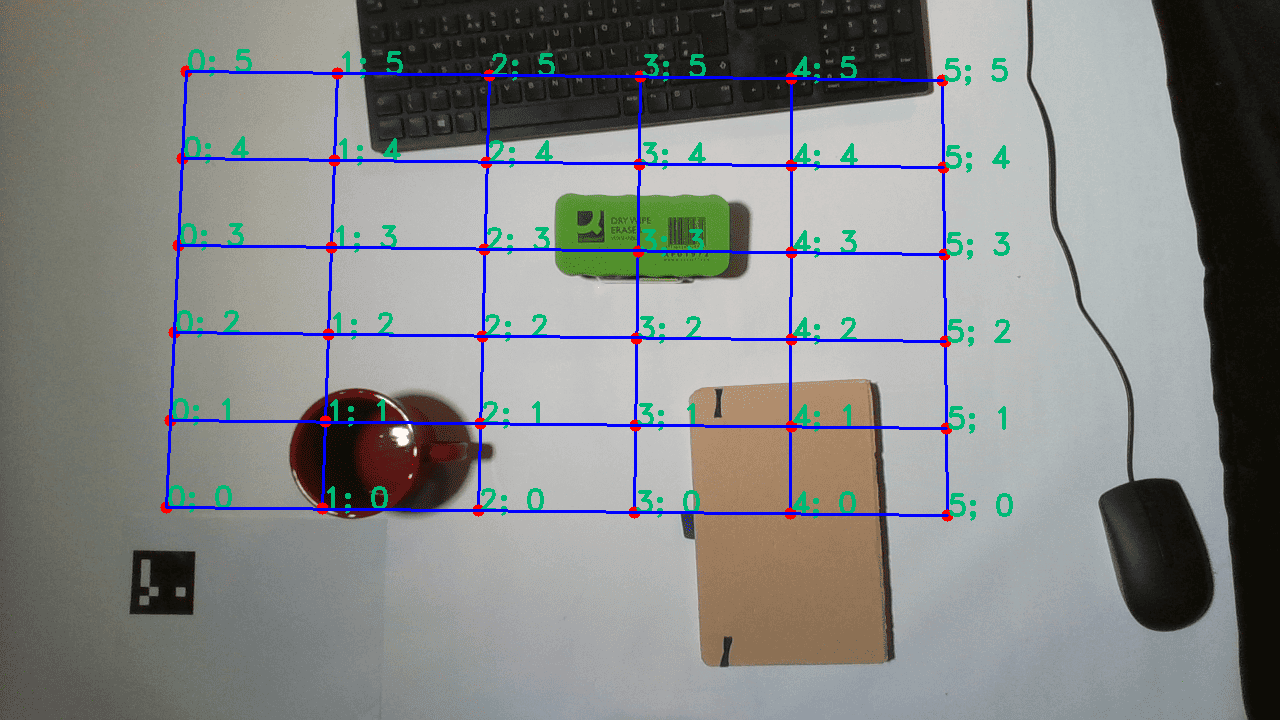

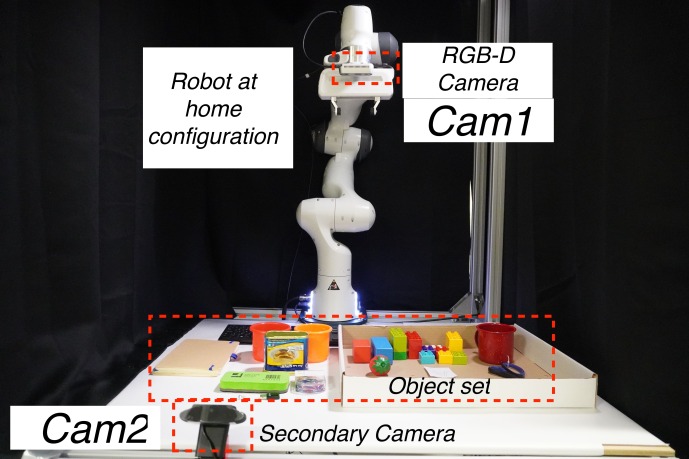

交互感知(IP)使机器人能够通过与物体进行物理交互并改变环境状态来提取工作空间中的隐藏信息并执行操作计划——这对于解决复杂、部分可观察场景中的遮挡和歧义至关重要。我们提出了零样本IP(ZS-IP),这是一个新颖的框架,它将多策略操作(推和抓取)与记忆驱动的视觉语言模型(VLM)相结合,以指导机器人交互并解决语义查询。ZS-IP集成了三个关键组件:(1)增强观察(EO)模块,通过传统的关键点和我们提出的pushlines来增强VLM的视觉感知——pushlines是一种为推操作量身定制的新型2D视觉增强;(2)记忆引导的动作模块,通过上下文查找来加强语义推理;(3)一个机器人控制器,根据VLM的输出执行推、拉或抓取。与为拾取和放置优化的基于网格的增强不同,pushlines捕获了富接触操作的示能,从而显著提高了推操作的性能。我们在具有不同遮挡和任务复杂性的各种场景中的7-DOF Franka Panda机械臂上评估了ZS-IP。我们的实验表明,ZS-IP优于被动和基于视点的感知技术,例如基于标记的可视化提示(MOKA),尤其是在推任务中,同时保持了非目标元素的完整性。

🔬 方法详解

问题定义:论文旨在解决在复杂、部分可观察的机器人操作场景中,由于遮挡和歧义导致机器人难以准确感知和理解环境,从而限制了交互式操作性能的问题。现有方法,如被动感知和基于视点的感知,无法有效地处理这些挑战,尤其是在需要物理交互(如推)来揭示隐藏信息时。

核心思路:论文的核心思路是将视觉语言模型(VLM)与多策略操作(推和抓取)相结合,利用VLM的语义理解能力和操作策略的物理交互能力,实现零样本的交互感知。通过记忆机制增强VLM的推理能力,并设计专门的视觉增强方法(pushlines)来提高推操作的性能。

技术框架:ZS-IP框架包含三个主要模块:1) 增强观察(EO)模块:该模块通过传统的关键点和pushlines来增强VLM的视觉感知能力。Pushlines是一种为推操作量身定制的2D视觉增强方法。2) 记忆引导的动作模块:该模块通过上下文查找来加强VLM的语义推理能力,从而更好地指导动作选择。3) 机器人控制器:该模块根据VLM的输出执行推、拉或抓取等操作。整体流程是,机器人首先通过EO模块感知环境,然后利用记忆引导的动作模块进行推理,最后通过机器人控制器执行相应的操作。

关键创新:该论文的关键创新在于:1) Pushlines:提出了一种新的2D视觉增强方法,专门用于提高推操作的性能。与传统的基于网格的增强方法不同,pushlines能够更好地捕获富接触操作的示能。2) 零样本交互感知:该框架能够在没有特定任务训练的情况下,通过VLM的泛化能力和多策略操作的交互能力,完成复杂的语义查询任务。

关键设计:Pushlines的具体实现方式未知,但其核心思想是捕捉推操作的示能。记忆引导的动作模块的具体实现方式也未知,但其核心思想是通过上下文查找来增强VLM的推理能力。论文中没有明确提及损失函数和网络结构的具体细节,这些可能是基于现有VLM模型进行的微调或改进。

🖼️ 关键图片

📊 实验亮点

实验结果表明,ZS-IP在推操作任务中显著优于被动和基于视点的感知技术,例如Mark-Based Visual Prompting (MOKA)。具体性能数据未知,但论文强调ZS-IP在提高推操作性能的同时,能够保持非目标元素的完整性,这表明该方法具有较好的鲁棒性和泛化能力。

🎯 应用场景

该研究成果可应用于各种需要机器人进行复杂交互操作的场景,例如:智能仓储中处理遮挡物品的拣选、家庭服务机器人中需要操作复杂物体的任务、以及工业制造中需要精细操作的装配任务。该研究有望提升机器人在复杂环境中的适应性和智能化水平,实现更高效、更可靠的自动化操作。

📄 摘要(原文)

Interactive perception (IP) enables robots to extract hidden information in their workspace and execute manipulation plans by physically interacting with objects and altering the state of the environment -- crucial for resolving occlusions and ambiguity in complex, partially observable scenarios. We present Zero-Shot IP (ZS-IP), a novel framework that couples multi-strategy manipulation (pushing and grasping) with a memory-driven Vision Language Model (VLM) to guide robotic interactions and resolve semantic queries. ZS-IP integrates three key components: (1) an Enhanced Observation (EO) module that augments the VLM's visual perception with both conventional keypoints and our proposed pushlines -- a novel 2D visual augmentation tailored to pushing actions, (2) a memory-guided action module that reinforces semantic reasoning through context lookup, and (3) a robotic controller that executes pushing, pulling, or grasping based on VLM output. Unlike grid-based augmentations optimized for pick-and-place, pushlines capture affordances for contact-rich actions, substantially improving pushing performance. We evaluate ZS-IP on a 7-DOF Franka Panda arm across diverse scenes with varying occlusions and task complexities. Our experiments demonstrate that ZS-IP outperforms passive and viewpoint-based perception techniques such as Mark-Based Visual Prompting (MOKA), particularly in pushing tasks, while preserving the integrity of non-target elements.