Have We Mastered Scale in Deep Monocular Visual SLAM? The ScaleMaster Dataset and Benchmark

作者: Hyoseok Ju, Bokeon Suh, Giseop Kim

分类: cs.RO

发布日期: 2026-02-20

备注: 8 pages, 9 figures, accepted to ICRA 2026

💡 一句话要点

提出ScaleMaster数据集,揭示深度单目SLAM在尺度一致性上的不足

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 单目SLAM 深度学习 尺度一致性 数据集 基准测试

📋 核心要点

- 现有深度单目SLAM在尺度一致性方面存在不足,尤其是在大规模、复杂结构的室内环境中。

- 提出ScaleMaster数据集,包含多层结构、长轨迹等挑战场景,用于评估和提升SLAM系统的尺度一致性。

- 实验表明,现有深度单目SLAM在ScaleMaster数据集上表现不佳,突显了尺度一致性问题的重要性。

📝 摘要(中文)

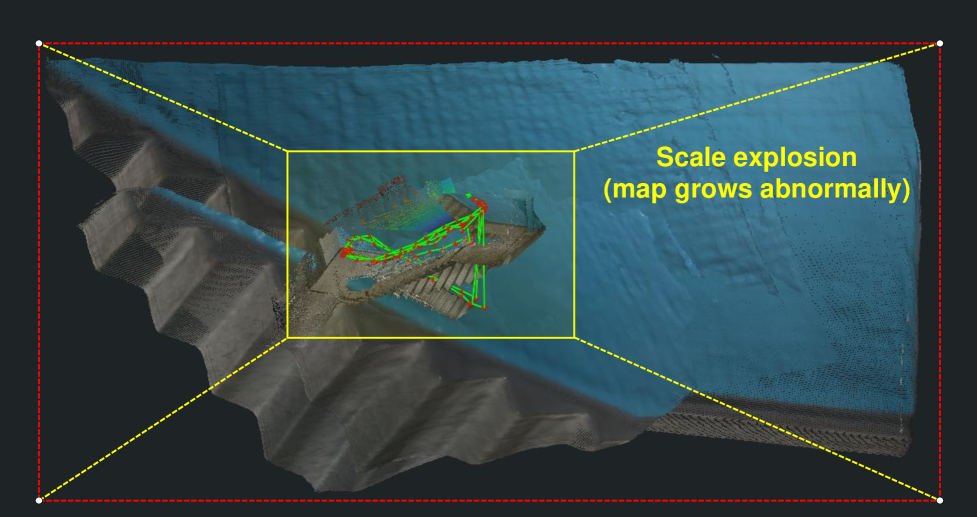

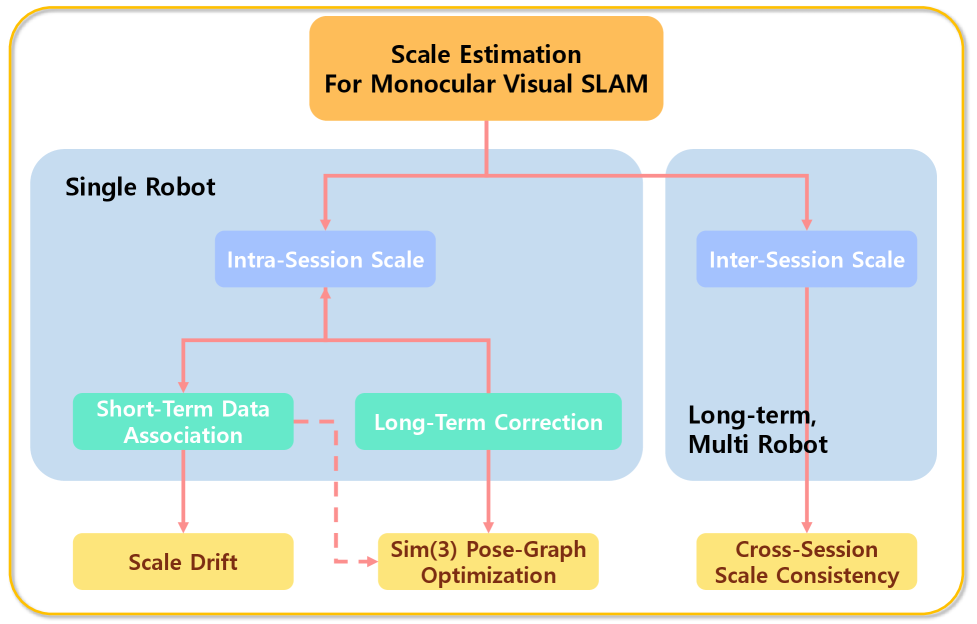

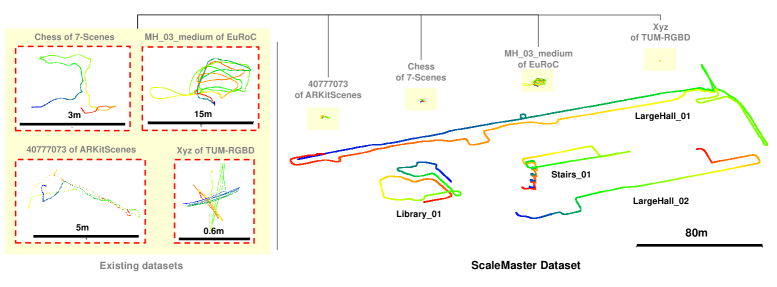

深度单目视觉SLAM近年来在精度和稠密重建方面取得了显著进展,但其在大规模室内环境中对尺度不一致的鲁棒性仍未得到充分研究。现有基准测试主要集中在房间尺度或结构简单的场景,未能充分解决会话内尺度漂移和会话间尺度模糊等关键问题。为了填补这一空白,我们推出了ScaleMaster数据集,这是第一个专门用于评估复杂场景下尺度一致性的基准,包括多层结构、长轨迹、重复视图和低纹理区域。我们系统地分析了现有深度单目视觉SLAM系统在尺度不一致性方面的脆弱性,提供了定量和定性的评估。我们的分析超越了传统的轨迹指标,包括使用Chamfer距离等指标对高保真3D真值进行直接的地图到地图的质量评估。结果表明,虽然现有的深度单目视觉SLAM系统在现有基准测试中表现出色,但在真实的、大规模室内环境中,它们会遭受严重的尺度相关故障。通过发布ScaleMaster数据集和基线结果,我们旨在为未来开发尺度一致且可靠的视觉SLAM系统奠定基础。

🔬 方法详解

问题定义:现有深度单目视觉SLAM系统在小规模、结构简单的场景中表现良好,但在大规模、复杂结构的室内环境中,由于长期尺度漂移和会话间尺度模糊,导致尺度不一致性问题严重,限制了其在实际场景中的应用。现有数据集难以充分评估和暴露这些问题。

核心思路:通过构建一个专门针对尺度一致性问题的数据集,ScaleMaster,来系统地评估现有深度单目SLAM系统在复杂场景下的性能。该数据集包含多层结构、长轨迹、重复视图和低纹理区域等挑战,旨在暴露现有方法在尺度估计方面的不足。

技术框架:ScaleMaster数据集的构建流程包括:数据采集(使用高精度传感器获取RGB-D数据),数据处理(包括噪声过滤、数据对齐等),以及真值生成(使用SLAM算法或人工标注生成高精度的3D地图)。同时,论文还提供了基于现有深度单目SLAM算法的基线结果,作为评估新算法的参考。评估指标包括传统的轨迹精度指标(如ATE, RMSE),以及地图到地图的质量评估指标(如Chamfer Distance)。

关键创新:ScaleMaster数据集是第一个专门针对深度单目SLAM尺度一致性问题设计的基准数据集。它不仅提供了具有挑战性的场景,还提供了高精度的3D真值地图,以及全面的评估指标,包括轨迹精度和地图质量。这使得研究人员能够更全面地评估和比较不同SLAM算法的尺度一致性性能。

关键设计:ScaleMaster数据集的关键设计包括:1) 多层结构:模拟真实室内环境的多层结构,增加尺度漂移的可能性;2) 长轨迹:模拟长时间的SLAM过程,暴露长期尺度漂移问题;3) 重复视图:模拟SLAM系统在重复场景中的表现,考察其对尺度一致性的影响;4) 低纹理区域:模拟低纹理环境,增加特征提取的难度,从而影响尺度估计的准确性。此外,数据集还提供了多种传感器数据,包括RGB图像、深度图像和IMU数据,方便研究人员进行多模态融合。

🖼️ 关键图片

📊 实验亮点

实验结果表明,现有的深度单目SLAM系统在ScaleMaster数据集上表现出显著的尺度不一致性问题,例如,在长轨迹中出现明显的尺度漂移,导致重建地图的质量下降。与在现有数据集上的良好表现形成鲜明对比,突显了ScaleMaster数据集的价值和必要性。

🎯 应用场景

该研究成果可应用于机器人导航、增强现实、三维重建等领域。通过提升深度单目SLAM系统的尺度一致性,可以使其在更大规模、更复杂的环境中稳定运行,为机器人提供更可靠的定位和地图信息,从而实现更智能的自主导航和交互。

📄 摘要(原文)

Recent advances in deep monocular visual Simultaneous Localization and Mapping (SLAM) have achieved impressive accuracy and dense reconstruction capabilities, yet their robustness to scale inconsistency in large-scale indoor environments remains largely unexplored. Existing benchmarks are limited to room-scale or structurally simple settings, leaving critical issues of intra-session scale drift and inter-session scale ambiguity insufficiently addressed. To fill this gap, we introduce the ScaleMaster Dataset, the first benchmark explicitly designed to evaluate scale consistency under challenging scenarios such as multi-floor structures, long trajectories, repetitive views, and low-texture regions. We systematically analyze the vulnerability of state-of-the-art deep monocular visual SLAM systems to scale inconsistency, providing both quantitative and qualitative evaluations. Crucially, our analysis extends beyond traditional trajectory metrics to include a direct map-to-map quality assessment using metrics like Chamfer distance against high-fidelity 3D ground truth. Our results reveal that while recent deep monocular visual SLAM systems demonstrate strong performance on existing benchmarks, they suffer from severe scale-related failures in realistic, large-scale indoor environments. By releasing the ScaleMaster dataset and baseline results, we aim to establish a foundation for future research toward developing scale-consistent and reliable visual SLAM systems.