GrandTour: A Legged Robotics Dataset in the Wild for Multi-Modal Perception and State Estimation

作者: Jonas Frey, Turcan Tuna, Frank Fu, Katharine Patterson, Tianao Xu, Maurice Fallon, Cesar Cadena, Marco Hutter

分类: cs.RO

发布日期: 2026-02-20

备注: Jonas Frey and Turcan Tuna contributed equally. Submitted to Sage The International Journal of Robotics Research

💡 一句话要点

GrandTour:用于多模态感知和状态估计的野外足式机器人数据集

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 足式机器人 数据集 多模态感知 状态估计 SLAM 机器人导航 环境感知

📋 核心要点

- 现有足式机器人数据集难以捕捉真实世界复杂环境,限制了状态估计、感知和导航算法的开发与评估。

- GrandTour数据集旨在提供大规模、多模态的足式机器人数据,涵盖多种复杂环境和操作场景,促进相关算法研究。

- 该数据集包含多种传感器数据和高精度地面实况轨迹,支持SLAM、状态估计和多模态学习等任务的研究。

📝 摘要(中文)

为了满足复杂、大规模环境中自主足式机器人对精确状态估计和多模态感知的需求,本文提出了GrandTour数据集。该数据集是首个大规模公开的足式机器人数据集,捕捉了真实世界条件,可用于开发和评估足式机器人状态估计、感知和导航算法。GrandTour数据集通过配备多模态传感器载荷的ANYbotics ANYmal-D四足机器人,在具有挑战性的室内外环境中采集数据,涵盖了从高山风光、森林到拆毁的建筑物和城市区域等多种场景,以及尺度、复杂性、光照和天气条件的大范围变化。该数据集提供来自旋转激光雷达、具有互补特性的多个RGB相机、本体感受传感器和立体深度相机的时间同步传感器数据。此外,它还包括来自基于卫星的RTK-GNSS和Leica Geosystems全站仪的高精度地面实况轨迹。该数据集支持SLAM、高精度状态估计和多模态学习方面的研究,能够对足式机器人系统中传感器融合的新方法进行严格的评估和开发。凭借其广泛的范围,GrandTour代表了迄今为止最大的开放获取足式机器人数据集。

🔬 方法详解

问题定义:现有足式机器人数据集规模小,环境单一,难以满足复杂真实场景下状态估计、感知和导航算法的训练和评估需求。缺乏高质量的地面实况数据也是一个痛点。

核心思路:通过在各种具有挑战性的真实环境中采集大规模多模态数据,并提供高精度的地面实况轨迹,为足式机器人算法的研究提供可靠的数据基础。核心在于尽可能覆盖真实场景的多样性,包括环境、光照、天气等因素。

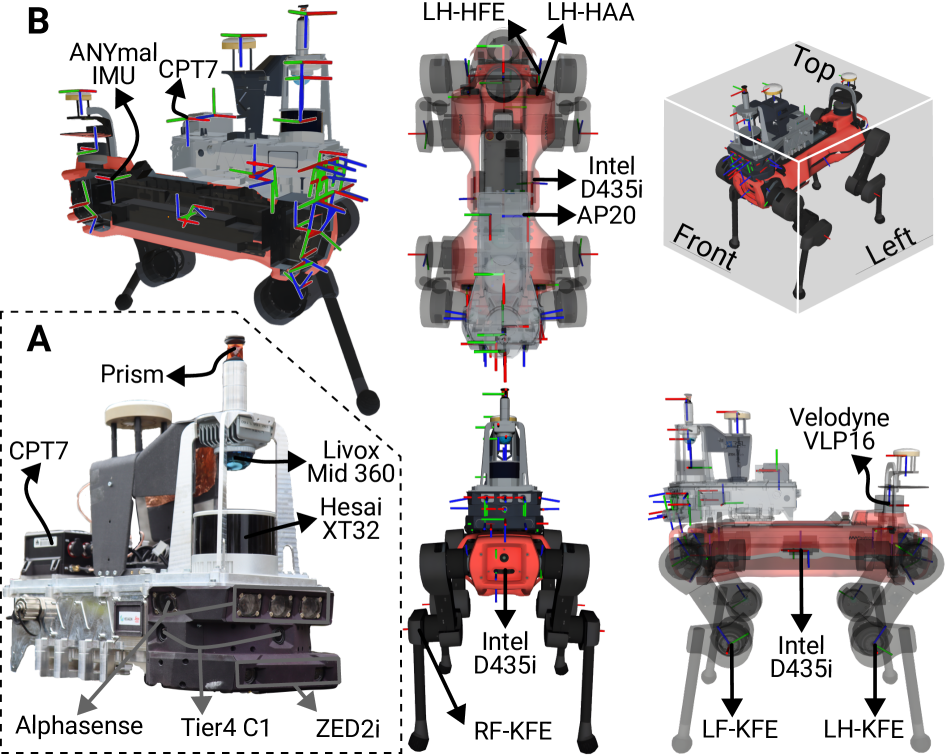

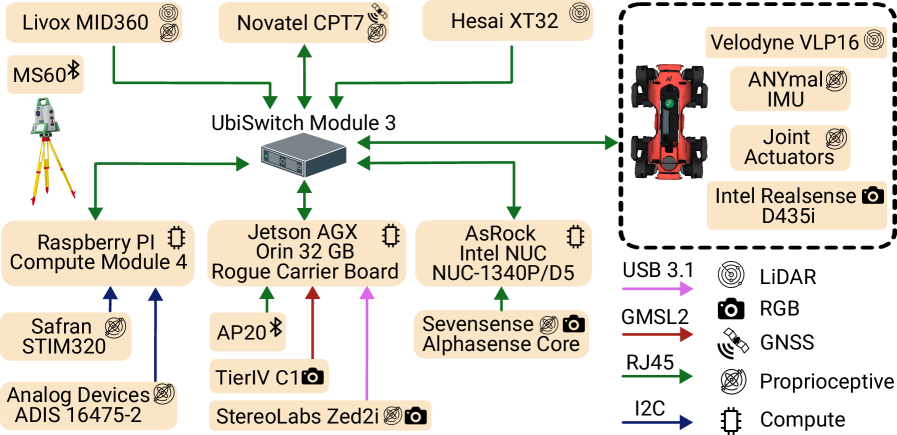

技术框架:GrandTour数据集的构建主要包含数据采集和数据处理两个阶段。数据采集阶段使用ANYbotics ANYmal-D四足机器人,搭载包括旋转激光雷达、多个RGB相机、本体感受传感器和立体深度相机在内的多模态传感器。数据处理阶段主要进行传感器数据的同步、校准,以及地面实况轨迹的生成。

关键创新:GrandTour数据集的关键创新在于其规模和多样性。它是迄今为止最大的开放获取足式机器人数据集,涵盖了从高山到城市等多种复杂环境。此外,该数据集还提供了高精度的地面实况轨迹,这对于状态估计算法的评估至关重要。

关键设计:数据集采集过程中,选择了具有代表性的环境和操作场景,并尽可能覆盖不同的光照和天气条件。地面实况轨迹的生成采用了RTK-GNSS和全站仪相结合的方法,以保证精度。数据集以ROS-independent和ROS两种格式发布,方便不同研究人员使用。

🖼️ 关键图片

📊 实验亮点

GrandTour数据集是目前最大的公开足式机器人数据集,包含多种传感器数据和高精度地面实况轨迹。它涵盖了从高山到城市等多种复杂环境,为足式机器人算法的研究提供了丰富的数据基础。通过该数据集,研究人员可以更有效地开发和评估足式机器人在真实环境下的性能。

🎯 应用场景

GrandTour数据集可广泛应用于足式机器人导航、SLAM、状态估计、环境感知等领域的研究。它能够促进相关算法在复杂真实环境下的性能提升,加速足式机器人在搜索救援、巡检、物流等领域的实际应用。未来,该数据集还可用于训练和评估基于深度学习的足式机器人控制策略。

📄 摘要(原文)

Accurate state estimation and multi-modal perception are prerequisites for autonomous legged robots in complex, large-scale environments. To date, no large-scale public legged-robot dataset captures the real-world conditions needed to develop and benchmark algorithms for legged-robot state estimation, perception, and navigation. To address this, we introduce the GrandTour dataset, a multi-modal legged-robotics dataset collected across challenging outdoor and indoor environments, featuring an ANYbotics ANYmal-D quadruped equipped with the \boxi multi-modal sensor payload. GrandTour spans a broad range of environments and operational scenarios across distinct test sites, ranging from alpine scenery and forests to demolished buildings and urban areas, and covers a wide variation in scale, complexity, illumination, and weather conditions. The dataset provides time-synchronized sensor data from spinning LiDARs, multiple RGB cameras with complementary characteristics, proprioceptive sensors, and stereo depth cameras. Moreover, it includes high-precision ground-truth trajectories from satellite-based RTK-GNSS and a Leica Geosystems total station. This dataset supports research in SLAM, high-precision state estimation, and multi-modal learning, enabling rigorous evaluation and development of new approaches to sensor fusion in legged robotic systems. With its extensive scope, GrandTour represents the largest open-access legged-robotics dataset to date. The dataset is available at https://grand-tour.leggedrobotics.com, on HuggingFace (ROS-independent), and in ROS formats, along with tools and demo resources.