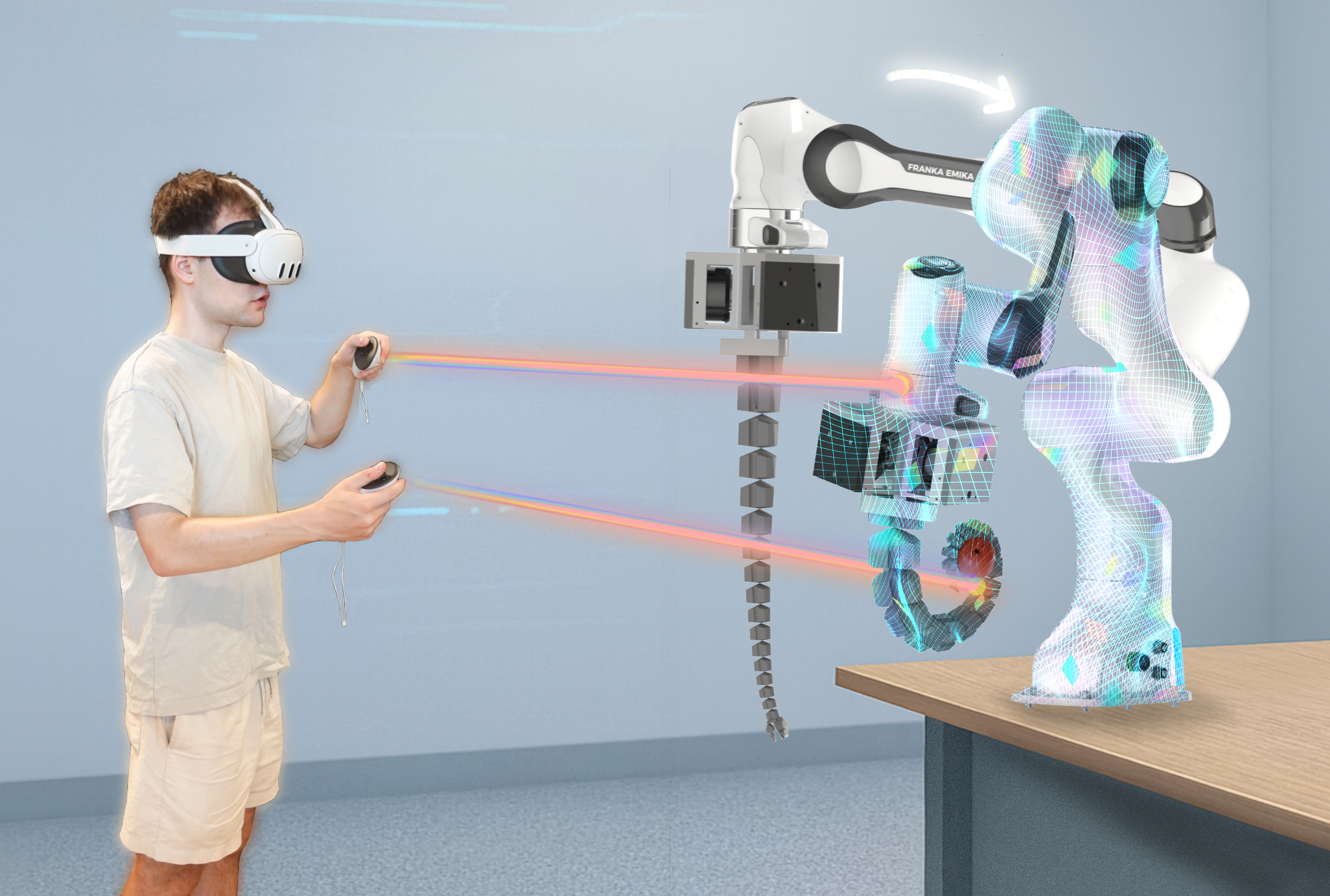

Physical Human-Robot Interaction for Grasping in Augmented Reality via Rigid-Soft Robot Synergy

作者: Huishi Huang, Jack Klusmann, Haozhe Wang, Shuchen Ji, Fengkang Ying, Yiyuan Zhang, John Nassour, Gordon Cheng, Daniela Rus, Jun Liu, Marcelo H Ang, Cecilia Laschi

分类: cs.RO

发布日期: 2026-02-19

备注: Camera-ready version for RoboSoft 2026. 8 pages, 6 figures

💡 一句话要点

提出基于增强现实的混合刚柔机器人人机交互框架,用于抓取任务

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 增强现实 人机交互 混合刚柔机器人 遥操作 参数识别

📋 核心要点

- 混合刚柔机器人在非结构化环境中具有潜力,但建模、感知和控制复杂,难以协调。

- 利用增强现实技术,用户可直接与虚拟机器人交互,并在物理机器人上复现,实现直观遥操作。

- 通过实物参数识别,确保虚拟模型与真实机器人行为一致,提高控制精度和可靠性。

📝 摘要(中文)

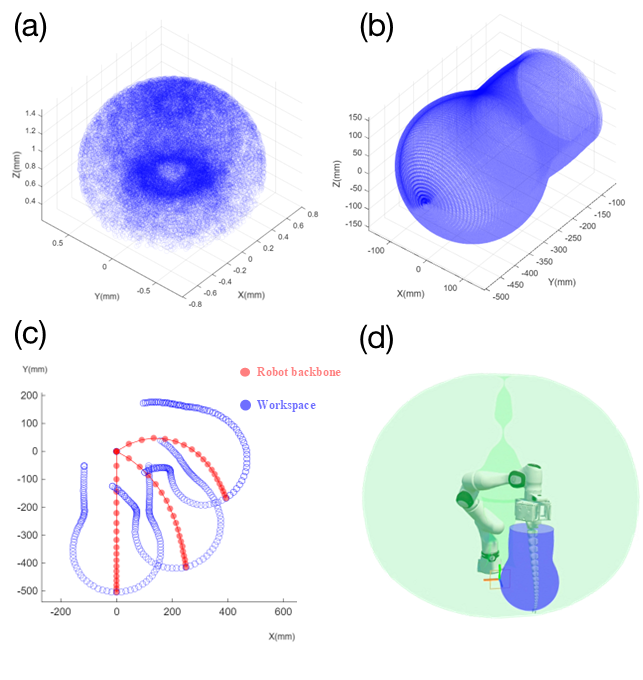

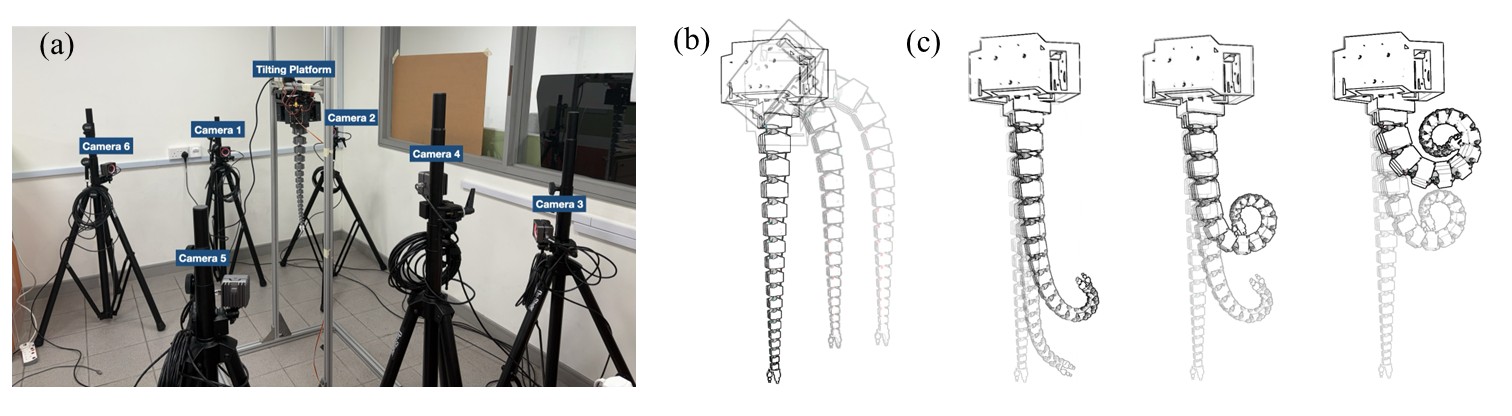

混合刚柔机器人结合了刚性机械臂的精度和柔性臂的顺应性与适应性,为非结构化环境中的通用抓取提供了一种有前景的方法。然而,由于建模、感知和跨域运动学方面的困难,协调混合机器人仍然具有挑战性。本文提出了一种新颖的基于增强现实(AR)的物理人机交互框架,该框架能够直接遥操作混合刚柔机器人,以执行简单的到达和抓取任务。使用AR头显,用户可以与集成到通用物理引擎中的机器人系统的模拟模型进行交互,该模型叠加在真实系统上,从而可以在实际部署之前进行模拟执行。为了确保虚拟机器人和物理机器人之间行为的一致性,我们引入了一种真实的参数识别管道,该管道利用了软机器人固有的几何特性,从而能够准确地建模其静态和动态行为以及控制系统的响应。

🔬 方法详解

问题定义:现有混合刚柔机器人的控制面临挑战,主要痛点在于难以准确建模软体部分的动态特性,导致虚拟环境与真实环境存在差异,影响遥操作的精度和可靠性。此外,跨域运动学问题也增加了控制的复杂性。

核心思路:论文的核心思路是利用增强现实技术,将虚拟机器人模型叠加到真实机器人系统上,用户通过AR界面直接与虚拟模型交互,实现对真实机器人的遥操作。为了保证虚拟环境与真实环境的一致性,提出了一个实物参数识别流程,用于精确建模软体机器人的动态特性。

技术框架:该框架包含以下几个主要模块:1) AR人机交互界面:用户通过AR头显观察和控制虚拟机器人。2) 物理引擎:用于模拟机器人的运动和力学行为。3) 刚柔混合机器人:实际的机器人系统。4) 实物参数识别模块:用于识别软体机器人的静态和动态参数,并更新到虚拟模型中。整体流程是:用户在AR界面中操作虚拟机器人,物理引擎计算机器人的运动状态,控制指令发送到真实机器人,同时,实物参数识别模块不断优化虚拟模型参数,使其与真实机器人行为一致。

关键创新:该论文的关键创新在于将增强现实技术与实物参数识别相结合,实现对混合刚柔机器人的精确遥操作。通过AR界面,用户可以直观地与机器人交互,降低了操作难度。实物参数识别模块能够自动校正虚拟模型,保证了虚拟环境与真实环境的一致性,提高了控制精度。

关键设计:实物参数识别模块是关键。它利用软体机器人的几何特性,设计了一套参数估计方法,包括静态参数(如形状、质量分布)和动态参数(如刚度、阻尼)。具体实现细节未知,但可以推测使用了优化算法,通过最小化虚拟机器人和真实机器人运动轨迹之间的差异来估计参数。

🖼️ 关键图片

📊 实验亮点

论文提出了一个完整的AR人机交互框架,并验证了其在混合刚柔机器人抓取任务中的有效性。虽然论文中没有给出具体的性能数据,但通过实物参数识别,可以显著提高虚拟模型与真实机器人行为的一致性,从而提升遥操作的精度和可靠性。与传统的遥操作方法相比,该方法具有更高的直观性和易用性。

🎯 应用场景

该研究成果可应用于远程医疗、危险环境作业、精密装配等领域。例如,医生可以通过AR界面远程操控机器人进行微创手术;消防员可以操控机器人进入火灾现场进行救援;工程师可以操控机器人进行高精度零件装配。该技术有望提高工作效率、降低操作风险,并拓展机器人的应用范围。

📄 摘要(原文)

Hybrid rigid-soft robots combine the precision of rigid manipulators with the compliance and adaptability of soft arms, offering a promising approach for versatile grasping in unstructured environments. However, coordinating hybrid robots remains challenging, due to difficulties in modeling, perception, and cross-domain kinematics. In this work, we present a novel augmented reality (AR)-based physical human-robot interaction framework that enables direct teleoperation of a hybrid rigid-soft robot for simple reaching and grasping tasks. Using an AR headset, users can interact with a simulated model of the robotic system integrated into a general-purpose physics engine, which is superimposed on the real system, allowing simulated execution prior to real-world deployment. To ensure consistent behavior between the virtual and physical robots, we introduce a real-to-simulation parameter identification pipeline that leverages the inherent geometric properties of the soft robot, enabling accurate modeling of its static and dynamic behavior as well as the control system's response.