EgoScale: Scaling Dexterous Manipulation with Diverse Egocentric Human Data

作者: Ruijie Zheng, Dantong Niu, Yuqi Xie, Jing Wang, Mengda Xu, Yunfan Jiang, Fernando Castañeda, Fengyuan Hu, You Liang Tan, Letian Fu, Trevor Darrell, Furong Huang, Yuke Zhu, Danfei Xu, Linxi Fan

分类: cs.RO

发布日期: 2026-02-18

💡 一句话要点

EgoScale:利用大规模第一人称视角人类数据扩展灵巧操作

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱六:视频提取与匹配 (Video Extraction) 支柱七:动作重定向 (Motion Retargeting) 支柱八:物理动画 (Physics-based Animation) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 灵巧操作 人机迁移 第一人称视角 大规模数据 视觉语言动作模型

📋 核心要点

- 现有方法难以有效利用人类行为数据进行高自由度灵巧操作学习,缺乏大规模人类数据驱动的迁移学习框架。

- EgoScale通过大规模第一人称视角人类数据预训练VLA模型,并结合轻量级人机对齐训练,实现高效的灵巧操作迁移。

- 实验表明,EgoScale显著提升了机器人灵巧操作的成功率,并具备良好的泛化能力,可迁移至不同自由度的机械手。

📝 摘要(中文)

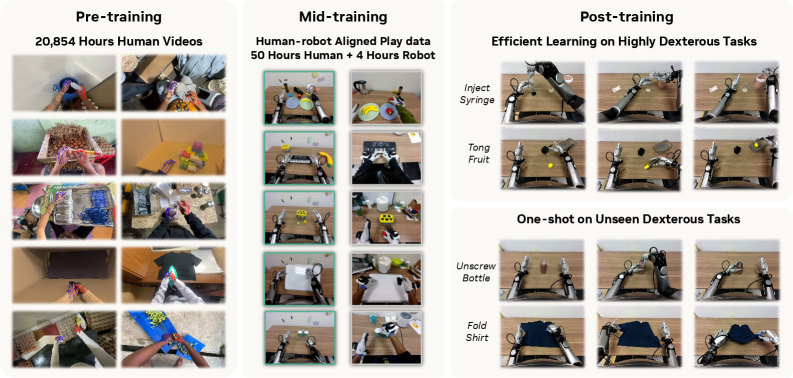

本文提出了EgoScale,一个基于大规模第一人称视角人类数据的人机灵巧操作迁移框架。该框架在一个包含超过20854小时动作标注的第一人称视角人类视频数据集上训练了一个视觉-语言-动作(VLA)模型,数据规模是先前工作的20倍以上,并揭示了人类数据规模与验证损失之间的对数线性比例关系。验证损失与下游真实机器人性能密切相关,表明大规模人类数据是一个可预测的监督来源。此外,本文还提出了一种简单的两阶段迁移方法:大规模人类预训练,然后进行轻量级对齐的人机中期训练。这使得强大的长时程灵巧操作和单样本任务适应成为可能,并且只需要最少的机器人监督。最终策略在使用22自由度灵巧机械手时,平均成功率比没有预训练的基线提高了54%,并且可以有效地迁移到具有较低自由度机械手的机器人上,表明大规模人类运动提供了一种可重用且与具体形态无关的运动先验。

🔬 方法详解

问题定义:论文旨在解决如何有效利用大规模人类行为数据,特别是第一人称视角视频数据,来提升机器人灵巧操作能力的问题。现有方法通常依赖于少量人工标注数据或复杂的强化学习,难以扩展到高自由度、长时程的灵巧操作任务。此外,现有方法在人机迁移方面存在挑战,难以充分利用人类的运动智能。

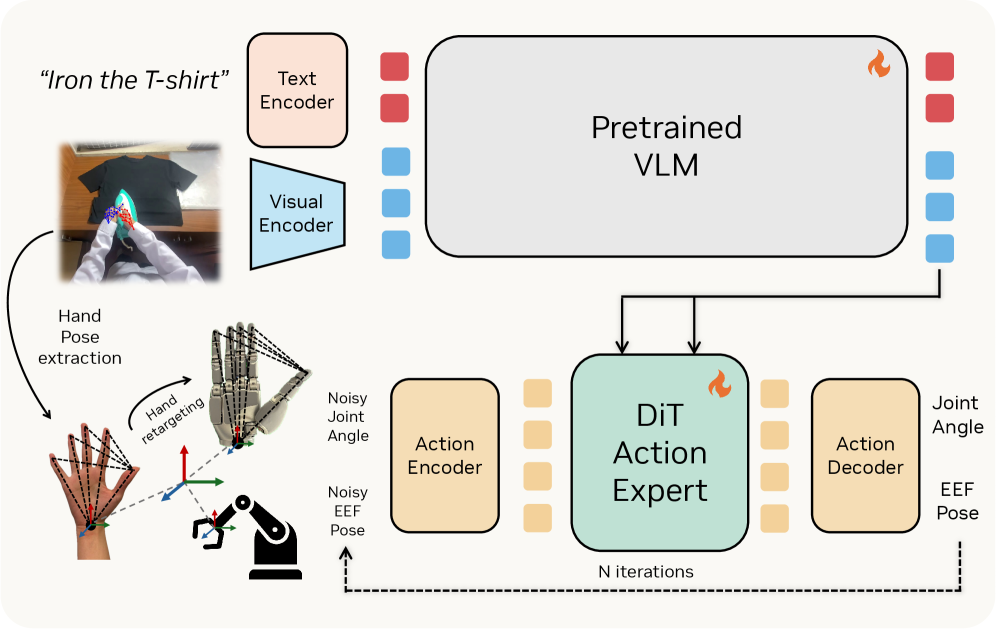

核心思路:论文的核心思路是利用大规模第一人称视角人类视频数据作为预训练数据,学习通用的运动先验知识。通过视觉-语言-动作(VLA)模型,将人类的视觉感知、语言指令和动作执行联系起来。然后,通过轻量级的人机对齐训练,将预训练模型迁移到机器人上,实现高效的灵巧操作。

技术框架:EgoScale框架包含两个主要阶段:1) 大规模人类数据预训练:使用超过20000小时的第一人称视角视频数据训练VLA模型,学习人类的运动模式和操作策略。2) 轻量级人机对齐训练:使用少量机器人数据对预训练模型进行微调,使其适应机器人的运动学和动力学特性。该框架使用视觉输入(第一人称视角图像)、语言指令和动作输出(机械手关节角度)作为VLA模型的输入和输出。

关键创新:论文的关键创新在于:1) 提出了EgoScale框架,将大规模人类数据与机器人学习相结合,实现高效的灵巧操作迁移。2) 揭示了人类数据规模与机器人性能之间的对数线性比例关系,验证了大规模人类数据作为监督信号的有效性。3) 提出了一种简单的两阶段迁移方法,即大规模人类预训练和轻量级人机对齐训练,降低了机器人学习的成本。

关键设计:VLA模型采用Transformer架构,将视觉特征、语言指令和动作序列编码到统一的嵌入空间中。损失函数包括动作预测损失、语言理解损失和视觉重建损失。人机对齐训练使用少量机器人数据,通过微调VLA模型的参数,使其适应机器人的运动学和动力学特性。论文还探索了不同的数据增强方法,以提高模型的泛化能力。

🖼️ 关键图片

📊 实验亮点

实验结果表明,EgoScale框架在使用22自由度灵巧机械手时,平均成功率比没有预训练的基线提高了54%。此外,EgoScale框架可以有效地迁移到具有较低自由度机械手的机器人上,表明大规模人类运动提供了一种可重用且与具体形态无关的运动先验。实验还验证了人类数据规模与机器人性能之间的对数线性比例关系。

🎯 应用场景

EgoScale框架可应用于各种需要灵巧操作的机器人任务,例如家庭服务机器人、工业自动化、医疗手术机器人等。通过利用大规模人类数据,可以降低机器人学习的成本,提高机器人的操作能力和泛化能力。该研究为机器人学习提供了一种新的思路,有望推动机器人技术的发展。

📄 摘要(原文)

Human behavior is among the most scalable sources of data for learning physical intelligence, yet how to effectively leverage it for dexterous manipulation remains unclear. While prior work demonstrates human to robot transfer in constrained settings, it is unclear whether large scale human data can support fine grained, high degree of freedom dexterous manipulation. We present EgoScale, a human to dexterous manipulation transfer framework built on large scale egocentric human data. We train a Vision Language Action (VLA) model on over 20,854 hours of action labeled egocentric human video, more than 20 times larger than prior efforts, and uncover a log linear scaling law between human data scale and validation loss. This validation loss strongly correlates with downstream real robot performance, establishing large scale human data as a predictable supervision source. Beyond scale, we introduce a simple two stage transfer recipe: large scale human pretraining followed by lightweight aligned human robot mid training. This enables strong long horizon dexterous manipulation and one shot task adaptation with minimal robot supervision. Our final policy improves average success rate by 54% over a no pretraining baseline using a 22 DoF dexterous robotic hand, and transfers effectively to robots with lower DoF hands, indicating that large scale human motion provides a reusable, embodiment agnostic motor prior.