Markerless Robot Detection and 6D Pose Estimation for Multi-Agent SLAM

作者: Markus Rueggeberg, Maximilian Ulmer, Maximilian Durner, Wout Boerdijk, Marcus Gerhard Mueller, Rudolph Triebel, Riccardo Giubilato

分类: cs.RO

发布日期: 2026-02-18

备注: Accepted contribution to ICRA 2026

💡 一句话要点

提出一种无需marker的多机器人SLAM方法,利用深度学习进行机器人检测和6D位姿估计。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 多机器人SLAM 无需marker 6D位姿估计 深度学习 机器人检测

📋 核心要点

- 传统多机器人SLAM依赖信标marker,易受光照和遮挡影响,限制了观测范围和鲁棒性。

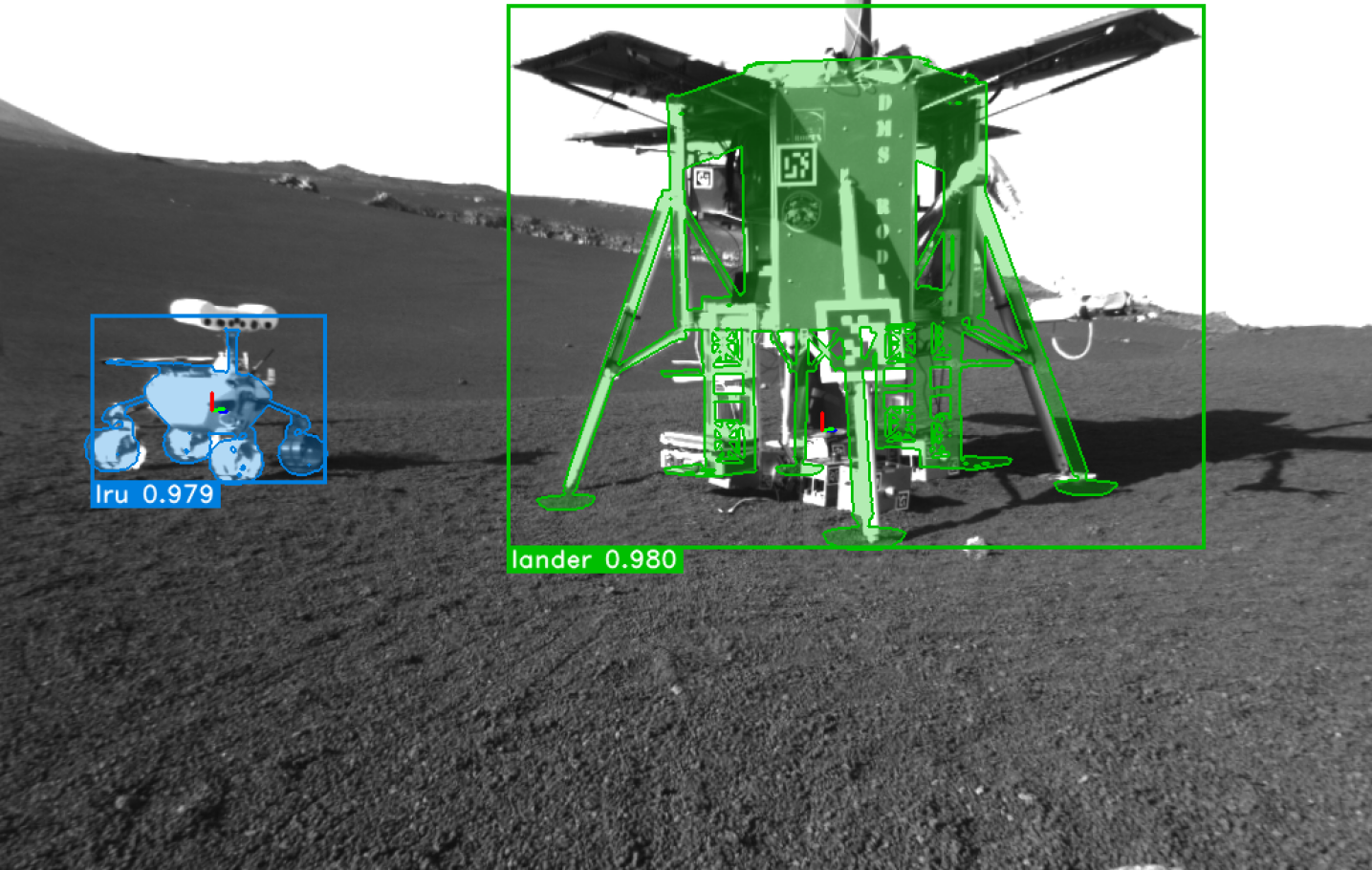

- 利用深度学习进行无需marker的机器人6D位姿估计,实现更灵活和鲁棒的机器人间数据关联。

- 实验验证了该方法在行星模拟环境中,能够提升多机器人SLAM系统的相对定位精度。

📝 摘要(中文)

多机器人SLAM方法融合来自不同观测者的定位历史和地图的能力,常常受到数据关联建立难度的挑战。在感知混淆或视角差异显著的情况下,不同机器人之间的回环检测容易受到影响。因此,机器人之间的直接相互观测是连接局部SLAM图的有效方式,但通常依赖于标定过的信标标记阵列(例如,AprilTag阵列),这严重限制了观测范围,并且在强烈的光照条件下(例如,反射或过度曝光)经常失效。本文提出了一种新的解决方案,利用了基于深度学习的6D位姿估计的最新进展。我们将无需marker的位姿估计作为去中心化多机器人SLAM系统的一部分,并证明了其对机器人团队之间相对定位精度的益处。该解决方案在行星模拟环境的测试场活动中记录的数据上进行了实验验证。

🔬 方法详解

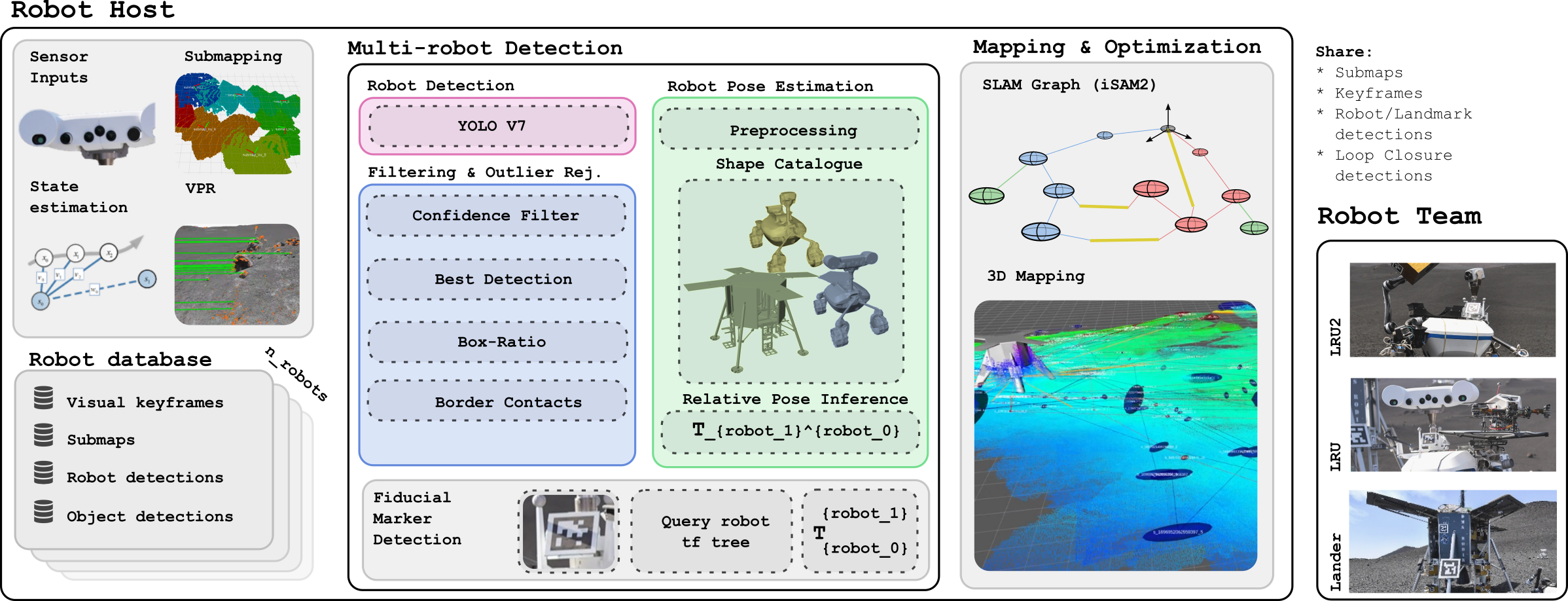

问题定义:多机器人SLAM中,建立不同机器人之间的有效数据关联是一个关键问题。传统方法依赖于预先标定的信标marker(如AprilTag),但这些marker在实际应用中存在诸多限制,例如观测范围受限、易受光照条件影响、易被遮挡等。这些限制降低了多机器人SLAM系统的鲁棒性和适用性。

核心思路:本文的核心思路是利用深度学习技术,实现无需marker的机器人检测和6D位姿估计。通过直接从图像中识别其他机器人并估计其位姿,可以避免对marker的依赖,从而提高系统的灵活性和鲁棒性。这种方法使得机器人可以在更广泛的环境和更复杂的光照条件下进行协作SLAM。

技术框架:该方法将无需marker的位姿估计集成到去中心化的多机器人SLAM系统中。整体流程包括:1)每个机器人利用自身的传感器(如相机)获取环境图像;2)使用深度学习模型检测图像中的其他机器人,并估计其6D位姿;3)将估计的位姿信息用于机器人间的数据关联,从而连接局部SLAM图;4)通过图优化等方法,融合来自不同机器人的信息,构建全局一致的地图。

关键创新:该方法最重要的创新点在于将深度学习应用于多机器人SLAM中的机器人检测和位姿估计,从而摆脱了对marker的依赖。与传统方法相比,该方法具有更高的灵活性和鲁棒性,可以在更复杂的环境中应用。

关键设计:论文中没有详细说明具体的深度学习模型结构和训练细节,这部分信息未知。但可以推测,可能使用了基于卷积神经网络(CNN)的目标检测和位姿估计模型,例如YOLO、SSD等。损失函数可能包括目标检测的损失和位姿估计的损失,通过联合优化来提高模型的性能。具体的参数设置和网络结构需要参考相关的深度学习文献。

🖼️ 关键图片

📊 实验亮点

该论文在行星模拟环境中进行了实验验证,证明了所提出的无需marker的位姿估计方法能够提高多机器人SLAM系统的相对定位精度。具体的性能数据和提升幅度未知,但实验结果表明该方法具有实际应用价值。

🎯 应用场景

该研究成果可应用于各种多机器人协作场景,例如:搜救行动、协同巡逻、环境监测、农业机器人、仓储物流等。无需marker的设计使得机器人可以在复杂和动态的环境中进行协作,提高了系统的适应性和实用性。未来,该技术有望推动多机器人系统的广泛应用。

📄 摘要(原文)

The capability of multi-robot SLAM approaches to merge localization history and maps from different observers is often challenged by the difficulty in establishing data association. Loop closure detection between perceptual inputs of different robotic agents is easily compromised in the context of perceptual aliasing, or when perspectives differ significantly. For this reason, direct mutual observation among robots is a powerful way to connect partial SLAM graphs, but often relies on the presence of calibrated arrays of fiducial markers (e.g., AprilTag arrays), which severely limits the range of observations and frequently fails under sharp lighting conditions, e.g., reflections or overexposure. In this work, we propose a novel solution to this problem leveraging recent advances in Deep-Learning-based 6D pose estimation. We feature markerless pose estimation as part of a decentralized multi-robot SLAM system and demonstrate the benefit to the relative localization accuracy among the robotic team. The solution is validated experimentally on data recorded in a test field campaign on a planetary analogous environment.