Dex4D: Task-Agnostic Point Track Policy for Sim-to-Real Dexterous Manipulation

作者: Yuxuan Kuang, Sungjae Park, Katerina Fragkiadaki, Shubham Tulsiani

分类: cs.RO, cs.CV, cs.LG

发布日期: 2026-02-17

备注: Project page: https://dex4d.github.io/

💡 一句话要点

Dex4D:用于灵巧操作的、与任务无关的Sim-to-Real点追踪策略

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 灵巧操作 Sim-to-Real 点追踪 任务无关 零样本迁移

📋 核心要点

- 真实世界灵巧操作数据收集成本高昂且难以扩展,而现有仿真方法需要为每个任务设计环境和奖励。

- Dex4D学习与任务无关的3D点追踪策略,通过操纵物体到任意姿势,实现技能的灵活组合和零样本迁移。

- 实验表明,Dex4D在仿真和真实机器人上均表现出色,能够泛化到新物体、场景和轨迹,优于现有方法。

📝 摘要(中文)

本文提出Dex4D,一个利用仿真学习与任务无关的灵巧技能的框架,这些技能可以灵活地重新组合以执行各种真实世界的操作任务。Dex4D学习一种与领域无关的3D点追踪条件策略,能够将任何物体操纵到任何期望的姿势。该“Anypose-to-Anypose”策略在仿真中针对数千个具有不同姿势配置的物体进行训练,覆盖了广泛的机器人-物体交互空间,这些交互可以在测试时组合。在部署时,该策略可以通过从生成的视频中提取期望的以物体为中心的点轨迹来零样本迁移到真实世界的任务,而无需微调。在执行过程中,Dex4D使用在线点追踪进行闭环感知和控制。大量的仿真和真实机器人实验表明,该方法能够对各种灵巧操作任务进行零样本部署,并且相对于先前的基线产生了一致的改进。此外,还展示了对新物体、场景布局、背景和轨迹的强大泛化能力,突出了所提出框架的鲁棒性和可扩展性。

🔬 方法详解

问题定义:现有灵巧操作方法难以泛化到各种任务,主要瓶颈在于真实数据收集成本高,仿真训练需要针对特定任务设计环境和奖励函数,导致模型缺乏通用性和泛化能力。因此,需要一种能够学习通用灵巧操作技能,并能零样本迁移到真实世界的框架。

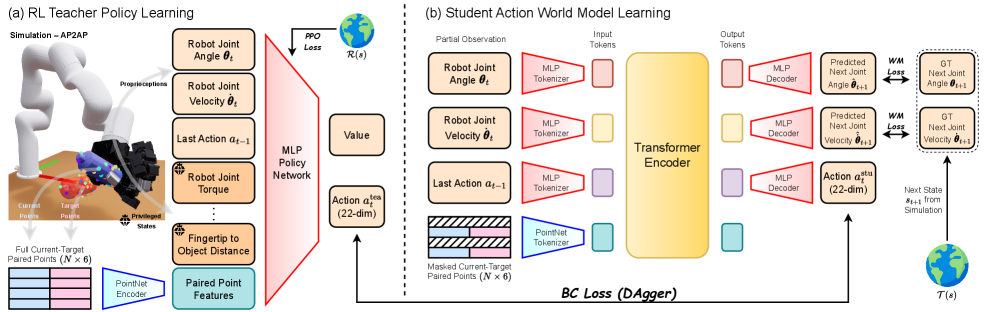

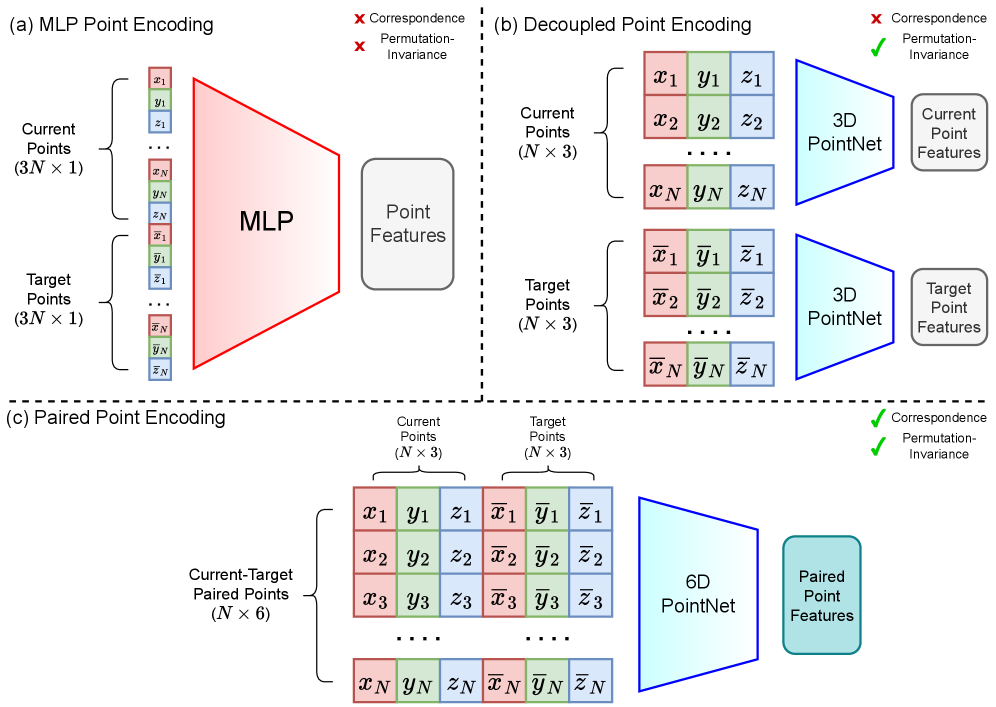

核心思路:Dex4D的核心思路是学习一种与任务无关的“Anypose-to-Anypose”策略,该策略能够将任何物体操纵到任何期望的姿势。通过在仿真环境中训练该策略,使其能够覆盖广泛的机器人-物体交互空间,从而获得更强的泛化能力。在部署时,通过提取期望的物体点轨迹作为输入,即可实现零样本迁移到真实世界。

技术框架:Dex4D框架主要包含两个阶段:训练阶段和部署阶段。在训练阶段,使用仿真环境生成大量数据,训练一个与任务无关的3D点追踪条件策略。该策略以当前物体姿势和目标姿势作为输入,输出机器人的动作。在部署阶段,首先从生成的视频中提取期望的物体点轨迹,然后将这些轨迹作为输入,驱动机器人执行操作任务。框架使用在线点追踪进行闭环感知和控制。

关键创新:Dex4D最重要的创新在于其与任务无关的设计。通过学习一种能够将任何物体操纵到任何期望姿势的通用策略,避免了为每个任务单独设计环境和奖励函数的需要。此外,通过使用3D点追踪作为感知和控制的接口,实现了零样本迁移到真实世界。

关键设计:Dex4D的关键设计包括:1) 使用大量的仿真数据进行训练,以覆盖广泛的机器人-物体交互空间;2) 设计一个3D点追踪条件策略,该策略能够根据当前物体姿势和目标姿势输出机器人的动作;3) 使用在线点追踪进行闭环感知和控制,以提高鲁棒性。

🖼️ 关键图片

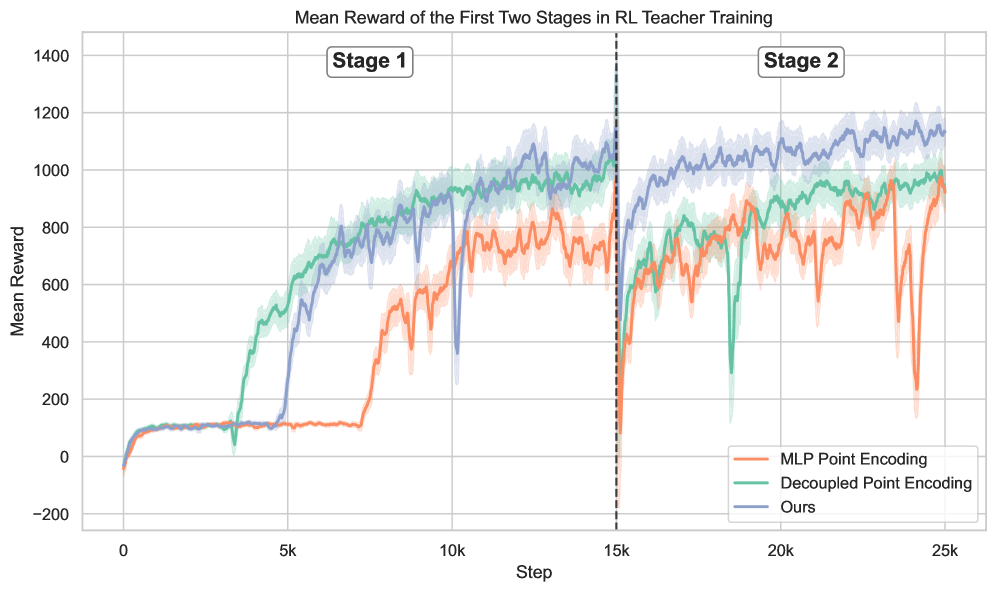

📊 实验亮点

Dex4D在仿真和真实机器人实验中均取得了显著成果。实验表明,Dex4D能够零样本迁移到各种灵巧操作任务,并且相对于先前的基线产生了一致的改进。此外,Dex4D还展示了对新物体、场景布局、背景和轨迹的强大泛化能力,证明了该框架的鲁棒性和可扩展性。

🎯 应用场景

Dex4D具有广泛的应用前景,例如:自动化装配、家庭服务机器人、医疗手术机器人等。该框架能够降低机器人开发的成本和难度,加速机器人在各个领域的应用。未来,可以进一步研究如何将Dex4D与其他感知和规划模块相结合,实现更复杂的机器人任务。

📄 摘要(原文)

Learning generalist policies capable of accomplishing a plethora of everyday tasks remains an open challenge in dexterous manipulation. In particular, collecting large-scale manipulation data via real-world teleoperation is expensive and difficult to scale. While learning in simulation provides a feasible alternative, designing multiple task-specific environments and rewards for training is similarly challenging. We propose Dex4D, a framework that instead leverages simulation for learning task-agnostic dexterous skills that can be flexibly recomposed to perform diverse real-world manipulation tasks. Specifically, Dex4D learns a domain-agnostic 3D point track conditioned policy capable of manipulating any object to any desired pose. We train this 'Anypose-to-Anypose' policy in simulation across thousands of objects with diverse pose configurations, covering a broad space of robot-object interactions that can be composed at test time. At deployment, this policy can be zero-shot transferred to real-world tasks without finetuning, simply by prompting it with desired object-centric point tracks extracted from generated videos. During execution, Dex4D uses online point tracking for closed-loop perception and control. Extensive experiments in simulation and on real robots show that our method enables zero-shot deployment for diverse dexterous manipulation tasks and yields consistent improvements over prior baselines. Furthermore, we demonstrate strong generalization to novel objects, scene layouts, backgrounds, and trajectories, highlighting the robustness and scalability of the proposed framework.