Improving MLLMs in Embodied Exploration and Question Answering with Human-Inspired Memory Modeling

作者: Ji Li, Jing Xia, Mingyi Li, Shiyan Hu

分类: cs.RO, cs.AI

发布日期: 2026-02-17

💡 一句话要点

提出基于人类记忆建模的MLLM框架,提升具身探索和问答能力

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 具身智能 多模态大语言模型 情景记忆 语义记忆 探索与问答 视觉推理 规则提取

📋 核心要点

- 现有方法依赖文本摘要,丢失视觉和空间细节,在非平稳环境中表现脆弱,这是核心问题。

- 论文核心在于解耦情景记忆和语义记忆,通过检索和推理辅助,实现经验的稳健重用和跨环境泛化。

- 实验结果表明,该方法在具身问答和探索任务中显著提升性能,情景记忆提升探索效率,语义记忆增强推理能力。

📝 摘要(中文)

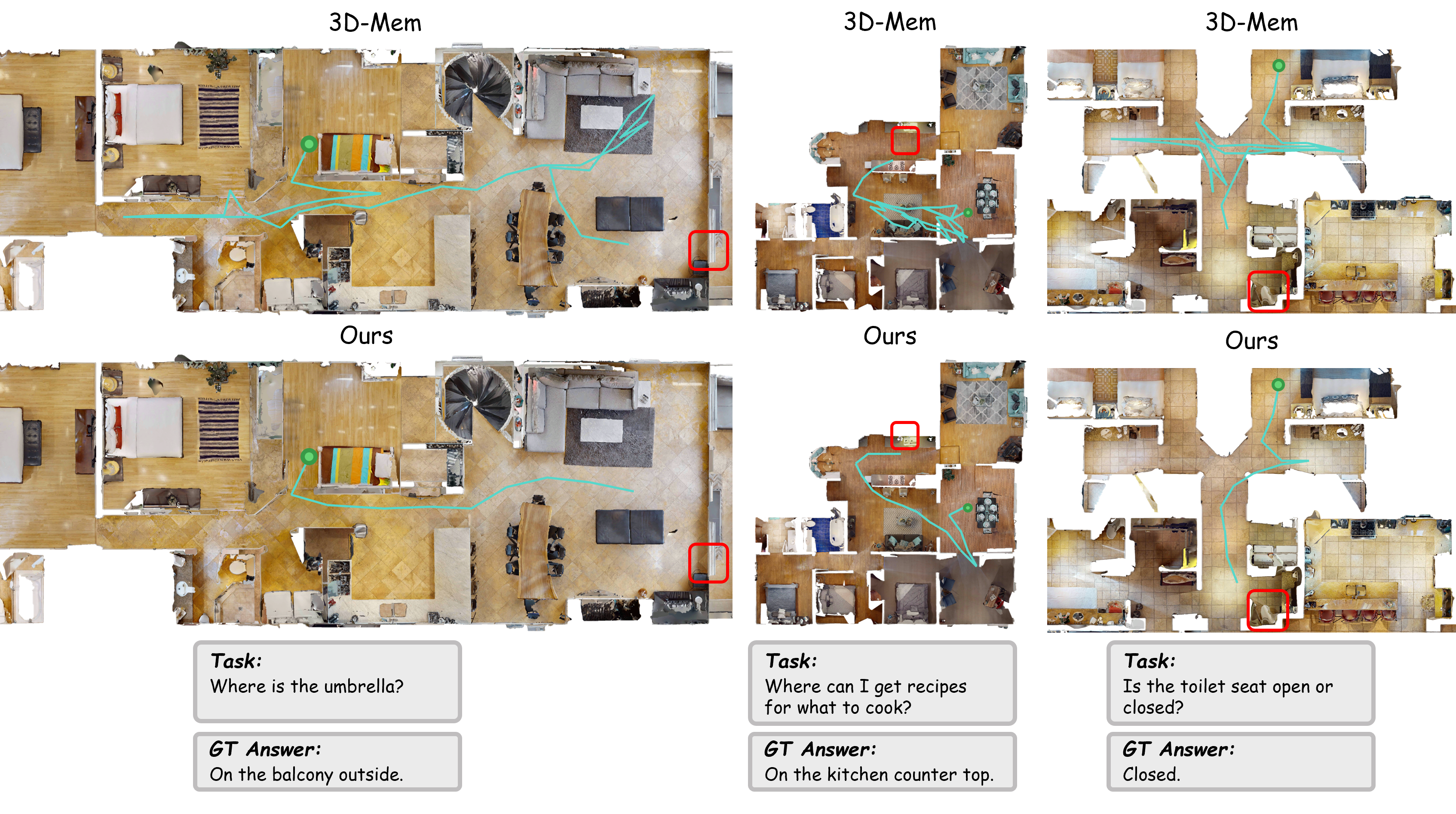

本文提出了一种非参数记忆框架,用于提升具身智能体在长时程观测和有限上下文预算下的多模态大语言模型(MLLM)性能。该框架显式地分离了情景记忆和语义记忆,用于具身探索和问答。采用“检索优先,推理辅助”的范式,通过语义相似性召回情景经验,并通过视觉推理验证,从而实现对过去观测的稳健重用,无需严格的几何对齐。同时,引入了一种程序式规则提取机制,将经验转换为结构化的、可重用的语义记忆,促进跨环境泛化。大量实验表明,该方法在具身问答和探索基准测试中取得了最先进的性能,在A-EQA上LLM-Match指标提升7.3%,LLM MatchXSPL指标提升11.4%,在GOAT-Bench上成功率提升7.7%,SPL提升6.8%。分析表明,情景记忆主要提高探索效率,而语义记忆则加强了具身智能体的复杂推理能力。

🔬 方法详解

问题定义:现有基于多模态大语言模型的具身智能体,在长时程观测和有限上下文预算下,难以有效利用历史信息进行探索和问答。现有方法通常依赖于文本摘要来存储和检索记忆,但这种方式会丢失丰富的视觉和空间细节,并且在环境变化时容易失效。因此,需要一种更有效、更鲁棒的记忆机制,能够充分利用历史经验,提升具身智能体的性能。

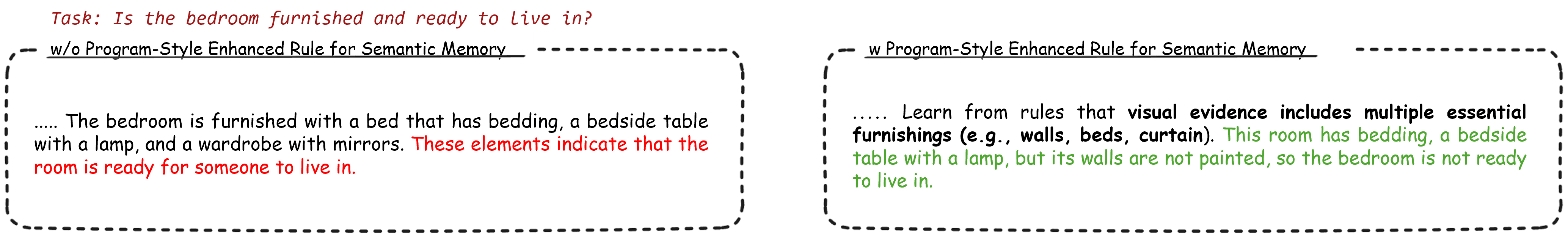

核心思路:论文的核心思路是模仿人类的记忆机制,将记忆分为情景记忆和语义记忆。情景记忆用于存储具体的经验,通过语义相似性进行检索,并通过视觉推理进行验证,从而实现对过去观测的灵活重用。语义记忆则用于存储抽象的知识,通过程序式规则提取机制将经验转换为结构化的知识,从而实现跨环境的泛化。

技术框架:整体框架包含情景记忆模块和语义记忆模块。情景记忆模块负责存储和检索过去的视觉经验,使用视觉编码器提取图像特征,并使用语义相似性度量进行检索。检索到的经验通过视觉推理模块进行验证,以确保其相关性和可靠性。语义记忆模块负责从经验中提取规则,使用程序式规则提取机制将经验转换为结构化的知识表示。这两个模块共同作用,为具身智能体提供全面的记忆支持。

关键创新:最重要的创新点在于显式地分离了情景记忆和语义记忆,并设计了相应的检索和推理机制。与现有方法相比,该方法能够更有效地利用历史经验,并且具有更强的鲁棒性和泛化能力。此外,程序式规则提取机制也是一个重要的创新,能够将经验转换为结构化的知识,从而促进跨环境的泛化。

关键设计:情景记忆的检索使用了余弦相似度来度量视觉特征的相似性。视觉推理模块使用了预训练的视觉语言模型来验证检索到的经验。程序式规则提取机制使用了基于规则的模板,将经验转换为if-then规则。损失函数包括检索损失和推理损失,用于优化情景记忆和语义记忆的性能。具体参数设置和网络结构在论文中有详细描述。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在A-EQA和GOAT-Bench等具身问答和探索基准测试中取得了显著的性能提升。在A-EQA上,LLM-Match指标提升7.3%,LLM MatchXSPL指标提升11.4%。在GOAT-Bench上,成功率提升7.7%,SPL提升6.8%。这些结果表明,该方法能够有效地提升具身智能体的探索效率和推理能力,并优于现有的方法。

🎯 应用场景

该研究成果可应用于各种需要长期记忆和复杂推理的具身智能任务,例如家庭服务机器人、自动驾驶、智能助手等。通过提升智能体对环境的理解和适应能力,可以使其在复杂环境中更好地完成任务,并提供更智能、更个性化的服务。未来,该方法有望进一步扩展到更广泛的机器人和人工智能领域。

📄 摘要(原文)

Deploying Multimodal Large Language Models as the brain of embodied agents remains challenging, particularly under long-horizon observations and limited context budgets. Existing memory assisted methods often rely on textual summaries, which discard rich visual and spatial details and remain brittle in non-stationary environments. In this work, we propose a non-parametric memory framework that explicitly disentangles episodic and semantic memory for embodied exploration and question answering. Our retrieval-first, reasoning-assisted paradigm recalls episodic experiences via semantic similarity and verifies them through visual reasoning, enabling robust reuse of past observations without rigid geometric alignment. In parallel, we introduce a program-style rule extraction mechanism that converts experiences into structured, reusable semantic memory, facilitating cross-environment generalization. Extensive experiments demonstrate state-of-the-art performance on embodied question answering and exploration benchmarks, yielding a 7.3% gain in LLM-Match and an 11.4% gain in LLM MatchXSPL on A-EQA, as well as +7.7% success rate and +6.8% SPL on GOAT-Bench. Analyses reveal that our episodic memory primarily improves exploration efficiency, while semantic memory strengthens complex reasoning of embodied agents.