SemanticFeels: Semantic Labeling during In-Hand Manipulation

作者: Anas Al Shikh Khalil, Haozhi Qi, Roberto Calandra

分类: cs.RO, cs.AI, cs.CV

发布日期: 2026-02-15

备注: 10 pages, 5 figures

💡 一句话要点

SemanticFeels:结合视觉触觉,实现手内操作中的语义标签与形状重建

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 手内操作 语义标签 神经隐式表示 触觉感知 材料分类

📋 核心要点

- 机器人日益融入日常任务,在手内操作中感知物体的形状和属性至关重要,这对于自适应和智能行为至关重要。

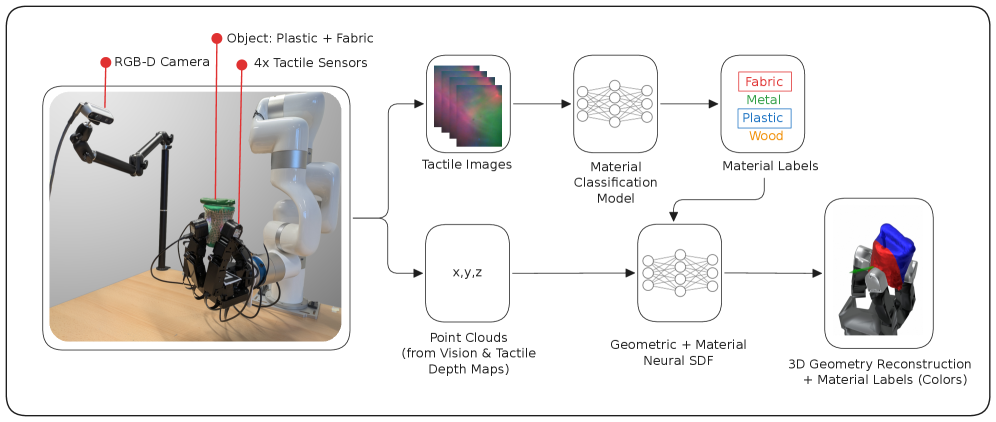

- SemanticFeels框架将语义标签与神经隐式形状表示相结合,利用视觉和触觉信息,实现物体形状重建和材料分类。

- 实验表明,该系统在单材料和多材料物体上均表现出良好的材料识别能力,在多材料物体操作中平均匹配准确率达到79.87%。

📝 摘要(中文)

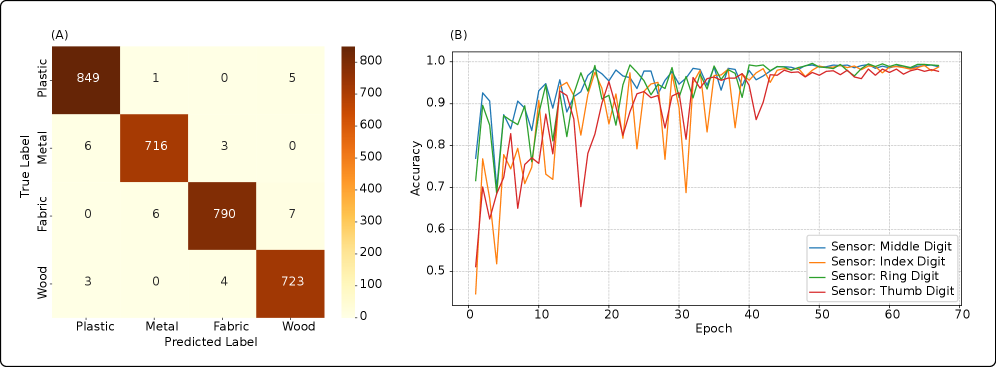

本文提出SemanticFeels,扩展了NeuralFeels框架,集成了语义标签与神经隐式形状表示,利用视觉和触觉信息。以材料分类为例,高分辨率Digit触觉读数通过微调的EfficientNet-B0卷积神经网络(CNN)处理,生成局部材料预测,然后嵌入到增强的符号距离场(SDF)网络中,联合预测几何形状和连续材料区域。实验结果表明,该系统在单材料和多材料对象上实现了预测材料与实际材料的高度对应,在多材料对象的多次操作试验中,平均匹配准确率达到79.87%。

🔬 方法详解

问题定义:现有机器人手内操作中,准确感知物体形状和材料属性仍然是一个挑战。传统方法依赖于显式几何模型或手工设计的特征,泛化能力有限。此外,如何有效地融合视觉和触觉信息,实现对物体属性的连续预测也是一个难点。

核心思路:SemanticFeels的核心思路是将语义标签(例如材料类型)嵌入到神经隐式形状表示中。通过联合预测几何形状和材料属性,实现对物体更全面的理解。利用神经网络强大的特征提取能力,从视觉和触觉数据中学习到物体的内在属性表示。

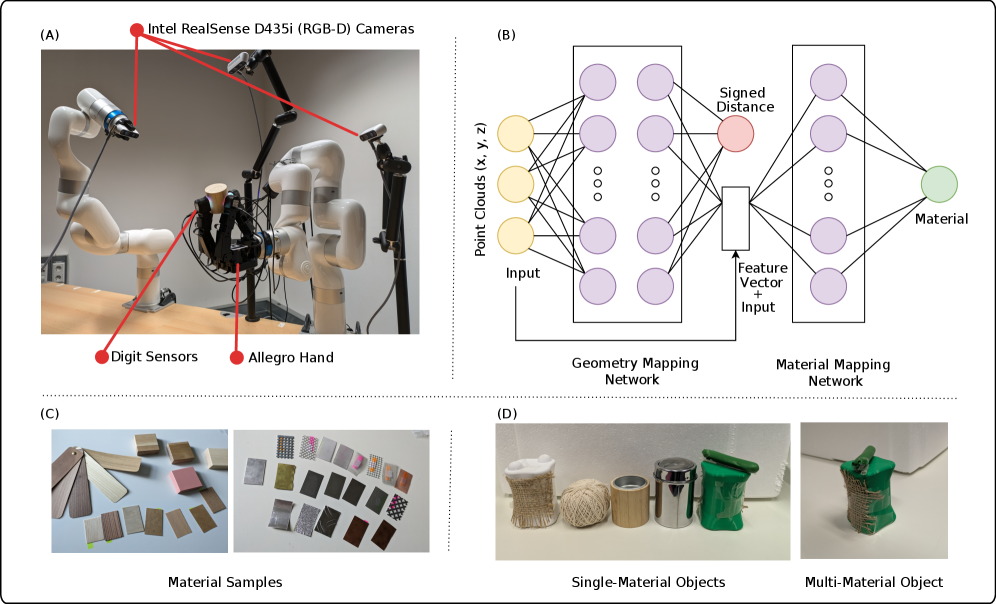

技术框架:SemanticFeels框架包含以下几个主要模块:1) 触觉数据采集:使用Digit触觉传感器获取高分辨率触觉读数。2) 局部材料预测:使用微调的EfficientNet-B0 CNN处理触觉读数,生成局部材料预测。3) 增强的SDF网络:将局部材料预测嵌入到增强的符号距离场(SDF)网络中,该网络同时预测几何形状和连续材料区域。4) 联合优化:通过联合优化几何形状和材料属性的损失函数,提高预测精度。

关键创新:SemanticFeels的关键创新在于将语义标签集成到神经隐式形状表示中。与传统的仅关注几何形状重建的方法不同,SemanticFeels能够同时预测物体的几何形状和材料属性。此外,该框架有效地融合了视觉和触觉信息,提高了对物体属性的感知能力。

关键设计:EfficientNet-B0 CNN经过微调,以适应触觉数据的特点。SDF网络采用MLP结构,输入为空间坐标和触觉特征,输出为符号距离值和材料属性。损失函数包括几何重建损失和材料分类损失。实验中,使用了真实世界的触觉数据和视觉数据进行训练和测试。参数设置方面,采用了Adam优化器,学习率设置为0.001,batch size设置为32。

🖼️ 关键图片

📊 实验亮点

实验结果表明,SemanticFeels在单材料和多材料对象上均取得了良好的性能。在多材料对象的多次操作试验中,平均匹配准确率达到79.87%。这表明该系统能够有效地识别物体的材料属性,并将其与几何形状相结合。与传统的基于视觉的方法相比,SemanticFeels能够更好地处理遮挡和光照变化等问题。

🎯 应用场景

SemanticFeels在机器人手内操作、物体识别、材料分类等领域具有广泛的应用前景。例如,可以应用于智能装配、物体抓取、质量检测等任务。通过感知物体的形状和材料属性,机器人可以更好地理解周围环境,从而实现更智能、更灵活的操作。未来,该技术有望应用于医疗、制造、服务等多个行业。

📄 摘要(原文)

As robots become increasingly integrated into everyday tasks, their ability to perceive both the shape and properties of objects during in-hand manipulation becomes critical for adaptive and intelligent behavior. We present SemanticFeels, an extension of the NeuralFeels framework that integrates semantic labeling with neural implicit shape representation, from vision and touch. To illustrate its application, we focus on material classification: high-resolution Digit tactile readings are processed by a fine-tuned EfficientNet-B0 convolutional neural network (CNN) to generate local material predictions, which are then embedded into an augmented signed distance field (SDF) network that jointly predicts geometry and continuous material regions. Experimental results show that the system achieves a high correspondence between predicted and actual materials on both single- and multi-material objects, with an average matching accuracy of 79.87% across multiple manipulation trials on a multi-material object.