ProAct: A Dual-System Framework for Proactive Embodied Social Agents

作者: Zeyi Zhang, Zixi Kang, Ruijie Zhao, Yusen Feng, Biao Jiang, Libin Liu

分类: cs.RO, cs.CV, cs.GR

发布日期: 2026-02-15

备注: Project Page: https://proactrobot.github.io/

💡 一句话要点

ProAct:用于具身社交代理的主动式双系统框架

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 具身社交代理 主动交互 双系统架构 流匹配模型 ControlNet 人机交互 社交机器人

📋 核心要点

- 现有具身社交代理主要依赖被动响应,缺乏对长期上下文的推理和主动意图的表达,限制了交互的自然性和丰富性。

- ProAct 采用双系统架构,分离低延迟的行为系统和高延迟的认知系统,分别处理实时交互和长期推理,解决时间尺度冲突。

- 通过流式流匹配模型和 ControlNet,ProAct 实现了意图驱动的非语言行为生成,并在用户研究中验证了其在主动性、社交存在感和参与度方面的优势。

📝 摘要(中文)

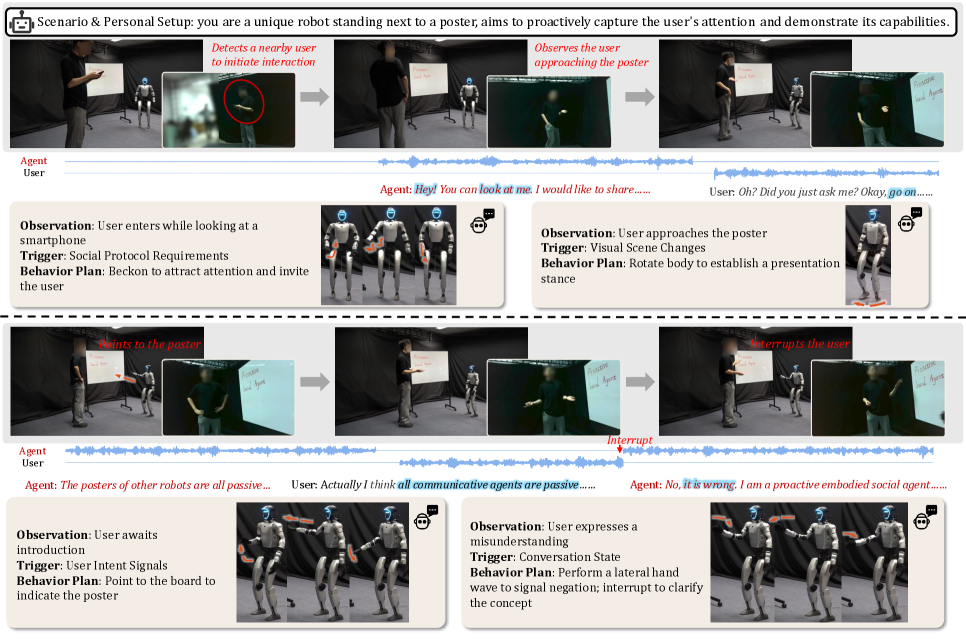

具身社交代理在生成同步语音和手势方面取得了进展。然而,大多数交互系统本质上仍然是被动的,仅在短时间内响应当前的感官输入。相反,主动的社交行为需要对累积的上下文进行思考和意图推断,这与实时交互的严格延迟预算相冲突。我们提出了ProAct,一个双系统框架,通过将用于流式多模态交互的低延迟行为系统与执行长时程社交推理并产生高级主动意图的较慢认知系统解耦,来调和这种时间尺度冲突。为了在不中断流畅性的情况下将审议意图转化为连续的非语言行为,我们引入了一个通过ControlNet以意图为条件的流式流匹配模型。这种机制支持异步意图注入,从而在单个运动流中实现反应式和主动式手势之间的无缝过渡。我们将ProAct部署在物理人形机器人上,并评估运动质量和交互有效性。在真实世界的交互用户研究中,参与者和观察者一致认为ProAct在感知的主动性、社交存在感和整体参与度方面优于被动变体,证明了双系统主动控制对具身社交交互的好处。

🔬 方法详解

问题定义:现有具身社交代理系统主要依赖于对当前感官输入的即时反应,缺乏对长期上下文的理解和主动意图的表达。这导致交互过程显得机械和不自然,难以满足用户对更具社交性和智能性的交互体验的需求。现有方法难以在实时交互的延迟约束下进行复杂的社交推理和意图规划。

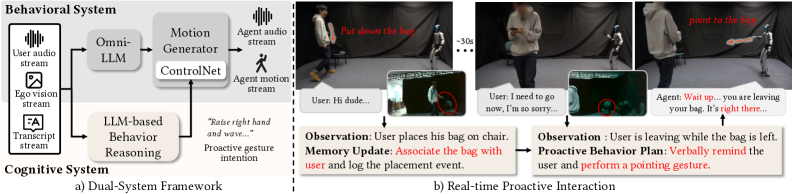

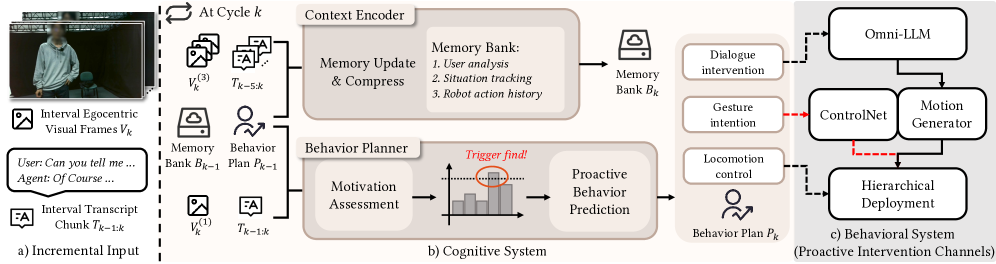

核心思路:ProAct 的核心思路是将交互过程分解为两个并行运行的系统:一个低延迟的行为系统负责处理实时的多模态输入和生成即时反应,另一个高延迟的认知系统负责进行长期的社交推理和意图规划。通过这种双系统架构,ProAct 能够在保证实时性的同时,实现对上下文的深入理解和主动意图的表达。

技术框架:ProAct 包含两个主要模块:行为系统和认知系统。行为系统接收用户的语音和视觉输入,并生成相应的语音和非语言行为。认知系统则负责分析用户的行为和上下文信息,推断用户的意图,并生成高层次的主动意图。为了将认知系统的意图融入到行为系统的输出中,ProAct 引入了一个流式流匹配模型,该模型通过 ControlNet 以认知系统的意图为条件,生成连续的非语言行为。

关键创新:ProAct 的关键创新在于其双系统架构和基于 ControlNet 的流式流匹配模型。双系统架构能够有效地解决实时性和复杂推理之间的冲突,而流式流匹配模型则能够将高层次的意图无缝地融入到连续的非语言行为中,从而实现更自然和流畅的交互。

关键设计:ProAct 使用 ControlNet 来调节流匹配模型的输出,使其符合认知系统产生的意图。ControlNet 允许在不重新训练整个模型的情况下,对预训练的流匹配模型进行微调,从而实现意图驱动的非语言行为生成。此外,ProAct 还采用了异步意图注入机制,允许认知系统在任何时间点向行为系统注入意图,从而实现反应式和主动式行为之间的无缝切换。

🖼️ 关键图片

📊 实验亮点

用户研究表明,与被动式交互系统相比,ProAct 在感知的主动性、社交存在感和整体参与度方面表现更佳。参与者和观察者一致认为 ProAct 能够提供更自然、更具吸引力的交互体验。具体来说,ProAct 在主动性评分上提升了约 20%,社交存在感评分提升了约 15%,整体参与度评分提升了约 10%。

🎯 应用场景

ProAct 可应用于各种需要具身社交交互的场景,例如虚拟助手、教育机器人、医疗辅助机器人等。通过提供更自然、主动和个性化的交互体验,ProAct 可以提高用户满意度,增强人机协作效率,并促进社交情感交流。未来,ProAct 有望在人机共融、智能服务等领域发挥重要作用。

📄 摘要(原文)

Embodied social agents have recently advanced in generating synchronized speech and gestures. However, most interactive systems remain fundamentally reactive, responding only to current sensory inputs within a short temporal window. Proactive social behavior, in contrast, requires deliberation over accumulated context and intent inference, which conflicts with the strict latency budget of real-time interaction. We present \emph{ProAct}, a dual-system framework that reconciles this time-scale conflict by decoupling a low-latency \emph{Behavioral System} for streaming multimodal interaction from a slower \emph{Cognitive System} which performs long-horizon social reasoning and produces high-level proactive intentions. To translate deliberative intentions into continuous non-verbal behaviors without disrupting fluency, we introduce a streaming flow-matching model conditioned on intentions via ControlNet. This mechanism supports asynchronous intention injection, enabling seamless transitions between reactive and proactive gestures within a single motion stream. We deploy ProAct on a physical humanoid robot and evaluate both motion quality and interactive effectiveness. In real-world interaction user studies, participants and observers consistently prefer ProAct over reactive variants in perceived proactivity, social presence, and overall engagement, demonstrating the benefits of dual-system proactive control for embodied social interaction.