Semantic-Contact Fields for Category-Level Generalizable Tactile Tool Manipulation

作者: Kevin Yuchen Ma, Heng Zhang, Weisi Lin, Mike Zheng Shou, Yan Wu

分类: cs.RO

发布日期: 2026-02-14

💡 一句话要点

提出语义-接触场(SCFields)以实现类别级通用触觉工具操作

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture) 支柱四:生成式动作 (Generative Motion) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 触觉感知 工具操作 Sim-to-Real 语义理解 机器人控制

📋 核心要点

- 现有方法难以在接触丰富的工具操作中实现通用性,VLA模型缺乏物理基础,触觉策略则难以泛化到不同工具。

- 论文提出语义-接触场(SCFields),融合视觉语义和密集接触估计,实现对不同工具的统一接触表示。

- 通过两阶段Sim-to-Real学习流程,先在模拟数据上预训练,再在真实数据上微调,实验证明了其类别级泛化能力。

📝 摘要(中文)

通用工具操作需要语义规划和精确物理控制。现有通用机器人策略,如视觉-语言-动作(VLA)模型,缺乏接触丰富的工具操作所需的高保真物理基础。另一方面,利用触觉感知的现有接触感知策略通常是特定实例的,无法推广到不同的工具几何形状。为了弥合这一差距,需要从多样化数据中学习统一的接触表示,但一个根本障碍仍然存在:大规模多样化的真实世界触觉数据获取成本高昂,而由于软传感器非线性变形的复杂动力学,直接零样本Sim-to-Real迁移具有挑战性。为了解决这个问题,我们提出了语义-接触场(SCFields),一种融合视觉语义和密集接触估计的统一3D表示。我们通过一个两阶段的Sim-to-Real接触学习流程来实现这一点:首先,我们在大型模拟数据集上进行预训练,以学习一般的接触物理;其次,我们在少量真实数据上进行微调,通过几何启发式和力优化进行伪标记,以对齐传感器特性。这允许物理泛化到未见过的工具。我们利用SCFields作为扩散策略的密集观察输入,以实现接触丰富的工具操作任务的稳健执行。在刮削、蜡笔绘画和剥离方面的实验表明,类别级别的泛化能力很强,明显优于仅视觉和原始触觉基线。

🔬 方法详解

问题定义:现有方法在工具操作的泛化性上存在不足。视觉-语言-动作模型虽然具备一定的通用性,但在接触丰富的操作中缺乏足够的物理基础。而依赖触觉感知的策略往往是针对特定工具实例设计的,难以推广到新的工具类别。因此,如何学习一种能够跨越不同工具几何形状的通用接触表示,是本研究要解决的核心问题。

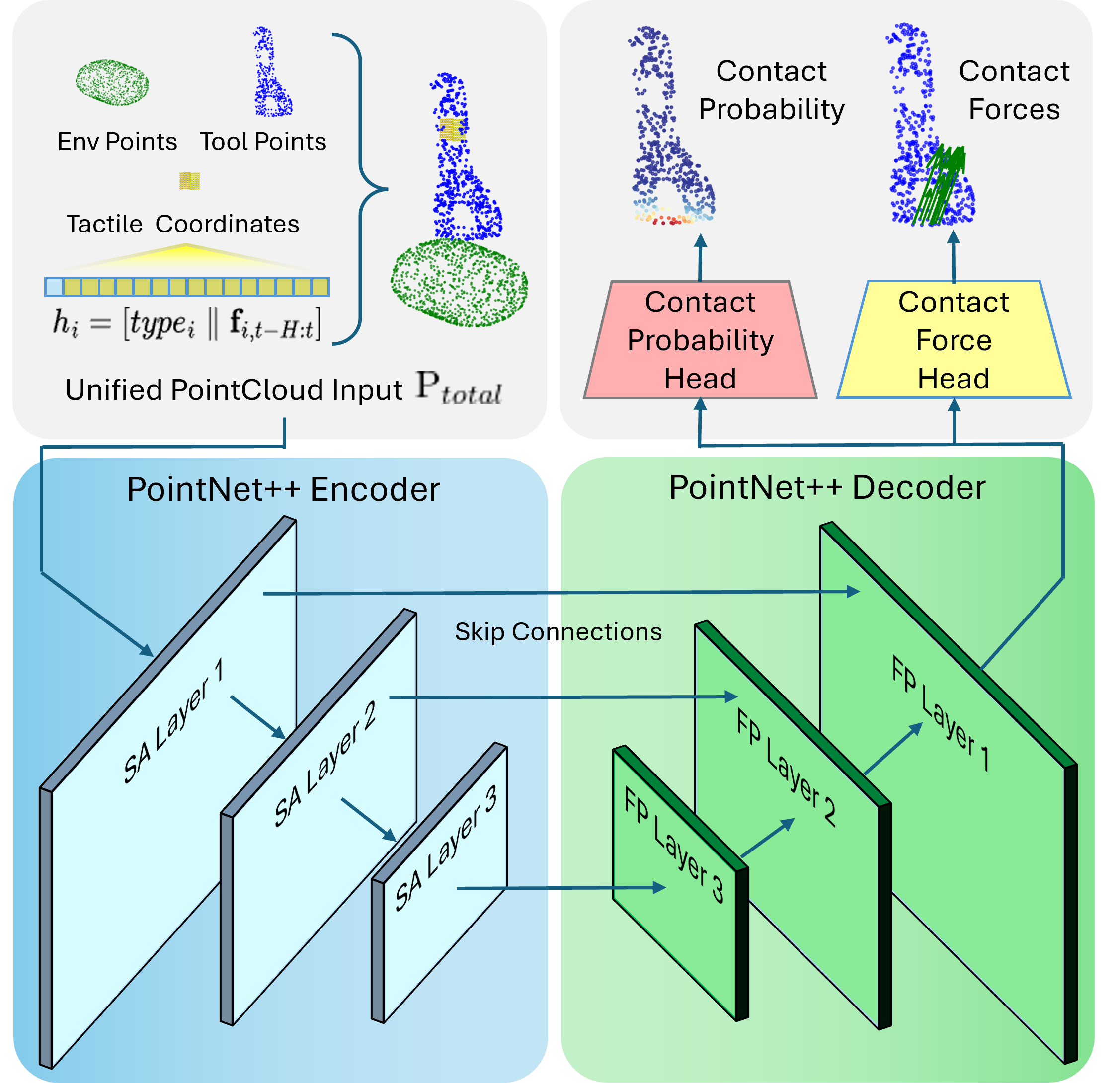

核心思路:论文的核心思路是将视觉语义信息与密集的接触估计相结合,构建一种统一的3D表示,称为语义-接触场(SCFields)。通过这种方式,模型可以同时理解工具的形状、语义以及与环境的接触状态,从而实现更鲁棒和泛化的工具操作。

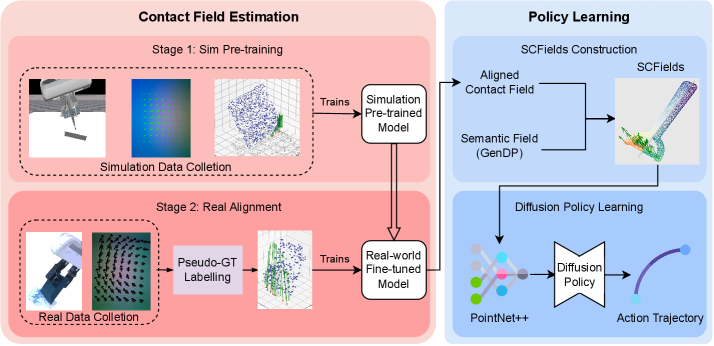

技术框架:整体框架包含两个主要阶段:Sim-to-Real接触学习流程和基于扩散策略的工具操作。Sim-to-Real流程又分为两个步骤:首先,在大量的模拟数据上预训练模型,学习通用的接触物理规律;然后,在少量的真实数据上进行微调,利用几何启发式和力优化方法生成伪标签,从而对齐模拟和真实环境中的传感器特性。最终,将SCFields作为扩散策略的输入,实现对工具的精确控制。

关键创新:最重要的创新点在于提出了语义-接触场(SCFields)这一概念,它将视觉语义信息和密集的接触估计融合在一起,形成了一种更全面、更具表达力的工具表示。与传统的仅依赖视觉或触觉信息的表示方法相比,SCFields能够更好地捕捉工具与环境之间的复杂交互关系。

关键设计:在Sim-to-Real流程中,几何启发式方法用于生成初始的伪标签,力优化方法则用于进一步 refinement。扩散策略用于控制工具的运动,其输入是SCFields,输出是工具的动作。具体的网络结构和损失函数细节在论文中应该有更详细的描述(未知)。

🖼️ 关键图片

📊 实验亮点

实验结果表明,提出的SCFields方法在刮削、蜡笔绘画和剥离等任务中表现出色,实现了类别级别的泛化。相较于仅使用视觉信息或原始触觉信息的基线方法,SCFields取得了显著的性能提升(具体提升幅度未知)。这证明了融合视觉语义和接触信息的有效性,以及Sim-to-Real学习流程的优越性。

🎯 应用场景

该研究成果可应用于各种需要精细操作的机器人任务,例如:自动化装配、医疗手术、家庭服务等。通过提升机器人对工具操作的通用性和鲁棒性,可以降低对特定环境和工具的依赖,从而拓展机器人的应用范围,提高生产效率和服务质量。未来,该技术有望应用于更复杂的机器人系统中,实现更智能、更自主的操作。

📄 摘要(原文)

Generalizing tool manipulation requires both semantic planning and precise physical control. Modern generalist robot policies, such as Vision-Language-Action (VLA) models, often lack the high-fidelity physical grounding required for contact-rich tool manipulation. Conversely, existing contact-aware policies that leverage tactile or haptic sensing are typically instance-specific and fail to generalize across diverse tool geometries. Bridging this gap requires learning unified contact representations from diverse data, yet a fundamental barrier remains: diverse real-world tactile data are prohibitive at scale, while direct zero-shot sim-to-real transfer is challenging due to the complex dynamics of nonlinear deformation of soft sensors. To address this, we propose Semantic-Contact Fields (SCFields), a unified 3D representation fusing visual semantics with dense contact estimates. We enable this via a two-stage Sim-to-Real Contact Learning Pipeline: first, we pre-train on a large simulation data set to learn general contact physics; second, we fine-tune on a small set of real data, pseudo-labeled via geometric heuristics and force optimization, to align sensor characteristics. This allows physical generalization to unseen tools. We leverage SCFields as the dense observation input for a diffusion policy to enable robust execution of contact-rich tool manipulation tasks. Experiments on scraping, crayon drawing, and peeling demonstrate robust category-level generalization, significantly outperforming vision-only and raw-tactile baselines.