Ontological grounding for sound and natural robot explanations via large language models

作者: Alberto Olivares-Alarcos, Muhammad Ahsan, Satrio Sanjaya, Hsien-I Lin, Guillem Alenyà

分类: cs.RO, cs.HC

发布日期: 2026-02-14

备注: An extended abstract of this article is accepted for presentation at AAMAS 2026: Olivares-Alarcos, A., Muhammad, A., Sanjaya, S., Lin, H. and Alenyà, G. (2026). Blending ontologies and language models to generate sound and natural robot explanations. In Proceedings of the International Conference on Autonomous Agents and Multiagent Systems. IFAAMAS

💡 一句话要点

提出一种融合本体推理与大语言模型的混合框架,用于生成语义对齐且自然的机器人解释。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 人机交互 机器人解释 本体推理 大型语言模型 可解释代理

📋 核心要点

- 现有机器人解释缺乏逻辑一致性和领域知识,难以满足人类的期望。

- 该方法融合本体推理与大语言模型,利用本体保证逻辑性,LLM生成自然语言。

- 实验表明,该方法在保持语义准确性的前提下,显著提高了机器人解释的清晰度和简洁性。

📝 摘要(中文)

本文提出了一种混合框架,该框架融合了基于本体的推理与大型语言模型(LLM),旨在生成语义对齐且自然的机器人解释,从而构建有效的人机交互。本体确保了逻辑一致性和领域基础,而LLM提供了流畅、上下文感知和自适应的语言生成。该方法能够从人机交互经验中获取数据,使机器人能够根据事件的属性来推断事件是否典型。本文集成了一种用于检索和构建静态对比本体叙事的先进算法,以及一个LLM代理,该代理使用这些叙事来生成简洁、清晰、交互式的解释。通过复制工业协作任务的实验室研究验证了该方法。实验结果表明,在保持语义准确性的前提下,基于本体的叙事的清晰度和简洁性得到了显著提高。初步评估进一步证明了系统适应用户反馈的能力。总而言之,这项工作突出了本体-LLM集成在推进可解释代理和促进更透明的人机协作方面的潜力。

🔬 方法详解

问题定义:现有机器人解释方法通常难以兼顾逻辑严谨性和表达的自然性。一方面,基于规则或本体的方法虽然逻辑清晰,但表达生硬,缺乏灵活性;另一方面,直接使用大型语言模型生成解释可能导致逻辑错误或与领域知识不符,缺乏可信度。因此,如何生成既符合逻辑又自然流畅的机器人解释是一个挑战。

核心思路:本文的核心思路是将本体推理的严谨性和大型语言模型的自然语言生成能力相结合。通过本体来保证解释的逻辑一致性和领域知识的正确性,同时利用大型语言模型将这些知识以自然、流畅的方式表达出来,从而实现语义对齐且自然的机器人解释。

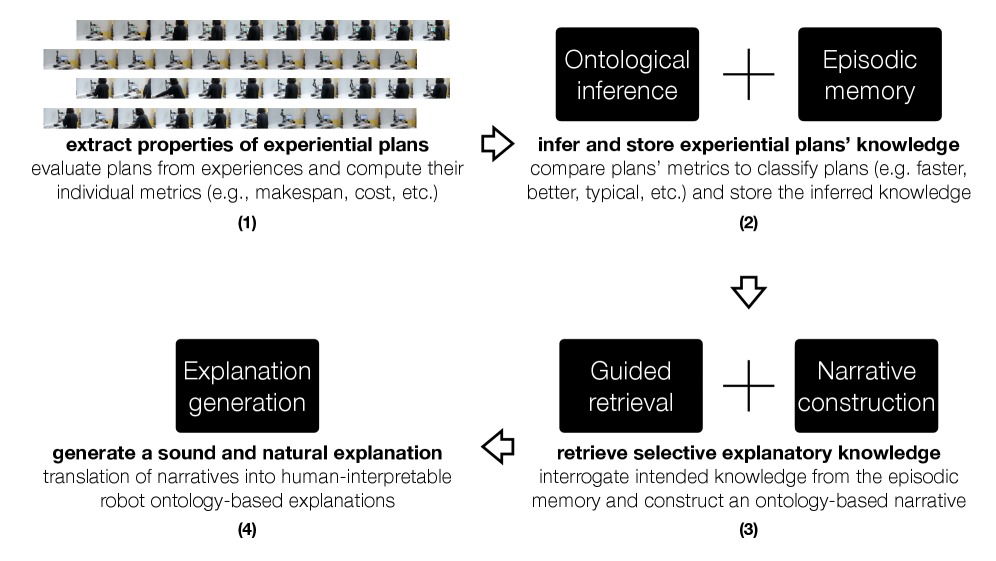

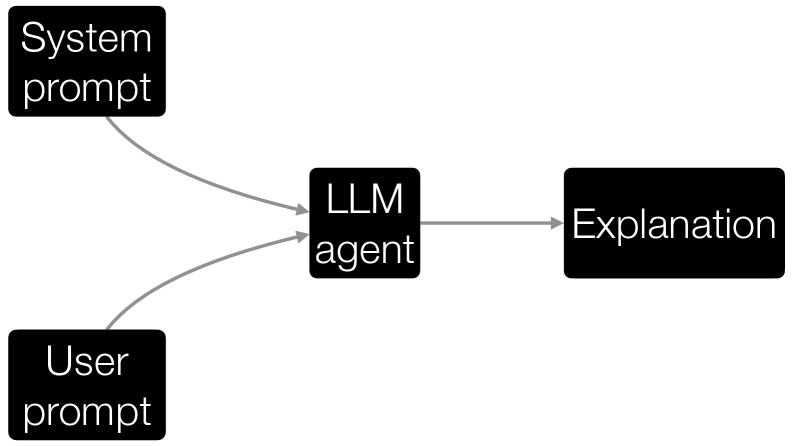

技术框架:该框架包含以下主要模块:1) 人机交互数据采集模块,用于收集机器人与人类交互过程中的数据;2) 本体构建与维护模块,用于构建和维护领域本体,确保知识的准确性和一致性;3) 基于本体的推理模块,用于根据本体知识对交互数据进行推理,判断事件的典型性;4) 叙事构建模块,用于根据推理结果构建对比叙事,突出事件的特点;5) 大型语言模型代理,用于将对比叙事转化为自然语言解释,并根据用户反馈进行调整。

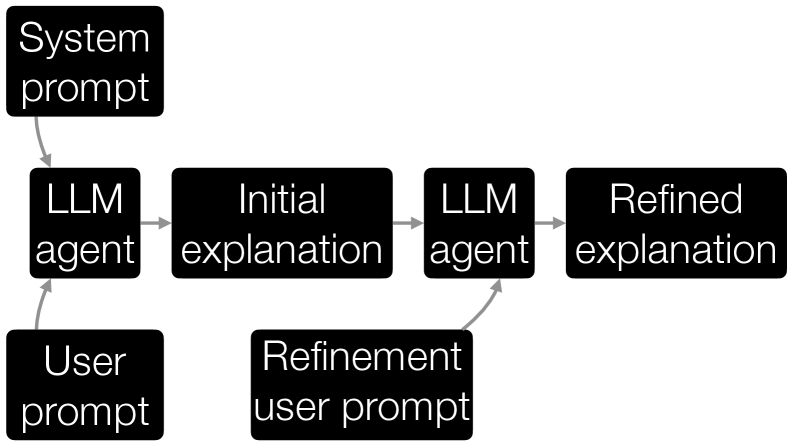

关键创新:该方法最重要的创新点在于将本体推理与大型语言模型相结合,实现了一种混合式的机器人解释生成框架。与传统方法相比,该方法既保证了解释的逻辑严谨性,又提高了表达的自然性和灵活性。此外,该方法还能够根据用户反馈动态调整解释,提高了人机交互的效率。

关键设计:论文采用了一种静态对比本体叙事构建算法,用于从本体中提取相关信息,并构建对比叙事。同时,利用大型语言模型作为代理,将对比叙事转化为自然语言解释。具体的参数设置和网络结构等技术细节在论文中没有详细描述,属于未知信息。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在保持语义准确性的前提下,显著提高了基于本体的叙事的清晰度和简洁性。初步评估还表明,该系统能够根据用户反馈调整解释,提升了人机交互的效率。具体的性能数据和提升幅度在论文中没有详细给出,属于未知信息。

🎯 应用场景

该研究成果可应用于各种人机协作场景,例如工业机器人、服务机器人、医疗机器人等。通过提供清晰、自然且符合逻辑的解释,可以提高用户对机器人的信任度,促进人机协作的效率和安全性。未来,该方法有望应用于更复杂的任务和更广泛的领域。

📄 摘要(原文)

Building effective human-robot interaction requires robots to derive conclusions from their experiences that are both logically sound and communicated in ways aligned with human expectations. This paper presents a hybrid framework that blends ontology-based reasoning with large language models (LLMs) to produce semantically grounded and natural robot explanations. Ontologies ensure logical consistency and domain grounding, while LLMs provide fluent, context-aware and adaptive language generation. The proposed method grounds data from human-robot experiences, enabling robots to reason about whether events are typical or atypical based on their properties. We integrate a state-of-the-art algorithm for retrieving and constructing static contrastive ontology-based narratives with an LLM agent that uses them to produce concise, clear, interactive explanations. The approach is validated through a laboratory study replicating an industrial collaborative task. Empirical results show significant improvements in the clarity and brevity of ontology-based narratives while preserving their semantic accuracy. Initial evaluations further demonstrate the system's ability to adapt explanations to user feedback. Overall, this work highlights the potential of ontology-LLM integration to advance explainable agency, and promote more transparent human-robot collaboration.