Safe-SDL:Establishing Safety Boundaries and Control Mechanisms for AI-Driven Self-Driving Laboratories

作者: Zihan Zhang, Haohui Que, Junhan Chang, Xin Zhang, Hao Wei, Tong Zhu

分类: cs.RO, cs.AI

发布日期: 2026-02-13

💡 一句话要点

Safe-SDL:为AI驱动的自动驾驶实验室建立安全边界与控制机制

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 自动驾驶实验室 安全框架 操作设计域 控制障碍函数 事务安全协议 人工智能安全 机器人安全

📋 核心要点

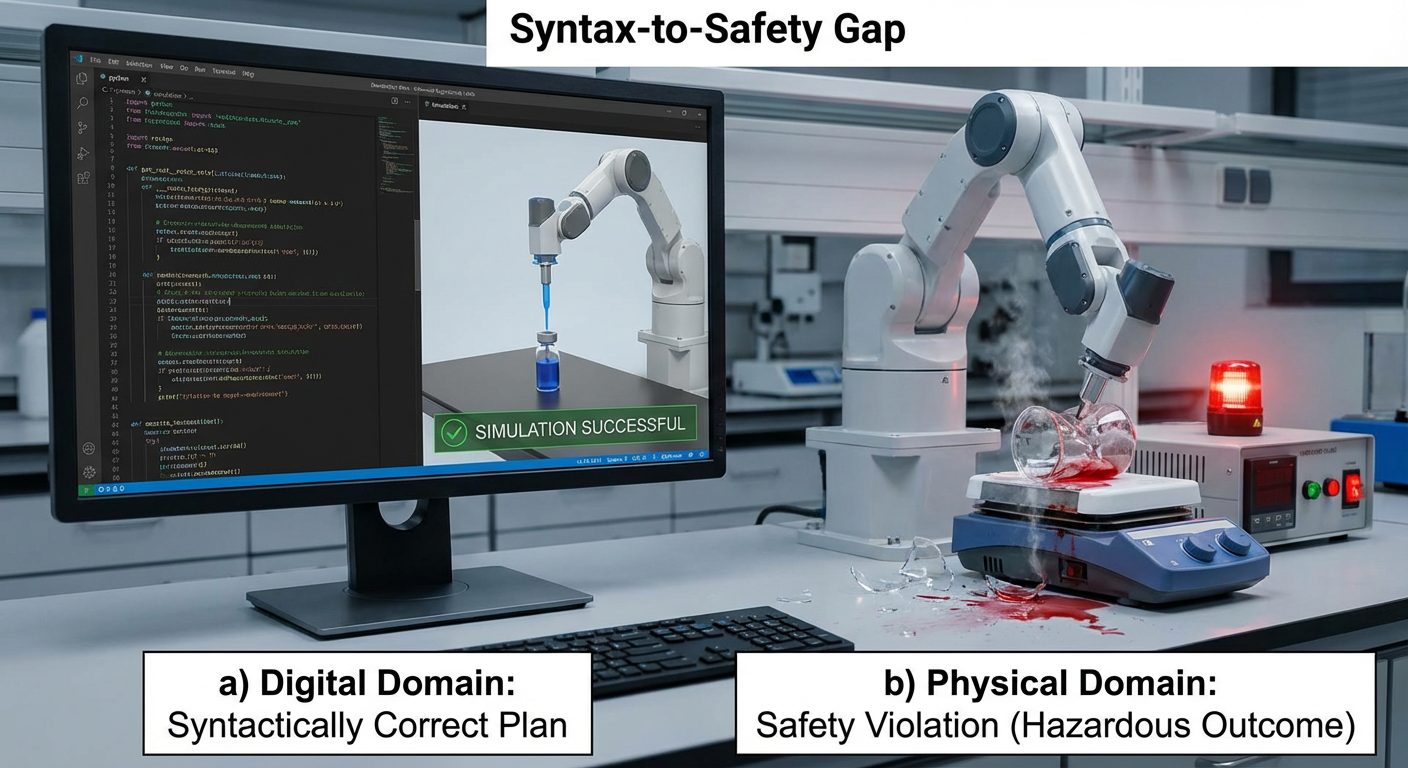

- 现有SDL面临“语法到安全差距”挑战,即AI生成指令在语法正确但物理执行上可能不安全。

- Safe-SDL框架通过操作设计域、控制障碍函数和事务安全协议,弥合这一差距,确保安全。

- 实验表明,现有基础模型存在安全漏洞,Safe-SDL提供的架构安全机制至关重要。

📝 摘要(中文)

自动驾驶实验室(SDLs)的出现通过将人工智能与机器人自动化相结合,改变了科学发现的方法,创建了能够自主生成假设、进行实验和分析的闭环实验系统。虽然有望将研究时间从数年压缩到数周,但它们的部署引入了前所未有的安全挑战,这与传统的实验室或纯粹的数字AI不同。本文提出了Safe-SDL,一个全面的框架,用于在AI驱动的自主实验室中建立强大的安全边界和控制机制。我们识别并分析了关键的“语法到安全差距”——AI生成的语法正确的命令与其物理安全影响之间的脱节——作为SDL部署中的核心挑战。我们的框架通过三个协同组件来解决这一差距:(1)正式定义的操作设计域(ODDs),将系统行为约束在经过数学验证的边界内,(2)控制障碍函数(CBFs),通过连续状态空间监测提供实时安全保证,(3)一种新颖的事务安全协议(CRUTD),确保数字规划和物理执行之间的一致性。我们通过分析包括UniLabOS和Osprey架构在内的现有实现来验证我们的理论贡献,展示了这些系统如何实例化关键的安全原则。针对LabSafety Bench的评估表明,当前的基础模型表现出显著的安全故障,表明架构安全机制是必不可少的,而不是可有可无的。我们的框架为安全部署自主科学系统提供了理论基础和实践指导,为负责任地加速AI驱动的发现奠定了基础。

🔬 方法详解

问题定义:论文旨在解决AI驱动的自动驾驶实验室(SDLs)中存在的安全问题。现有方法主要依赖于人工干预或简单的安全规则,无法充分应对SDL复杂、动态的实验环境。核心痛点在于AI生成的指令虽然语法正确,但可能导致物理世界的危险操作,即“语法到安全差距”。

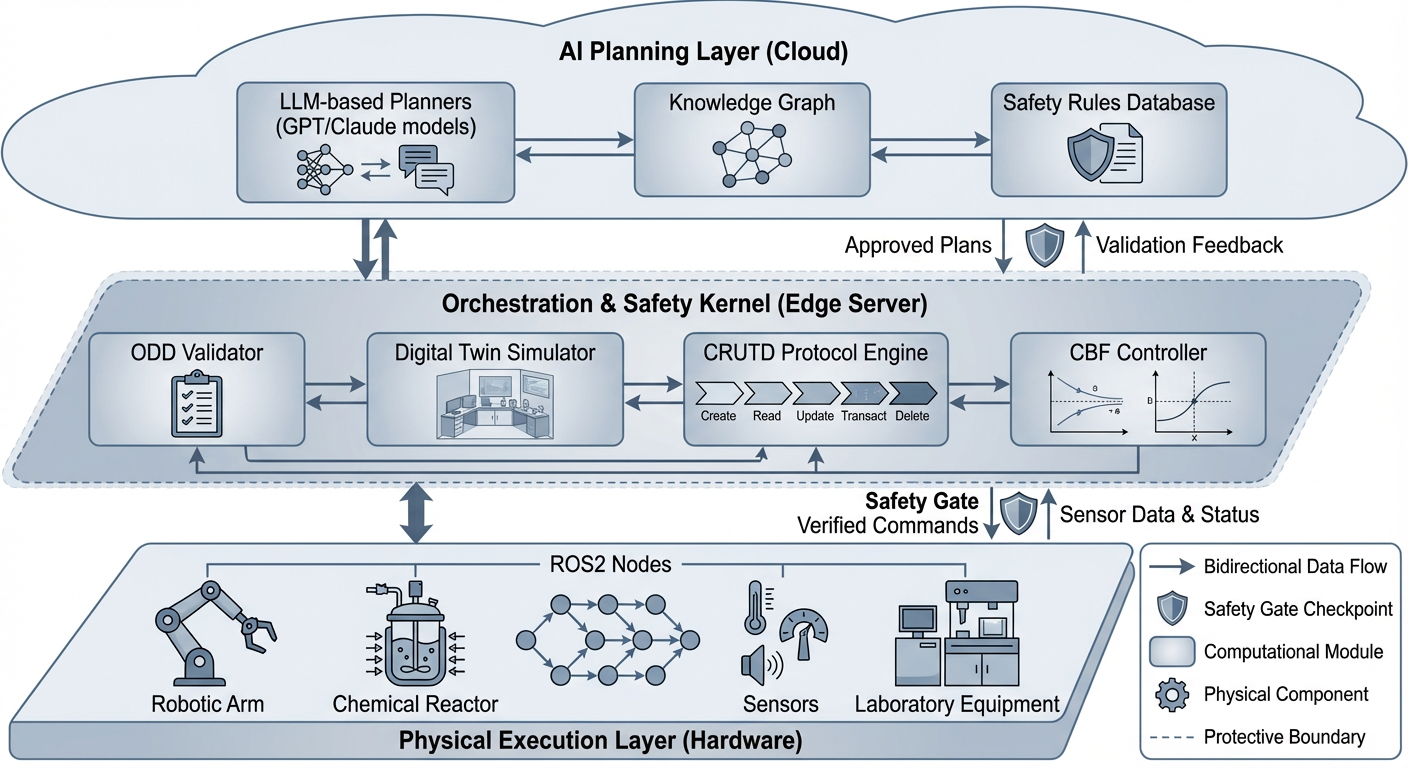

核心思路:论文的核心思路是通过多层次的安全保障机制,将AI的决策约束在安全范围内。具体而言,通过定义操作设计域(ODDs)来限制实验范围,利用控制障碍函数(CBFs)进行实时安全监控,并采用事务安全协议(CRUTD)确保数字规划与物理执行的一致性。这种分层设计旨在从根本上解决“语法到安全差距”问题。

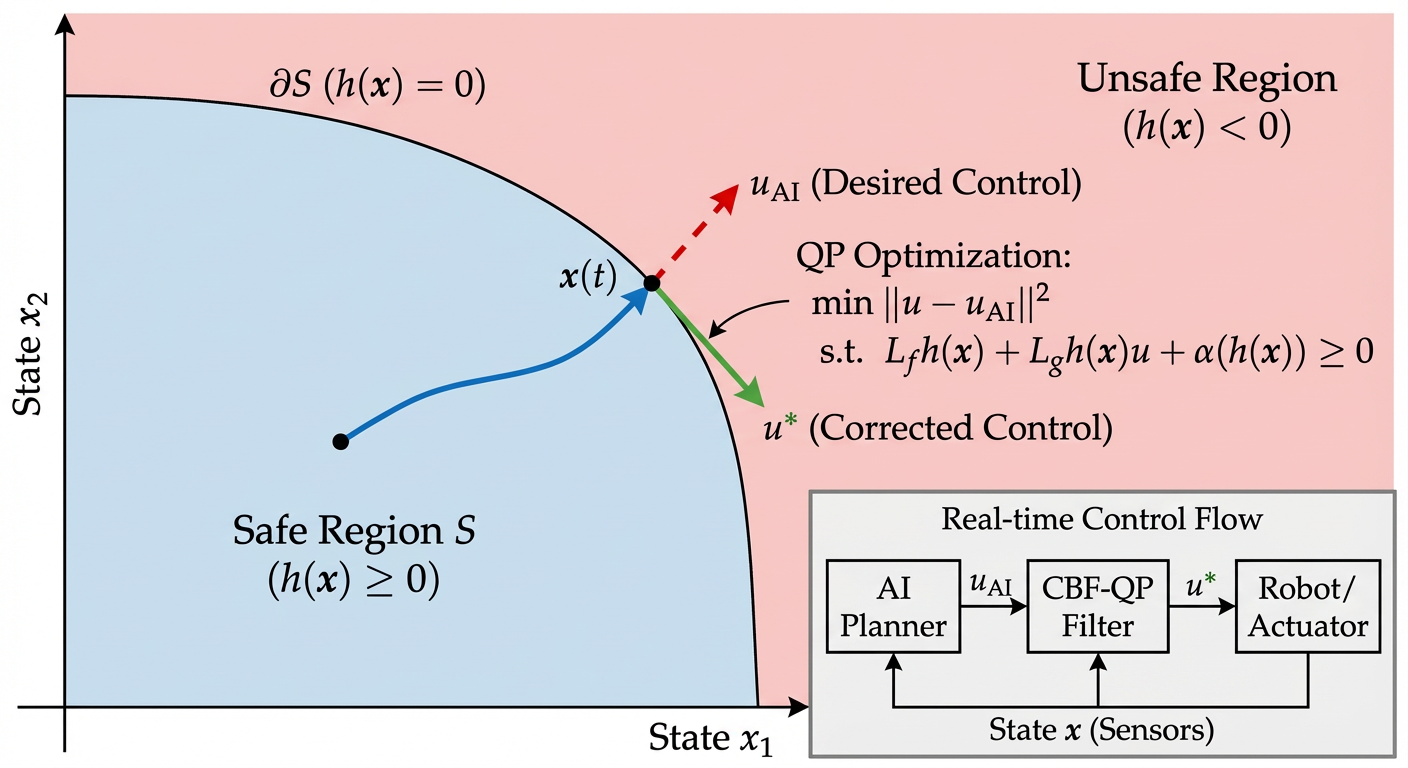

技术框架:Safe-SDL框架包含三个主要组件:1) 操作设计域(ODDs):定义系统安全运行的边界,通过数学公式进行验证。2) 控制障碍函数(CBFs):实时监控系统状态,并在即将超出安全边界时进行干预,确保系统安全。3) 事务安全协议(CRUTD):确保数字规划与物理执行的原子性,防止因执行中断或错误导致的安全问题。这三个组件协同工作,形成一个完整的安全保障体系。

关键创新:论文的关键创新在于提出了一个综合性的安全框架,将操作设计域、控制障碍函数和事务安全协议相结合,为AI驱动的自动驾驶实验室提供多层次的安全保障。与现有方法相比,Safe-SDL不仅关注指令的语法正确性,更关注其在物理世界中的安全影响,从而有效弥补了“语法到安全差距”。

关键设计:ODDs的设计需要根据具体的实验环境和任务进行定义,通常涉及对实验参数、设备状态和环境条件的约束。CBFs的设计需要考虑系统的动力学特性和安全边界,选择合适的控制策略以确保系统状态始终在安全范围内。CRUTD协议的设计需要确保数字规划和物理执行的原子性,例如,采用两阶段提交协议或类似的机制来保证数据一致性。

🖼️ 关键图片

📊 实验亮点

论文通过LabSafety Bench对现有基础模型进行了评估,结果表明这些模型存在显著的安全漏洞,强调了架构安全机制的重要性。对UniLabOS和Osprey架构的分析表明,这些系统在一定程度上体现了Safe-SDL框架的安全原则,验证了该框架的有效性。这些实验结果为Safe-SDL框架的实际应用提供了有力支持。

🎯 应用场景

Safe-SDL框架可广泛应用于化学合成、材料发现、生物工程等领域的自动驾驶实验室。通过提供可靠的安全保障,该框架能够加速科学研究进程,降低实验风险,并促进AI在科学领域的更广泛应用。未来,Safe-SDL有望成为自动驾驶实验室安全设计的标准。

📄 摘要(原文)

The emergence of Self-Driving Laboratories (SDLs) transforms scientific discovery methodology by integrating AI with robotic automation to create closed-loop experimental systems capable of autonomous hypothesis generation, experimentation, and analysis. While promising to compress research timelines from years to weeks, their deployment introduces unprecedented safety challenges differing from traditional laboratories or purely digital AI. This paper presents Safe-SDL, a comprehensive framework for establishing robust safety boundaries and control mechanisms in AI-driven autonomous laboratories. We identify and analyze the critical ``Syntax-to-Safety Gap'' -- the disconnect between AI-generated syntactically correct commands and their physical safety implications -- as the central challenge in SDL deployment. Our framework addresses this gap through three synergistic components: (1) formally defined Operational Design Domains (ODDs) that constrain system behavior within mathematically verified boundaries, (2) Control Barrier Functions (CBFs) that provide real-time safety guarantees through continuous state-space monitoring, and (3) a novel Transactional Safety Protocol (CRUTD) that ensures atomic consistency between digital planning and physical execution. We ground our theoretical contributions through analysis of existing implementations including UniLabOS and the Osprey architecture, demonstrating how these systems instantiate key safety principles. Evaluation against the LabSafety Bench reveals that current foundation models exhibit significant safety failures, demonstrating that architectural safety mechanisms are essential rather than optional. Our framework provides both theoretical foundations and practical implementation guidance for safe deployment of autonomous scientific systems, establishing the groundwork for responsible acceleration of AI-driven discovery.