Imitating What Works: Simulation-Filtered Modular Policy Learning from Human Videos

作者: Albert J. Zhai, Kuo-Hao Zeng, Jiasen Lu, Ali Farhadi, Shenlong Wang, Wei-Chiu Ma

分类: cs.RO, cs.CV, cs.LG

发布日期: 2026-02-13

💡 一句话要点

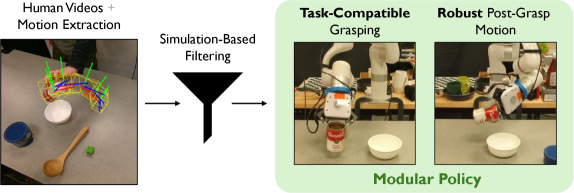

提出PSI框架,通过模拟过滤的人类视频学习模块化操作策略,提升机器人操作技能。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture)

关键词: 机器人操作 模仿学习 模块化策略 模拟过滤 人类视频

📋 核心要点

- 现有方法难以直接从人类视频中学习机器人的抓取行为,尤其当机器人不具备类人手时。

- PSI框架利用模拟环境过滤人类视频数据,为抓取动作添加任务导向的适用性标签,从而实现监督学习。

- 实验表明,PSI框架无需机器人数据即可有效学习操作技能,显著提升了操作的鲁棒性。

📝 摘要(中文)

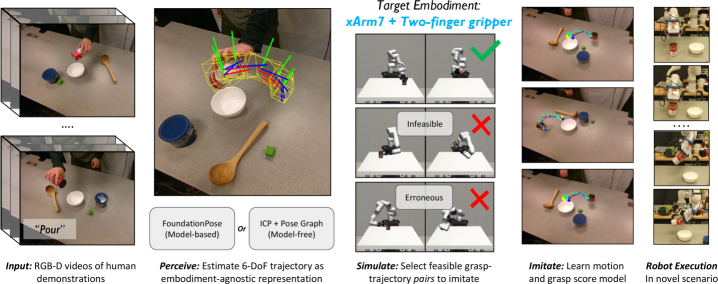

本文提出了一种名为Perceive-Simulate-Imitate (PSI) 的框架,用于训练模块化的操作策略。该框架利用人类视频中的运动数据,并通过模拟环境中的配对抓取-轨迹过滤进行处理。人类视频为学习抓取后的运动提供了强有力的信号,但对于学习先决的抓取行为,尤其是对于没有类人手的机器人来说,效果较差。PSI框架通过模拟步骤扩展轨迹数据,获得抓取适用性标签,从而实现面向任务的抓取能力的监督学习。实验结果表明,该框架无需任何机器人数据即可高效学习精确的操作技能,与直接使用抓取生成器相比,性能更加稳健。

🔬 方法详解

问题定义:论文旨在解决如何利用人类视频数据有效地训练机器人进行灵巧操作的问题,特别是如何克服人类视频在学习抓取行为方面的局限性,因为人类的手和机器人的手存在差异,直接模仿效果不佳。现有方法通常依赖于直接使用抓取生成器,但生成的抓取动作可能与后续的任务不兼容,导致操作失败。

核心思路:核心思路是利用模拟环境来评估和过滤从人类视频中学习到的抓取动作,从而为机器人选择更适合完成特定任务的抓取方式。通过在模拟环境中对抓取动作进行评估,可以为每个抓取动作赋予一个“适用性”标签,用于指导机器人学习更有效的抓取策略。

技术框架:PSI框架包含三个主要阶段:感知(Perceive)、模拟(Simulate)和模仿(Imitate)。首先,感知阶段从人类视频中提取运动轨迹。然后,模拟阶段利用模拟环境,对提取的运动轨迹进行抓取动作的评估和过滤,生成带有适用性标签的数据。最后,模仿阶段利用带有标签的数据,训练一个模块化的操作策略,该策略包含一个抓取生成器和一个运动控制器。

关键创新:关键创新在于使用模拟环境对从人类视频中学习到的抓取动作进行过滤和评估,从而为机器人选择更适合完成特定任务的抓取方式。这种方法克服了直接模仿人类抓取动作的局限性,提高了机器人操作的鲁棒性和效率。

关键设计:PSI框架的关键设计包括:1) 使用模拟环境评估抓取动作的适用性,例如通过评估抓取后物体是否稳定以及是否能够顺利完成后续运动;2) 使用监督学习方法训练抓取生成器,使其能够生成更符合任务需求的抓取动作;3) 使用模块化的策略设计,将抓取和运动控制分离,从而提高策略的灵活性和可扩展性。

🖼️ 关键图片

📊 实验亮点

实验结果表明,PSI框架在真实机器人环境中能够成功学习精确的操作技能,且无需任何机器人数据。与直接使用抓取生成器相比,PSI框架能够显著提高操作的鲁棒性,成功率提升明显。这些结果验证了PSI框架的有效性和优越性。

🎯 应用场景

该研究成果可应用于各种需要机器人进行灵巧操作的场景,例如工业自动化、家庭服务、医疗辅助等。通过学习人类的操作技能,机器人可以更高效、更安全地完成各种任务,提高生产效率和服务质量。此外,该研究也为机器人学习和模仿人类行为提供了一种新的思路。

📄 摘要(原文)

The ability to learn manipulation skills by watching videos of humans has the potential to unlock a new source of highly scalable data for robot learning. Here, we tackle prehensile manipulation, in which tasks involve grasping an object before performing various post-grasp motions. Human videos offer strong signals for learning the post-grasp motions, but they are less useful for learning the prerequisite grasping behaviors, especially for robots without human-like hands. A promising way forward is to use a modular policy design, leveraging a dedicated grasp generator to produce stable grasps. However, arbitrary stable grasps are often not task-compatible, hindering the robot's ability to perform the desired downstream motion. To address this challenge, we present Perceive-Simulate-Imitate (PSI), a framework for training a modular manipulation policy using human video motion data processed by paired grasp-trajectory filtering in simulation. This simulation step extends the trajectory data with grasp suitability labels, which allows for supervised learning of task-oriented grasping capabilities. We show through real-world experiments that our framework can be used to learn precise manipulation skills efficiently without any robot data, resulting in significantly more robust performance than using a grasp generator naively.